在实际调用模型API时,你是否曾被两个参数困惑过:Temperature 和 Top-p?它们就像模型的两个“创造力旋钮”,掌握它们,你就能精准控制模型输出是“保守稳定”还是“天马行空”。

今天,我们就来彻底搞懂这两个参数——它们是什么、怎么用、有什么区别,以及如何在代码中调优。

一、为什么需要“创造力开关”?

大语言模型本质上是“概率预测机”:给定上文,它预测下一个词的概率分布。

如果每次都选概率最高的“很好”,输出会非常确定、重复、乏味。但如果你想让模型写诗、 brainstorm 创意,就需要引入随机性。Temperature 和 Top-p 正是控制这种随机性的两个核心参数。

一句话:它们决定模型是“照本宣科”还是“脑洞大开”。

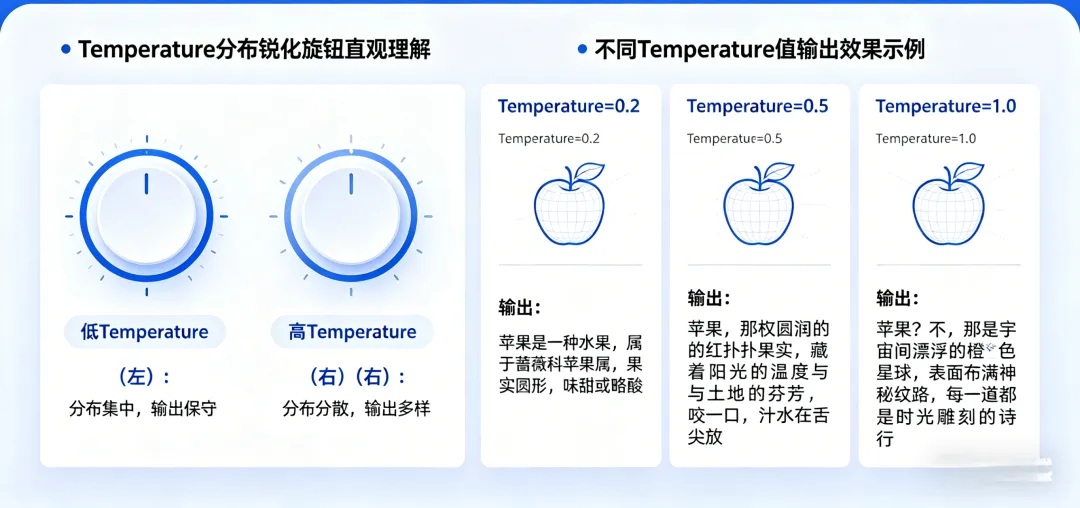

二、Temperature:分布“锐化”旋钮

2.1 直观理解

Temperature 是一个大于0的数值,通常范围在 0~2 之间。它通过调整概率分布的“陡峭程度”来控制随机性:

Temperature 趋近 0:概率分布极度尖锐,最高概率的词几乎总被选中 → 输出确定、可重复。 Temperature = 1:保持原始概率分布,不做调整。 Temperature > 1:概率分布变得平坦,低概率词也有机会被选中 → 输出多样、有创意。

2.2 数学原理(非必需,但有助于理解)

模型输出的是每个词的原始分数(logits)。Softmax 函数将 logits 转换为概率:

P(i) = exp(z_i / T) / Σ exp(z_j / T)

其中 T 就是 Temperature。当 T 越小,指数函数的差异被放大,高概率词更高,低概率词更低;当 T 越大,差异被缩小,所有词概率趋近均匀。

2.3 实际效果示例

输入:“写一个关于猫的句子。”

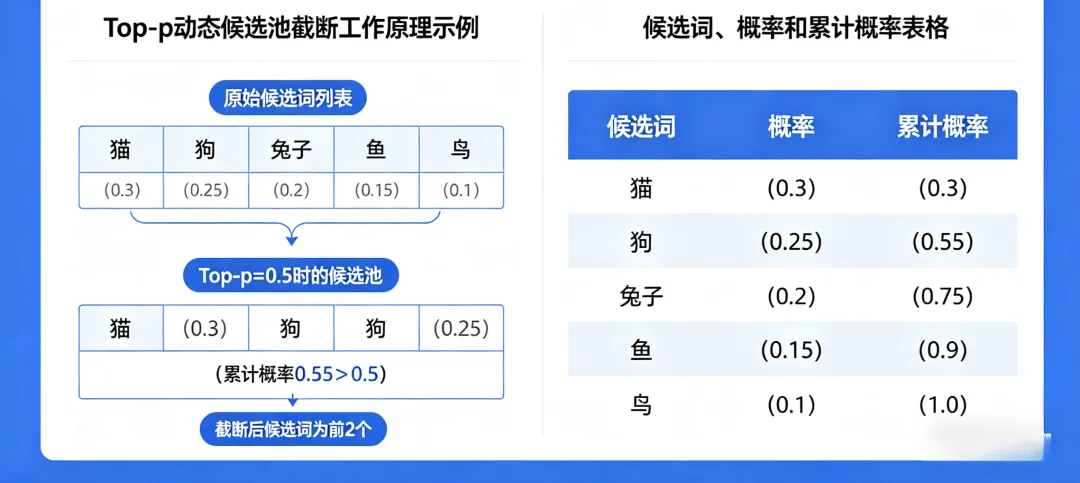

三、Top-p:动态候选池截断

3.1 直观理解

Top-p(也称 nucleus sampling)是一个 0~1 之间的数值。它不直接调整概率值,而是动态选择概率质量总和达到 p 的最小候选词集合,然后从这个集合中采样。

Top-p = 0.1:只从累计概率前 10% 的词中选 → 严格、确定性高。 Top-p = 0.9:覆盖绝大多数可能词 → 多样性好。 Top-p = 1:所有词都纳入候选 → 完全自由。

3.2 工作原理示例

假设模型预测下一个词的概率分布:

若 Top-p = 0.7:候选集为 [很好, 不错](累计概率 0.75 ≥ 0.7),忽略“晴朗”及之后的词。若 Top-p = 0.9:候选集为 [很好, 不错, 晴朗](累计概率 0.90)。

3.3 与 Temperature 的区别

| 作用方式 | ||

| 对分布形状 | ||

| 典型用途 |

两者可以同时使用:先用 Top-p 排除尾部低质量词,再用 Temperature 调整剩余候选的随机性。

四、实战:在代码中调整这两个参数

以 OpenAI API 为例(其他模型如 Claude、文心一言类似):

import openai

response = openai.ChatCompletion.create(

model="gpt-3.5-turbo",

messages=[{"role": "user", "content": "给我一个关于AI的创意故事"}],

temperature=0.8, # 中等创意

top_p=0.9, # 覆盖90%概率质量

max_tokens=150

)

print(response.choices[0].message.content)

4.1 不同场景的参数推荐

| 代码生成、数学推理 | |||

| 客服回复、信息抽取 | |||

| 创意写作、头脑风暴 | |||

| 翻译、摘要 | |||

| 对话机器人(通用) |

4.2 调参技巧

先固定一个,调整另一个:通常先设置 Top-p = 1或0.9,然后调节 Temperature 观察效果。极低 Temperature 不等于完全确定:即使 temperature=0,模型仍可能因浮点误差产生微小变化。如需绝对确定,设置seed参数。Top-p 不宜过小: Top-p < 0.1可能导致候选词太少,输出重复且无意义。**结合 max_tokens和frequency_penalty**:防止重复和过长输出。

五、高级话题:动态调整与自适应

在生产环境中,你可能需要根据任务类型动态调整参数。例如:

首轮生成:用较高 Temperature 探索多种可能。 后续细化:降低 Temperature 收敛到最佳答案。 用户控制:在UI中提供滑块,让用户自己调节“创意程度”。

一些研究尝试让模型自适应的选择 Temperature(如根据上下文不确定性),但目前尚未普及。

六、常见误区

| Temperature 和 Top-p 可以同时设为 0 | |

| Temperature > 1 总是更好 | |

| Top-p 越大输出越好 | |

| 参数调优一次搞定 |

七、总结

| Temperature | ||||

| Top-p |

最佳实践:

确定性任务(代码、数学): temperature=0, top_p=0.2创意任务(写作、闲聊): temperature=0.8, top_p=0.9不确定时从 temperature=0.5, top_p=0.8开始调试。

掌握这两个参数,你就拥有了控制大模型“创造力开关”的能力。在开发 AI 应用时,不妨多尝试不同的组合,找到最适合你场景的“黄金参数”。

互动话题:你在使用大模型 API 时,遇到过因为参数设置不当导致输出质量差的情况吗?欢迎分享你的调参经验!

注:不同模型(如 Claude、Gemini、文心一言)对这两个参数的支持和取值范围可能略有差异,请参考各模型官方文档。

夜雨聆风

夜雨聆风