这两年,“本地部署大模型”这件事越来越火。但很多人一上来就把事情想复杂了:是不是要装 Linux、配 Docker、研究一堆依赖,还得懂命令行?其实真没必要。如果你的目标很简单,就是想在Windows 电脑上,本地跑一个能正常聊天、写内容、改文案、做总结的中文大模型,那我更建议你别一开始就折腾太多方案,直接走一条更稳的路:Ollama + Qwen2.5:3b。Ollama 官方已经提供 Windows 原生安装包,安装后会在后台运行,同时终端命令也能直接用;而 Qwen2.5:3b 也已经在 Ollama 的官方模型库里,可以直接下载和运行。在 Windows 上,怎么安装 Ollama、怎么把模型部署起来、怎么使用、怎么删除模型、怎么卸载干净。

一、为什么我只推荐这一套

原因很简单:第一次本地部署,最重要的不是“最强”,而是“先跑起来”。Ollama 的优点在于,它把“下载模型、启动模型、管理模型”这几件事都做得比较统一。你不用自己去拼推理框架,也不用自己去找一堆第三方脚本。常用命令也很直接,比如运行模型用 ollama run,查看本地模型用 ollama ls,查看运行中的模型用 ollama ps,删除模型用 ollama rm,停止模型用 ollama stop。至于模型,我不建议第一次就上特别大的参数。Qwen2.5:3b 在 Ollama 官方模型页里的体积大约是2.5GB,参数量约4.02B,支持100 多种语言和方言,拿来做日常中文问答、文案润色、内容整理,已经够用了。对第一次本地部署的人来说,它比一上来就冲更大的模型更友好。

二、先说清楚:Ollama 到底是什么

你可以把 Ollama 理解成一个本地大模型管理工具。它本身不是“大模型”,而是一个让你在本机上更方便地下载、启动、调用和管理模型的工具。装好之后,它会在 Windows 上以原生应用的方式运行,后台启动服务,命令行里也能直接调用;如果你以后有开发需求,它默认还会在本机提供 API 服务,地址是http://localhost:11434。所以这套方案的关系其实很简单:

三、开始之前,先看你的电脑够不够用

按照 Ollama 官方 Windows 文档,Windows 版建议系统为Windows 10 22H2 或更新版本;如果你是 NVIDIA 显卡,驱动需要452.39 或以上;如果你是 AMD Radeon,也需要装对应驱动。官方还提到,Ollama 本体安装至少需要约 4GB 空间,而模型文件还会继续占空间,少则几 GB,多的时候可能是几十 GB 甚至更多。这句话可以说得更直白一点:大多数近几年的 Windows 电脑都能装,但流不流畅,主要看内存、CPU 和显卡。如果你只是先体验一下,本地跑个 4B 模型,一般问题不大。但如果你的系统盘本来空间就不多,那你最好在安装前就想清楚:**模型文件到底放哪儿。Ollama 官方支持通过环境变量OLLAMA_MODELS修改模型存放位置,这一点后面我会讲。

四、第一步:在 Windows 上安装 Ollama

这一部分,很多文章都会一笔带过,但其实它恰恰是新手最需要的。Ollama 官方提供 Windows 下载页, 网址是:https://ollama.com/download,Windows 端最简单的安装方式,就是直接使用官方安装程序 OllamaSetup.exe。官方文档也明确说了,这是在 Windows 上最容易的安装方式。下载完成后,双击OllamaSetup.exe,按安装向导一步步完成即可。官方文档提到,Windows 版 Ollama默认安装在你的用户目录下,不要求管理员权限;如果想安装在别的目录下, 请按照提示进行修改就行了。另外,安装的过程 务必勾选 Add to PATH。

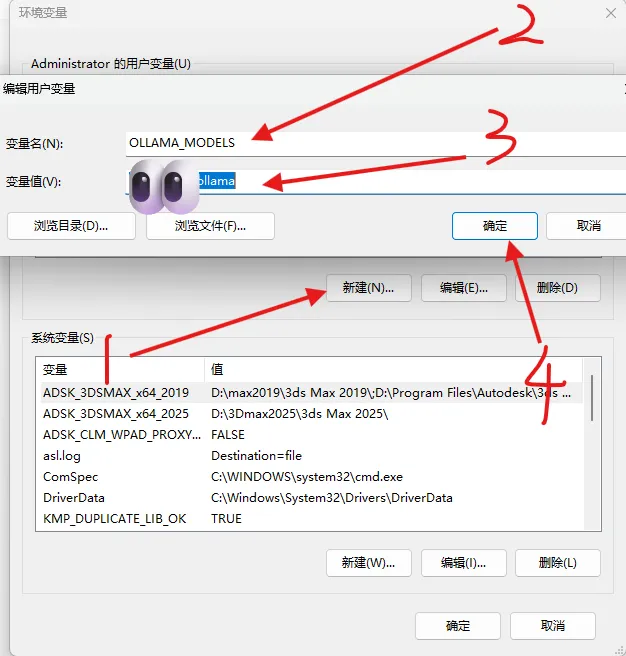

五、第二步:先把模型存储位置想好

很多人第一次本地部署,不是败在“不会装”,而是败在“C 盘突然不够用了”。因为程序本身占用不算夸张,但模型文件会越来越多。Ollama 官方在 Windows 文档和 FAQ 里都写得很清楚:如果你不想让下载下来的模型放在默认目录,可以通过设置环境变量 OLLAMA_MODELS,把模型目录改到别的盘。Windows 上的设置方法是:先退出 Ollama,然后在系统里搜索环境变量,打开“编辑你的账户的环境变量”,新建或修改 OLLAMA_MODELS,保存后重新启动 Ollama。举个最实用的例子,你可以把模型目录改成:操作顺序可以这样理解:先退出右下角托盘里的 Ollama,打开 Windows 的环境变量设置:新建变量名 OLLAMA_MODELS,变量值填 D:\OllamaModels,点保存。重新启动 Ollama,再去下载模型,这样做的好处非常直接:以后你下载的不管是 Qwen、Gemma 还是别的模型,都会优先放到 D 盘,而不是把系统盘越挤越满。这个做法是官方支持的。

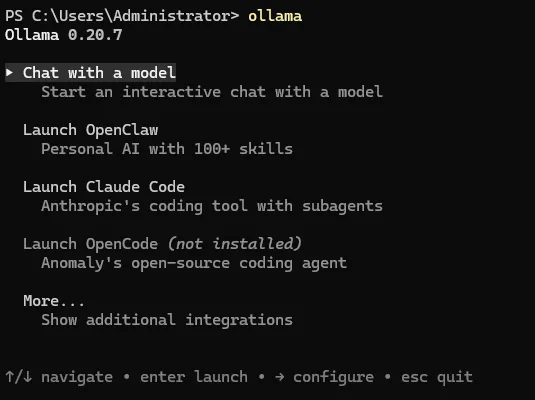

六、第三步:验证 Ollama 是否安装成功

安装好之后,不要急着下模型,先确认程序是不是已经能正常工作。根据 Ollama 官方 Quickstart 文档,运行 ollama 会打开交互菜单,你可以通过方向键选择功能、选择模型,按回车启动。对新手来说,这是判断“有没有装成功”的最直观方式。如果这个命令能正常打开菜单,基本说明安装没问题。如果你更喜欢直接一步到位,那也可以直接运行模型。成功的界面:

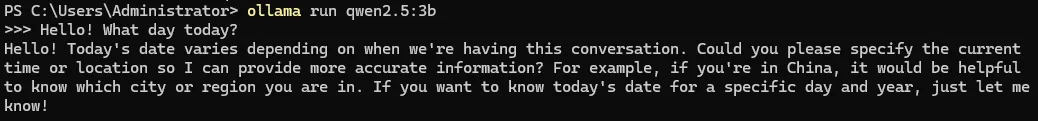

七、第四步:正式部署模型

接下来就是最关键的一步了:把模型拉下来,并且跑起来。这是 Ollama 官方模型页给出的直接运行方式。第一次执行时,它会自动下载 qwen2.5:3b 这个模型;下载完成后,就会直接进入对话界面。Qwen2.5:3b 在 Ollama 官方模型页显示大小约为2.5GB,因此第一次下载会花一点时间,这个主要取决于你的网络情况。

八、第五步:装好之后,平时怎么用

很多人以为部署完之后会很复杂,其实日常使用真的没那么难。1. 再次启动模型,以后每次想用它,打开 PowerShell 输入ollama run 是官方 CLI 的标准启动方式。这个命令会列出本地已有模型,适合你下载了多个模型之后查看。这个命令能看到当前哪些模型正在运行。官方 API 文档和 CLI 体系都提供了这个能力,用来确认模型是否已经加载进内存很方便。不用的时候把它停掉,可以省一些本机资源。stop 也是官方 CLI 提供的管理命令之一。

九、如果你想从命令行之外去调用它

Ollama 在 Windows 安装完成后,会在本机提供一个本地 API 服务,默认地址是:http://localhost:11434。官方 Windows 文档和 Quickstart 文档都提到了这一点,也给了 API 调用示例。也就是说,你以后如果想把本地模型接到你自己的小工具、脚本或者应用里,不一定非要手动开命令行聊天。但如果你目前只是想写文章、做总结、润色文案,那先别管 API,命令行够用了。

十、怎么删除模型

这一部分一定要讲,因为很多教程只教你装,不教你删。如果你只是不想要某个模型了,不代表要把整个 Ollama 都卸掉。比如你先装了 qwen2.5:3b,后来想清理掉,那么最直接的方法就是:这两个动作都属于 Ollama 官方 CLI 的标准用法:ls 用于查看本地模型,rm 用于删除本地模型。ollama stop qwen2.5:3bollama rm qwen2.5:3b

十一、怎么彻底卸载 Ollama

如果你不是只想删模型,而是想把Ollama 整个从 Windows 里卸载掉,官方文档给的方式也很明确:进入 Windows 的“Add or remove programs(添加或删除程序)”,找到 Ollama,然后卸载。Ollama 的 Windows 安装器会在系统里注册卸载程序,所以走系统自带的卸载入口就可以。如果你改过 OLLAMA_MODELS 的位置,安装器不会自动删除你自己下载的模型。这意味着,你把程序卸载了,不代表模型文件已经一起删干净。官方文档对这一点写得很直接。

十二、想删干净,记得检查这几个目录

按照 Ollama 官方 Windows 文档,Windows 上常见的相关目录主要有这几个:- %LOCALAPPDATA%\Ollama :日志和下载更新文件

- %LOCALAPPDATA%\Programs\Ollama :程序二进制文件

- %HOMEPATH%\.ollama :模型和配置

- 如果你设置过 OLLAMA_MODELS,模型文件就在你自定义的目录里

- 最后手动检查 %HOMEPATH%\.ollama 和你自定义的模型目录

十三、这套方案适合什么人

想在 Windows 电脑上先把本地大模型跑起来的人Ollama 官方 FAQ 里也明确提到,本地运行时,提示词和数据是在本机处理的。这也是很多人愿意尝试本地部署的重要原因之一。当然,如果你后面要做更复杂的知识库、网页界面、多模型切换,那是下一阶段的事。但第一步,真的没必要一下子把事情搞得太大。

十四、最后说一句实话

很多人卡在“本地部署大模型”这件事上,不是因为它太难,而是因为刚开始就想走最全、最复杂、最像高手的路线。其实没必要。如果你只是想在 Windows 上拥有一个能自己跑、能正常用、也知道怎么删的大模型环境,那么最朴素的一条路,往往就是最靠谱的一条路:先安装 Ollama,再运行qwen2.5:3b。这套方案不一定是最花哨的,但它足够清楚、足够实用、也足够适合第一次上手的人。Ollama 在 Windows 上有官方安装、官方命令、官方卸载路径,Qwen2.5:3b 也有现成的官方模型页和标准运行方式。对大多数人来说,这就够了。

文末可附:常用命令速查

ollama # 打开 Ollama 交互菜单ollama run <model> # 运行指定模型并进入对话ollama launch # 交互式启动外部集成ollama launch <integration> # 启动指定集成工具ollama launch <integration> --model <model> # 用指定模型启动集成ollama launch <integration> --config # 仅配置集成,不立即启动ollama pull <model> # 下载模型到本地ollama rm <model> # 删除本地模型ollama ls # 查看本地已有模型ollama signin # 登录 Ollama 账号ollama signout # 退出 Ollama 账号ollama create -f <Modelfile> # 通过 Modelfile 创建自定义模型ollama ps # 查看当前运行中的模型ollama stop <model> # 停止正在运行的模型ollama serve # 启动 Ollama 服务

以上命令都来自 Ollama 官方文档和官方模型页。

夜雨聆风

夜雨聆风