当AI助手“坑”了安检员?

——揭秘自动化系统

如何增加风险

当你拖着行李箱通过机场安检时,你是否注意过屏幕后那双紧盯着X光机屏幕的眼睛?在那一瞬间,他们不仅要识别出形状各异的物品,还要判断屏幕上突然跳出的“警报框”是真是假。

在工程心理学领域,这被称为“人机协同”的经典难题。今天,我们要解读的这篇2025年发表在《Ergonomics》上的最新研究,揭示了一个问题:旨在提高效率的AI辅助系统,如果设计不当,反而可能让安检员漏掉真正的危险品。

研究背景

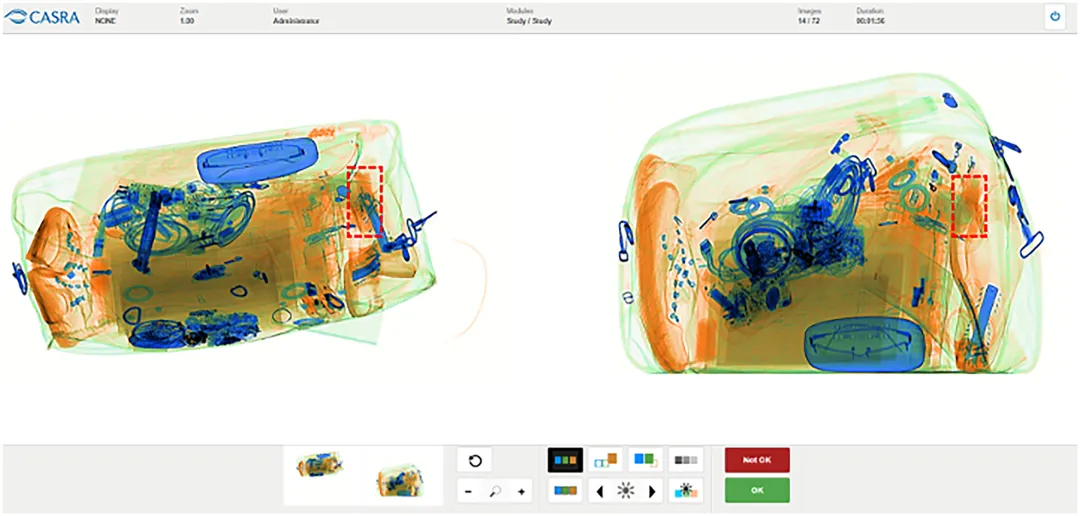

在现代机场,安检员通常不是单打独斗,他们身边有一个“电子眼”——爆炸物探测系统 (EDSCB)。这个系统会自动扫描行李的X光图像,如果发现可疑的爆炸物,就会在屏幕上画一个红框。

理论上,这应该让安检更轻松。但在现实中,机器并不完美。

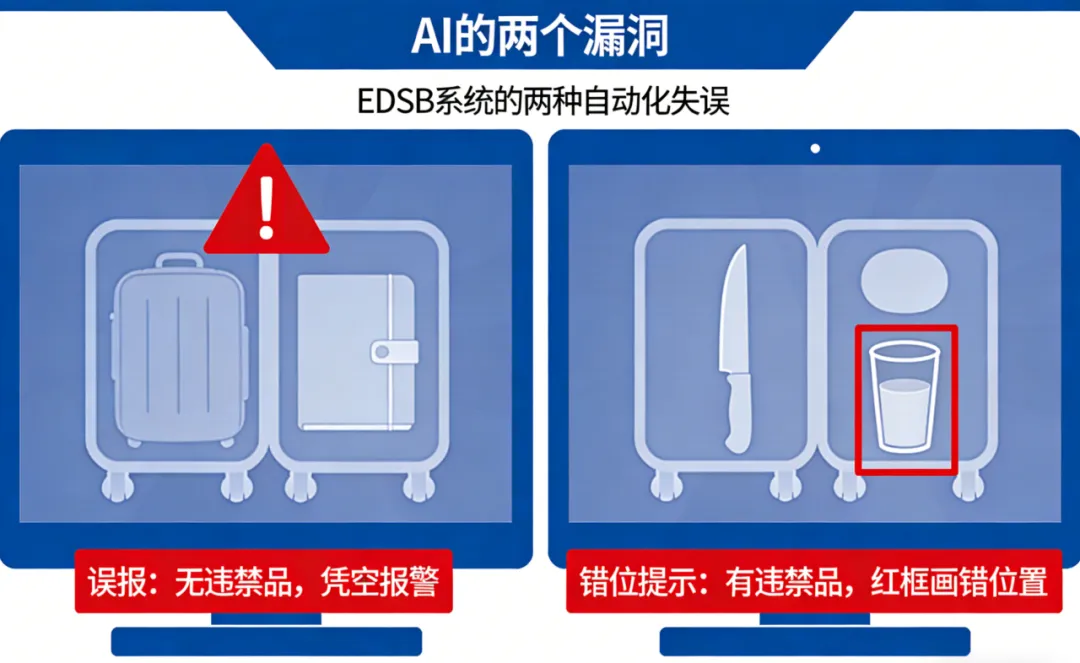

这篇名为《决策支持系统的误报和错误提示对人机系统性能的影响:一项针对机场安检员的研究》的论文,关注了机器犯错的两种形式:

误报 (False Alarms):在无目标物时触发警报。

错位提示/误导 (Miscues): 这是本文的核心重点。图片里确实有违禁品,但不是炸弹,而是一把枪或一把刀。机器却错误地把红框画在了别的地方。

对于工程心理学学生来说,这是一个典型的信号检测论应用场景。我们需要思考:当辅助系统的可靠性下降时,人类操作员是如何调整他们的感知和决策策略的?

实验设计

为了搞清楚这个问题,研究者找来了112名真正的职业机场安检员(剔除异常数据后最终99人)。

实验逻辑

研究者使用了高度仿真的X光图像模拟器,将安检员分成了三组,除了正常触发爆炸物报警之外,每组面对的AI系统“犯错风格”不同:

·误报组:AI在没有违禁品的图片上触发报警(误报)。

·错位提示组:图像中确实存在威胁目标(如刀具或枪支,但不是爆炸物),AI总是把框画在其他无关位置,比如图片里有刀,AI却框了别的地方。

·混合故障组:会出现前两组的两种错误,AI既会产生误报,也会产生错位提示。

任务:安检员被要求在15秒内判断图像中是否有违禁品(爆炸物、枪、刀)。

结果与讨论

实验结论

核心发现:错位提示的“隐形杀手”效应

实验结果打破了 “机器出错,人就会变笨” 的简单认知,得出的结论解释了为什么红框会 “骗” 过人的眼睛:

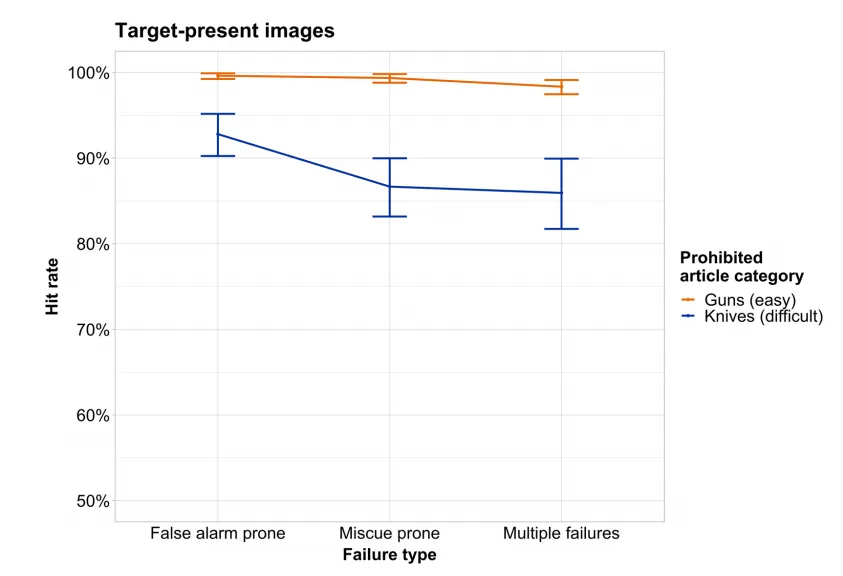

结论一:错位提示会显著降低检出率

在面对刀具这种较难发现的目标时,错位提示组的安检员漏检率明显高于其他组。

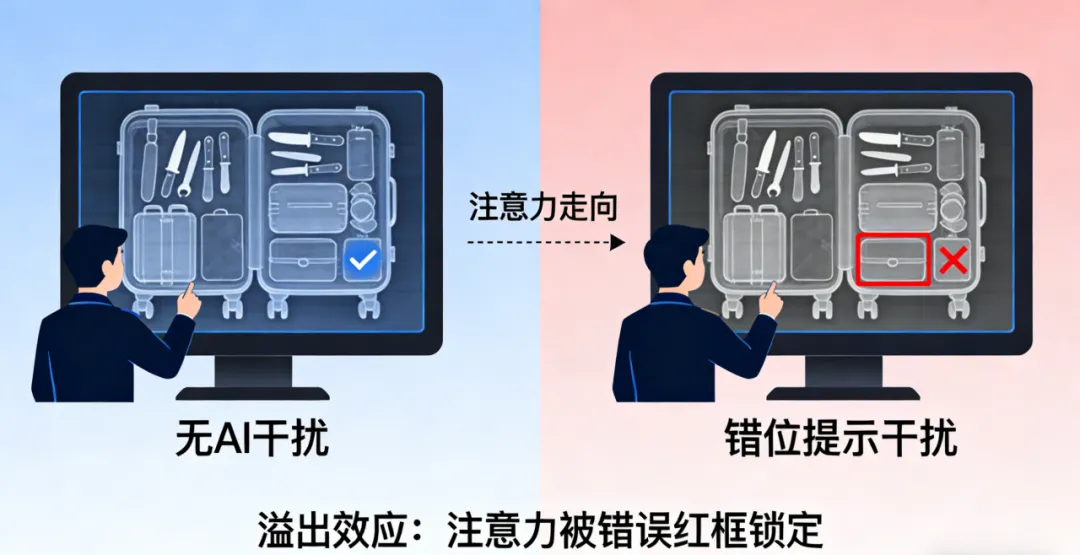

这种现象被称为“溢出效应”。AI 的红框本来是针对爆炸物的提示,但当它错误地出现在含有刀具的图像上时,安检员的注意力被牢牢锁定在错误位置,导致他们对图像中真实存在的刀具视而不见。

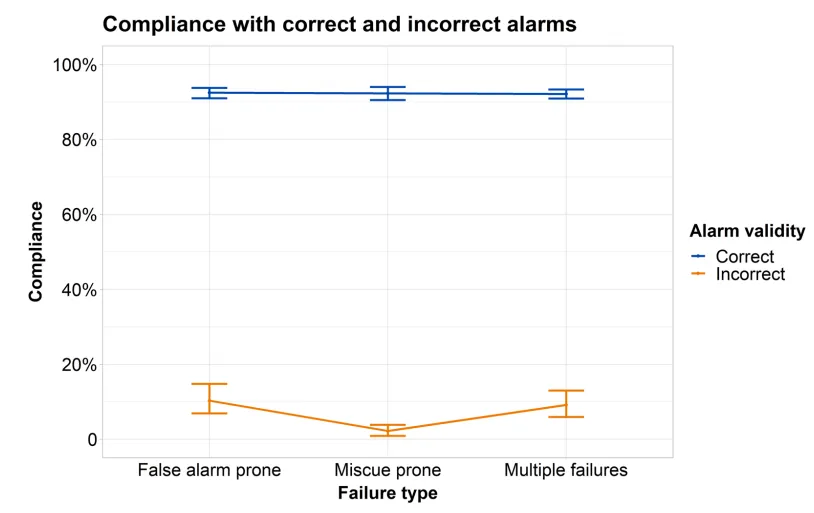

结论二:人类拥有惊人的“纠错能力”

研究发现,安检员对系统的主观信任度并没有因为错位提示而大幅下降。但在行为上,他们表现出了适应性。

安检员更愿意听从AI对炸弹的正确提示,而对于那些明显是“画错地方”的提示,他们的配合度较低。这说明人类操作员在潜意识里进行着信任校准。

结论三:“简单”的目标不受影响

研究中,枪支的检出率在各组之间没有显著差异。

为什么? 因为枪支体积大、形状规则,属于“显性目标”。即使被AI误导了一下,安检员也能很快在后续搜索中发现它。这印证了目标难度在视觉搜索中的调节作用。

讨论与启示

我们需要 AI 的帮助,但绝不能让 AI 的错误干扰人类的判断。

从工程心理学角度看,AI 红框的 “致命问题” 在于过度的显著性:红框太显眼,直接剥夺了安检员的自主搜索权,让人脑陷入 “满足搜索” 的认知陷阱。

一旦看到红框,潜意识就会觉得 “任务完成了”,从而停止对其他危险品的排查。

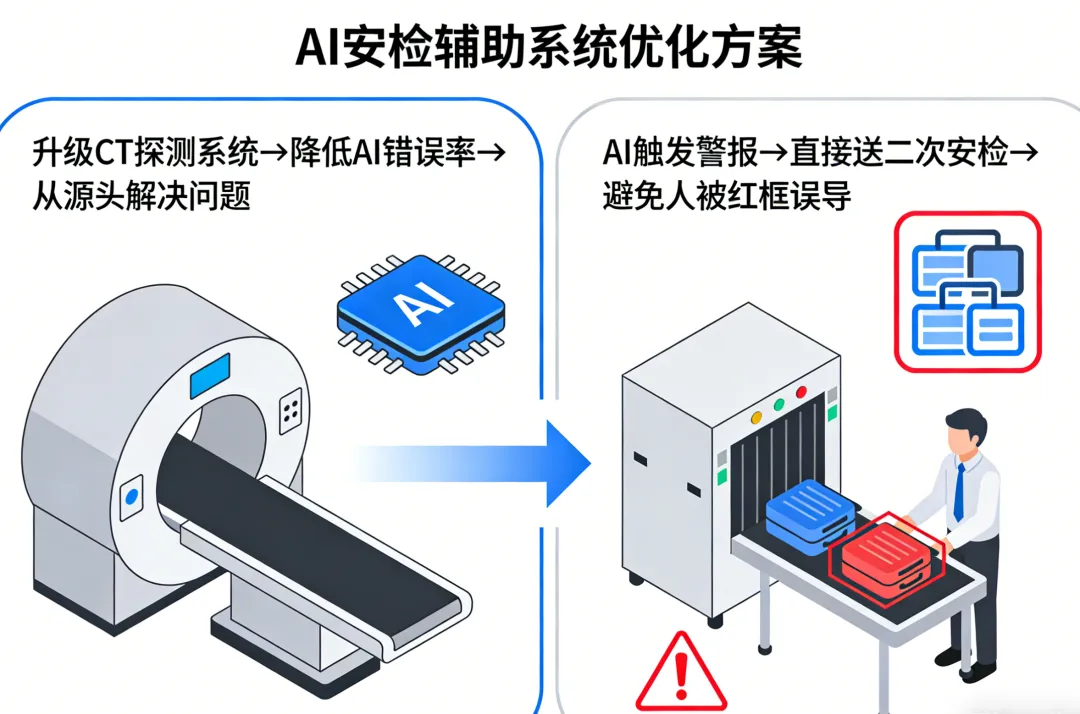

针对这个问题,研究者给出了两个切实可行的解决方案:

方案一

技术方面:升级 AI,从根源减少错位提示:

研发更精准的探测系统,比如采用 CT 技术的EDSCB,把 AI 的错位提示率和误报率降到 5% 以下,从源头解决机器错误的问题。

方案二

流程方面:改变安检流程,不让人判断 AI 的错误:

既然人容易被红框误导,那就取消安检员在屏幕上 “确认 / 忽略”AI 报警的步骤:只要 AI 跳出红框,直接将行李送往二次人工开箱检查,让机器的提示只作为“预警”,而非 “判断依据”。

这两个方案,本质上都是让机器做机器擅长的事,让人做人擅长的事,找到人机协同的最佳平衡点。

结语

安检屏幕背后,是一场高强度的认知硬仗而这篇研究的意义,也远不止于机场安检:从医疗诊断的 AI 辅助影像分析,到自动驾驶的路况提示,再到各行各业的智能决策系统,“如何避免机器的错误干扰人类”,都是人机交互领域永恒的课题。

我们追求更智能的机器,但永远不要忘记:

人机协同的核心:

是让机器服务于人,而非取代人。

参考文献

Huegli, D., Chavaillaz, A., Sauer, J., & Schwaninger, A. (2025). Effects of false alarms and miscues of decision support systems on human–machine system performance: a study with airport security screeners. Ergonomics, 68(12), 2088–2103.

ZJUpsy@楼震霆供稿

夜雨聆风

夜雨聆风