AI 辅助科研,先别急着找工具

我这一年怎么用 AI 做社科科研

从会用工具到搭起系统

这篇是给朋友的经验分享,也是我过去一年边做边踩坑后留下的一套可复用方法。工具我不会铺满,只聊真正改变我工作方式的那几件事。

目录

-

• 总纲:AI 协作的四个层次 -

• 一、底层认知:从提示词到上下文工程 -

• 二、文献检索:工具组合拳 -

• 三、文献阅读与管理 -

• 四、写作系统:卡片化写作 -

• 五、Skill 思维:把重复流程固化 -

• 六、工具分工原则 -

• 七、工程思维:用项目文件夹管理研究 -

• 入门建议

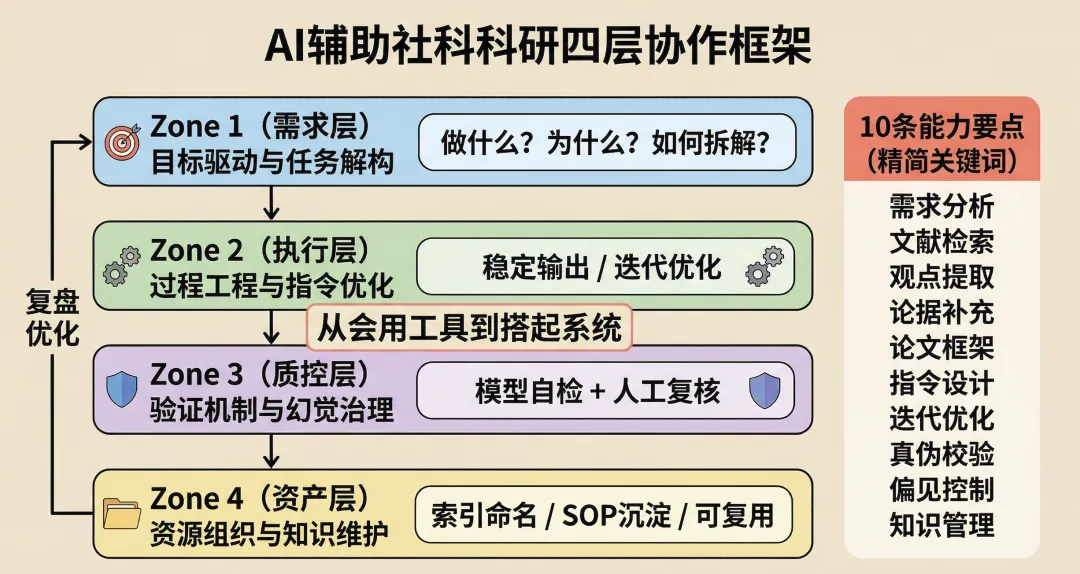

总纲:AI 协作的四个层次

用 AI 辅助科研,最重要的能力不是”会用工具”,而是能用自然语言把自己的需求结构化、清晰表达出来。

具体来说,就是这 10 条:

1. 明确真实需求,知道”我要什么”,而不只是”我想做什么”

2. 项目化拆解,把一个大目标拆成可执行的子任务

3. 人机分工判断,清楚哪些必须人工完成、哪些适合交给 AI

4. 结构化指令,给 AI 明确的背景、目的、约束条件

5. 构建 SOP,把成功的交互路径沉淀为标准流程

6. 定期卸载,让 AI 输出项目日志、压缩信息、聚焦焦点

7. 验证机制,每次输出都要求模型自检,再人工复核

8. 建立索引,大量资料输入后给 AI 建立唯一映射

9. 精准命名,对所有输入资料按类别统一命名

10. 基底文件,每次任务开始前输入核心约束

这 10 条可以归纳为四个层次:

需求层 — 做什么?为什么做?怎么拆?→ 对应:上下文工程、需求锚定、工程思维

执行层 — 怎么让 AI 稳定输出?→ 对应:文献检索、文献阅读、卡片化写作

质控层 — 输出靠不靠谱?→ 对应:上下文防腐、多模型交叉评审、模型自检

资产层 — 怎么沉淀、怎么复用?→ 对应:项目文件夹、文献卡片、Chatlog 归档

记住这个框架,后面每一节的具体方法就不是零散的技巧了,而是四个层次的落地实践。

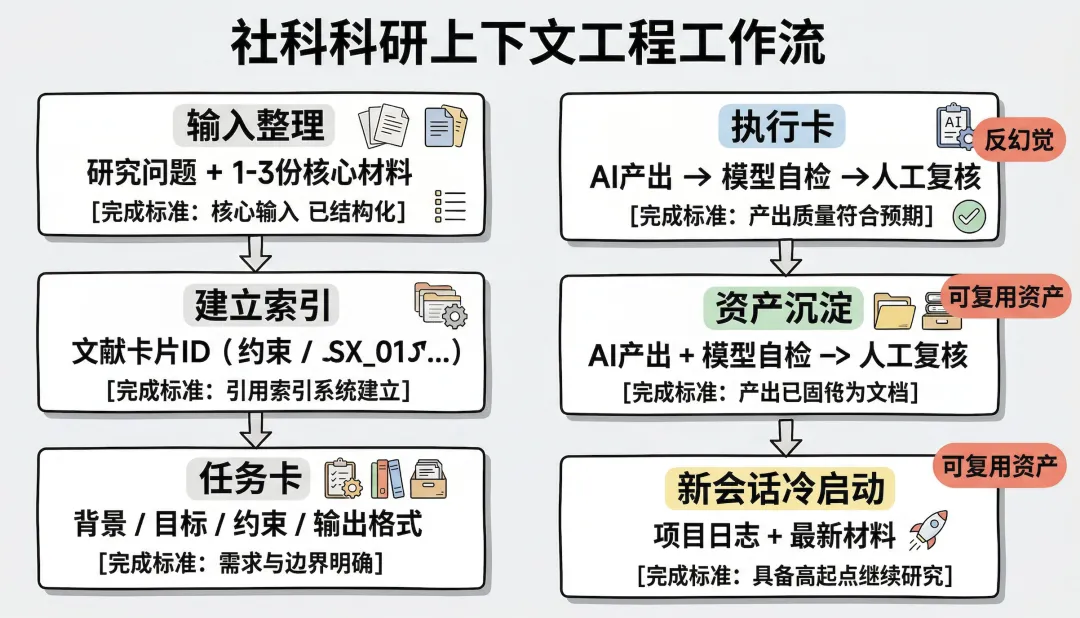

一、底层认知:从提示词到上下文工程

很多人用 AI 效果不好,不是模型不够聪明,是没管理好上下文。

1.1 Prompt Engineering 已经不够用了

大多数人对 AI 的理解:

我有件事 → 写一个 prompt → AI 帮我生成 → 不满意就改 → AI 又忘了刚说的 → 重复循环……

高手对 AI 的理解:

我设计一个系统 → 让 AI 永远看到对的东西 → 它才会稳定地做出对的事

Prompt Engineering 是一句话的技巧;上下文工程是整个工作流的设计能力。

举个写论文的例子:

-

• 普通用法:写一个 prompt 让 AI 帮写文献综述,不满意就改 -

• 上下文工程用法:把理论框架做成资料模块、把文献笔记做成记忆槽、把研究问题做成任务上下文

结果:前者写出来很空泛,改几轮还是不满意;后者基于全部材料组合输出,几乎可以直接用。

核心逻辑:模型不是你的助理,它只是按顺序”吃”上下文。你喂什么,它就看什么;你没喂,它就真的不知道。

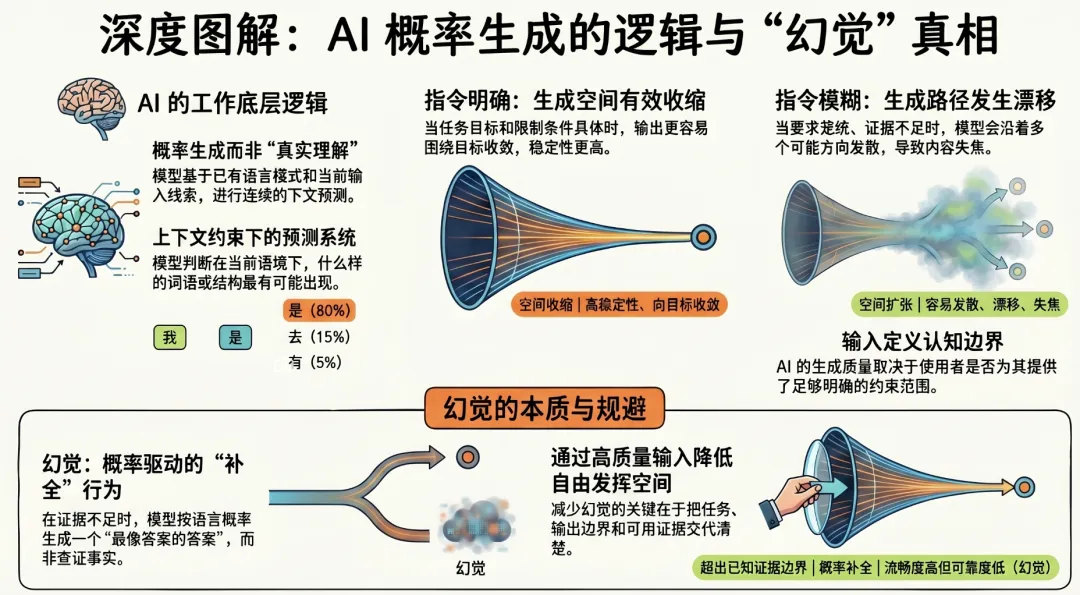

1.2 先理解 AI 的本质

AI 的本质是概率匹配,它看的是”哪几个词/概念通常在一起出现”。你输入的信息越明确,它指向的概率空间越窄,输出就越稳定。

用机器学习做个类比:你明确给的信息就是 1,没给的信息就是 0。但 AI 不会告诉你”这个位置是 0″,它会按照概率补一个看起来合理的值填上去。

这就是幻觉的本质:模型把 0 当成了 1。

所以对抗幻觉的根本方法不是”选更聪明的模型”,而是尽量减少 0 的数量——把该说清楚的背景、约束、资料都说清楚,让模型少猜。

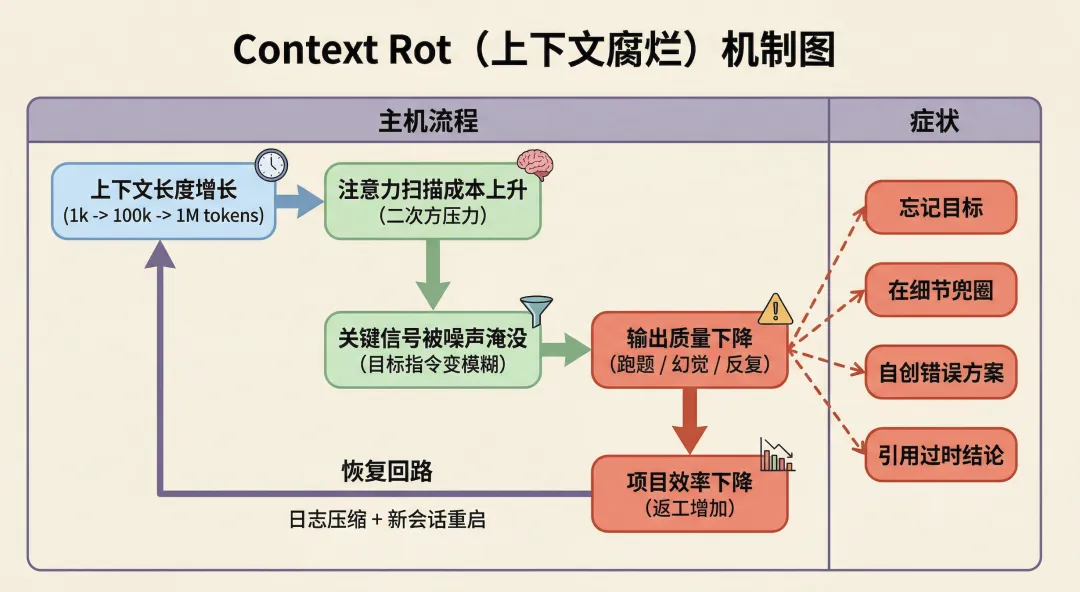

1.3 Context Rot(上下文腐烂)

AI 的注意力会随对话变长而涣散。你开头给的指令、上传的资料,到第 30 轮对话时模型已经”看不太清”了。为什么会这样?

大模型使用 Transformer + 注意力机制。每生成一个新词,模型都要”回头”扫描整个上下文的所有 token。上下文从 1 千增加到 100 万,计算成本是二次方级增长的。

打个比方:人脑会主动屏蔽 99.99% 无关记忆,只关注当前相关的信息。但 AI 像是在一个堆满东西的桌面上,每次都要被迫全部扫描一遍。信息越多,干扰越多,”注意力预算”被摊得越薄。

这不是小问题。

-

• 顶级模型在短任务上几乎 100% 完成;任务拉到 4 小时以上,成功率直接掉到 10% -

• 简单的常识推理题,短提示词下正确率 90%+;塞进几万 token 的长文里,可能掉到 20%-30%

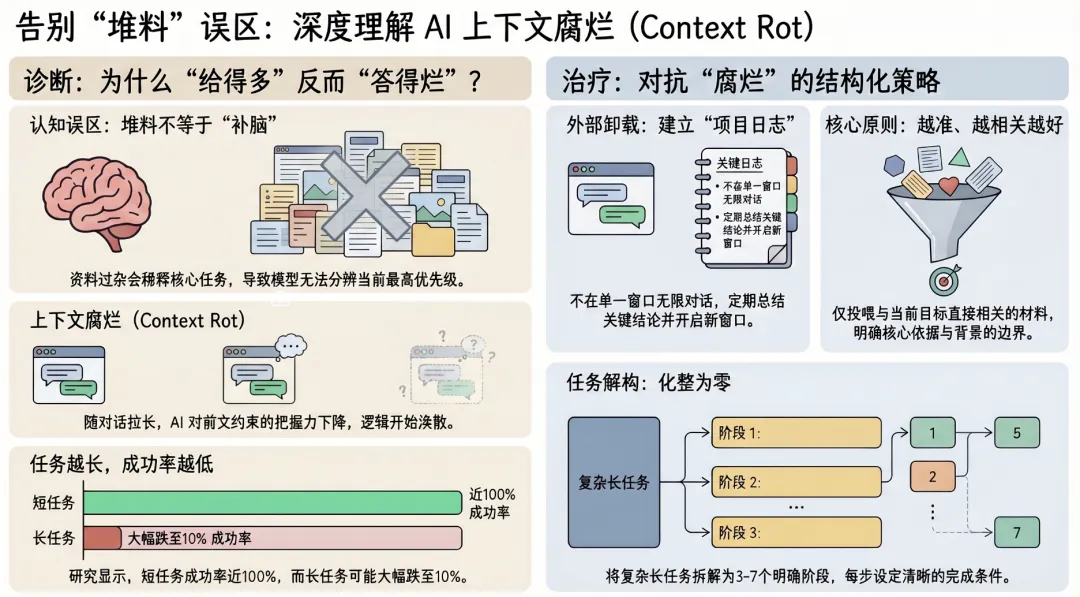

大白话:你以为是在给 AI “补脑”,其实是在给它”添堵”。

日常体验里最常见的表现:忘记目标 → 在不重要细节上兜圈子 → 面对已有答案时自创一套 → 引用已被推翻的方案。

1.4 上下文防腐的六个技巧

对抗 context rot 不是靠”选更大的上下文窗口”,关键是管理你喂给 AI 的信息结构。

技巧 1:不要把”整个世界”一次性喂给 AI

一次对话控制在:一个明确主题 + 1-3 份核心材料。多余资料先让 AI 分批总结成”知识小卡片”,按需调用。

技巧 2:用项目日志代替无限拉长的对话

长项目不要在一个对话框里拖走。定期让 AI 输出关键决策和结论,第二天开新对话时只贴入日志 + 最新材料。上下文短且结构化 → 腐烂少 → 进度清晰。

技巧 3:长文先”建索引”,再让 AI 读

不要直接塞全文。先让 AI 为长文做一个章节索引 + 关键词索引;问问题前先问”这类问题应该看哪一节”;只把相关章节塞进新对话再追问细节。

技巧 4:把任务拆成可度量的阶段

任何超过 2 小时的人类工作,拆成 3-7 个阶段,每个阶段都有明确的完成条件(如字数、结构、必须回答的 3 个问题)。

技巧 5:定期”刷新记忆”,让 AI 做总结

感觉对话变散、跑题时,执行”自救”:

“请帮我用 10 条 bullet,总结本次对话到目前为止所有关键结论和前提假设。以后在回答时,如果发现跟这些假设冲突,请主动提醒我。”

把此总结复制到新对话,作为”冷启动上下文”,相当于记忆压缩 + 垃圾清理。

技巧 6:把上下文工程当成核心技能

真正的壁垒不是写 prompt,而是如何设计信息结构 + 任务结构:

-

• 超过 1 页的需求 → 写”任务卡”(背景、目标、约束、输出格式) -

• 大块资料 → 建立索引(3 句摘要、5 个关键词、能解决的 3 类问题)

资料索引 Prompt(可直接复制):

请阅读以下文献/资料,为每篇生成一个结构化索引卡片。## 输出格式### [文献编号] 标题- 三句摘要:研究了什么 → 用了什么方法/理论 → 得出了什么结论- 五个关键词:提取 5 个学术关键词- 能回答的三类问题:列出这篇文献可以回答的 3 类研究问题- 与我的研究关系:对"你的研究主题"有什么直接价值- 优先级建议:精读 / 泛读 / 暂不需要注意:如果判断某篇文献与研究完全无关,如实标注"暂不需要"并说明理由1.5 结构化 Prompt

既然 AI 是概率匹配,输入越明确输出越稳定,那指令怎么写才够明确?

四个要素缺一不可:

-

• 任务背景:”我正在写一篇关于教师流动的制度分析论文” -

• 任务目的:”帮我梳理近五年相关文献的理论脉络” -

• 约束条件:”只关注历史制度主义视角的文献” -

• 可用资源:”以下是我整理的 15 篇文献的结构化笔记”

同时结合负向约束,告诉 AI 不能做什么,往往比告诉它能做什么更重要:

-

• “不要使用’关键”核心”彰显”赋能’等空泛修饰词” -

• “不要编造不存在的文献引用,如果不确定就标注'[待核实]'” -

• “不要在没有数据支撑的情况下做因果推断” -

• “不要在文献综述中引入新的理论框架,只围绕已有的 X 和 Y 展开”

负向约束说到底是给你的写作立规矩,让 AI 在规矩内执行,而不是自由发挥。

1.6 项目说明文档

每次开新对话都要重新解释”我在研究什么”,既浪费时间,又每次说的还不一样。

解决办法:在项目一开始就写一份项目说明文档,后续所有 AI 交互都基于这份文档启动。

第一步:需求锚定

在动笔之前,先想清楚一个问题:你的真实目标是什么?

表面需求和真实目标经常不一样:

-

• “帮我润色这篇论文” → 真实目标可能是”达到期刊投稿的语言门槛” -

• “帮我找一些关于 X 的文献” → 真实目标可能是”确认没有人做过同样的研究” -

• “帮我写文献综述” → 真实目标可能是”梳理理论脉络,定位研究缺口”

真实目标不同,AI 的执行方向完全不同。先把真实目标想清楚,再写进文档。

项目说明文档里写什么?

-

• 我是谁:学科背景、研究方向、当前阶段(开题/写初稿/修改/投稿) -

• 研究目标:这篇论文要回答什么问题,边界在哪 -

• 核心思路:原始 idea 是什么,后续怎么演变的 -

• 理论框架:用了什么理论,为什么选这个而不是那个 -

• 偏好与约束:写作风格偏好、目标期刊要求、不能跑偏的方向 -

• 项目进展:做到哪一步了,已经确定什么,还卡在哪里 -

• 待解决问题:当前遇到的具体困难

它在整个流程中的角色

这份文档不是一个”写完就放着”的东西,它是贯穿整个研究流程的共享上下文:

-

• 组态文献定位:让 AI 理解你的研究全貌,才能准确拆解概念 -

• IMA 文献筛选:作为筛选标准,判断几十篇文献里哪些值得精读 -

• 多模型交叉评审:每个模型窗口拿到同一份文档,方案才有可比性 -

• 卡片化写作:作为第一层卡片,所有讨论蒸馏卡都挂在它下面 -

• 换工具/换窗口:任何新工具拿到就能直接干活

它说到底是一个可传递的项目上下文,不仅你能用,将来交给合作者,拿到就能继续推进。

1.7 Chatlog 对话归档

AI 对话窗口里的内容是临时的,窗口关了就没了。但很多讨论过程中产生的思路、结论、推翻的方案,都是有价值的研究资产。

操作方式:

-

1. 每个研究项目建一个专属文件夹 -

2. 每次有价值讨论后,把对话导出为文档 -

3. 用下面的 prompt 压缩成高价值摘要

对话转摘要 Prompt(可直接复制):

请阅读以下 AI 对话记录,提取其中对研究有实际价值的结论:## 本次对话基本信息- 日期:- 主题:- 使用的工具:## 核心结论(本次对话确定下来的东西)## 推翻或修正的内容(之前以为对的,这次发现不对的)## 新产生的问题或待验证的假设## 对项目说明文档的更新建议## 值得保留的具体方案或表述(可直接用于论文写作的)注意:1. 只提取有研究价值的内容,过滤寒暄和重复讨论2. 推翻的内容一定要记录——避免下次又走回老路3. 论文段落输出的有价值版本需保留原文小习惯:对话摘要按日期命名,定期回顾,把成熟结论合并到项目说明文档。归档文件夹是”原材料库”,项目说明文档是”成品”。

1.8 结构化文献卡片笔记

这是整个 AI 辅助科研流程中最核心的资产。

给每篇文献分配一个唯一映射 ID(如 WX_01、WX_02),在后续写作、讨论、笔记中统一用 ID 引用。这个 ID 同时也是上传到 IMA 时的文件命名。

每张卡片包含:

-

• 研究问题:这篇文献要解决什么 -

• 方法论:用了什么方法/理论框架 -

• 核心发现:主要结论 -

• 局限性:作者自己承认的不足 -

• 与核心文献的关联:跟你的研究是什么关系 -

• 项目价值:对你的论文具体有什么用 -

• 写作应用:哪些观点/表述可以直接引用 -

• 优先级:精读 / 泛读 / 跟踪

为什么它是核心资产?

-

• 它是所有后续环节的基础,写综述、找论证、检查引用都要回到这些卡片 -

• AI 读结构化文本的准确率远高于读整篇论文 PDF -

• 它是可累积的,这个项目的卡片,下一个项目可能还能用 -

• 它是可校验的,方便回头核查”这个观点到底来自哪篇文献”

建议:不要等”读完所有文献”再整理。每读一篇就整理一张,先用 AI 辅助提取初稿,再人工校对补充。

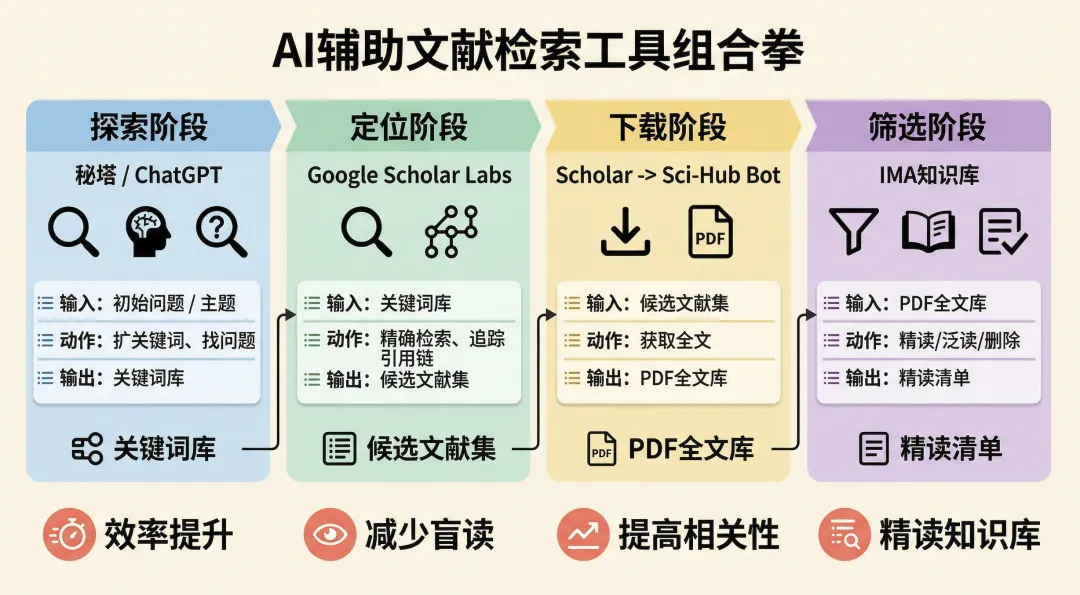

二、文献检索:工具组合拳

找文献是科研的起点,也是 AI 最能直接帮上忙的环节。

2.1 组态思维文献定位

专门解决”研究题目太具体、太小众,找不到直接匹配文献”的问题。(方法源于孙宇凡老师)讲座回放丨如何快速写好文献综述?AI写作三步法

核心思路:从”找替身”升级为”找零件”。

举个例子:假设你要研究”双减政策下教师的职业压力与应对机制”。

直接搜双减加教师职业压力,结果会有很多,但同质化很严重,基本都是现状调查加对策建议,理论对话对象很薄。用组态思维拆解:

第一步:概念化拆解——这个研究涉及哪些要素?

-

行动者,一线教师、学校管理者、教育行政部门、家长 -

情境,课后服务拉长工时,评价体系调整滞后,非教学任务持续转嫁 -

核心现象,工作负荷结构性变化、情绪耗竭上升、离职意向出现 -

核心关切,政策如何在执行层面对教师形成制度性挤压

第二步:提炼抽象维度

-

双减政策,抽象为自上而下的制度变迁、教育治理重构 -

职业压力,抽象为专业自主权受侵蚀、情绪劳动超载 -

工时延长与职责扩张,抽象为制度性角色膨胀 -

评价体系滞后,抽象为制度不匹配与多重制度逻辑冲突

第三步:构建条件矩阵——每个维度设为条件,不同组合对应不同的理论对话对象

-

角色膨胀 + 专业自主权,对接去专业化文献 -

制度逻辑冲突 + 情绪劳动,对接制度不兼容与情绪耗竭文献 -

自上而下变迁 + 基层应对,对接街头官僚与再制度化文献

第四步:生成检索策略——每个条件组合对应中英文关键词 + 代表文献

我把这个做成了个skill放在 GitHub:https://github.com/Ricky-zhang1/configurational-literature-mapping.git

2.2 组态定位 → AI 推荐文献 → 生成检索式

组态定位帮你拆解出了维度和条件组合,下一步不是直接去搜,而是让 AI 推荐权威文献,并生成可直接用的检索式。

具体操作:

-

1. 把组态定位的拆解结果发给 ChatGPT -

2. 让它做两件事:推荐核心文献 + 生成知网和 Google Scholar 的检索式 -

3. 拿到推荐后,回 Google Scholar 核实引用量和真实性 -

4. 拿到检索式后,直接复制到数据库执行检索,批量下载

Prompt 示例:

基于以下研究拆解结果,请完成两个任务:【研究拆解结果】- 条件组合1:Drift + 教育分权- 条件组合2:Layering + 职业治理- 条件组合3:Conversion + 标准政治化【任务1】针对每个条件组合,推荐 3-5 篇该领域最权威的核心文献,标注推荐理由。【任务2】分别生成适合知网和 Google Scholar 的检索式。2.3 文献检索工具箱

中文搜索:秘塔搜索(metaso.cn)— 中文学术问题探索、概念解释

英文搜索:

-

• ChatGPT 直接搜索 — 英文学术问题探索、关键词扩展 -

• ChatGPT Deep Research — 自动搜索大量网页生成带引用的综述,适合领域全景扫描 -

• Google Scholar Labs(scholar.google.com/scholar_labs)— Google Scholar 的 AI 增强版,支持自然语言提问

-

• Sci-Hub Bot(https://sci-bot.ru/)— 论文下载

浏览器插件:

-

• Google 学术搜索按钮(Chrome 应用商店搜索”Google 学术搜索按钮”)— 在任意网页上一键检索相关学术文献。比如 AI 推荐了一篇文献,框选标题就可以直接检索出文献和下载链接

实际用法组合:

-

1. 探索阶段:秘塔搜索(中文)或 ChatGPT(英文)快速了解领域 -

2. 定位阶段:Google Scholar Labs 做精确检索,引用追踪 -

3. 下载阶段:Scholar 找到 → Sci-Hub Bot 获取全文 -

4. 插件辅助:读到有趣参考文献,一键跳转 Scholar 查找

注意:AI 搜索工具找到的文献一定要回 Google Scholar 或数据库核实,它们引用的信息偶尔有误。

两个实用技巧:

-

• 辅助拓展关键词:把研究方向描述丢给 ChatGPT 或秘塔,让它帮你扩展同义词、上位概念、相关理论术语 -

• 知网批量导出 + AI 筛选:在知网按关键词检索后,批量导出文献的标题、作者、摘要为 doc 文件,丢给 AI 筛选哪些值得精读

三、文献阅读与管理

3.1 IMA 知识库 + 播客功能

IMA(腾讯出的知识库工具)可以上传文献 PDF 和网页,建立自己的文献资料库。ai 在回答问题的时候基于知识库内上传的材料进行回答,还会生成脚本定位引用的内容原文方便人工核查,降低了幻觉的风险。

基础用法:批量导入文献 → 自然语言搜索文献内容 → AI 基于知识库做文献梳理

文献筛选:

-

1. 给文献 PDF 加标准序号命名(WX_01、WX_02……) -

2. 把项目说明文档发给 IMA,让它基于你的研究问题筛选值得精读的文献 -

3. IMA 逐篇评估相关性,给出精读/泛读/可删除的建议 -

4. 删除不相关的,留下真正有用的

任务模式的播客功能(重点推荐):

这是 IMA 在科研场景里最强的功能。上传资料后,它会基于资料生成一段双人对话的播客音频,讲给你听。

两轮播客法:

-

1. 第一轮:只给研究资料,不给初稿 — 上传文献笔记、研究思路、理论框架,不上传初稿。听播客:检验研究思路是否清晰、逻辑是否连贯 -

2. 第二轮:上传初稿,再生成一次 — 听播客:直观感受初稿论述是否有力、哪里深入了、哪里还有空洞

为什么有效?听别人”讨论”你的研究,和自己反复读自己的文字,是两种完全不同的体验。很多在文字里觉得”好像没问题”的地方,用耳朵一听就会发现逻辑跳跃或论证薄弱。

质性研究特别适用:把所有访谈转录材料丢进去,基于研究问题让 IMA 生成播客,经常能发现之前忽略的关联和模式。

3.2 多窗口协同阅读

多窗口隔离原则:不同文献/不同任务用不同对话窗口,避免上下文互相污染。

-

• 窗口 A:ChatGPT 读一篇核心文献 -

• 窗口 B:Gemini 读另一篇文献 -

• 整合:把两个窗口的结果复制到一个文档,再投给 AI 做对比分析

关键原则:AI 没有学术品味,无法判断文献质量。先选好 2-3 篇核心文献让 AI 精读,其余以结构化笔记的形式喂给它。

3.3 五维批判性阅读

大多数人用 AI 读论文的方式是”帮我总结一下”,这是被动接收。更高效的方式是批判性阅读,用 AI 检验论文是否真的证明了它声称的内容。

核心转换:

-

• 传统:”帮我总结这篇论文” → 知道论文说了什么 -

• 批判性:”这篇论文到底证明了什么,依据是什么,在回避什么?” → 读懂论文

前提:必须先自己完整阅读论文,再把全文喂给 AI 提问。

五刀提问框架(按重要性排序):

第一刀:区分”主张”与”证明”

“仅从方法和结果来看,这项研究能合理推出什么结论、不能推出什么?现在读摘要,告诉我作者在哪里过度延伸了。”

第二刀:方法论的隐含假设

“这项研究没有测量什么?作者的方法论在悄悄假设什么,却从不说明?”

第三刀:结论的泛化边界

“如果我在不同背景的不同人群中重复这项研究,结果最可能在哪里变化?”

第四刀:论辩坐标定位

“这篇论文在回应什么辩论?它回应的那些人会怎么反驳?”

第五刀:参考文献的选择性回避

“这篇论文的参考文献中,缺失了哪些该领域必不可少的引用?”

注意:第五刀 AI 容易编造”缺失引用”,必须回原文核实。

这五刀的价值:不是让 AI 替你读论文,而是帮你从”外部旁观者”变成”内部论辩参与者”。

3.4 整理文献卡片

读完文献后,按 1.8 节介绍的结构化文献卡片格式整理笔记。五维批判性阅读的结论也应该记入卡片,尤其是”结论延伸度”和”方法论假设”。

四、写作系统:卡片化写作

核心原则

不要让模型直接读原始聊天记录写论文,要让模型基于卡片化材料执行写作。

原始聊天记录有三个结构性问题:

1. 信息密度不均匀——真正可用于写作的只有少数结论,剩下大量是试探和重复。如果不先压缩,模型会把”讨论过的可能性”误当成”已经确定的结论”

2. 多版本经常互相冲突——第一轮说 A、第二轮改成 B、第三轮又混起来。没有裁决机制,写出来的文本主线会散

3. 论文写作需要边界,聊天没有边界——引言、综述、方法、结果各自功能不同。模型如果拿不到边界,就会”什么都写了一点,但没有一段真正有用”

卡片分层思路

核心逻辑不是”多记笔记”,而是把不同类型的信息分层管理:

-

• 第 1 层·总纲:项目卡片 — 我到底在研究什么?边界在哪? -

• 第 2 层·讨论:讨论蒸馏卡 — 这轮讨论得出了什么结论?推翻了什么? -

• 第 3 层·裁决:决策日志 — A 方案和 B 方案,最终选哪个? -

• 第 4 层·证据:文献卡片 + 结果解释包 — 文献说了什么?数据能证明什么? -

• 第 5 层·执行:章节写作包 — 写这一章要完成什么?边界在哪? -

• 第 6 层·冲突:修改比较卡 — 原稿保留什么?A 方案吸收什么?

实际流程:在 ChatGPT/Gemini 里讨论(发散) → 有结论后填入讨论蒸馏卡(收敛) → 多方案冲突时记入决策日志 → 写作时把相关卡片打包投给 AI 执行

按阶段调用

项目刚起步:先只做项目卡片 + 讨论蒸馏卡。重点不是写正文,而是把研究问题、边界和主线压实。

讨论很多但还没写正文:每次讨论后做讨论蒸馏卡 + 决策日志,这样不会在下一轮又从头聊一遍。

开始整理文献:核心文献沉淀为文献卡片。写综述时按卡调用,写引言时快速取证。

开始写某一章:不要直接说”帮我写文献综述”。先做章节写作包——这一章的功能、边界、核心论点、材料来源。一章一包,效果比整篇一起喂稳定得多。

已有初稿,多个改法:先锁定”只改哪一段” → 用修改比较卡对原稿、方案 A、方案 B 做比较 → 决定吸收策略后再执行。不要跳过比较卡,否则模型大概率会把不同方案揉在一起。

多模型交叉评审

引言到底按 A 结构还是 B 结构?文献综述用时间线还是主题线?

-

1. 分别生成方案:新开多个对话窗口,每个都上传项目说明文档 + 文献卡片,让 AI 各自给出方案 -

2. 汇总到一个文档:把不同方案复制到同一文档,标注各方案核心逻辑 -

3. 交给新窗口评估:开新 AI 会话,让它评估哪个更好

关键 tip:告诉评估的 AI——”这些方案不是我写的,是我让不同模型分别生成的,请你客观严谨地评估各自的优劣。”避免 AI 倾向性附和。

拆解任务

不要把”帮我写一篇文献综述”这种大任务直接丢给 AI。

拆解原则:按照人类自己完成这个任务所需的步骤和时间来拆。

比如拆成:确定边界范围 → 梳理理论脉络 → 识别对话关系 → 定位研究缺口 → 确定组织结构 → 逐节撰写

每个子任务单独开一个对话,喂入对应材料,让 AI 专注做一件事。

生成大纲的方法

-

1. 先投喂目标期刊的范文,让 AI 学习该期刊的结构和风格 -

2. 上传项目说明文档和文献卡片作为素材 -

3. 让 AI 基于具体材料生成适配你主题的大纲 -

4. 多个 AI 各出一版,汇总后交叉评审

规范化命名

-

• 文献卡片:WX_01、WX_02…… -

• 论文大纲:大纲_v1、大纲_v2 -

• 数据分析结论:机制A_分析结论 -

• 修改方案:修改方案_审稿人意见1

人机分工边界

必须人工完成:确定研究问题和理论框架、判断文献质量、实地调研/访谈、核心论证的逻辑把控、伦理审查、对 AI 输出的最终审核

适合交给 AI:数据清洗/格式转换、文献摘要提取、草拟提纲/初稿润色、检查引用格式、多方案对比、基于已有材料生成变体

原则:AI 做执行,人做判断。

每次输出都要求模型自检

在 prompt 末尾加上:

输出完成后,请自检:1. 事实性:引用的数据、文献是否准确?有没有编造?2. 逻辑性:论证链条是否完整?有没有跳跃或矛盾?3. 一致性:是否遵守了上述所有约束条件?4. 标注不确定的内容为 [待核实]注意:模型自检不能替代人工复核。两者缺一不可。

反馈闭环

AI 的输出不满意,不要全盘否定重新来。更高效的做法是”反馈-修正-再输出”:

-

1. 拿到初版输出 -

2. 标注具体哪里不对(不是”写得太泛”,而是”第三段的因果推理缺乏机制描述”) -

3. 把标注后的版本 + 具体修改意见一起投回去 -

4. AI 基于精准反馈修正,比从零重新生成效果好得多

核心:反馈越具体,迭代越快。

五、Skill 思维:把重复流程固化

5.1 什么是 Skill 思维

每次用 AI 做同类任务(润色论文、检查引用格式、整理文献),都要重新写一遍指令,而且每次写的还不太一样,效果也不稳定。

Skill 思维:把你反复要做的事情写成标准化模板,让 AI 每次都按同一套流程执行。

5.2 怎么开始做

-

1. 识别重复任务:哪个动作做得最多? -

2. 写一次完整指令:背景、要求、约束、输出格式写清楚 -

3. 存成文档:下次直接复制使用,根据情况微调 -

4. 逐步迭代:用了几次后发现哪里不够就改哪里

5.3 一个好模板长什么样

-

• 角色设定:AI 在这个任务里扮演什么角色 -

• 任务描述:具体要做什么 -

• 输入要求:需要用户提供什么材料 -

• 输出格式:结果按什么结构呈现 -

• 质量标准:什么样的结果是合格的 -

• 约束条件:哪些事情不能做 -

• 自检步骤:AI 在输出前应该自己检查什么

5.4 Skill 思维 vs 普通 Prompt

-

• 普通 Prompt:每次重新写,靠记忆容易忘,质量取决于每次发挥 -

• Skill 思维:写一次反复用,存成文档不会漏,稳定可预期,持续优化

六、工具分工原则

各工具定位

-

• ChatGPT 网页版:讨论构思、Deep Research、发散性思考。产出候选方案 -

• Gemini:快速问答、多视角对比、文献提取。交叉评审的第二意见 -

• IMA:知识库管理、文献筛选、内容搜索、播客生成。文献理解、证据层材料供应 -

• DeepSeek:中文长文本处理、代码辅助。备用中文写作工具

写作流程一句话

网页端讨论用来定方向,文献卡片和 IMA 用来供证据,修改比较卡用来裁冲突,ChatGPT/Gemini 用来执行成文。

具体步骤:

-

1. 先定项目,填项目卡片 -

2. 再沉淀讨论,每轮讨论后做讨论蒸馏卡 -

3. 再补证据,核心文献做卡片,文献批量导入 IMA -

4. 再拆章节,准备写哪章就做哪章的章节写作包 -

5. 有多个改法先比较,做修改比较卡再决定吸收 -

6. 最后执行写作,把章节写作包 + 文献卡片 + 比较结论打包投给 AI

最容易踩的坑

坑 1:把原始聊天当知识库 — 聊天是发散的,写作需要收敛

坑 2:一次让 AI 理解项目又写完整章 — “理解”和”执行”分开,先确认理解正确再执行

坑 3:每轮都把全部材料重新塞一遍 — 模型每次都重新洗牌,版本会漂。用卡片系统按需投喂

坑 4:候选方案不经裁决直接进主稿 — 多个方案必须先走修改比较卡,否则越改越乱

七、工程思维:用项目文件夹管理研究

把做研究当成做一个工程项目。一个选题从启动到投稿,会产生大量文档、数据、对话记录、不同版本的稿件。如果不提前规划好文件夹结构,很快就会变成一团乱麻。

推荐的项目文件夹架构

研究项目名称/├── 项目说明文档.md ← 所有 AI 交互的共享入口├── 00_项目总览/ ← 研究框架、目标期刊、时间规划├── 01_文献与数据/│ ├── 原始文献 PDF/│ ├── 结构化文献卡片/│ └── 数据源与检索记录/├── 02_理论框架/│ ├── 核心理论文献/│ ├── 框架演变记录/│ └── 分析框架图/├── 03_论文草稿/│ ├── 当前版本/ ← 永远只有一个最新版│ ├── 修改方案/│ ├── 归档_旧版本/ ← 被替代的版本移到这里│ └── 版本记录.md├── 04_数据分析/│ ├── 原始数据/│ ├── 分析脚本/│ └── 分析结果/├── 05_Chatlog/ ← 对话归档├── 06_范文参考/└── 07_投稿材料/几个关键原则

-

• 编号前缀控制顺序: 00_01_02_…… 让文件夹按逻辑排列 -

• 当前版本和归档分离: 当前版本/里永远只有一个最新稿,旧版移到归档_旧版本/ -

• 版本记录:每次大改写一行,改了什么、为什么改、基于谁的反馈 -

• Chatlog 独立文件夹:按日期命名,定期回顾,成熟结论合并到项目说明文档 -

• 不要过度细分:按需裁剪,够用就行

入门建议

如果你刚接触 AI 辅助科研,建议按这个顺序上手:

第一步:学会结构化 Prompt(第一节),这是地基

第二步:用 ChatGPT Deep Research + Google Scholar 找文献,最快见效

第三步:建结构化文献卡片,为后续写作打基础

第四步:尝试卡片化写作,解决”AI 写出来很空”的问题

第五步:从重复任务开始做模板,把最常做的那个动作固化下来

先把每一步手动做通,再考虑流程化。

夜雨聆风

夜雨聆风