具身智能相关论文开源代码推荐20260415

点击下方卡片,关注【具身智能小站】公众号

📅 2026年4月

👋 大家好!

来了!2026 年新开始的一个系列,主要是整理具身智能领域最近发表的提供开源代码或数据集的项目(论文),希望对相关领域的小伙伴有所帮助。获取这些论文的开源项目链接,可以直接在本文中查看。欢迎转发和关注!!👇

📊 今日数据统计

|

|

|

|---|---|

|

|

|

🤖 开源论文(重点板块)

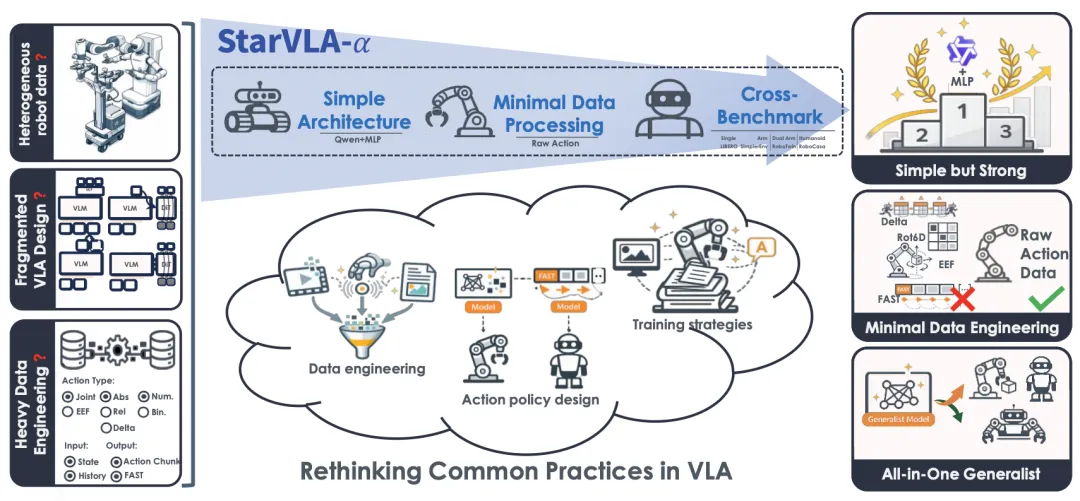

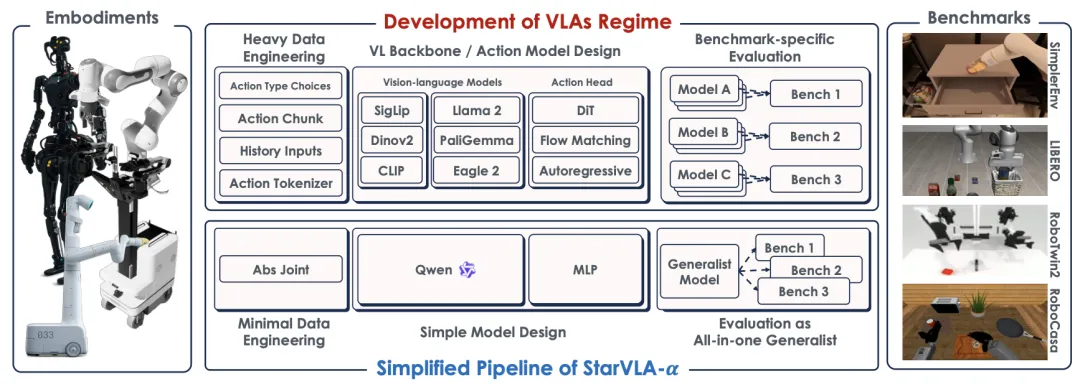

🔬 StarVLA-α:降低视觉-语言-动作系统的复杂性

📌 VLA · 具身智能 · 多任务学习 · 基准测试

✨ 通过强VLM骨干加轻量MLP动作头的极简设计,在多个基准上达到最优性能,挑战了现有复杂架构的必要性

📖 当前VLA系统架构、数据、评估方式高度碎片化。StarVLA-α提供了一个简单但强大的基线,刻意最小化架构与数据处理复杂度。在统一的多基准训练(LIBERO、SimplerEnv、RoboTwin、RoboCasa)下,该简单设计表现出强竞争力,并在真实RoboChallenge基准上超越π0.5达20%。系统分析表明:连续动作预测优于离散;动作特定预训练效果依赖数据匹配;数据工程技巧在数据充足时增益有限。

💡 强VLM初始化与统一训练流水线比复杂架构工程更重要。

🔗 项目链接:https://github.com/starVLA/starVLA

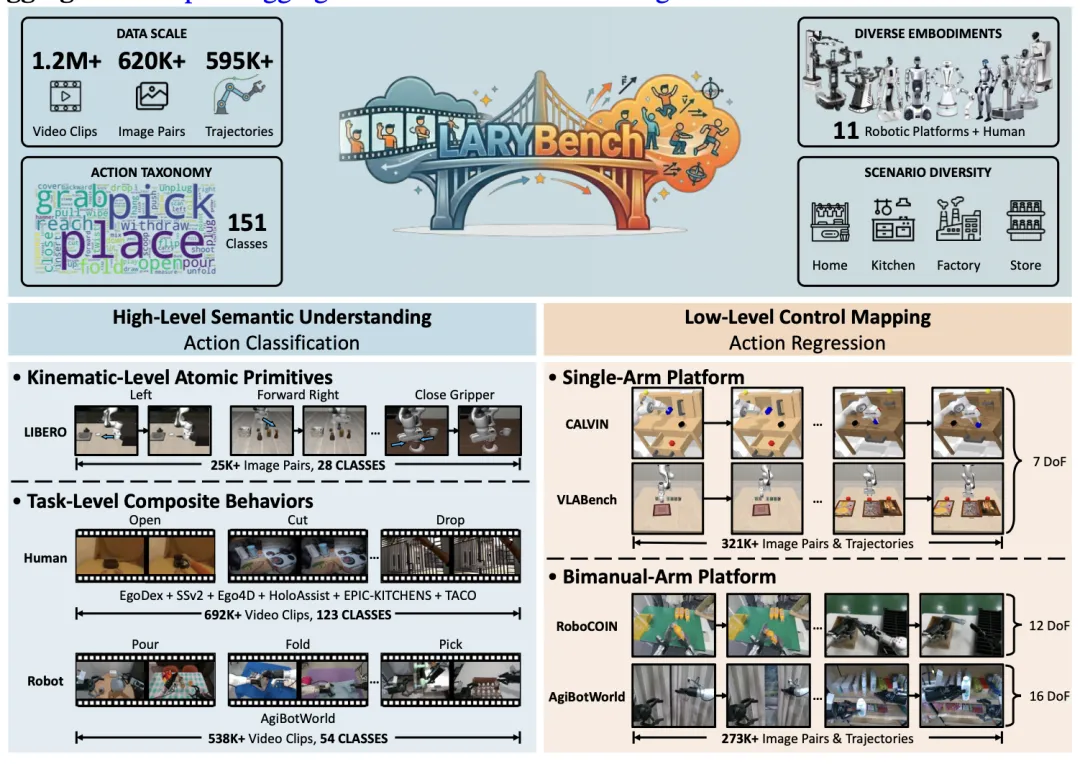

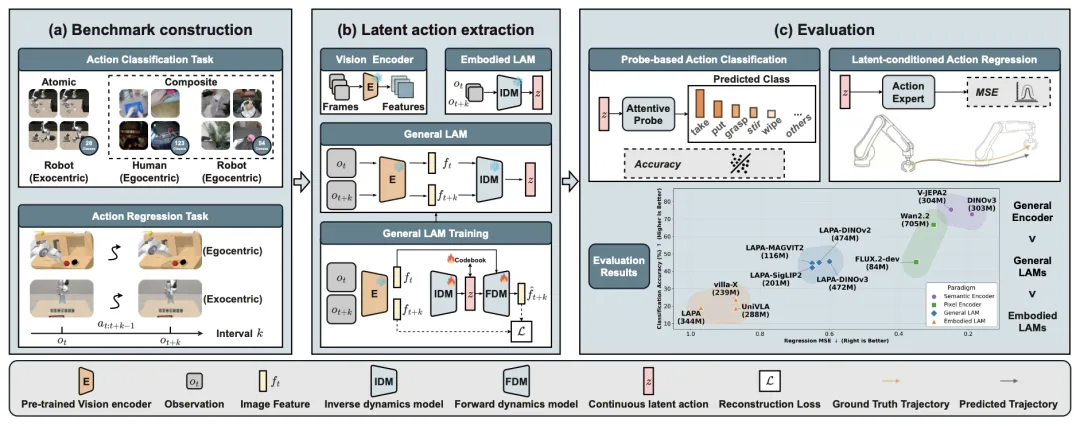

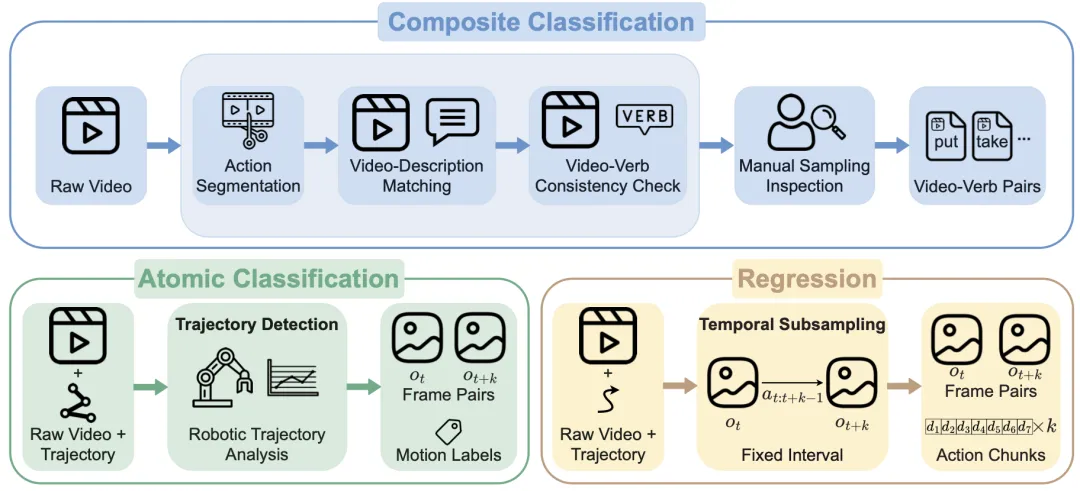

🔬 LARY:面向通用视觉-动作对齐的潜在动作表示评估基准

📌 潜在动作 · 视觉-语言-动作 · 基准测试 · 表示学习

✨ 首次系统评估潜在动作表示在高层语义动作分类与低层机器人控制回归上的质量,揭示通用视觉编码器优于专用具身模型

📖 从大规模人类视频中学习潜在动作表示是解决机器人数据稀缺的关键,但缺乏对其质量的系统评估。LARYBench构建了包含120万视频、151个动作类别、620K图像对和595K轨迹的大规模基准,涵盖高层的复合行为分类和低层的末端轨迹回归。评估11个模型发现:通用视觉基础模型无需动作监督即优于专用潜在动作模型;基于隐特征的视觉空间比基于像素的空间更对齐于物理动作空间。

💡 未来VLA系统应更多利用通用视觉表示,而非在稀缺机器人数据上从头学习动作空间。

🔗 项目链接:https://github.com/meituan-longcat/LARYBench

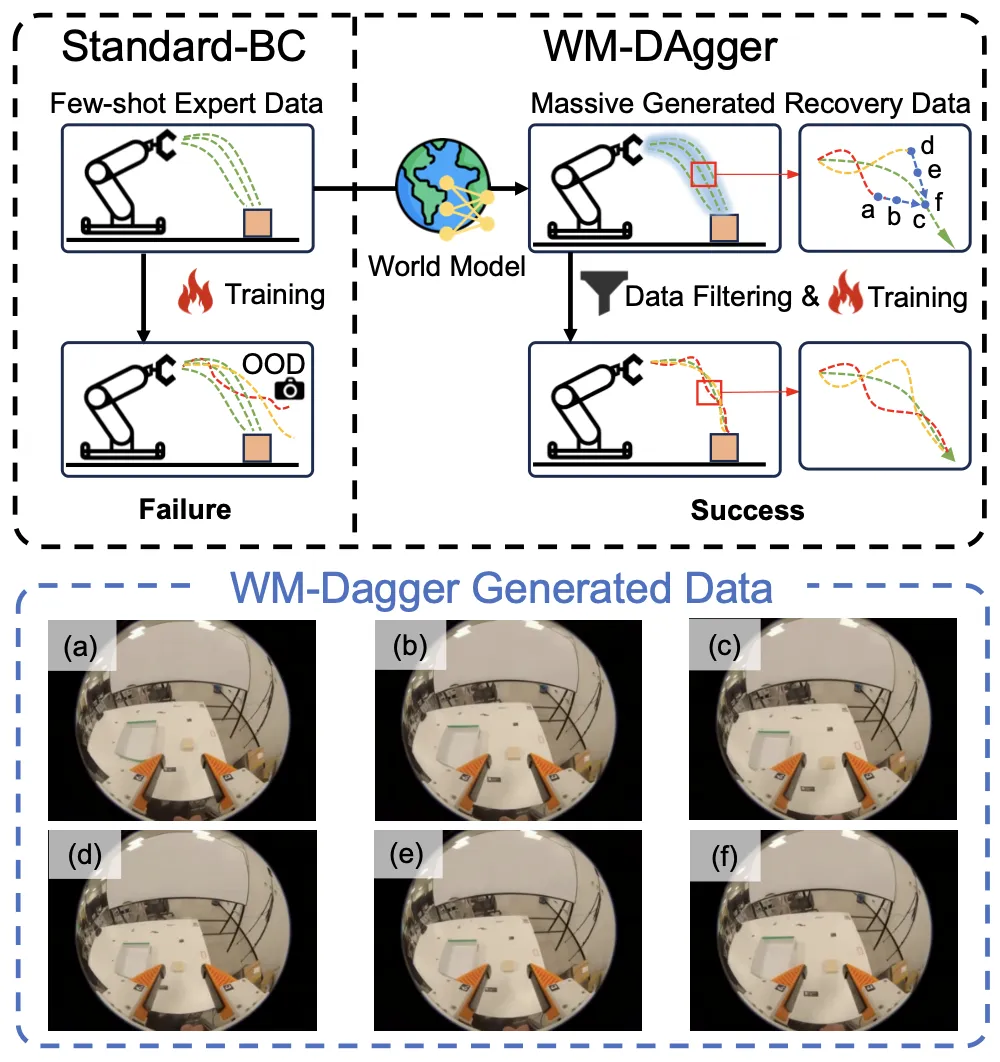

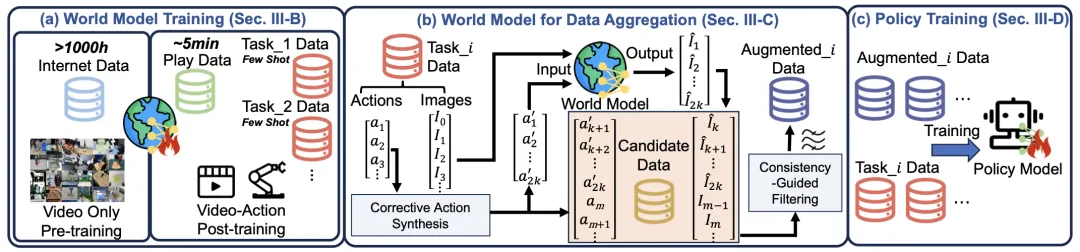

🔬WM-DAgger:基于世界模型的模仿学习高效数据聚合

📌 模仿学习 · 世界模型 · 数据聚合 · 机器人操作

✨ 利用世界模型合成离分布恢复数据,仅需少量演示即可大幅提升机器人操作的成功率

📖 模仿学习受限于复合误差问题。WM-DAgger利用眼在手上的条件化世界模型(EAC-WM)合成离分布状态的恢复轨迹。通过纠正动作合成模块生成任务导向的恢复动作,并通过一致性引导过滤模块剔除幻觉帧。在软袋推送、抓放、投票插入和毛巾折叠四个真实任务上验证,仅用5个演示就在软袋推送任务上达到93.3%成功率。

💡 世界模型可作为可扩展的高保真监督器,减少对人类演示的依赖。

🔗 项目链接:https://github.com/czs12354-xxdbd/WM-DAgger

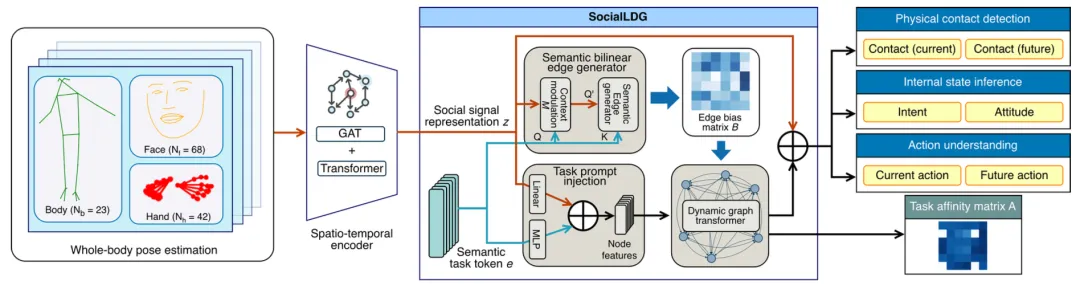

🔬 SocialLDG:通过词汇引导的动态图学习教机器人理解社交交互

📌 人-机器人交互 · 多任务学习 · 动态图 · 社交智能

✨ 显式建模用户内部状态(意图、态度)与可观察行为之间的动态关系,实现机器人主动社交理解

📖 社交机器人需要推断用户内部状态并预测其行为。SocialLDG提出一种多任务学习框架,将六个社交感知任务(接触、意图、态度、动作)建模为动态图中的节点,通过语言模型注入词汇先验,并学习随时间演化的任务亲和矩阵。在两个公开数据集上达到最优性能,支持新任务快速扩展且不遗忘旧任务,并提供了任务关系演化的可解释性。

💡 动态任务亲和矩阵可以自动检测交互阶段边界,为认知过程提供新见解。

🔗 项目链接:https://anonymous.4open.science/r/SocialLDG-914F

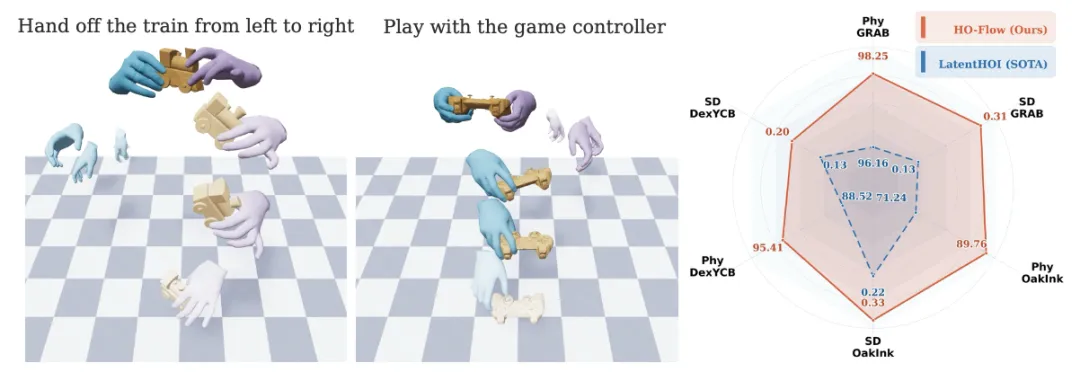

🔬 HO-Flow:基于流匹配的手-物交互运动生成框架

📌 手-物交互 · 运动生成 · 流匹配 · VAE

✨ 提出交互感知VAE与自回归流匹配模型,在三个基准上实现最先进的物理合理性与运动多样性

📖 生成真实3D手-物交互序列需要兼顾时序连贯性与物理合理性。HO-Flow首先通过交互感知VAE将手-物运动编码到统一隐空间,捕捉全局轨迹与细粒度接触特征;然后采用掩码流匹配模型结合自回归时序推理,在连续空间中高效生成隐运动编码。实验在GRAB、OakInk、DexYCB上验证了优于现有方法的物理合理性与运动多样性。

💡 流匹配相比扩散模型在抑制穿透和提升物理真实性上更具优势。

🔗 项目链接:https://zerchen.github.io/projects/hoflow.html

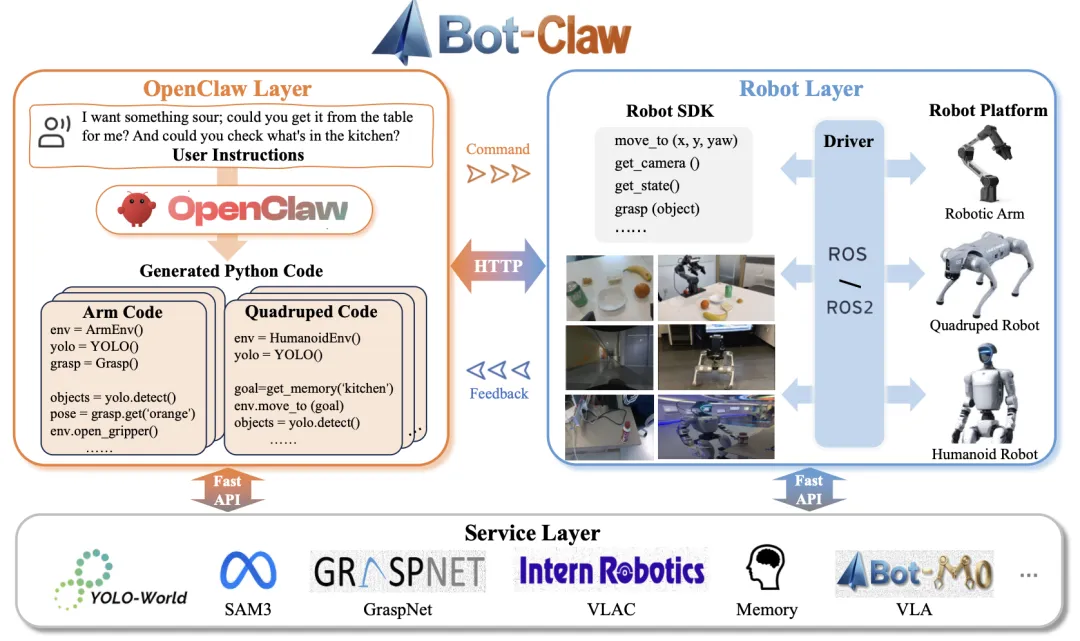

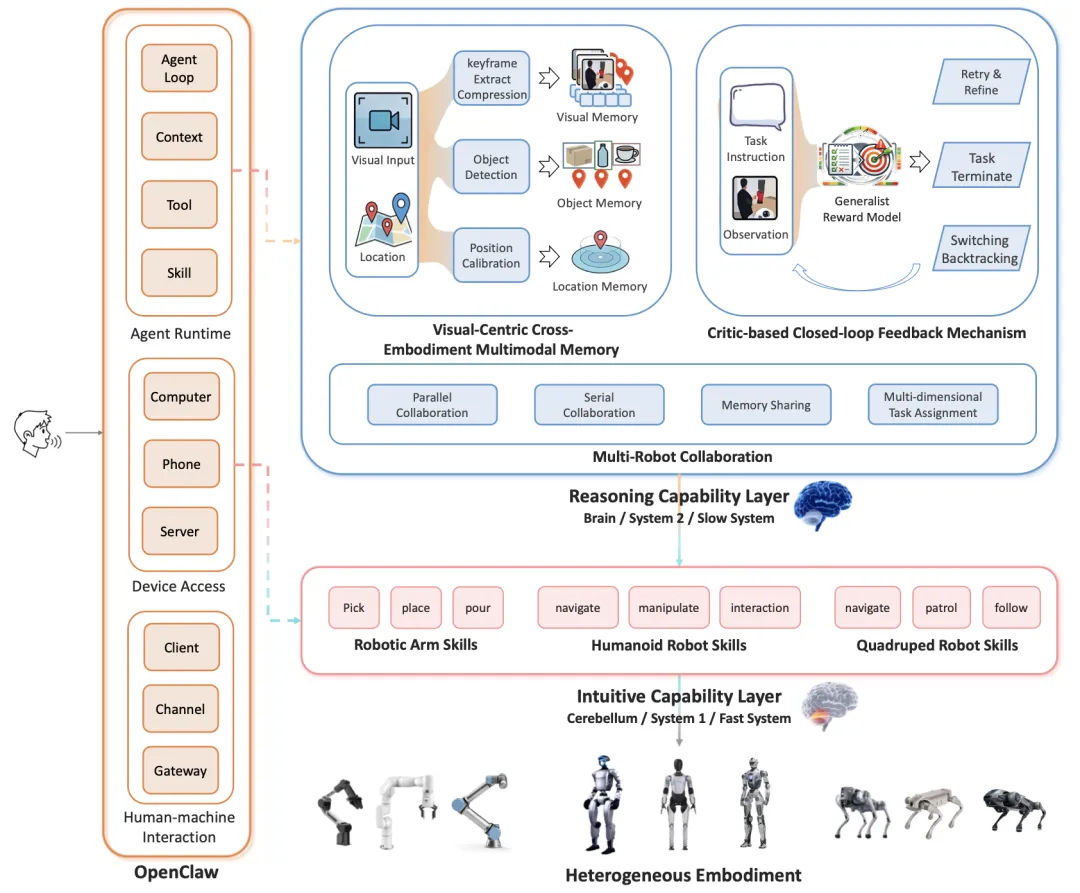

🔬 ABot-Claw:持久、协作与自我进化机器人智能体的基础框架

📌 Embodied AI · 多智能体 · 世界模型 · 闭环反馈

✨ 通过统一具身接口、视觉中心跨具身多模态记忆和基于评论家的闭环反馈,实现真实世界中多机器人协作与自我进化

📖 当前具身智能系统在开放世界中面临高层推理与低层执行的鸿沟。ABot-Claw扩展了OpenClaw运行时,集成三大创新:统一具身接口支持异构机器人协调调度;视觉中心跨具身多模态记忆提供持久上下文检索;基于通用奖励模型的评论家模块实现在线进度评估、局部修正与重规划。实验展示了在机械臂、人形机器人和四足机器人上的复杂任务执行与跨具身任务重分配。

💡 将OpenClaw的软件自动化能力延伸到物理世界,是实现长期自主运行的关键路径。

🔗 项目链接:https://github.com/amap-cvlab/ABot-Claw

一般的星球时间限制是1年,我们这个进去就是终身进去了,不会有时间限制。还有可以结合更多志同道合的朋友

夜雨聆风

夜雨聆风