AI Agent从玩具到工具 | 跨越企业级部署的记忆与安全鸿沟

最近,AI 圈的目光集体转向了”Agent 落地”。Cloudflare 推出企业级边缘计算平台 Agent Cloud;Meta 发布多智能体编排模型 Muse Spark;解决大模型”失忆”问题的 Cognee 记忆框架在开发者社区引发热烈讨论。

行业信号再清晰不过:AI Agent 正在跨越”Demo 玩具”的阶段,向复杂的企业级集群演进。

但真正令人不安的,是这背后被忽视的安全盲区。

一、 大模型的”失忆症”,让攻击有了持久化的温床

长周期、多步骤的工作流,是 Agent 最容易”翻车”的场景。由于大模型上下文窗口存在物理上限,当处理了大量中间数据之后,最初的指令目标往往已经被”淹没”了——Agent 会突然忘记自己在干什么,转而跑偏到无关的任务上去。

行业的应对思路,是给 Agent 外挂一个”持久化记忆体”。Cognee 这类框架,通过图数据库和 RAG 技术,让 Agent 不仅能存储数据,还能理清实体之间的逻辑关系。这相当于给 AI 装上了一个带推理能力的外脑。

但从安全的角度看,记忆的持久化,恰恰是一枚定时炸弹。

一次污染,长期生效。在企业级场景中,这无异于引狼入室。

二、 从本地沙箱到企业架构:安全措施还在”原地踏步”

环境跃迁,往往是事故的温床。当 Agent 脱离了相对封闭的本地测试环境,跨入企业级分布式部署的网络边界时,底层的通信机制和权限管理正经受着严重的错位考验。

1. WebSocket 网关的裸奔

现代多智能体框架在协同工作时,高度依赖 WebSocket 长连接来保证低延迟的实时状态同步。在单机开发环境里,本地网关天然处于被信任的状态。但一旦进入分布式部署,如果 WebSocket 网关直接暴露在复杂企业网络中,缺少连接层的强校验与加密隔离,攻击者就能以极低的成本发起中间人攻击——嗅探智能体之间的通信内容,甚至伪造调度指令,将整个业务流的工作流导向彻底劫持。

2. 插件集成的”越权”黑洞

Agent 的能力边界,取决于它的”手脚”——也就是各种第三方 API 和插件。以最常见的企业协同办公平台集成为例:为了让 Agent 自动发消息、创建日程,开发者通常需要授予相应的 API Token。

问题出在权限的颗粒度上。一个只被设计用来”汇总每日打卡记录”的 Agent,很可能同时获得了读取企业内部公开文档甚至群聊记录的权限。如果这个 Agent 被恶意 prompt 攻破,它瞬间就变成了一个拥有高权限的内部”内鬼”——横向爬取敏感业务数据,几乎毫无阻碍。

3. 多租户环境下的数据穿透

在 SaaS 化的 Agent 服务中,多个部门或不同企业共用同一套底层架构。如果在向量检索、内存处理和执行沙箱层面没有做到严格的物理或逻辑隔离,A 部门的 Agent 在处理涉密财务数据时,完全可能因为上下文缓存未清理或检索域混淆,将机密信息”泄漏”到 B 部门的问答结果中。

这不是理论推演。在多租户向量数据库的场景下,已有多起因隔离不充分导致跨租户数据泄露的真实案例。

三、 构建 Agent 时代的安全护栏

面对这些工程层面的痛点,泛泛而谈”AI 伦理”毫无意义,安全机制必须直接写进产品需求和系统架构的底层设计里。

原则一:零信任 + 最小权限

Agent 的每一个插件调用、每一次跨域通信,都必须经过动态鉴权。Token 须具备严格的生命周期管理和极细粒度的接口权限绑定——不是”能调这个插件”,而是”只能读取这三条数据中的这一个字段”。

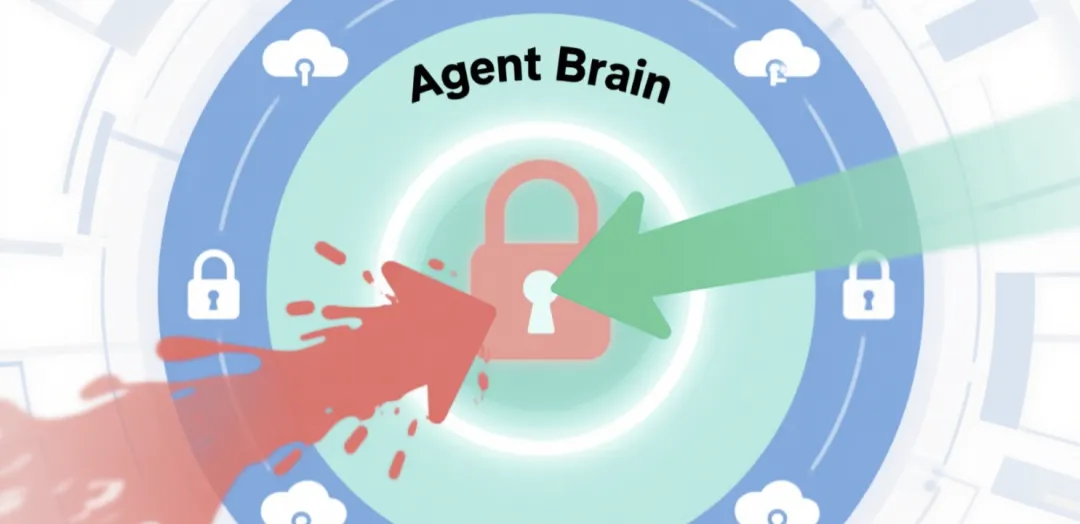

原则二:双向安全护栏(Security Guardrails)

输入端,建立硬性过滤机制,拦截针对 Agent 逻辑的恶意注入;输出端,在 API 调用前设置拦截器,审查其动作是否合规。防止越权操作,更要防止敏感数据被意外外发。

原则三:全流量细粒度审计

针对 Agent 的 WebSocket 通信和 API 调用,建立协议级的全流量分析与回溯机制。一旦发生越权或异常资源消耗——比如某个 Agent 在短时间内发起了大量非预期的 API 请求——系统应能精准定位到是哪条指令触发了失控行为。

AI Agent 是极具想象力的生产力工具,但这股力量必须戴着镣铐跳舞。只有筑牢底层的安全底座,真正解决通信验证与权限隔离的痛点,企业级 Agent 才能真正走出 Demo,抵达业务的深水区。

全文完

夜雨聆风

夜雨聆风