AI 工具实战笔记 03:WorkBuddy 积分节省指南 + 自定义模型教程

不想错过苏米的分享和推送?

戳上方蓝字“苏米客”关注我吧

并点击右上角“···”菜单,

选择“设为星标”

接上文,前面提到了关于积分的领取,今天就详细的来分享一下WorkBuddy 积分消耗规则以及如何使用更节省积分,我相信在你看到的很多文章里,都会跳过这个,只讲实战的方案,不讲软件的底层逻辑

今天苏米就给大家补齐这一块,因为只有搞清楚底层的规则,WorkBuddy 才能越用越久,越用越好用!

不然今天一个任务就把你积分耗光,明天开了会员,还没用两下又没有余额,这就不只是花冤枉钱的事儿了,是WorkBuddy 根本用不了,你就直接放弃了~

所以今天分享两件事:1、如何节省积分,降低消耗;2、接入自定义模型,外部加持消耗兜底;

1、了解积分如何消耗?

所有的AI对话都是按Token来计算的,中文名称叫“词元”,那么Token 消耗的主要两个来源是什么?

| 消耗类型 | 含义 | 怎么影响消耗 |

|---|---|---|

| 输入 Token | 你发送的内容 + 历史对话 + 工具返回结果 | 对话越长,消耗越大 |

| 输出 Token | AI 生成的回复 | 回复越长,消耗越大 |

但在WorkBuddy里,WorkBuddy采用基于 Credits 的资源配额管理机制,就是把Token转换成积分来计算消耗了,实际差别不大,但个人就比较难计算,Credits 系用于衡量 AI 任务执行过程中的资源消耗量。

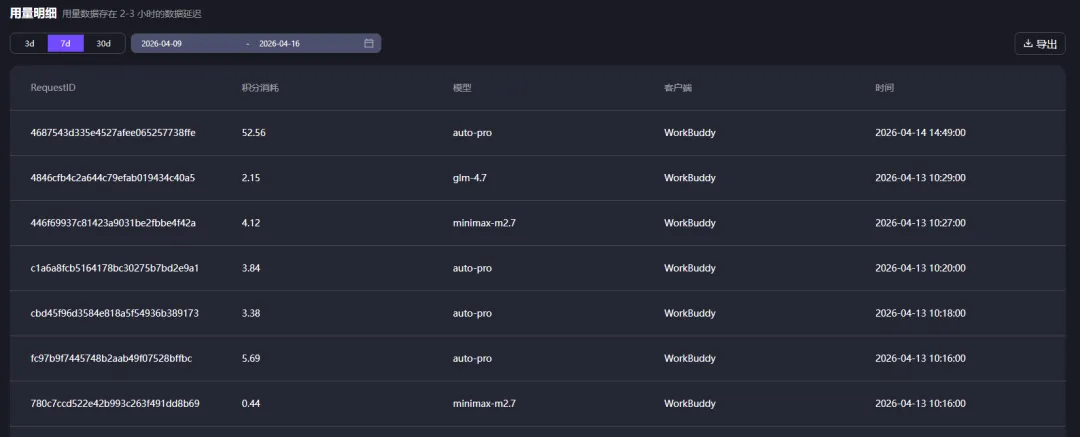

看下面的账单,其实是比较蒙的:

2、高消耗的问题根源

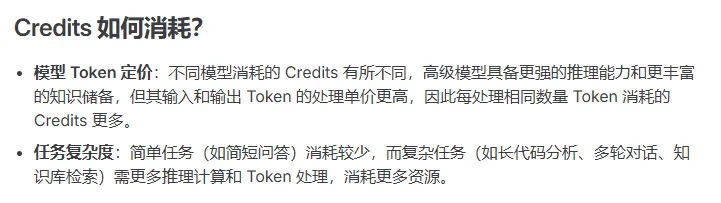

了解了WorkBuddy积分的计算规则,官方有提到两点:不同模型消耗的 Credits 有所不同、简单任务消耗较少,而复杂任务需更多推理计算和 Token 处理消耗更多资源(等于没说)

但苏米这里分享两个最容易出现高消耗情况:

1)对话轮数越多,消耗越容易出现指数级增长

这是 90% 的人都会踩的坑,长时间持续对话:

因为每一轮对话,都会把之前所有内容重新发给 AI。

- • 第 1 轮:处理当前问题 → 低消耗 ✅

- • 第 5 轮:处理当前问题 + 前 4 轮历史 → 中消耗 ⚠️

- • 第 10 轮:处理当前问题 + 前 9 轮历史 → 较高消耗 🔺

- • 第 20 轮:处理当前问题 + 前 19 轮历史 → 高消耗 ❌

假设你的后端项目有一个接口报错,当用户没有传递某个可选参数时,服务器直接返回 500 内部错误。

❌ 高消耗做法(24,800 Tokens)

第 1 轮

用户: 我的项目跑不起来了,帮我检查一下。

AI: 好的,请提供错误日志或项目路径... [等待用户输入]

第 2 轮

用户: 好像是在获取用户详情的时候报错的。

AI: 让我查看一下相关的路由定义... [全局搜索 user/profile 路由,读取路由文件 150 行]

第 3 轮

用户: 报错信息说是 NoneType object has no attribute 'get'。

AI: 这通常是因为字典为空导致的。请问具体是哪个接口?能否贴一下报错堆栈?

第 4 轮

用户: 就是 user_service.py 里面的 get_profile 方法。

AI: 让我读取这个文件看看逻辑... [读取 user_service.py 全文 400+ 行代码]

第 5 轮

用户: 你看是哪里的问题?前端有时候不传参数。

AI: 我看到代码里有一行 request_data.get('config').get('theme')。如果 request_data.get('config') 返回 None,就会报错。你需要修改这里。

第 6 轮

用户: 那你帮我改一下吧,做一个保护。

AI: 好的,修改代码如下... [生成包含 30 行上下文的补丁代码]6 轮对话,消耗约 24,800 Tokens ⚠️

✅ 低消耗做法(125 Tokens)

用户:

修复 /backend/services/user_service.py 第 156 行的空引用 Bug。

问题: request_data.get('config') 可能为 None,导致调用 .get('theme') 时崩溃。

要求: 请直接修改该行代码,使用安全的嵌套获取方式(如 or {})来处理,无需解释。

AI:

已修复。将 request_data.get('config').get('theme') 修改为 (request_data.get('config') or {}).get('theme')。1 轮对话,消耗约 125 Tokens ✅

对比结果

| 指标 | 高消耗 | 低消耗 | 差距 |

|---|---|---|---|

| Token 消耗 | 24,800 | 125 | 节省 99.5% |

| 对话轮数 | 6 轮 | 1 轮 | 减少 83.3% |

| 总耗时 | 4-6 分钟 | 8 秒 | 减少 97% |

2)文件读取需求越模糊,消耗越大

这种也是最常见的,因为Agent有自主执行操作文件的能力,所以当你的需求模糊的时候,Agent会自己读目录找文件,这就会直接导致,你的目录越多,文件越难找,执行效率就越慢,也越消耗Tokens

精准定位 :非必要别让 AI 瞎找,直接给路径。

❌ 高消耗做法

第 1 轮

用户: 检查一下项目报错的原因。

AI: 请提供具体的错误信息或日志。

第 2 轮

用户: 控制台提示某个文件有语法错误。

AI: 让我搜索一下项目中的 JavaScript 文件... [全局扫描目录]

第 3 轮

用户: 应该是在 utils 目录下。

AI: 正在读取 /src/utils/ 目录... [列出所有文件,逐一排查]

3 轮对话,消耗 Token 中... ⚠️✅ 低消耗做法

用户: 定位 /src/utils/logger.js 第 12 行的语法错误。

AI: 已定位。该行缺少闭合括号,是否立即修复?

1 轮对话,极速响应 ✅对比结果

| 指标 | 高消耗 | 低消耗 | 节省 |

|---|---|---|---|

| Token 消耗 | 高 (需扫描目录) | 低 (精准跳转) | 30-50% |

只要解决这两个问题,大部分的场景下是能节省不少Tokens的

3、5 个技巧,积分消耗直降 90%

| 技巧 | 核心心法 | ✅ 低消耗示例 | 节省 |

|---|---|---|---|

| 1. 精准定位 | 直给路径,拒绝搜索 | “读取 /workspace/app.py 第 50 行” | 30-50% |

| 2. 一次说清 | 拒绝挤牙膏,需求一步到位 | “写爬虫爬豆瓣 Top250,输出 CSV” | 40-60% |

| 3. 控制输出 | 只要结果,不要废话 | “只输出代码,不加注释” | 20-40% |

| 4. 及时清理 | 切换任务,使用 /clear | 每 5-10 轮清理一次上下文 | 50-80% |

| 5. 选对模型 | 杀鸡焉用牛刀 | 简单任务用轻量模型 | 30-50% |

4、模型选型积分消耗说明

| 模型 | 侧重点 | 积分消耗 |

|---|---|---|

| MiniMax-M2.5 | 轻量快速、性价比高 | 0.18 |

| 智谱 GLM-4.7 | 逻辑强、综合能力均衡 | 0.23 |

| MiniMax-M2.7 | 多模态、图片/图文理解 | 0.26 |

| Kimi-K2.5 | 超长上下文、文档精读 | 0.28 |

| DeepSeek-V3.2 | 代码、数理、技术逻辑 | 0.30 |

| 自定义模型 | 本地部署、完全免费 | 0 |

选型小建议

- • 简单任务:优先选 M2.5(积分最省)

- • 长文档/大文件:用 Kimi-K2.5(省心)

- • 看图片/图表:选 M2.7

- • 写方案/做策划:用 GLM-4.7

- • 技术/代码类:直接用 DeepSeek

5、积分不够,上自定义模型

如果说你已经很省了,但还积分还是很快消耗完,而且上了套餐还是不够怎么办?

那就只能上自定义模型了,今天苏米分享接入两个我个人觉得比较好的国产模型MiniMax M2.7和GLM-5.1 而且对应的MiniMax Token Plan 和GLM Codeing Plan

WorkBuddy 接入 MiniMax 教程

MiniMax 最近推出了 M2.7 模型,号称支持”AI 自我迭代”,在代码和推理任务上表现优秀。

而一新增语音、音乐、视频和图片生成权益好友立享 9折

专属优惠:https://platform.minimaxi.com/subscribe/token-plan?code=3KrdXFHSKA\&source=link

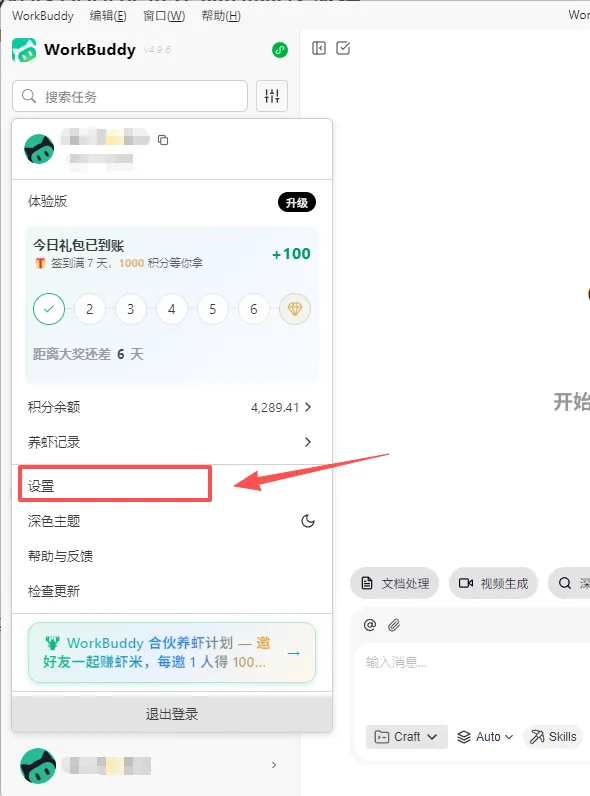

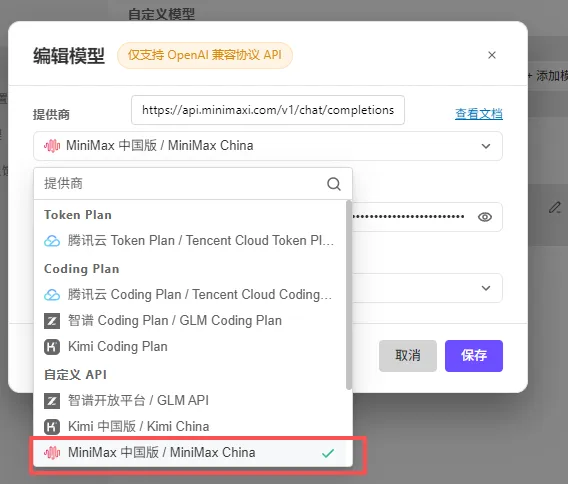

打开 WorkBuddy 设置

点击左下角头像里的设置

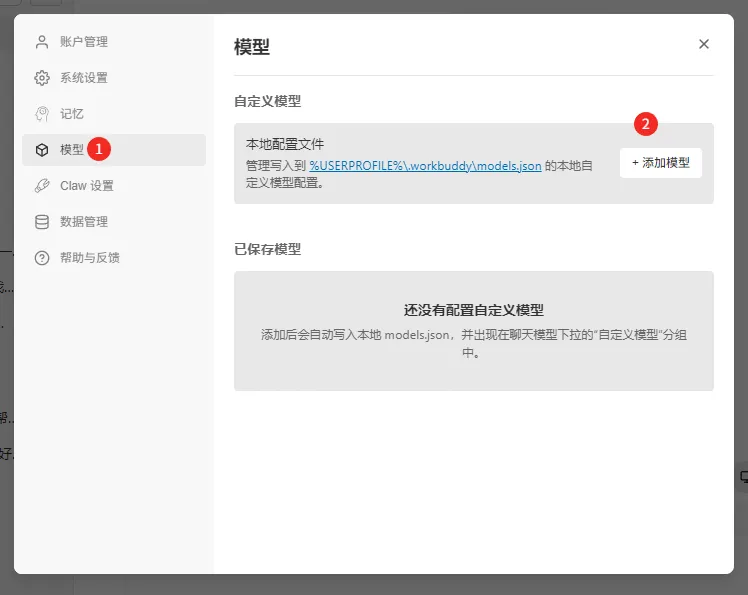

然后点击模型 → 添加模型。

添加 MiniMax 模型配置

打开 MiniMax 账户管理,点击接口秘钥,把秘钥复制到 WorkBuddy 编辑模型的弹出框里。

注意选择MiniMax的时间没有显示支持 Token Plan ,但实测是可以的,而且内置支持MiniMax M2.5,后面会告诉大家如何改M2.7

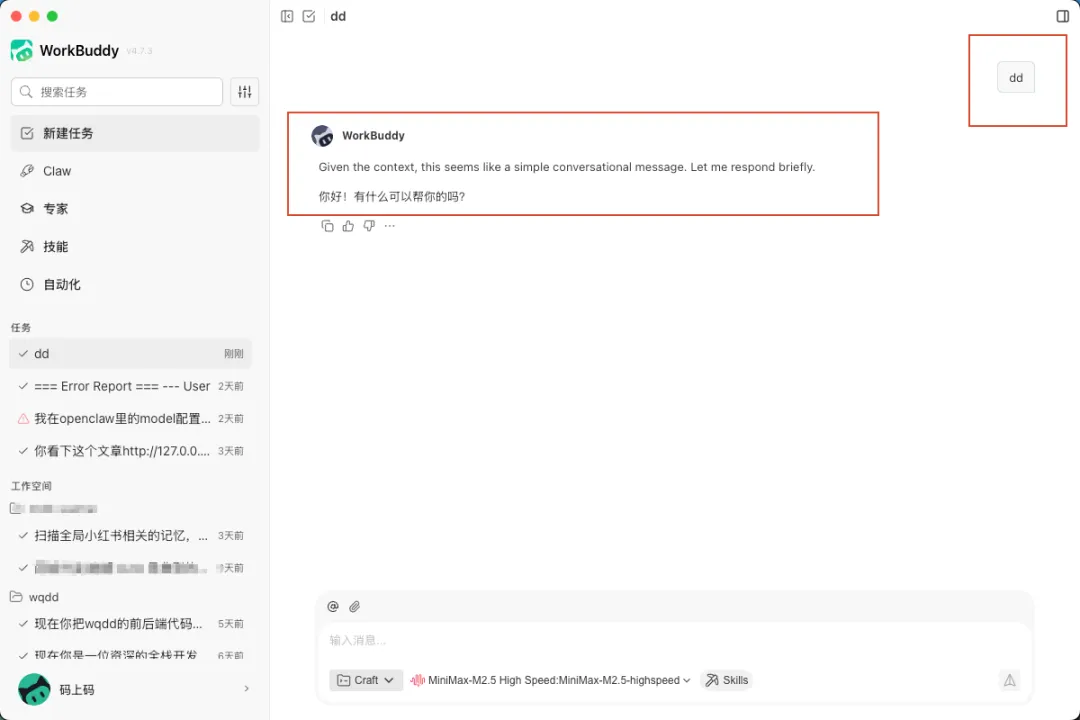

重启 WorkBuddy 并切换模型

建议完全退出再重新打开 WorkBuddy(macOS 用户右键 Dock 图标选「退出」)。

重启后在对话框左下角切换到 MiniMax M2.5,发一条消息验证。

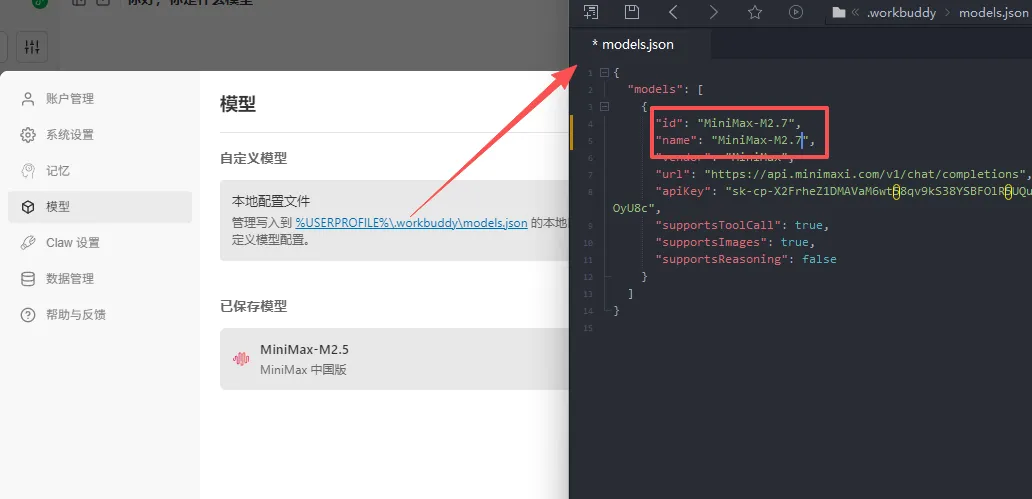

接下来我们把模型改成M2.7,手动修改配置文件,进入设置 – 点击模型,可以看到配置文件路径这里是可以点击的%USERPROFILE%\.workbuddy\models.json,直接点击用编辑器打开

直接把2.5改成2.7,完全退出再重新打开 WorkBuddy就变成MiniMax M2.7了

WorkBuddy 接入 GLM-5.1 教程

最近智谱发布了 GLM-5.1 模型更新,SWE-Bench Pro 全球第一,长程任务可连续工作 8 小时,最具性价比的选择自然是智谱 Coding Plan!

专属优惠:https://www.bigmodel.cn/glm-coding?ic=9AAIY9WTEH

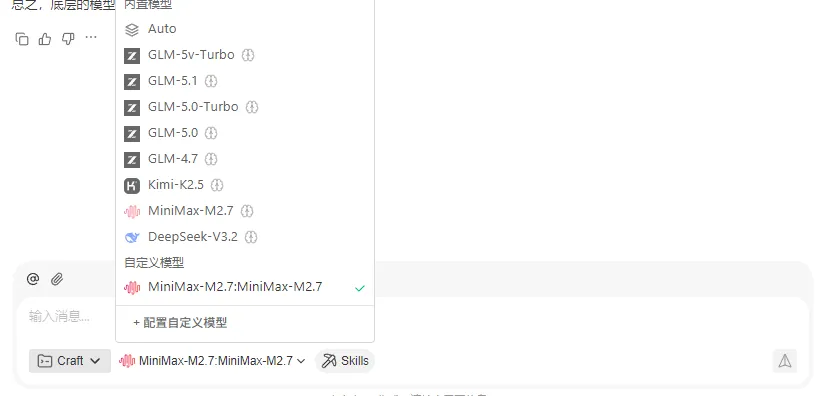

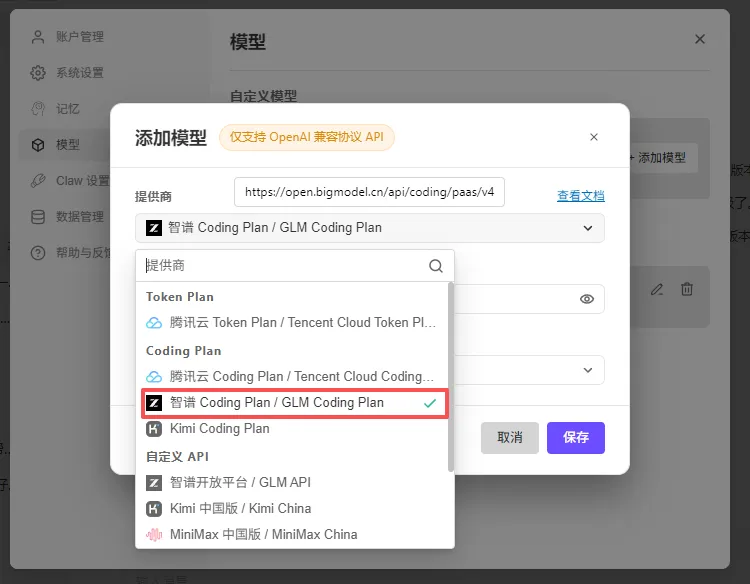

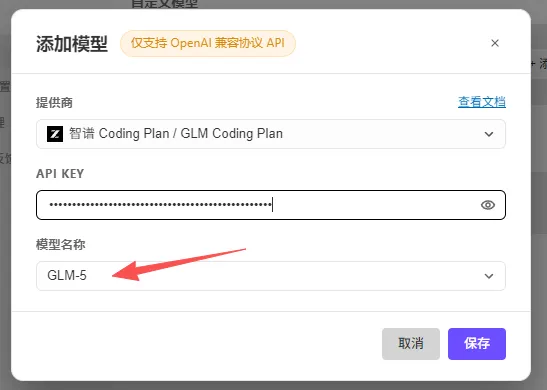

添加 智谱 Coding Plan 模型配置

WorkBuddy 内置支持直接选择 智谱的 Coding Plan 模型配置

同样目前最新版WorkBuddy 支持到GLM-5,所以先选择,再来改配置

重启 WorkBuddy 并切换模型

用前面改MiniMax 的方法,把配置改成GLM-5.1,并完全退出再重新打开 WorkBuddy,再来试试

这样你的对话就不再受积分限制了。

有了MiniMax M2.7和GLM-5.1加持,WorkBuddy的执行效率将大大提升!

记得先把免费的额度都用完,日常使用额度也是充足的

📮 往期精彩文章

夜雨聆风

夜雨聆风