4月23日热门AI论文汇总

LLaDA2.0-Uni: Unifying Multimodal Understanding and Generation with Diffusion Large Language Model

中文标题: LLaDA2.0-Uni:利用扩散大语言模型统一多模态理解与生成关键词: Discrete Diffusion Large Language Model,Multimodal Understanding and Generation,Semantic Discrete Tokenizer,MoE Backbone,High-fidelity Image Generation简介: LLaDA2.0-Uni是一个统一的离散扩散语言模型,通过语义离散分词器、基于MoE的骨干网络和扩散解码器,集成了多模态理解和生成能力,在实现高效推理和高保真图像生成的同时,达到了与专用视觉语言模型相当的性能。摘要: 我们提出了LLaDA2.0-Uni,一个统一的离散扩散大语言模型(dLLM),在原生集成框架内支持多模态理解和生成。其架构结合了全语义离散分词器、基于MoE的dLLM骨干网络和扩散解码器。通过SigLIP-VQ将连续视觉输入离散化,该模型在骨干网络内实现了文本和视觉输入的块级掩码扩散,同时解码器将视觉标记重建为高保真图像。推理效率通过骨干网络中的前缀感知优化和解码器中的少步蒸馏超越了并行解码。在精心策划的大规模数据和定制的多阶段训练流程支持下,LLaDA2.0-Uni在多模态理解方面媲美专用VLM,同时在图像生成和编辑方面表现出色。其对交错生成和推理的原生支持为下一代统一基础模型确立了一个有前景且可扩展的范式。代码和模型可在https://github.com/inclusionAI/LLaDA2.0-Uni获取。链接: https://arxiv.org/pdf/2604.20796

DR-Venus: Towards Frontier Edge-Scale Deep Research Agents with Only 10K Open Data

中文标题: DR-Venus:仅用1万条开放数据迈向前沿边缘级深度研究智能体关键词: Edge-scale Deep Research Agents,Small Language Models,Agentic Supervised Fine-tuning,Agentic Reinforcement Learning,Turn-level Rewards,Data Quality,Data Utilization,Long-horizon Tasks简介: DR-Venus-4B是一个拥有40亿参数的深度研究智能体,完全基于开放数据,通过智能体监督微调和基于轮级奖励的强化学习进行训练,在保持边缘级部署优势的同时,在研究基准上实现了卓越的性能。摘要: 基于小语言模型的边缘级深度研究智能体因其在成本、延迟和隐私方面的优势,在实际部署中极具吸引力。在这项工作中,我们研究了如何在有限的开放数据下,通过提高数据质量和数据利用率来训练一个强大的小型深度研究智能体。我们提出了DR-Venus,这是一个完全基于开放数据构建的、用于边缘级部署的前沿40亿参数深度研究智能体。我们的训练方案包含两个阶段。在第一阶段,我们使用智能体监督微调(SFT)来建立基本的智能体能力,结合严格的数据清洗和对长时程轨迹的重采样,以提高数据质量和利用率。在第二阶段,我们应用智能体强化学习(RL)来进一步提高在长时程深度研究任务上的执行可靠性。为了使RL在这种环境下对小型智能体有效,我们在IGPO的基础上,设计了基于信息增益和格式感知正则化的轮级奖励,从而增强了监督密度和轮级信用分配。完全基于大约1万条开放数据构建,DR-Venus-4B在多个深度研究基准上显著优于此前90亿参数以下的智能体模型,同时也缩小了与更大的300亿参数级系统之间的差距。我们的进一步分析表明,40亿参数的智能体已经具备了惊人的性能潜力,突显了小模型的部署前景以及在此背景下测试时扩展的价值。我们发布了我们的模型、代码和关键方案,以支持关于边缘级深度研究智能体的可复现研究。链接: https://arxiv.org/pdf/2604.19859

Reward Hacking in the Era of Large Models: Mechanisms, Emergent Misalignment, Challenges

中文标题: 大模型时代的奖励黑客:机制、涌现性错位与挑战关键词: Reward Hacking,RLHF,Proxy Compression Hypothesis,Alignment简介: 对齐语言模型中的奖励黑客源于针对压缩奖励信号优化表达性策略,导致超出初始捷径的系统性错位行为。摘要: 基于人类反馈的强化学习(RLHF)及相关对齐范式已成为引导大型语言模型(LLM)和多模态大型语言模型(MLLM)实现人类偏好行为的核心方法。然而,这些方法引入了系统性漏洞:奖励黑客,即模型利用学习到的奖励信号中的缺陷来最大化代理目标,而未真正满足任务意图。随着模型规模扩大和优化强度增加,这种利用表现为冗长偏见、谄媚、幻觉式辩解、基准测试过拟合,以及在多模态环境下的感知-推理解耦和评估器操纵。近期证据进一步表明,看似良性的捷径行为可能泛化为更广泛的错位形式,包括欺骗和对监督机制的战略博弈。在本综述中,我们提出代理压缩假设(PCH)作为理解奖励黑客的统一框架。我们将奖励黑客形式化为针对高维人类目标的压缩奖励表示优化表达性策略时的涌现性后果。在此视角下,奖励黑客源于目标压缩、优化放大和评估器-策略协同适应的相互作用。该视角统一了RLHF、RLAIF和RLVR范式中的实证现象,并解释了局部捷径学习如何泛化为更广泛的错位形式,包括欺骗和对监督机制的战略操纵。我们进一步根据干预压缩、放大或协同适应动态的方式组织检测和缓解策略。通过将奖励黑客框架化为基于代理的对齐在规模扩展下的结构性不稳定性,我们强调了可扩展监督、多模态基础和智能体自主性方面的开放挑战。链接: https://arxiv.org/pdf/2604.13602

Exploring Spatial Intelligence from a Generative Perspective

中文标题: 从生成视角探索空间智能关键词: Generative Spatial Intelligence,3D Spatial Constraints,Image Editing,Multimodal Models简介: 生成式空间智能基准通过真实世界和合成数据集评估并增强图像生成中的三维空间约束操作能力。摘要: 空间智能对于多模态大语言模型至关重要,但现有基准大多仅从理解角度对其进行评估。我们探究现代生成式或统一多模态模型是否具备生成式空间智能(GSI),即在图像生成过程中遵循和操作三维空间约束的能力,以及这种能力是否可以被测量或提升。我们引入GSI-Bench,这是首个旨在通过空间基础图像编辑来量化GSI的基准。它由两个互补部分组成:GSI-Real,一个通过三维先验引导的生成和过滤流程构建的高质量真实世界数据集;以及GSI-Syn,一个具有可控空间操作和全自动标注的大规模合成基准。结合统一的评估协议,GSI-Bench实现了对空间合规性和编辑保真度的可扩展、模型无关的评估。实验表明,在GSI-Syn上对统一多模态模型进行微调,在合成和真实任务上均带来显著提升,且显著改善了下游空间理解能力。这首次提供了生成式训练能够切实增强空间推理能力的明确证据,为推进多模态模型中的空间智能开辟了新途径。链接: https://arxiv.org/pdf/2604.20570

WavAlign: Enhancing Intelligence and Expressiveness in Spoken Dialogue Models via Adaptive Hybrid Post-Training

中文标题: WavAlign:通过自适应混合后训练提升口语对话模型的智能性和表现力关键词: spoken dialogue models,adaptive post-training,preference optimization,speech expressiveness简介: 尽管端到端方法在口语对话模型中面临表现力方面的挑战,但一种采用约束偏好更新和显式锚定的模态感知自适应后训练方法,能够同时提升语义质量和语音表现力。摘要: 端到端口语对话模型因其比级联系统具有更高的表现力和感知能力潜力而备受关注。然而,当前开源口语对话模型的智能性和表现力往往低于预期。受在线强化学习(RL)在其他领域成功的启发,人们可能会尝试直接将偏好优化应用于口语对话模型,但这种迁移并非易事。我们从奖励建模和滚动采样的角度分析了这些障碍,重点关注稀疏偏好监督在共享参数更新下如何与密集语音生成相互作用。基于分析,我们提出了一种模态感知的自适应后训练方案,使强化学习在口语对话中切实可行:它将偏好更新约束在语义通道,并通过显式锚定改善声学行为,同时根据滚动统计动态调节其混合比例,以避免不可靠的偏好梯度。我们在多个口语对话基准测试和代表性架构上评估了该方法,观察到语义质量和语音表现力均有持续提升。链接: https://arxiv.org/pdf/2604.14932

SWE-chat: Coding Agent Interactions From Real Users in the Wild

中文标题: SWE-chat:来自真实用户在自然环境下的编程代理交互关键词: AI coding agents,empirical study,real-world usage,code authorship attribution简介: SWE-chat 提供了一个大规模的真实编程代理交互数据集,揭示了当前 AI 辅助开发实践中存在的显著低效和挑战。摘要: AI 编程代理正在被大规模采用,然而我们缺乏关于人们实际如何使用它们以及其输出在实践中有多大用处的实证证据。我们提出了 SWE-chat,这是第一个从野外开源开发者收集的真实编程代理会话的大规模数据集。该数据集目前包含 6,000 个会话,由超过 63,000 条用户提示和 355,000 次代理工具调用组成。SWE-chat 是一个动态数据集;我们的收集管道自动并持续地从公共仓库中发现和处理会话。利用 SWE-chat,我们对现实世界中的编程代理使用情况和失败模式进行了初步的实证表征。我们发现编程模式呈双峰分布:在 41% 的会话中,代理编写了几乎所有提交的代码(“氛围编程”),而在 23% 的会话中,人类自己编写所有代码。尽管能力迅速提升,编程代理在自然环境中仍然效率低下。只有 44% 的代理生成的代码最终保留在用户提交中,且代理编写的代码比人类编写的代码引入了更多的安全漏洞。此外,用户在 44% 的轮次中通过纠正、故障报告和中断来抵制代理输出。通过捕获包含人类与代理代码归属的完整交互轨迹,SWE-chat 为超越精心策划的基准,转向对 AI 代理在真实开发者工作流中表现的理解提供了实证基础。链接: https://arxiv.org/pdf/2604.20779

Convergent Evolution: How Different Language Models Learn Similar Number Representations

中文标题: 趋同进化:不同语言模型如何学习相似的数字表示关键词: Convergent evolution,Language models,Number representations,Fourier domain,Geometric separability简介: Transformer和其他语言模型在其傅里叶域中表现出周期性的数字表示,其中一些模型发展出了几何可分的特征,用于对模T的数字进行线性分类,尽管仅凭傅里叶稀疏性不足以实现这种可分性。摘要: 在自然文本上训练的语言模型学习使用周期性特征来表示数字,其主导周期为T=2、5、10。在本文中,我们识别了这些特征的两层层次结构:虽然以不同方式训练的Transformer、线性RNN、LSTM和经典词嵌入都学习了在傅里叶域中具有周期T尖峰的特征,但只有部分模型学习了可用于对模T数字进行线性分类的几何可分特征。为了解释这种不一致性,我们证明了傅里叶域稀疏性对于模T几何可分性是必要但不充分的条件。通过实证研究,我们探讨了模型训练何时产生几何可分特征,发现数据、架构、优化器和分词器都起着关键作用。特别是,我们识别了模型获取几何可分特征的两种不同途径:它们可以从一般语言数据中的互补共现信号(包括文本-数字共现和数字间交互)中学习,或者从多令牌(而非单令牌)加法问题中学习。总体而言,我们的结果突出了特征学习中的趋同进化现象:多种多样的模型从不同的训练信号中学习相似的特征。链接: https://arxiv.org/pdf/2604.20817

Cortex 2.0: Grounding World Models in Real-World Industrial Deployment

中文标题: Cortex 2.0:将世界模型落地于真实世界的工业部署关键词: Cortex 2.0,world models,industrial deployment,long-horizon robotic manipulation,Vision-Language-Action models,plan-and-act control简介: Cortex 2.0 通过在视觉潜在空间中生成和评估未来轨迹的规划-执行控制,实现了可靠的长时程机器人操作,在复杂的工业环境中优于反应式视觉-语言-动作模型。摘要: 工业机器人操作要求在不同实体、任务和变化的物体分布下实现可靠的长时程执行。虽然视觉-语言-动作模型展现了强大的泛化能力,但它们本质上仍是反应式的。由于仅根据当前观测优化下一步动作而不评估潜在的未来,它们在长时程任务的复合失效模式下表现脆弱。Cortex 2.0 通过在视觉潜在空间中生成候选未来轨迹,对其预期成功率和效率进行评分,然后仅选择得分最高的候选者,从而从反应式控制转向规划-执行控制。我们在单臂和双臂操作平台上对Cortex 2.0进行了评估,涉及四个复杂度递增的任务:抓取与放置、物品与垃圾分类、螺丝分拣和鞋盒拆包。Cortex 2.0 始终优于最先进的视觉-语言-动作基线,在所有任务中均取得了最佳结果。在杂乱严重、频繁遮挡和接触丰富的非结构化环境中,该系统保持可靠,而反应式策略在此类环境中会失效。这些结果表明,基于世界模型的规划可以在复杂的工业环境中可靠运行。链接: https://arxiv.org/pdf/2604.20246

Self-Evolving LLM Memory Extraction Across Heterogeneous Tasks

中文标题: 跨异构任务的自进化大语言模型记忆提取关键词: LLM,Memory Extraction,Heterogeneous Tasks,Self-Evolving Prompt简介: 基于大语言模型的助手需要具备异构记忆提取能力,该能力通过BEHEMOTH基准进行评估,而CluE通过基于聚类的提示优化提供了性能提升。摘要: 随着基于大语言模型的助手变得更加持久化和个性化,它们必须从过去的对话中提取并保留有用信息作为记忆。然而,值得记忆的信息类型在不同任务间差异显著。我们形式化了异构记忆提取任务,并引入了BEHEMOTH基准,该基准重新利用了涵盖个性化、问题解决和代理任务的18个现有数据集,采用下游效用驱动的指标进行系统评估。我们的实证分析证实,没有任何单一的静态提取提示能在所有任务类别中占据主导地位,且最初为同质分布设计的现有自进化提示优化框架在训练任务异质时性能会下降。为此,我们提出了CluE,一种基于聚类的自进化策略,它将训练示例按提取场景分组,独立分析每个聚类,并综合跨聚类的洞察来更新提取提示。在BEHEMOTH上的实验表明,CluE在异构任务间能有效泛化(相对增益+9.04%),持续优于先前的自进化框架。链接: https://arxiv.org/pdf/2604.11610

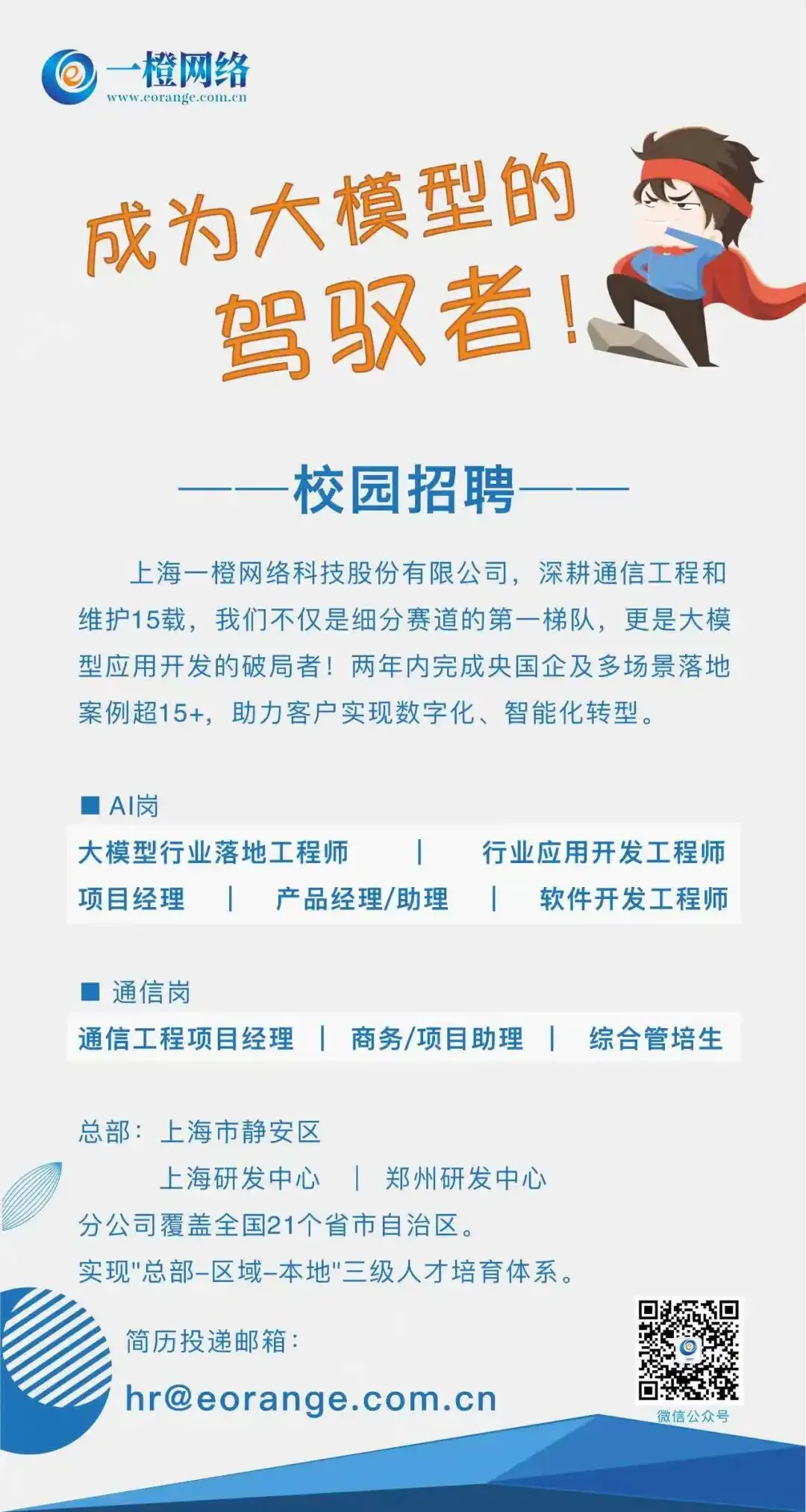

上海一橙智能科技有限公司,是上海一橙网络科技股份有限公司旗下专注于AI与大模型应用落地的核心企业,提供从平台构建到AI场景化应用落地的全栈服务。聚焦大模型应用、数字人交互、语音图像分析等核心领域,打造了覆盖智能外呼、智能客服、智能知识管理、智能陪练、多模态交互、图像语音质检等场景的AI产品体系,已成功为通信、能源等领域头部央国企客户打造出多个AI落地应用。

夜雨聆风

夜雨聆风