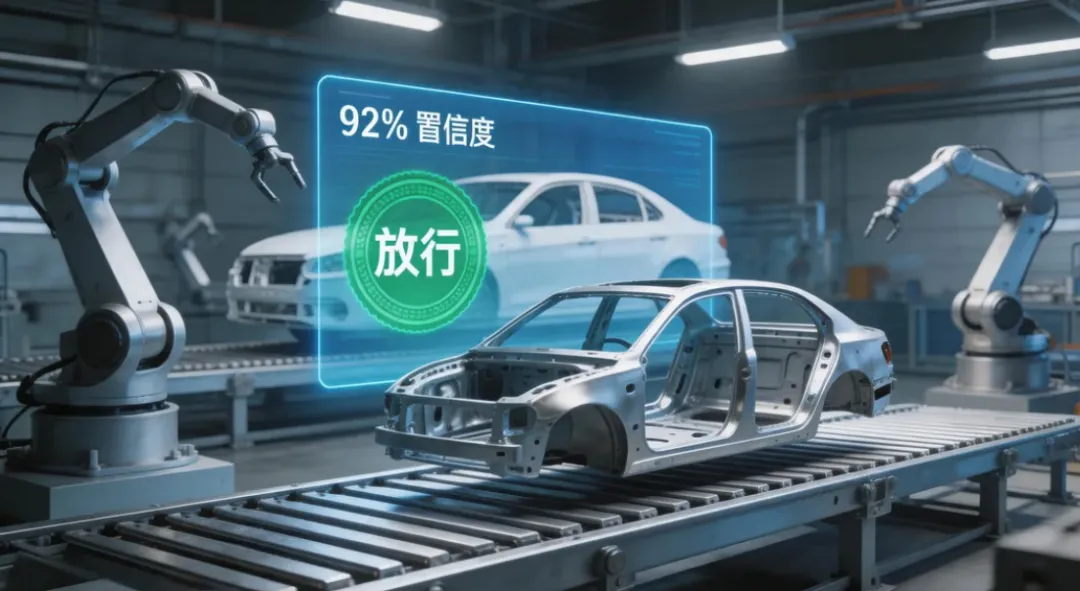

VDA《AI in Quality Management》的实践逻辑:92%的置信度,凭什么放行?质量合格逻辑的重构

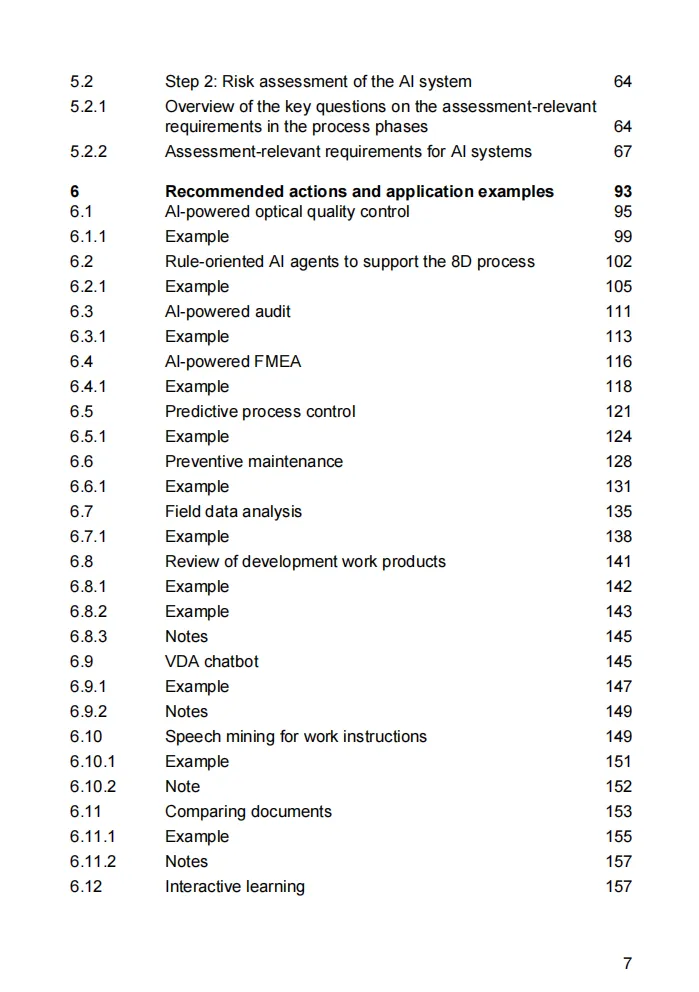

2026年3月,德国汽车工业协会(VDA)发布黄皮书《Artificial Intelligence in Quality Management》(第一版),现处于反馈阶段(截止2026年5月12日)。原文英语,暂无中文版。

想象一个场景。

你坐在汽车生产线的终检工位上。一台AI光学检测设备刚刚判定一个零部件“合格”,屏幕上跳出一行字:置信度92%。

旁边的通止规也显示合格。

问题来了:你签不签字放行?

传统质量管理的训练告诉你:合格就是合格,不合格就是不合格,没有92%这个说法。卡尺量出来是10mm,就是10mm,不是“92%的10mm”。

但AI不按这套逻辑出牌。它输出的是一个概率。

92%,意味着还有8%的不确定。那8%怎么办?审核员问你:凭什么相信这个92%?你怎么证明这个决定不是拍脑袋?

这不是假设。这是今天汽车行业每一个引入AI的质量经理都会遇到的真实困境。

德国汽车工业协会(VDA)在2026年3月发布了一份黄皮书,题目叫《质量管理中的人工智能》。它没有教你调参,没有讲算法。它只回答一个问题:

一个输出概率的AI,凭什么获得质量体系颁发的“合格证”?

答案,有点反直觉。

一、质量管理的“基座”和AI的“冒犯”

先看传统质量管理。

它的三根柱子是:确定性、可重复性、可追溯性。

卡尺量10mm,换一个人量还是10mm。控制图上的点超了,就触发纠正。8D报告里的每一个原因,都要有证据链。审核员来了,你拿出记录,一条一条对得上。

这套体系用了几十年,可靠。它的底层假设是:测量结果是一个确定的值,决策是非黑即白的。

再看AI。

AI学数据,不读标准。AI输出概率,不是结论。AI的表现在数据变化时会“漂移”——换了材料批次,它的准确率可能悄悄下降。很多AI还是黑箱,你问它“为什么判废”,它说不清楚。

每一项,都在挑战质量管理的三根柱子。

怎么办?不用AI?那你就失去效率。硬用?体系可能被冲垮。

VDA的答案是:不改三根柱子,但要在它们之间架一座桥。

这座桥的设计图纸,就在这份黄皮书里。

二、三个对策:把“不确定”关进流程的笼子里

VDA没有试图让AI变得更确定。它做的是另一件事:改变我们对待不确定性的方式。

对策一:先统一语言,否则寸步难行

数据科学家说“置信度92%”,质量工程师理解成“有8%可能出错”。前者觉得已经很高了,后者觉得这风险不可接受。

对话在起点就断了。

VDA做的第一件事,就是给每个AI术语在质量场景里下定义。

“置信度”不是准确率,而是模型对自己判断的不确定程度的表达。“漂移”不是设备温漂,而是输入数据的分布变了。“黑箱”是技术状态,“高风险AI系统”是法律分类——两者不能混为一谈。

好比两个国家的人谈判,先得把词典对齐。否则后面的流程、模板、检查表全是空中楼阁。

对策二:不搞一刀切,风险多大,管控多深

不是所有AI应用都需要走同一个批准流程。

VDA设计了一个两步走的风险分级。

第一步,看七个维度:是否属于欧盟AI法案规定的高风险系统?数据是否涉及个人隐私?财务损失有多大?会不会伤及品牌声誉?产品安全等级多高?……

每个维度分三级:AIQM-1(低)、AIQM-2(中)、AIQM-3(高)。整个项目的风险等级,取最高的那个。

第二步,根据这个等级,决定检查清单的深度。

低风险的内部工具——比如一个帮你整理文档的聊天机器人——可能只需要验证数据来源和基本性能。高风险的在线废品分类系统——如果把良品判废,或者把废品放出——就要过全部流程:数据收集、模型训练、鲁棒性测试、人机回环、持续监控……

这就像医院里的检查。普通感冒和心脏手术,术前检查的项目数量不一样。不是厚此薄彼,而是风险不同,投入的验证精力就应该不同。

对策三:管住AI的“幻觉”,用规则兜底

这是最见功夫的地方。

VDA不回避AI会犯错。它承认“幻觉”存在——AI会生成听起来合理但实际错误的结论。它承认黑箱存在——有些模型你就是解释不了。

但它的逻辑是:犯错可以接受,前提是这些错误是可预期、可检测、可纠正的。

拿光学检测那个例子。AI输出92%置信度,你不能直接签字。

怎么做?VDA在6.1章给出了具体规则:

先做位置校验。AI识别出的零件位置,是否与参考特征(比如一颗螺丝)的位置一致?如果位置偏差过大,这个“92%”自动标记为不可信,转人工检查。

再做多区域交叉验证。让AI同时看零件的头部、中部、尾部。三个区域的分类结果如果不一致,结果也要降级处理。

这样一来,“92%”不再是一个孤立数字,而是被多个校验门禁过滤后的结论。审核员来查,你拿出规则、日志、验证记录——每一笔都清楚。

再比如8D报告。AI辅助写报告,最怕它编出一个不存在的根本原因。VDA的对策也很简单:AI只提建议,不能直接填;每个建议必须附带来源引用(历史案例编号、测量数据);系统设门禁,证据缺失就卡住,不让提交。

这不是在技术上消灭幻觉——短期也消灭不了。这是在流程上管理幻觉的后果。

三、对质量人意味着什么:不是取代,是升级

很多人担心AI会取代质量检验员。

VDA的答案很明确:不会。但会用AI的质量人,会取代不会用的。

第四章列出了四大核心能力:理解AI/ML基本概念、懂数据分析、会使用生成式AI(包括写提示词)、了解AI伦理和法规。

同时定义了四个新角色:AI质量数据工程师、分析师、数据科学家、数据经理。

这并不意味着每个人都要变成程序员。而是说,在质量管理体系里,必须有人专门负责数据管道、模型监控、合规审查。这些职能原来是IT或数据团队的,现在质量团队要参与甚至主导。

原来你检验零件。现在你检验AI。

原来你写8D报告。现在你审批AI写的草稿。

原来你管设备校准。现在你管数据漂移和模型版本。

职责变了,但位置更核心了。

四、回到最初的问题

92%的置信度,凭什么放行?

VDA的答案是:不是92%本身值得信任,而是你为这个92%搭建的整个管理流程值得信任。

你定义了规则——在什么条件下允许AI自动放行,什么条件下必须转人工。

你做了验证——用独立的测试集确认过这个AI在该产线、该光照、该批次材料下的表现。

你设了监控——每天跟踪它的准确率、置信度分布,发现漂移就及时报警。

你留了记录——每一次放行决策都保留了版本、参数、特征匹配日志,审核员可以追溯。

AI可以不完美,但你的体系必须能兜住它的不完美。

这就是VDA给AI颁发“质量合格证”的底层逻辑。

不是因为它准,而是因为你管得住。

为赋能质量人员,知识星球已积累研发管理、流程管理、项目管理、质量管理的干货资料4700+,内容还在更新中,欢迎加入,学习提升!

夜雨聆风

夜雨聆风