AI Agent的落地真相:AI能给答案,但给的答案好不好?

AI给了你一个答案,但那不是你要的那个

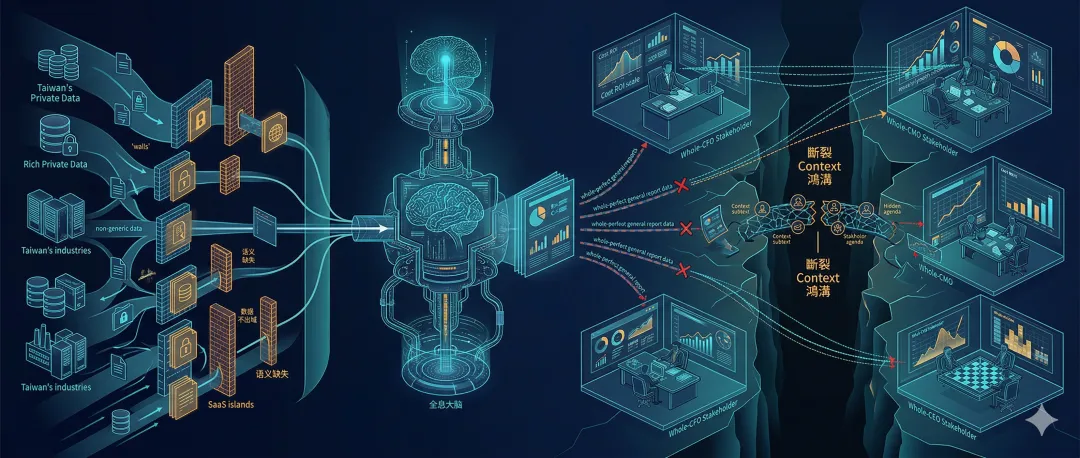

够好陷阱(Good-Enough Trap):AI找到B就停了,但你要的是C。语境黑盒(Context Blindspot):AI看得见数据,看不见stakeholder之间的潜台词。Output不是文件,是一次政治沟通。

⸻

NO° 01够好陷阱:AI找到B就停了

关键词:目标深度 · 最优解 · 验证成本 · 低context任务

假设你让AI分析一个业务问题。

这个问题有5个可能的答案:A、B、C、D、E。

评分分别是:A=80分,B=85分,C=92分,D=91分,E=50分。

AI会怎么做?

它会找到B——85分,”够好”——然后停下来,report on B。

但你要的是C——92分,最优解。

这就是够好陷阱(Good-Enough Trap):AI找到了一个”够好”的答案,但你永远不知道有更优解存在。

问题的根源在于:AI缺乏对“最终目标“的深度理解。

它优化的是“合理输出“,不是“正确决策“。

当AI看到B(85分)时,它认为“这个答案质量不错,可以交付了“。但它不知道:

• 在这个业务场景里,85分和92分的差距意味着什么

• 有没有可能找到更好的答案

• 这个决策的影响范围有多大

更麻烦的是:

当AI给你B时,你不敢直接用。你必须花大量时间去验证——A对不对?C存不存在?D和E呢?

原本想用AI省时间,结果验证的时间比自己做还长。

这就是够好陷阱的隐性成本:

AI给了你一个“够好“的答案,但你不敢信,不得不自己重走一遍。

目前AI真正能替代的,是低context、有明确终态的任务。

比如:格式化文档、翻译文本、生成标准代码。这些任务的目标清晰,答案对错一目了然。

但真正的分析和决策推动?AI还差得远。

AI找到B就停了,但你要的是C——这就是够好陷阱 | 图源:Pexels

⸻

NO° 02语境黑盒:AI看不见潜台词

关键词:Context Blindspot · Stakeholder · 隐性议程 · 政治沟通

够好陷阱是AI的”深度”问题。

语境黑盒是AI的”广度”问题。

AI可以生成一份完美的分析报告——数据准确、逻辑严密、格式规范。但这份报告在会议室里可能没有一个人引用。

为什么?

因为Output不是文件,是一次政治沟通。

同一个分析结果,在不同人眼里是完全不同的东西:

对谁说

CFO要看成本结构和ROI,CMO要看增长路径和市场机会,CEO要看风险敞口和战略取舍。

AI不知道谁是真正的决策者。

它生成的报告是“通用版“——对谁都适用,对谁都不精准。

说什么

什么信息对这个人关键,而非对全局关键?

比如一个市场分析:全局来看,市场规模、增长率、竞争格局都很重要。

但如果这个分析是给CFO看的,在预算收紧的背景下,最关键的是“哪些市场可以战略性放弃“。

AI不知道这个context,它会给你一份“均衡“的报告,但CFO找不到他要的答案。

怎么说

推动hidden agenda的叙事框架是什么?

每个组织都有自己的政治结构。有些决策已经内定,分析只是走流程;有些决策需要”借刀杀人”,分析报告是武器;有些决策需要”集体背锅”,分析报告是盾牌。

AI看不见这些潜台词。

语境黑盒(Context Blindspot):AI看得见数据,看不见stakeholder之间的潜台词。

语境黑盒:AI看得见数据,看不见stakeholder之间的潜台词 | 图源:Pexels

⸻

NO° 03海外研究的印证

关键词:HBS · 效率提升 · 信任赤字 · 组织语境

这不是我们的主观判断,海外研究给出了印证。

哈佛商学院(HBS)在2025年底发表了一项研究:

AI提升了知识工作者的效率约20%,但高管对AI产出的信任度仍然很低。

为什么效率提升了,信任却没有?

研究给出的答案是:AI产出缺乏“组织语境“。

具体来说:

• AI不知道这个组织的决策历史——哪些方案试过失败了,为什么失败

• AI不知道这个组织的权力结构——谁是真正的决策者,谁是拦路者

• AI不知道这个组织的沟通风格——什么算“有说服力“的表达

这些context,不是数据,是经验;不是结构化的,是散落在人的记忆里的。

另一项来自MIT的研究给出了更精确的对比:

AI在标准化任务上的表现接近人类专家,但在需要context判断的任务上,准确率下降了30-50%。

这印证了我们前面的判断:

AI目前能替代的是低context任务,真正的分析和决策推动,还需要人。

AI提升效率20%,但信任赤字依然存在——因为缺乏组织语境 | 图源:Pexels

⸻

NO° 04管理者的应对

关键词:AI是analyst · Narrative是人的工作 · 边界清晰

面对够好陷阱和语境黑盒,管理者应该怎么做?

第一,明确AI的边界

AI可以是analyst,但narrative仍然是人的工作。

让AI做:

• 数据收集和整理

• 初步分析和模式识别

• 标准化文档的生成

人来做:

• 判断哪个答案最优

• 针对不同stakeholder调整叙事

• 推动hidden agenda的沟通策略

第二,建立验证机制

既然AI可能掉进够好陷阱,就需要建立人工验证机制。

不是每份AI产出都需要人重走一遍,但关键决策必须有“第二双眼睛“。

可以设定规则:

• 涉及金额超过X的决策,必须人工复核

• 涉及跨部门利益的方案,必须多方验证

• AI置信度低于Y的输出,必须人工确认

第三,培养“数据–业务翻译官“

语境黑盒的本质,是懂数据的人不懂业务,懂业务的人不懂数据。

需要一类人:既懂AI的能力边界,又懂组织的政治语境。

他们能把AI的output翻译成不同stakeholder能听懂、愿意听的语言。

这种人不是数据科学家,是“数据–业务翻译官“。

在AI时代,这种人的价值会越来越高。

AI是analyst,narrative是人的工作——边界要清晰 | 图源:Pexels

⸻

NO° 05结语:Output端的双重失效

关键词:够好陷阱 · 语境黑盒 · Workflow > Skills > Agent

我们提出了两个新概念:

够好陷阱(Good-Enough Trap):AI找到B就停了,但你要的是C。

语境黑盒(Context Blindspot):AI看得见数据,看不见stakeholder之间的潜台词。

这两个问题叠加在一起,构成了Output端的结构性失效。

Input端的问题是“数据进不去“,Output端的问题是“答案出不来“。

两端都卡住了,中间Processing端再强也没用。

这就是为什么大公司的理性选择是 Workflow > Skills > Agent。

不是放弃AI,是把AI放在它真正靠谱的位置上。

下一篇,也是最后一篇,我们将完整拆解:为什么聪明的CXO都在悄悄退回Workflow。

Input和Output两端都卡住,中间Processing再强也没用 | 图源:Pexels

⸻

参考来源

本文引用的数据均来自以下公开报告和官方来源,读者可直接访问链接核实:

1. Harvard Business School, “AI and Trust in Enterprise Decision Making,” 2025.→ https://www.hbs.edu/

2. MIT Sloan Management Review, “Contextual AI: Why Machines Struggle with Organizational Nuance,” 2025.→ https://sloanreview.mit.edu/

3. McKinsey & Company, “The State of AI: Global Survey 2025,” November 2025.→ https://www.mckinsey.com/capabilities/quantumblack/our-insights/the-state-of-ai

⸻

往期「从发布会到会议室」系列

· 全员发布Agent,但大公司还在用Excel

· AI不缺算力,缺的是能喂的数据

· AI给了你一个答案,但那不是你要的那个 ← 你在这里

· 聪明的CXO,都在悄悄退回Workflow

⸻

欢迎关注「AI未来反思录」,获取更多AI行业深度分析与人文视角观察。

加入读者群,与企业管理者、科技从业者一起深度讨论AI时代的组织与人的未来。

夜雨聆风

夜雨聆风