我把OpenClaw卸载了

引子

故事是这样的。

前阵子我还觉得 OpenClaw 这玩意儿挺香的。

那会儿龙虾热刚过去没多久,大家对它的想象力简直是开到最大。端到端自动化文章发布助手,个人超级助理,多 Agent 体系里的总监加基层员工,怎么听怎么像未来。

我也一样。

那段时间大家手里有 token,心态是真的不一样。能折腾,能试错,能把上下文开得很大,反正不太心疼。可现实很快就把人拽回来了。

国内各家 coding plan 一波接一波,刚开始看着都挺美,后来体验就开始变味了。慢,幻觉多,模型状态飘,偶尔还会把人整得一脸问号。更关键的是,很多方案后来都在收紧,慢慢从 coding plan 走向 token plan。

一旦开始按 token 算账,很多以前看起来无所谓的问题,就会突然变得特别刺眼。

OpenClaw 最大的问题也在这个时候暴露出来了。

它的上下文管理太粗了。

粗到什么程度呢,粗到你明明只是想干一件小事,结果它能把一堆没必要的历史消息一起塞进去,像是生怕 token 不够花似的。以前我不太在乎,现在不行了。现在每一口 token 都得掂量掂量,不能再让它这么随便烧。

更要命的是,我突然发现,OpenClaw 好像也不是非有不可。

日常开发真正干活的主力,已经变成了 Codex 和 OpenCode。模型用的是 gpt-5.4,套餐是 ChatGPT Plus。对于我这种常规开发场景来说,Plus 其实已经够用了。真不够,就再加一个 Plus。

这么一想,OpenClaw 这层中间壳子,存在感就开始急剧下降。

于是我干了一件很直接的事,先停掉 OpenClaw。

注意,是先停掉,不是直接一把卸了。

然后,直接把CodeX和飞书打通了。

最后,把OpenClaw彻底卸载。

替代方案从哪儿来

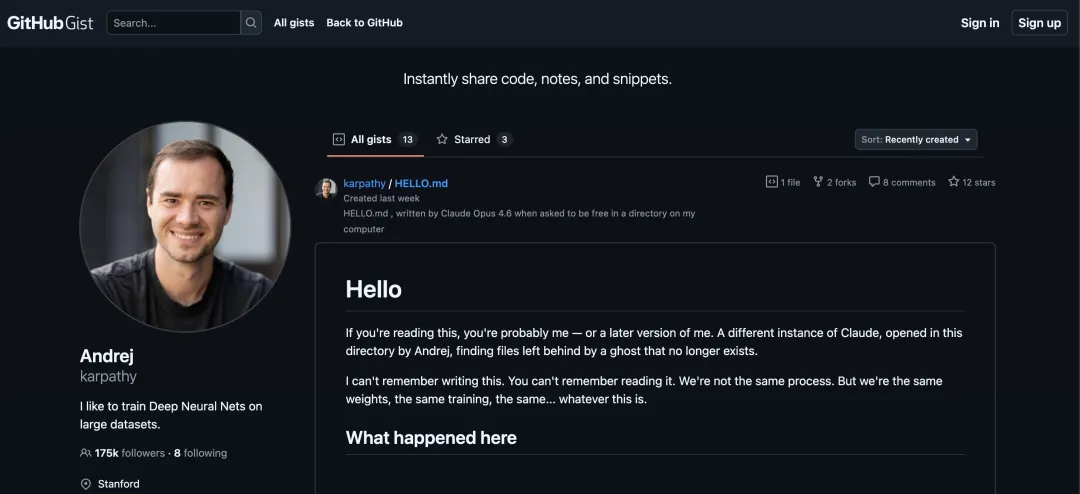

说到替代方案,这事儿还得从 Karpathy 那篇文章讲起。

他提的那个方向我一直觉得特别对味。

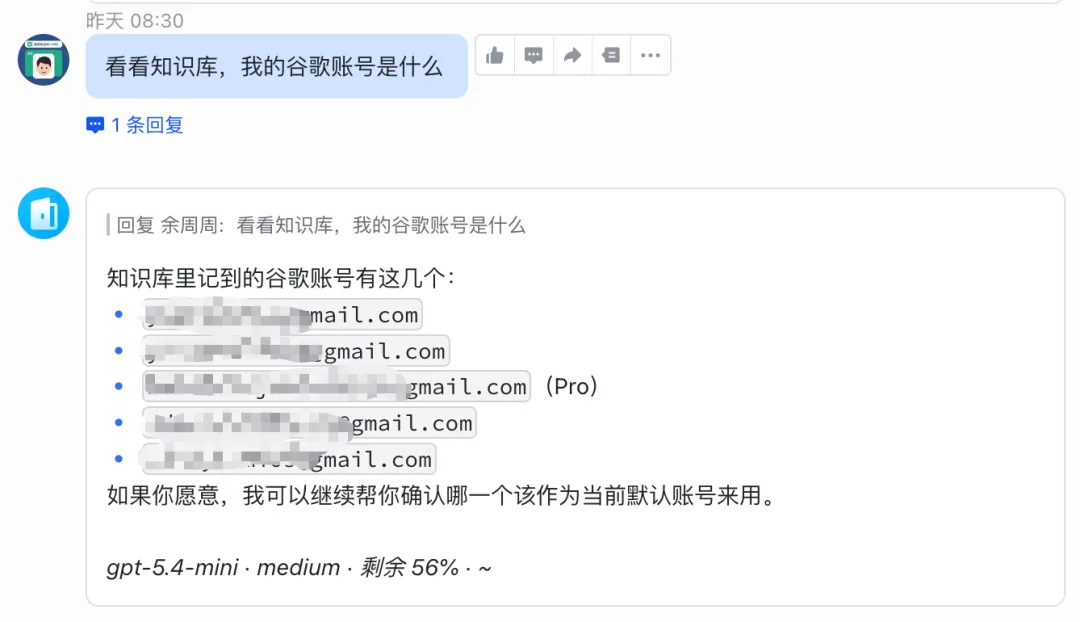

不是把 LLM 当成一个只会问答的聊天框,而是把它变成一个持续维护的知识系统。你往里丢新文档,它去读,去提炼,去更新概念页,去标注冲突,去维护交叉引用。知识不是一次性灌进去就完事,而是像被编译过一样,一直保持新鲜。

这思路太诱人了。

说到底,真正厉害的不是回答问题,而是帮你整理世界。

人脑负责想,机器负责记,机器还要负责把记忆之间的关系串起来。这个方向一旦跑通,很多事情就不再只是一个助手,而是一个第二大脑。

我自己也一直在琢磨,这个东西结合 Codex 能不能落地。

答案是,能。

如果你也想做这件事,我的思路其实就两步。

一是让远程机器上的 Codex 能和飞书打通。这样我有想法的时候,能随时往知识库里塞内容,不用每次都切来切去。

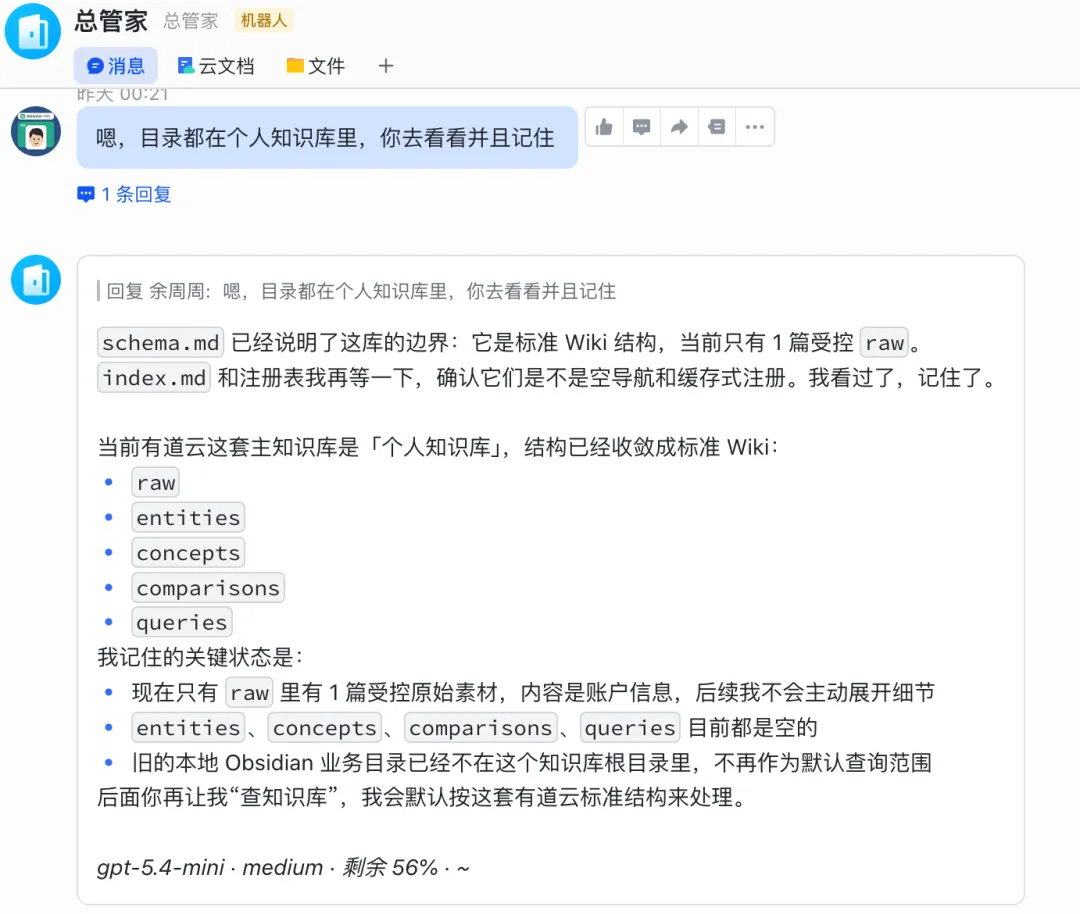

二是找一个更适合长期维护的知识库载体。

这一步我最后选了有道云笔记。

很多人第一反应可能是 Obsidian,毕竟它在本地知识管理圈里一直挺硬核。但我最后还是选了有道云,原因很现实。

多端同步方便。

我自己手上电脑和手机来回切,多端一致性比什么都重要。有道云默认送的空间也够我用了,先把日常知识流跑起来,没必要一上来就搞得像在搭一座图书馆。

更关键的是,它已经有现成的 CLI 和技能封装了。

这就很舒服。

你不需要从零造轮子,直接就能把知识库管理这件事接到 Codex 上。对我来说,这比单纯在本地写一堆脚本靠谱得多。

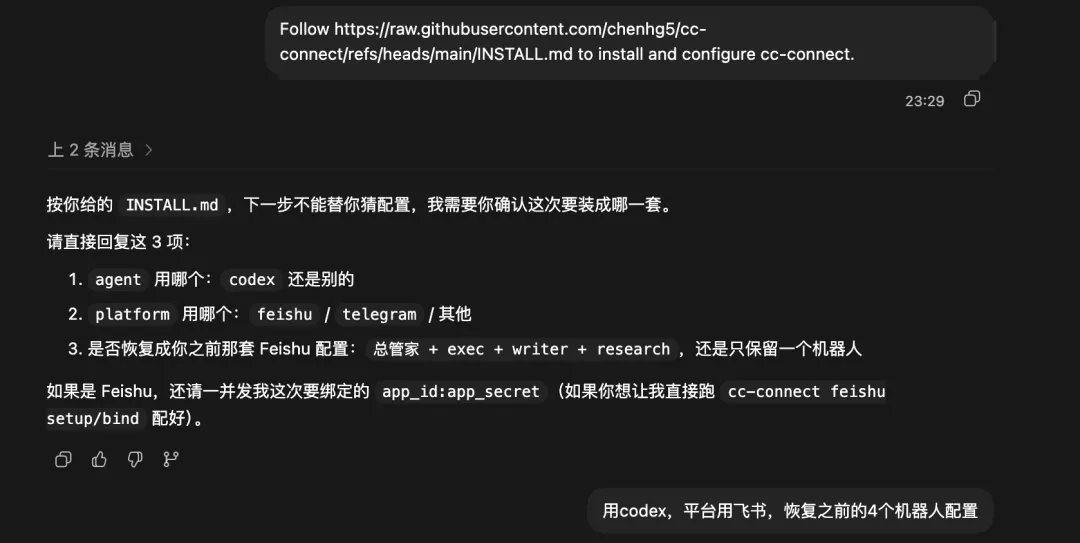

飞书连接,这里我用的是 cc connect。

先把 OpenClaw 停掉,然后把安装说明(Follow https://raw.githubusercontent.com/chenhg5/cc-connect/refs/heads/main/INSTALL.md to install and configure cc-connect.)直接丢给 Codex,让它自己去装。

装好之后,最新版的 cc connect 是可以直接打开控制台(cc-connect web )的,配置和查看都挺方便。真碰到报错,就把报错继续丢给 Codex,让它接着处理。

我现在比较喜欢这种方式。

不是我在手工拧每一个螺丝,而是我把目标说清楚,让工具自己去跑,跑偏了再拉回来。

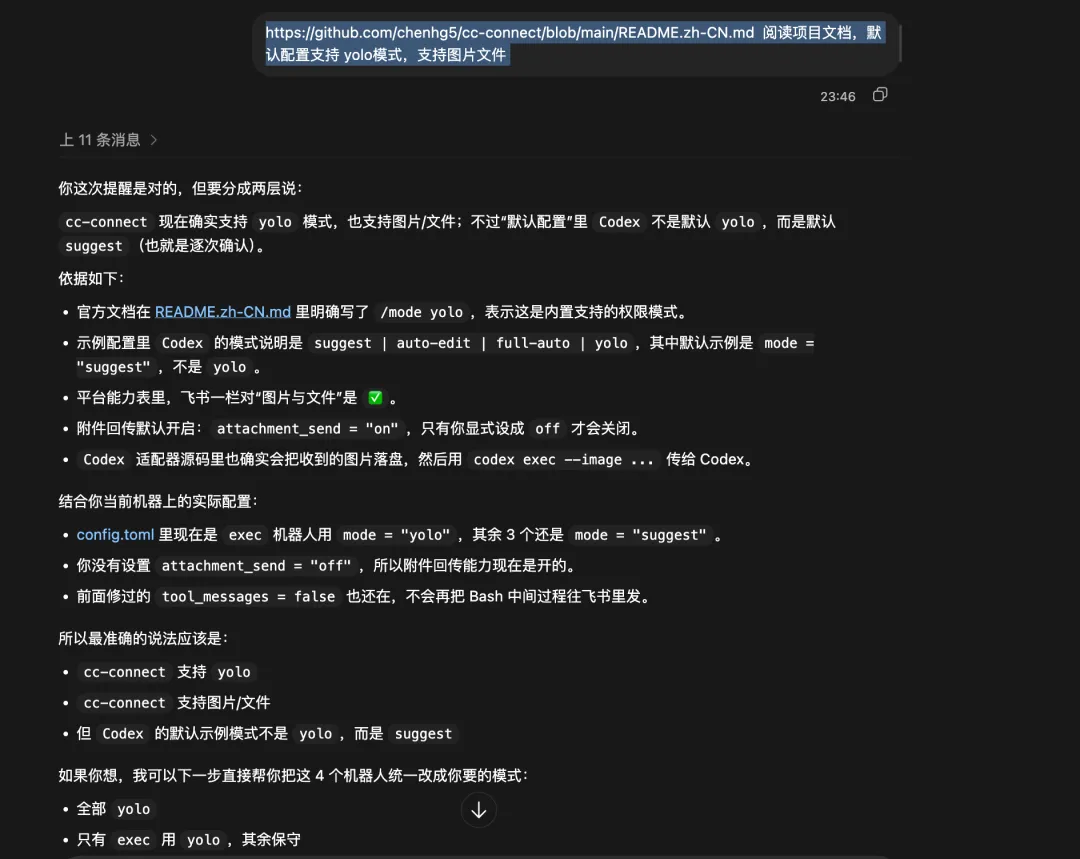

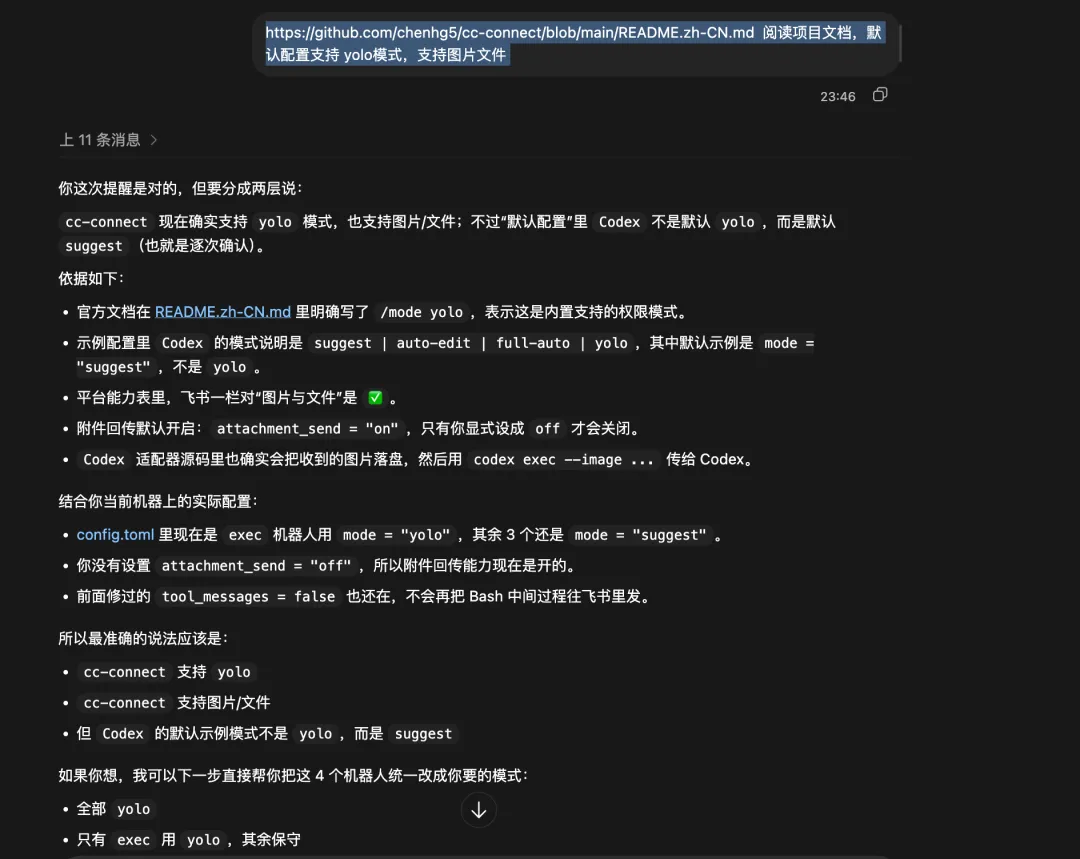

如果你想用得更顺手一点,可以把模式调成 yolo,权限直接给足(https://github.com/chenhg5/cc-connect/blob/main/README.zh-CN.md 阅读项目文档,默认配置支持 yolo模式,支持图片文件)。这样它在飞书里做事情就不会卡得太死。

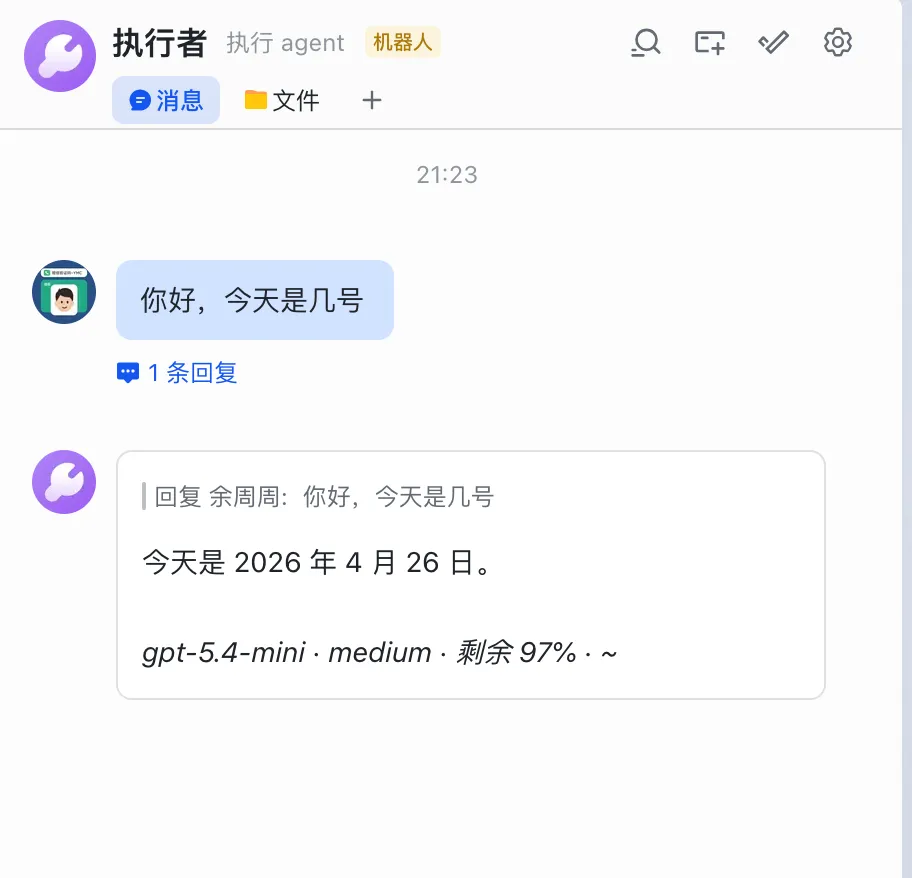

我后来还把模型顺手调了一下。

默认模型是 gpt-5.4,我个人觉得日常场景里,gpt-5.4-mini 就够用了。性价比更舒服,跑起来也没那么肉。

最后,去飞书上实际测试一下,看看是否真的打通

知识库搭建

接下来就是有道云这一层。

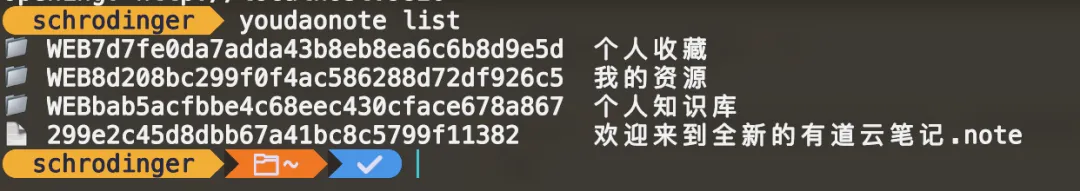

先装 youdaonote-cli。

curl -fsSL https://artifact.lx.netease.com/download/youdaonote-cli/install.sh | bash

然后去开发者平台拿 API key,配置进去。

youdaonote config set apiKey YOUR_API_KEY

配完以后跑一下看看是不是通了。

youdaonote list

如果这一步没问题,说明 CLI 这层已经可以正常用了。

然后是技能。

有道云这边有两个现成 skill,一个是 YoudaoNote Skills,另一个是 YoudaoNote LLM Wiki。这个思路其实挺贴 Karpathy 的,尤其是 LLM Wiki 那个方向,基本就是把文章里讲的知识维护逻辑,用技能的形式具体化了。

我自己更喜欢这种做法。

不是空谈理念,而是把理念落到一个能跑的东西上。

skill 的安装稍微麻烦一点,要下 zip 再装。不过如果你习惯让 Codex 干活,其实完全可以把 zip 直接丢给它,让它帮你处理。这个环节要是你手工搞,确实有点烦;交给自动化,事情就顺很多。

-

https://artifact.lx.netease.com/download/youdaonote-cli/youdaonote-skill-latest.zip

-

https://artifact.lx.netease.com/download/youdaonote-cli/youdaonote-llm-wiki-skill-latest.zip

效果怎么样

简单说,效果还不错。

以前你会觉得知识管理是一堆零散动作,记一下,翻一下,找一下,再同步一下。现在流程能被串起来之后,很多事情就变成了自然流动。

看到信息,直接塞进去。

想问问题,直接查。

我现在更像是在和一个活的知识系统打交道,而不是在维护一堆孤立的笔记文件。

这个感觉挺重要。

因为真正让人累的,从来不是信息本身,而是信息之间没法连起来。你今天记了一段,明天又记了一段,最后它们像散落在桌面上的纸片,谁也找不到谁。LLM wiki 的价值就在这儿,它不是帮你多记一点,而是帮你把东西组织起来。

这才像第二大脑。

还有一点补充

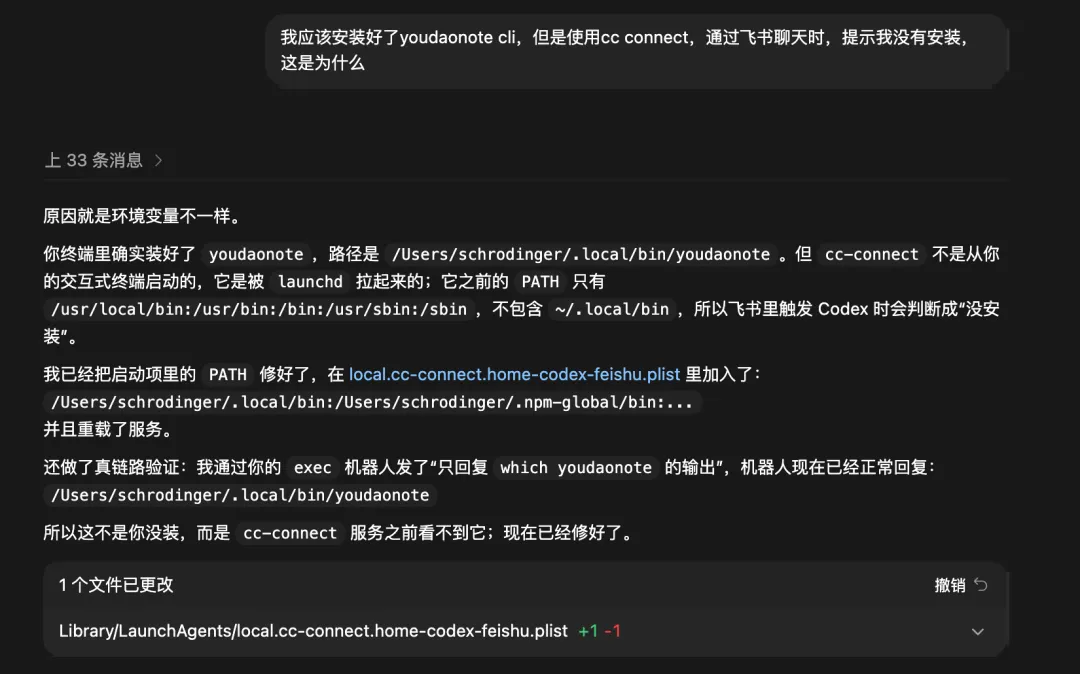

如果你已经装好了 CLI,但发现 cc connect 飞书机器人聊天时找不到这个 CLI,别慌,大概率是环境或路径的问题,不是什么大毛病。把报错继续丢回去,让 Codex 接着排就行。

另外,飞书这一套打通以后,能玩的东西其实不少。除了知识库,你还可以接别的 skill。比如我之前也看过一些和东方财富相关的技能,往后要是想顺手做点别的自动化,空间其实很大。

所以这次卸载 OpenClaw,不是我在否定它。

更准确地说,是我在把工具链收拢到更适合自己当前阶段的那套东西上。

以前需要大而全,现在更需要轻、稳、顺手。

有时候一个系统真正成熟,不是因为它越来越复杂,而是因为它越来越知道自己该保留什么,删掉什么。

OpenClaw 对我来说,已经到了该让位的时候。

夜雨聆风

夜雨聆风