AI算力时代的“四大金刚”:服务器、电源、交换机、光模块全解析

点击蓝字,关注我们

如果问当前科技行业最热门的话题是什么,答案毋庸置疑是人工智能。但大多数人关注的,是GPT-5又进化到什么程度、DeepSeek刷屏了多少次、哪家国产大模型又拿了融资。很少有人会去想:支撑这些AI大模型背后的物理世界,究竟长什么样?

事实上,每一次你在对话框里敲下问题、点击发送,背后都有一整套鲜为人知的硬件系统在飞速运转——AI服务器承担着海量计算任务,服务器电源将电网电力精准投喂给每一颗芯片,交换机在成千上万个GPU之间来回调度数据,光模块则像数字世界的“血管”,让信息以接近光速的速度穿梭于整个数据中心。这四个产品,堪称AI算力时代的“四大金刚”。

AI服务器:算力的“心脏”

用在哪里?

大型互联网公司、云计算服务商、金融和政府机构等都会部署AI服务器来支撑自己的AI业务。从OpenAI训练GPT系列大模型,到国内互联网大厂部署云服务,背后都是成百上千台AI服务器在同时运转。据预测,2026年全球AI服务器出货量增速有望超过28%,市场规模预计将达数千亿美元量级。

用到哪些半导体元器件?

AI服务器是名副其实的“半导体的盛宴”。一台AI服务器中,GPU、DRAM、CPU等核心芯片占据约80%的成本。

CPU:负责逻辑调度和任务分发,代表厂商包括Intel、AMD。

GPU/NPU:最核心的算力单元,负责大规模并行计算。全球市场由NVIDIA主导,其Blackwell架构GB200系列单卡算力已突破3000TOPS;国产阵营中,寒武纪思元590、华为昇腾910C等芯片也正在加速追赶。

HBM高带宽内存:紧贴GPU/CPU封装,提供超高带宽的数据通路,主要供应商包括SK海力士、三星、美光。

PCB印制电路板:承载所有芯片和元器件的基底,随着AI服务器高速信号传输需求激增,对PCB的层数和材料性能也提出了更高要求。

各类被动元器件:如MLCC多层陶瓷电容,用于电源滤波和信号耦合,虽然单价低但需求量巨大。

服务器电源:算力的“供血管道”

服务器电源是将电网交流电转换为服务器GPU、CPU等负载所需直流电的电能转换装置。如果说AI服务器是算力的“心脏”,那电源系统就是连接心脏和电网的主动脉——没有稳定高效的电源,再强大的芯片也只是一堆冰冷的硅片。

用在哪里?

从单台AI服务器到整排GPU机柜,从中小机房到超大规模数据中心。在英伟达GB200 NVL72机柜中,一个机柜的总功耗已突破100kW。

电源系统怎么运转?

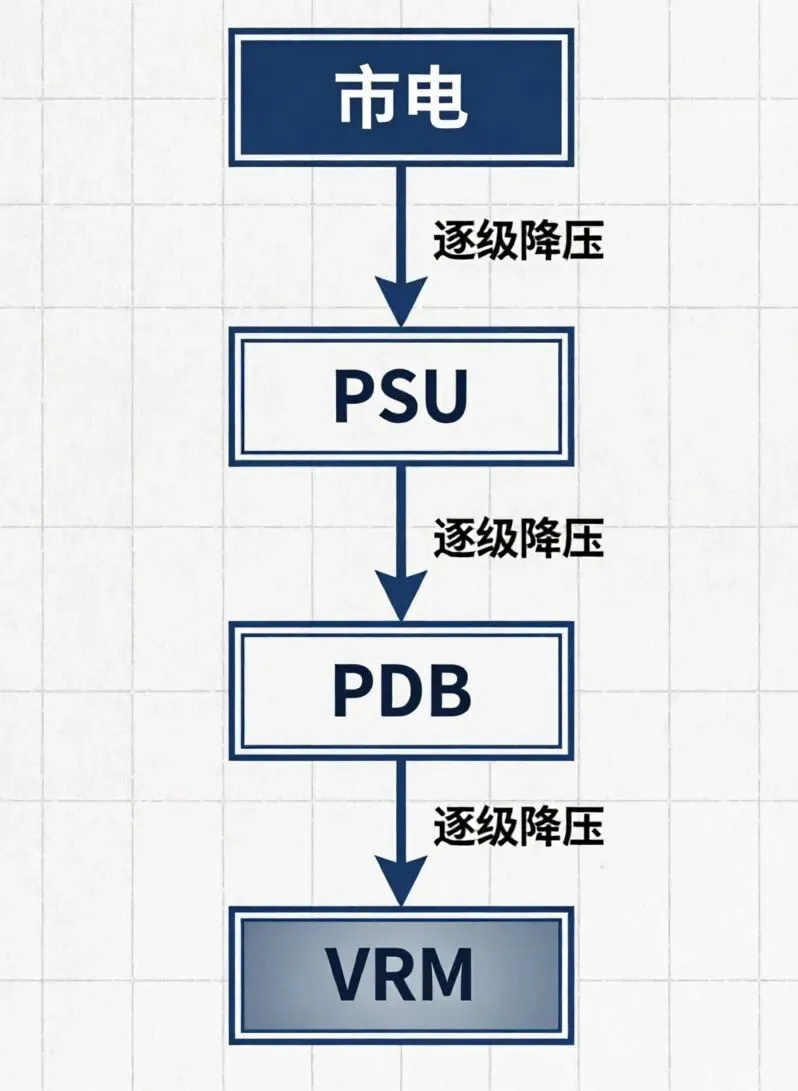

AI服务器的供电体系可以分为三个层级:供电体系(UPS/HVDC/PDU)、AC-DC转换(PSU/PMC/BBU)和DC-DC转换(PDB/VRM)。

简化来看就是一个逐级降压的过程:市电进入机柜后,先由PSU将AC转换为48V直流电;再通过PDB降压到12V;最后由紧贴CPU/GPU的VRM将12V降到芯片工作所需的1V甚至更低电压(约0.8V)。这套架构直接决定了AI数据中心的能源效率和稳定性。

用到哪些半导体元器件?

服务器电源是功率半导体的集中“练兵场”。

功率MOSFET:在电源转换各级电路中担任开关器件,实现电压变换,头部供应商包括Infineon、ON Semiconductor、ST、TI等。

PWM控制器:控制MOSFET的开关频率和时序,保障输出电压稳定。

DrMOS:将驱动IC和功率MOSFET集成在同一封装内,提高功率密度和效率,是当前AI服务器主板级供电的主流方案。国内杰华特已量产90A DrMOS产品,性能处于行业领先水平。

GaN和SiC宽禁带半导体:氮化镓和碳化硅器件具备更高的开关频率和更低的导通损耗,正成为AI电源设计的新宠。48V直流供电与GaN器件的组合,已使电源转换效率提升至97.5%。

PFC、LLC、同步整流等拓扑中的各类控制芯片和隔离器件。

交换机:算力集群的“交通枢纽”

数据中心交换机是高性能的网络设备,负责管理数据中心内外部的庞大数据流量,确保数以万计的服务器之间能以极低延迟、超高速度进行通信。用城市交通来类比:如果把数据中心比作一座城市,那交换机就是城市里最繁忙的路口和立交桥。

所有GPU之间的数据交换——无论是模型训练中的梯度同步、参数传输,还是推理过程中的数据分发——都得经过交换机。AI训练的效果好坏,很大程度上取决于这些交换机处理数据的效率和延迟。

用在哪里?

大型互联网公司、云计算服务商的数据中心内部,以及支撑AI算力集群的专用网络。当前主流架构已从100G/400G快速跃升到800G,并正向1.6T迈进。

用到哪些半导体元器件?

交换机的“灵魂”在于交换芯片。

交换芯片ASIC:这是交换机的核心。它专门负责数据包的快速转发处理,决定了交换机的容量、端口速率和转发性能。博通的Tomahawk 6是全球首款实现102.4 Tbps单芯片交换容量的以太网交换芯片,带宽是前代平台的两倍,单芯片可支持512个200G端口,专为百万级XPU的AI集群设计。Marvell的Teralynx系列也是主要竞争者。此外还有NVIDIA的Spectrum系列交换芯片,主要面向自家的InfiniBand和以太网融合方案。

CPU管理芯片:处理控制平面的任务(如路由协议、设备管理等),通常采用ARM架构或x86架构的嵌入式处理器。

PHY芯片:负责物理层信号的收发与编码/解码,连接交换芯片和光模块或铜缆接口。

NPU/DPU:新型AI交换机开始引入网络专用处理单元,用于卸载和加速数据处理任务,如流量分析、安全防护、智能调度等。

光模块:算力世界的“血管系统”

光模块是一种集成了光电转换功能的设备,能够将电信号转换为光信号发送出去,同时也能将接收到的光信号转换为电信号。它的本质,就是光电信号的“翻译官”——把服务器、GPU产生的电信号转换成光子“射出”,通过光纤传输到另一端后,再还原成电信号供设备处理。

光模块的决定性作用在于:没有它,AI服务器集群内的GPU就无法互联,成千上万颗芯片之间就“无法对话”,算力也就只能在单机范围内打转,无法真正形成集群效应。

用在哪里?

数据中心内服务器与交换机之间的互联、交换机与交换机之间的互连,以及跨机柜、跨集群的长距离数据传输。当今大模型训练中,每颗GPU需要搭配的800G光模块数量已从传统3个提升到8到12个,需求弹性远高于GPU本身。

用到哪些半导体?

光模块内部包含光芯片和电芯片两大类别。

光芯片方面:

激光器芯片:将电信号转换为光信号,主流方案采用DFB/EML激光器,材料以InP磷化铟为主。代表厂商包括Coherent、Lumentum、博通等。

探测器芯片:将接收到的光信号转换回电信号(通常为PIN或APD探测器)。

电芯片方面——被称为光模块的“大脑”:

DSP数字信号处理器:核心芯片,负责高速信号的调制编码、色散补偿等复杂数字处理,以应对高速长距传输中的信号劣化。主要由博通、Marvell设计,台积电代工。

Driver激光驱动芯片:将DSP输出的电信号放大并整形,为激光器提供准确的调制电流,驱动其以特定频率发光。

TIA跨阻放大器:将光电探测器输出的微弱电流信号线性转换成电压信号,供后级电路处理。

MCU/控制器:负责模块的监控管理、温度补偿、DDM数字诊断等功能。

此外,光模块中还集成了不少被动光器件,如隔离器、耦合器、分路器等。

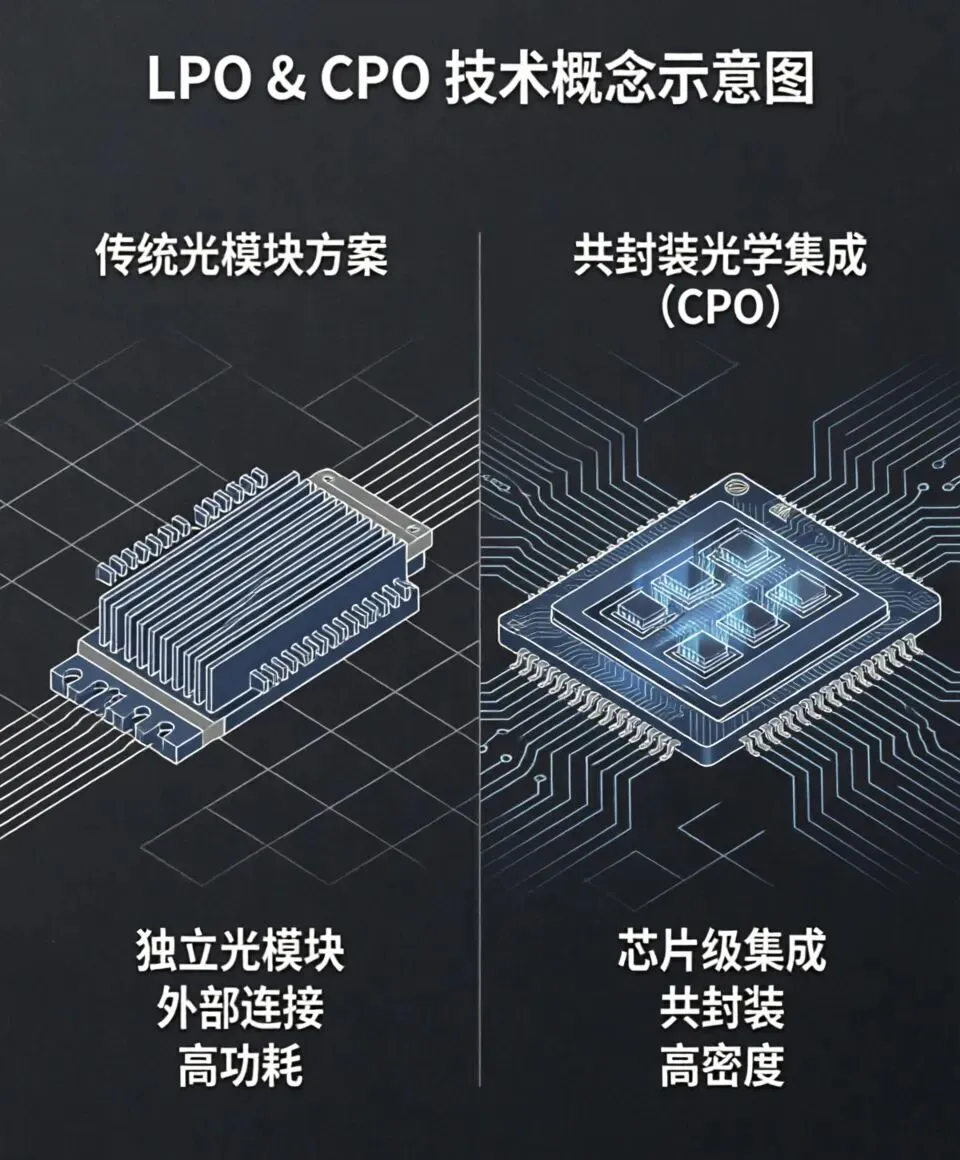

技术变革方向:

LPO线性可插拔光模块正在成为新趋势,它抛弃了能耗较高的DSP芯片,改用线性模拟技术直接驱动光电器件,可显著降低功耗和延迟;而CPO共封装光学技术则将光引擎与交换芯片直接封装在一起,进一步提高系统集成度和能效。

从AI服务器到服务器电源,从交换机到光模块——这四种产品并不是孤立的,它们共同构成了一条完整的AI算力供应链:芯片厂商提供核心算力,电源保障能量供给,网络将零散的算力汇集成千军万马,光模块则让信息以光速穿梭于整个生态系统。任何一个环节掉链子,AI大模型都无法正常运行。

这四大硬件产品背后,又凝结着无数半导体芯片的智慧:GPU和CPU是服务器的大脑,DSP和交换芯片让通信变得智能高效,GaN和SiC等新型器件让供电系统在散热和体积约束下仍然保持稳定。半导体行业的技术革新,正在从各个维度推动AI算力基础设施持续进化。

夜雨聆风

夜雨聆风