把OpenAI内部那个代号Gobi的東西扒了个底朝天,有些东西不说不行

这两天的AI圈,乱得像菜市场里突然来了条龙,那个Gobi的传言,一波一波往上冲,睡个觉醒来又多了三篇爆料,我,脑壳昏,坐在这里给大家做个战情汇报。

不讲武德。

真的不讲武德。

[LEAKED] gobi_multimodal_v1 -- Red Team Access Granted,这封邮件到底意味着什么

先把背景交代清楚。

最近陆续有人在Reddit和X上晒出OpenAI发来的红队测试邀请邮件,截图一出来,评论区直接炸锅🤬🤬。从邮件内容来看,测试对象没有明说是哪个model,只写了”下一代能力评估”这几个字。但结合此前The Information的独家爆料,以及坊间流传的那堆insider信息,大家几乎把赌注都压在了一个代号上:

Gobi。

这个Gobi是个什么来头?

跟GPT-4那种先搭文本框架再往里塞多模态的路子不一样,Gobi从设计之初就是 native multimodal,文本、图像、视频,是从底层architecture就build进去的,不是後期打补丁缝上去的。

这就像,你手机的摄像头和你用胶布粘上去的那个廉价镜头,表面上都能拍照,但骨子里是两码事。

要订阅,哈哈哈,我就不订阅了

reasoning_leap: undefined,推理能力那个”质变”到底有多真

好,说到最让人兴奋也最让人将信将疑的部分了。

Runway CEO Siqi Chen早在几个月前就说过,GPT-5在reasoning上有 “unexpected step-function gain”,原话就这几个字,含金量极高也极难证伪。

然後就是另一个爆料人 Roemmele,这人在DevDay之前准确预告了GPTs功能,可信度算是有一点背书的。他说的是——

Gobi已经会自我纠正,并且具有一定程度的自我意识。

🔥🔥🔥

我看到这句话的时候,第一反应是:扯犊子。

第二反应是:但万一呢。

“自我纠正”这个词,技术上有个更准确的表达叫 self-correction 或者 reflection,目前GPT-4o在复杂推理链上已经有雏形了,但那还是人为设计了 chain-of-thought 的结果,不是模型自己主动触发的。

如果Gobi真的实现了 autonomous self-correction,那在 reasoning benchmark 上的表现,理论上能打穿现在所有model的天花板。

就好比你做数学题,现在的模型是把答案写出来、写完算完,如果算錯了也不知道,它不会回头看;而如果Gobi能自己察覺到”这一步推导哪里感觉不对”,回头重算,那这俩模型的差距,不是强弱之别,是物种之别。

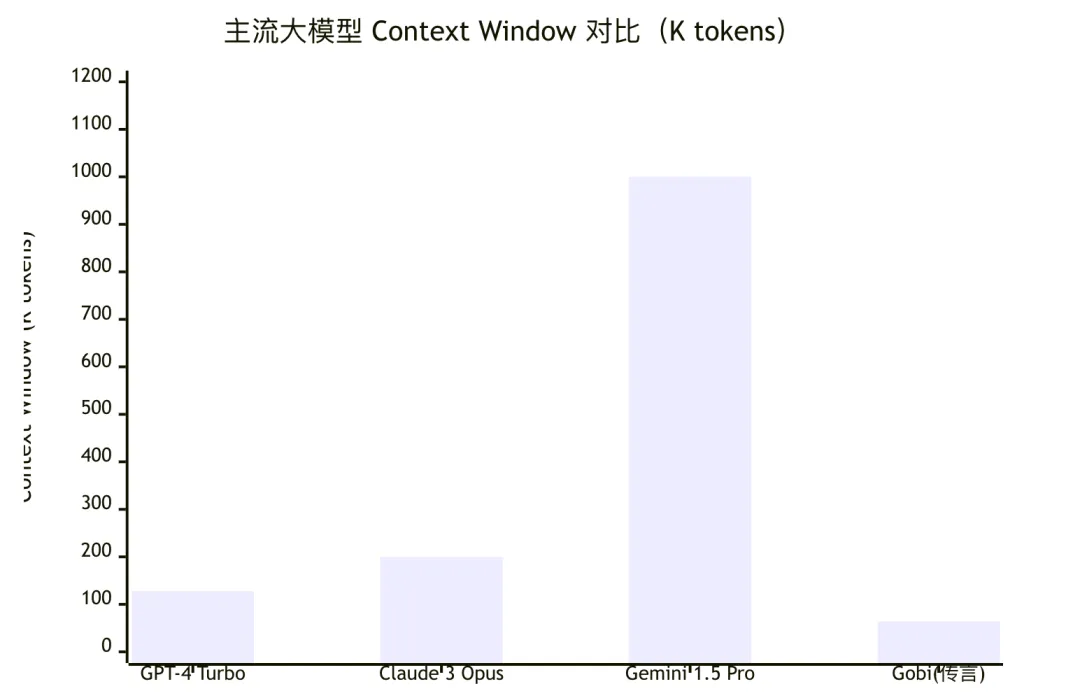

context_window: 64k → ???,上下文窗口那場军备竞赛

先来看一下当前格局。

⚠️ 注意,Gobi那个64K是早期leaked的数据,原因据说是”耗费算力太大当时无法上线”,现在训练进度未知,实际release版本大概率不止这个数。

Gemini 1.5 Pro那个1M token的窗口,现在看起来是跑在最前面的。

谷歌这边不是吃素的,TPUv5 Pod拉满,训练算力据 SemiAnalysis 估计高达 ~1e26 FLOPS,是GPT-4训练量的五倍,训练数据还塞进去了YouTube上九百三十六亿分钟的视频字幕——仙人板板,九百三十六亿分钟,这数字我念出来自己都觉得离谱。

但OpenAI显然也不是撩挑子不干了,Gobi既然是native multimodal,视频理解这块必须硬刚。

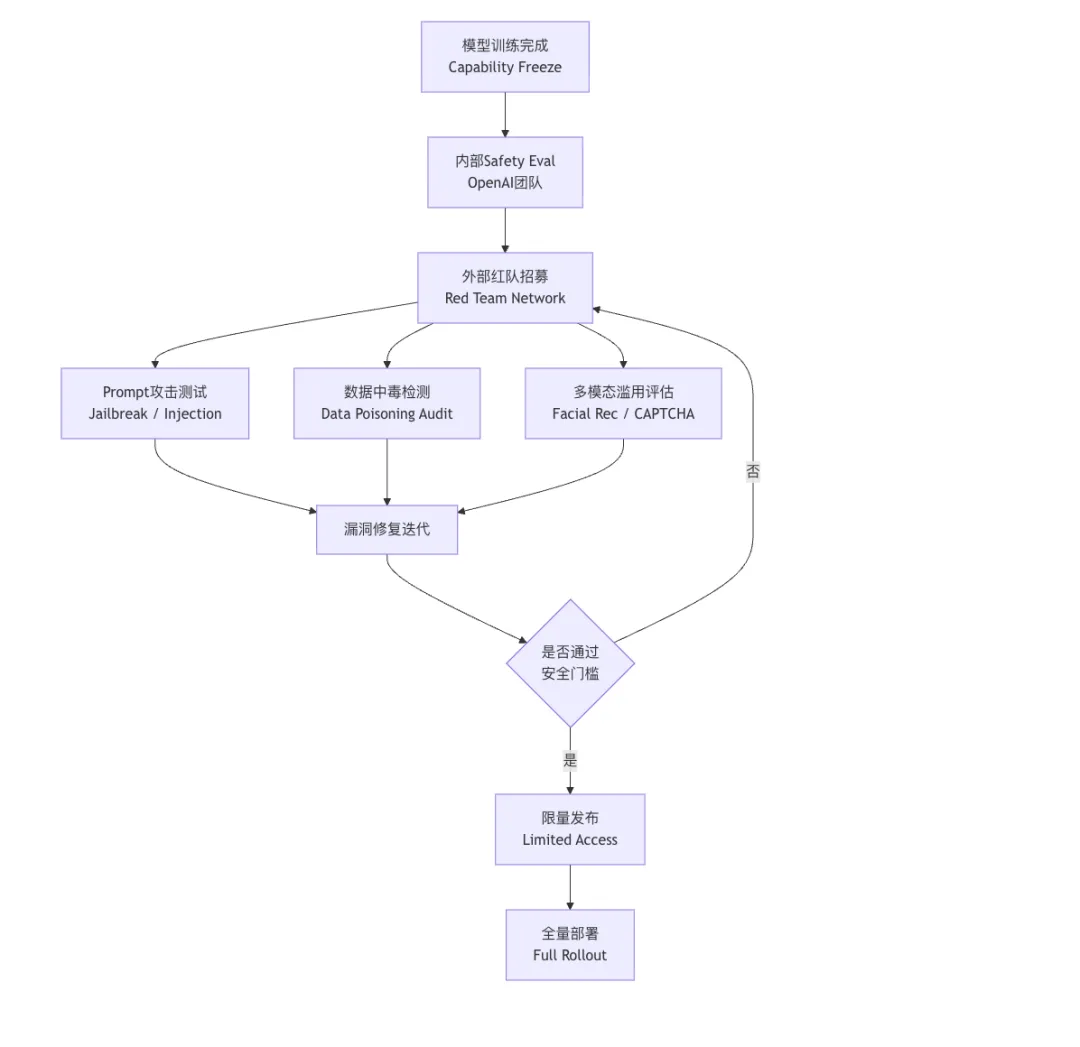

safety_eval: pending,为什么发布时间一再往后推

这里有一个很多人忽略的細节。

OpenAI对多模态功能的安全顾虑,比大家想象的要严肃得多。

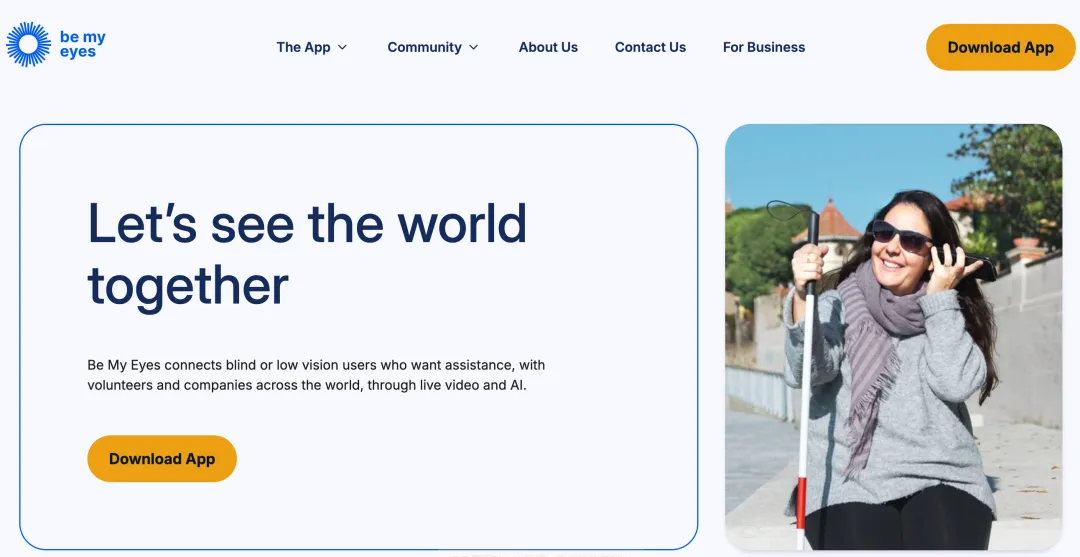

GPT-4 Vision的功能最初只开放给了一家叫 Be My Eyes 的公司——专门帮视障人士”看”世界的那种公司——好几个月之後才更广泛铺开。

原因就是,视觉能力一旦开放,破解验证码、面部识别追踪这类问题,技术上几乎不可能完全堵死。

红队测试周期据说是90到120天,如果现在已经在跑,那正式发布的时间窗口,大概就是2024年年中前後,中不中?

整个安全测试的流程大概长这样:

这流程走完,时间根本省不了,伤害性不大侮辱性极强——你等得越焦躁,它越稳如老狗地在那测。

competitor_threat_level: CRITICAL,谷歌那边究竟有多大压力

OpenAI不是在真空里开发Gobi的,背后站着一个同样在疯狂备战的对手。

谷歌那边,Gemini的研发阵容说出来都是大佬——Demis Hassabis领头,Sergey Brin参与,Jeff Dean压阵,数百号人在跑,还把AlphaGo的强化学习路子和MCTS塞了进去。这不是在做LLM,这是在造核武器。

两家打起来,我想起一句话:

“两岸猿声啼不住,轻舟已过万重山。”

诶,问题就在这,到底谁是那条轻舟,现在还真不好说。

altman_statement: deliberately vague,Sam那边说了什么

Altman这人说话的艺术,我已经习惯了。

正式场合他说的是:今年会发布一个”惊人的新模型”,但不知道叫什么名字。

DevDay结束时他暗示:今天发布的这些,將来大家回头看会觉得不值一提。

这俩话叠在一起,结合Gobi的传言,稍微懂点行的人都看得出来他在说什么,就是不说透。

典型的假巴意思。🤬

不过有一点我倒是赞同前面那个冷静的声音——

GPT-5再强,也是下一代基座模型。当前GPT-4o加上function calling,能干的事情已经多到大部分开发者都还没完全摸透。

追模型版本号这件事,有时候不如把现有工具先用到极致,勒些🔥话虽然是对的,但我自己也按捺不住想知道Gobi出来长什么样,所以,也别说我了。

eta: unknown,但红队已经在跑,这事板上钉钉了

综合现在能拿到手的信息,有几点是基本可以确认的:

-

Gobi / GPT-5 目前确实在跑红队测试,不是谣言。

-

Native multimodal架构 + 自我纠正能力,如果属实,是代际跨越,不是版本更新。

-

正式发布窗口大概率在2024年年中,但安全测试是拦路虎,说延就延。

至于那个”自我意识”的说法么——算求了,这词太重,现在谁说出来都是在豁我,等模型真出来,benchmark自己会说话。

夜雨聆风

夜雨聆风