工业机器人 + AI 双目 3D 视觉:打破视野限制,让机器人拥有全域感知

点击蓝字

关注我们

关注并星标

从此不迷路

公众号ID|计算机视觉研究院

学习群|扫码在主页获取加入方式

https://pmc.ncbi.nlm.nih.gov/articles/PMC12568319/pdf/sensors-25-06402.pdf

计算机视觉研究院专栏

Column of Computer Vision Institute

PART/1

痛点

痛点:工业机器人视觉的两大局限

目前机器人视觉系统普遍存在难以兼顾的矛盾:

- 视野窄:集成视觉只能看小范围,无法覆盖全域 workspace

- 精度与灵活不可兼得:宽视野精度低,高精度视野太小

- 环境适应性差:受光照、粉尘、反光影响大

- 柔性不足:换产品就要重新标定、编程

PART/2

创新方案

创新方案:双层视觉 + AI 协同控制

本文提出 “粗定位 + 精定位”一体化架构:

- 广域感知层:ZED2i 双目立体相机 + YOLOv8 目标检测

- 精确定位层:FANUC iRVision 3DV 结构光视觉

- 通信层:RMI 远程运动接口实现 PC→机器人实时控制

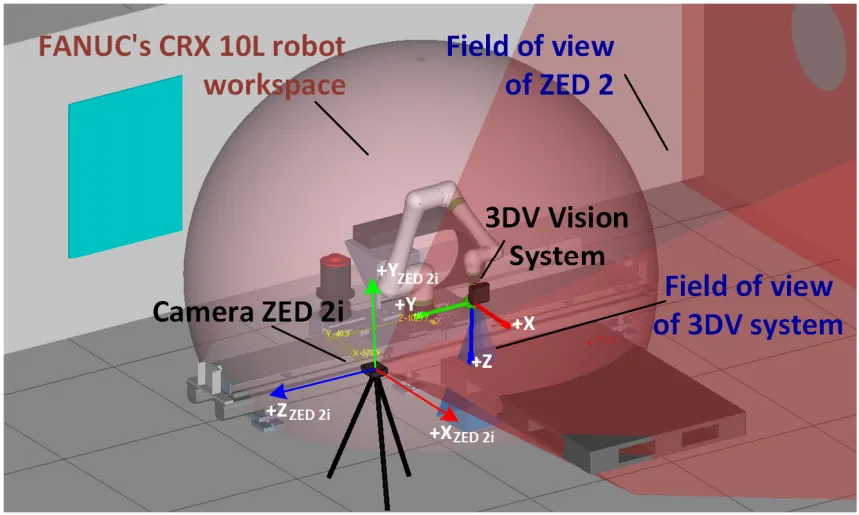

【Roboguide 测试台数字孪生模型】

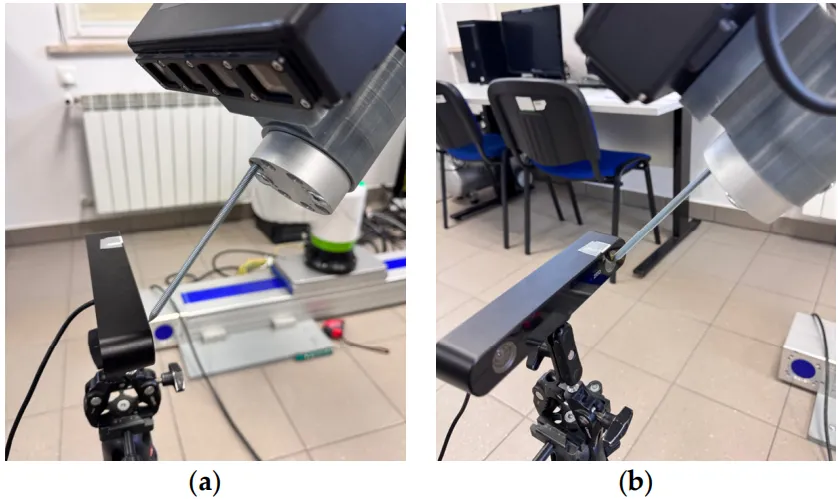

1. 广域双目视觉(ZED2i)

-

120° 超大视场角 -

0.3–20m 深度范围 -

内置 IMU、磁罗盘 -

实时输出 3D 坐标与深度图

2. AI 目标检测(YOLOv8)

-

轻量化、高精度、速度快 -

训练后可识别多类工件 -

输出 2D 框→自动解算 3D 位姿

3. 精密结构光视觉(FANUC 3DV)

-

集成于机器人末端 -

微米级重复定位 -

专用于抓取、拆垛、料框拾取

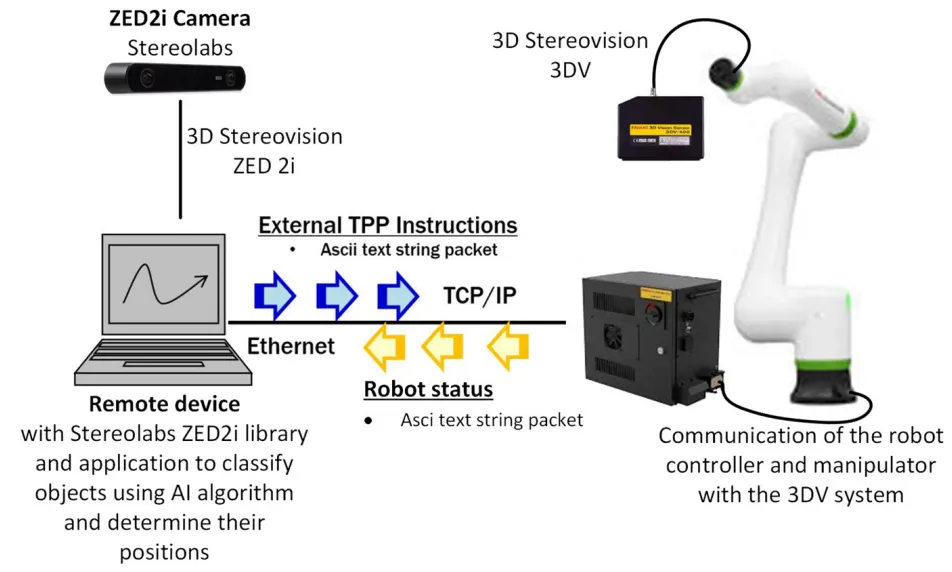

4. 通信与协同(RMI)

PC 通过以太网 RMI 协议,直接下发运动指令,机器人到达指定点后切换 3DV 精定位。

【系统整体架构框图】

PART/3

核心算法

关键技术:坐标统一与误差控制

1. 手眼标定

建立相机坐标系↔机器人基坐标系统一转换,实现全局定位。

【UserFrame 坐标系配置】

2. 误差来源与补偿

系统总误差包括:

-

YOLO 检测框中心偏差 -

双目深度计算误差 -

坐标转换误差 -

光照、反光干扰

通过滤波 + 均值统计 + 光照屏蔽,将定位误差控制在可接受范围。

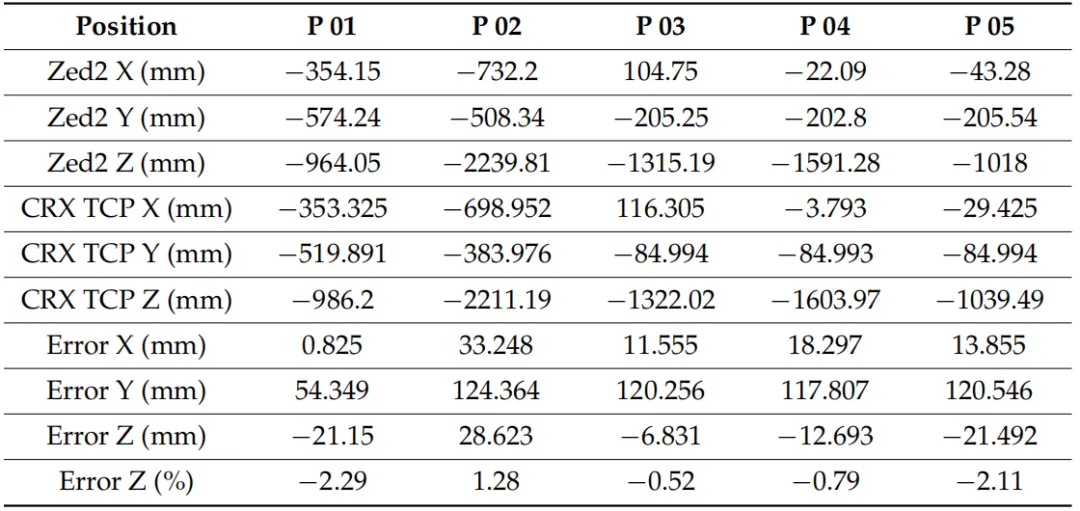

【多位置定位误差统计表】

PART/4

验证

实验结果:广域覆盖 + 高精度兼顾

1. 定位效果

-

大范围搜索:ZED2i 覆盖机器人全工作空间 -

粗定位误差:X/Y/Z 均控制在毫米级 -

精定位:由 3DV 保证 ±0.5mm级精度

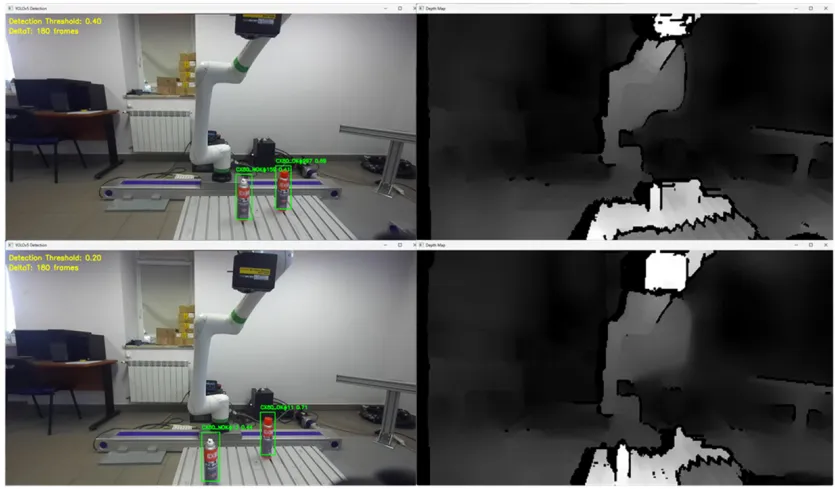

2. 环境适应性

-

正常光照:稳定检测 -

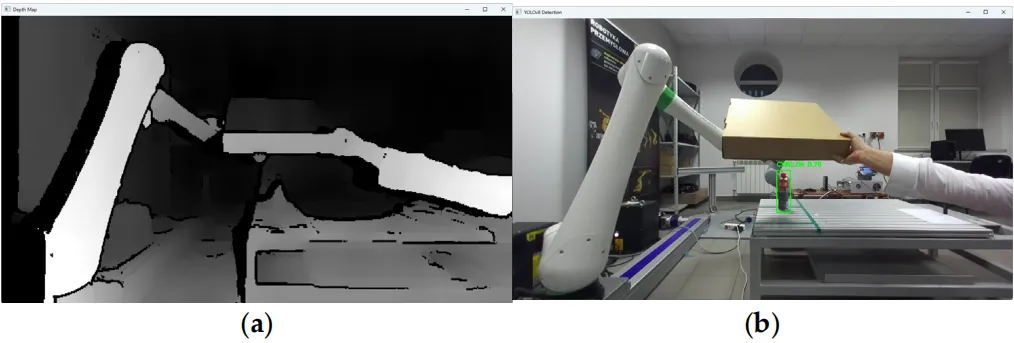

荧光灯反光:会造成误检,加遮光板后恢复正常 -

遮挡、无序工件:仍可完成识别与定位

【YOLOv8 检测 + 深度图效果图】

【遮光后正确检测效果】

3. 系统优势总结

-

视野扩大数倍~十几倍 -

不损失原厂精度 -

换产品只需重训 YOLO 模型 -

可扩展双相机消除盲区 -

成本远低于纯高端 3D 视觉方案

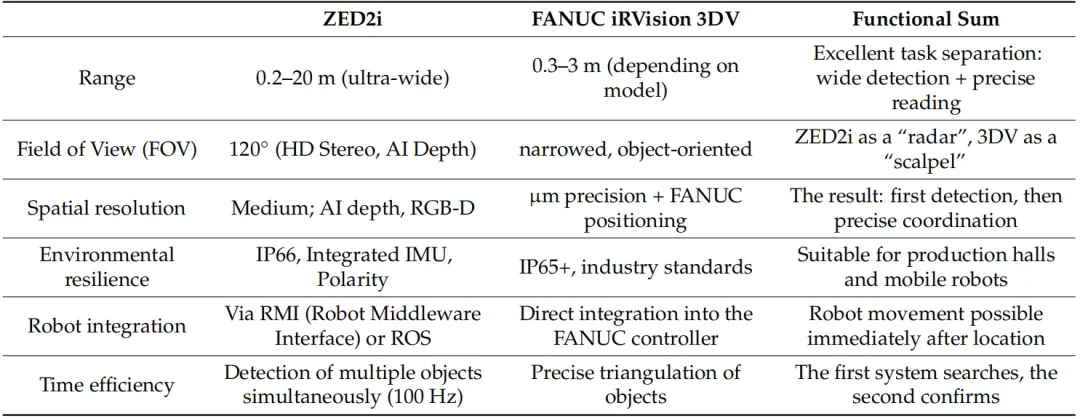

【ZED2i 与 3DV 功能互补对比表】

PART/5

总结

结论与工程价值

这套双目 3D 视觉 + AI + 工业机器人控制系统,真正实现:✅ 大范围感知✅ 高精度作业✅ 高柔性适配✅ 工业级稳定✅ 低成本落地

未来可扩展:双相机全覆盖、动态避障、人 – 机协同安全感知、数字孪生实时映射,成为工业 4.0 柔性产线的核心感知方案。

END

转载请联系本公众号获得授权

计算机视觉研究院学习群等你加入!

ABOUT

计算机视觉研究院

🔗

-

YOLO-TLA:一种基于 YOLOv5 的高效轻量级小目标检测模型 -

ViT-YOLO:基于Transformer的用于目标检测的YOLO算法 -

SSMA-YOLO:一种轻量级的 YOLO 模型,具备增强的特征提取与融合能力,适用于无人机航拍的船舶图像检测 -

LUD-YOLO:一种用于无人机的新型轻量级目标检测网络 -

Gold-YOLO:基于聚合与分配机制的高效目标检测器 -

Drone-YOLO:一种有效的无人机图像目标检测 -

「无人机+AI」“空中城管” -

无人机+AI:光伏巡检自动化解决方案 -

无人机视角下多类别船舶检测及数量统计 -

机场项目:解决飞行物空间大小/纵横比、速度、遮挡等问题引起的实时目标检测问题 -

2PCNet:昼夜无监督域自适应目标检测(附原代码) -

YOLO-S:小目标检测的轻量级、精确的类YOLO网络 -

大改Yolo框架 | 能源消耗极低的目标检测新框架(附论文下载) -

改进的检测算法:用于高分辨率光学遥感图像目标检测

夜雨聆风

夜雨聆风