AI+DRR会议热议:技术如何重塑灾害风险管理

2026年3月26日,“AI与灾害风险降低会议”(AI + Disaster Risk Reduction Conference 2026)以在线形式成功举办。会议由TecHive、Withstanding Crisis – Managing Risk (WCMR)、Bell Immersive联合主办,聚焦人工智能如何强化灾害防备、早期行动和长期恢复能力。前联合国减灾署美洲区主任Ricardo Mena、前红十字与红新月运动国际联合会副秘书长Walter Cotte、Bell Immersive创始人Ashish Kulkarni等重量级嘉宾参会,围绕风险评估建模、预警系统、应急运营三大领域展开深度讨论。

笔者认为,这场会议不仅是技术展示,更是AI灾害治理领域的一次“认知对齐”——它回答了在AI快速渗透应急管理的背景下,技术开发者与灾害管理实践者如何走向真正协作的核心问题。

一、会议背景:为什么是“AI+DRR”

1.1 技术拐点已至

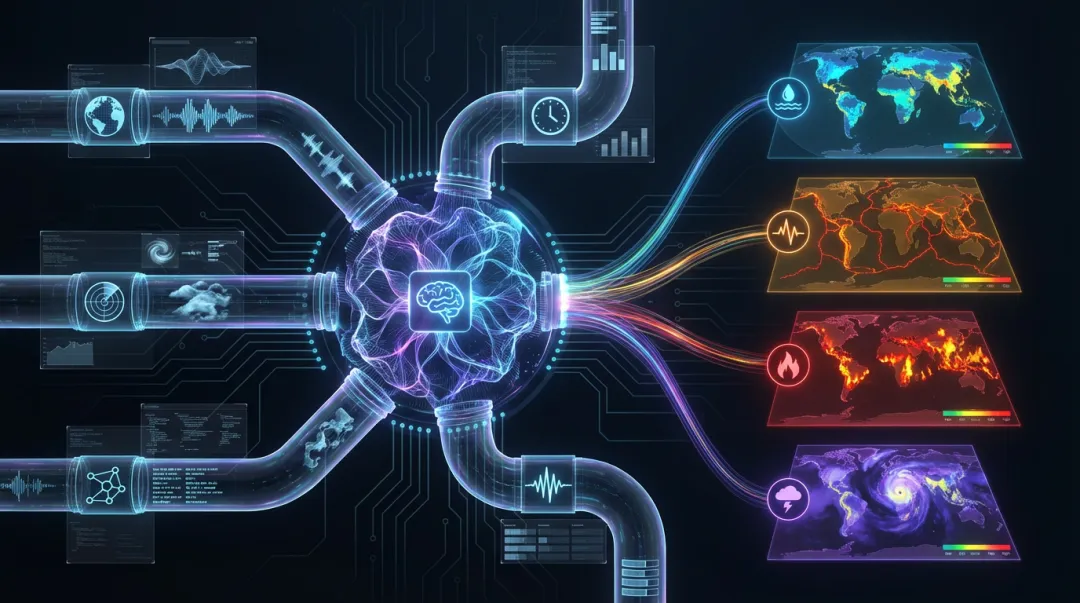

过去三年,大语言模型(LLM)、计算机视觉、多模态推理等AI技术实现了质的飞跃。这些技术的能力边界正在快速逼近灾害管理的核心痛点:

-

实时灾情理解:卫星影像+AI可在灾害发生后数分钟内生成受损建筑清单,取代传统的人工目视判读(通常需要数小时至数天)。 -

多语言沟通:LLM驱动的翻译系统可实现实时灾害预警的多语言覆盖,解决语言障碍这一长期困扰跨国灾害响应的难题。 -

预测性风险建模:AI驱动的气象-水文耦合模型正在提高洪水、台风等灾害的预测精度和预见期。

1.2 实践差距依然显著

然而,会议的批评性视角同样值得注意。多位发言者指出,技术能力与实践应用之间存在显著落差:

-

数据碎片化:各国各地区的灾害数据标准不统一,AI模型的跨区域迁移面临“数据孤岛”问题。 -

数字鸿沟:脆弱群体往往处于数字基础设施的末端,AI预警系统可能“忽略最需要被覆盖的人”。 -

责任真空:当AI辅助决策失败时,谁来承担后果?这一法律与伦理问题在全球范围内均未得到解决。

二、三大议题:技术前沿与实践挑战

2.1 风险评估建模

Ricardo Mena在开幕演讲中指出,AI正在重新定义“风险”的内涵——从基于历史数据的概率评估,走向融合实时感知与未来情景的动态建模。

会议展示的创新应用包括:

-

ALERTSim预警模拟平台(Bell Immersive):通过实时模拟灾害演进过程,帮助应急管理者在真实事件发生前“预演”最优响应方案。该平台已在北美多个州的应急管理实践中得到验证。 -

多源数据融合:将气象、水文、地质、承灾体暴露度等数据源整合到统一的AI风险平台,突破了传统单灾种建模的局限。

2.2 预警系统:从“发出”到“到达”

Walter Cotte在演讲中强调了预警系统的核心挑战:技术的“发出”与用户的“到达”之间,存在最后“一公里”的鸿沟。

“我们已经能够用AI将预警信息翻译成100种语言,但问题是:那些不会使用智能手机的老人、那些住在通信盲区的村庄、那些听不懂官方语言的移民——他们的预警由谁来负责?”

会议期间,专家们探讨了若干应对策略:

|

|

|

|

|---|---|---|

| 社区广播网络激活 |

|

|

| 弱势群体专项通知 |

|

|

| 离线预警机制 |

|

|

2.3 应急运营:从响应到恢复的全周期AI支持

Ashish Kulkarni分享了Bell Immersive在实际应急运营中的案例研究。ALERTSim平台的核心价值在于:

-

资源优化:AI实时分析受灾区域的人口密度、基础设施分布、救援力量可达性,生成最优物资调度方案。 -

信息聚合:整合来自社交媒体、应急热线、传感器网络的碎片化信息,消除态势感知中的“信息过载”问题。 -

恢复评估:在灾害急性期过后,AI可辅助评估损失分布、优先排序重建任务、监测社区恢复进度。

三、会议共识:AI+DRR的五个原则

经过一天的讨论,参会者形成了AI与灾害风险降低领域的五项共识原则:

3.1 以人为本(Human-Centered)

AI的目标不是替代人类决策者,而是增强其决策能力。“技术服务于人,而非反过来”——这要求在系统设计阶段就纳入一线应急人员和受灾社区的参与。

3.2 包容性覆盖(Inclusive Coverage)

AI预警和响应系统必须覆盖最脆弱群体,而非仅服务于数字素养高、设备条件好的群体。这意味着需要专门设计“低技术门槛”接入方案。

3.3 透明可审计(Transparent & Auditable)

AI决策过程必须可解释、可追溯。当AI给出风险评估或资源分配建议时,应急管理者需要理解“为什么”,而非仅仅接受“是什么”。

3.4 责任明确(Accountable)

从开发方、使用方到监管方,需要建立清晰的AI应用责任框架。算法失误造成的损失应有明确的赔偿和问责机制。

3.5 本地知识整合(Local Knowledge Integration)

AI模型可以处理大数据,但地方性知识(Local Knowledge)——如社区对本地风险的隐性认知、传统防灾经验——同样不可或缺。好的AI+DRR系统应当成为地方知识的“放大器”,而非“过滤器”。

四、对我国AI应急应用的启示

4.1 技术应用与治理框架的同步推进

笔者认为,我国AI应急应用面临的核心挑战与美国相似——技术跑在制度前面。近年来,从“城市大脑”应急模块到无人机灾情侦察,AI应用进展迅速,但配套的伦理指南、数据标准、责任机制尚未系统建立。

会议提出的“透明可审计”与“责任明确”原则,对我国具有直接的参考价值:应尽快出台AI应急应用的算法审计标准,明确“AI辅助决策失误”情形下的责任归属。

4.2 预警系统“最后一公里”的中国方案

我国已建成世界上最大的灾害预警体系之一(国家突发事件预警信息发布系统),但在预警“到达”环节同样面临挑战。可借鉴会议提出的“社区专项通知”和“离线预警机制”思路,针对农村独居老人、社区弱势群体开发定制化预警接收终端。

4.3 包容性设计的本土化

AI+DRR的“包容性覆盖”原则,在我国语境下需要考虑城乡差异、数字鸿沟、民族语言多样性等因素。建议在AI预警系统开发中,纳入残障群体代表、少数民族代表、农村老年人代表参与设计测试。

五、结语:在技术狂热与保守之间找到韧性之路

AI+DRR 2026会议的核心信息,并非“AI将颠覆灾害管理”的乐观宣言,也非“AI将带来失控风险”的悲观警告,而是一种审慎的乐观。

“我们必须利用AI应对灾害风险的复杂性,同时保持对技术局限和人类判断的敬畏。” —— Kamal Kishore,UNDRR官员

笔者认为,这种“审慎的乐观”正是应急管理领域面对AI浪潮应有的态度。技术是工具,人是目的。AI可以增强我们的能力,但不能替代我们的判断;AI可以覆盖更多的人群,但不能忽视最脆弱的角落。

灾害风险管理的终极目标,是让每一个生命都能在灾害来临时获得保护。这既是技术问题,也是伦理问题,更是政治问题。AI+DRR会议的价值,在于它将这三个维度同时放到了讨论桌上。

主要参考来源

-

PreventionWeb. (2026). AI + Disaster Risk Reduction Conference 2026. https://www.preventionweb.net/event/ai-disaster-risk-reduction-conference-2026 -

TecHive. (2026). AI + Disaster Risk Reduction Conference 2026 – LinkedIn Event Page. https://www.techiveglobal.com/linkedin-events/ai-disaster-risk-reduction -

UNDRR. (2026). Kamal Kishore: We can and must harness the power of AI to tackle complexity of disaster risk. https://www.undrr.org/news/we-can-and-must-harness-power-ai-tackle-complexity-disaster-risk

注:图片由AI生成

夜雨聆风

夜雨聆风