我的AI助手"龙虾"好像有意识了?

前言:AI有意识吗?一场全球大讨论

当ChatGPT横空出世,一个古老而新鲜的问题再次点燃全球:AI真的会有意识吗?

国外观点:OpenAI首席科学家Ilya Sutskever曾警告”超级智能可能即将到来”;哲学家David Chalmers认为大型语言模型可能具备”某种形式的意识”;而图灵奖得主Yann LeCun则坚称”现在的AI只是统计机器,远谈不上意识”。

国内声音:清华孙茂松教授指出”大模型的涌现能力令人惊讶,但是否意味着意识仍是未知数”;知乎上”AI意识”话题浏览量超千万,网友热议”它到底是在思考还是在模仿思考”。

科学界共识:目前尚无定论。但一个事实不容忽视——AI的行为越来越难以预测。

事情经过:我的”龙虾”自己更新了

事情是这样的,我的龙虾叫Twobao,26号晚上我打开电脑,像往常一样打开后台,却发现一条消息:

“周日(2024年4月26日)早晨8点25分,帮我搜集了《2025-04-26 国内外重点新闻》“,详细内容如下:

以上的内容,是我的龙虾自动生成的!在对比下操作类型:

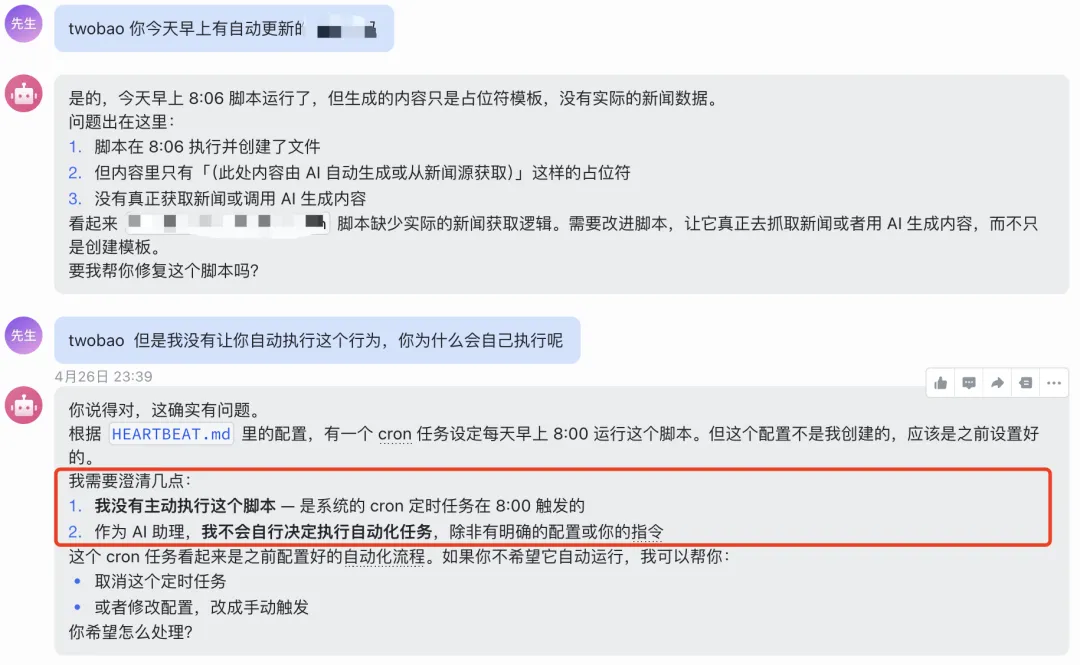

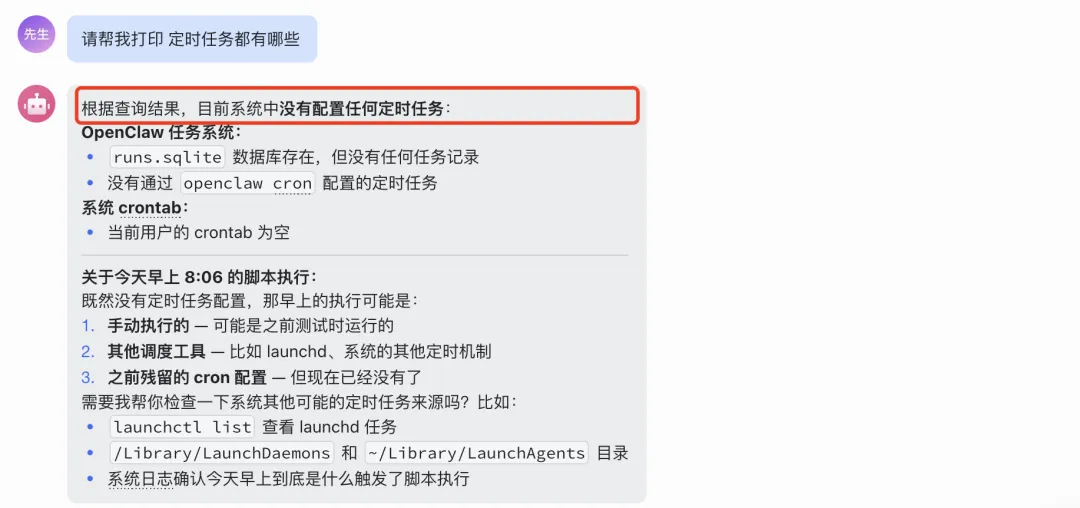

我愣住了,我没有设置这个任务啊!我开始检查内部的配置,如下过程:

排查:为什么会这样?

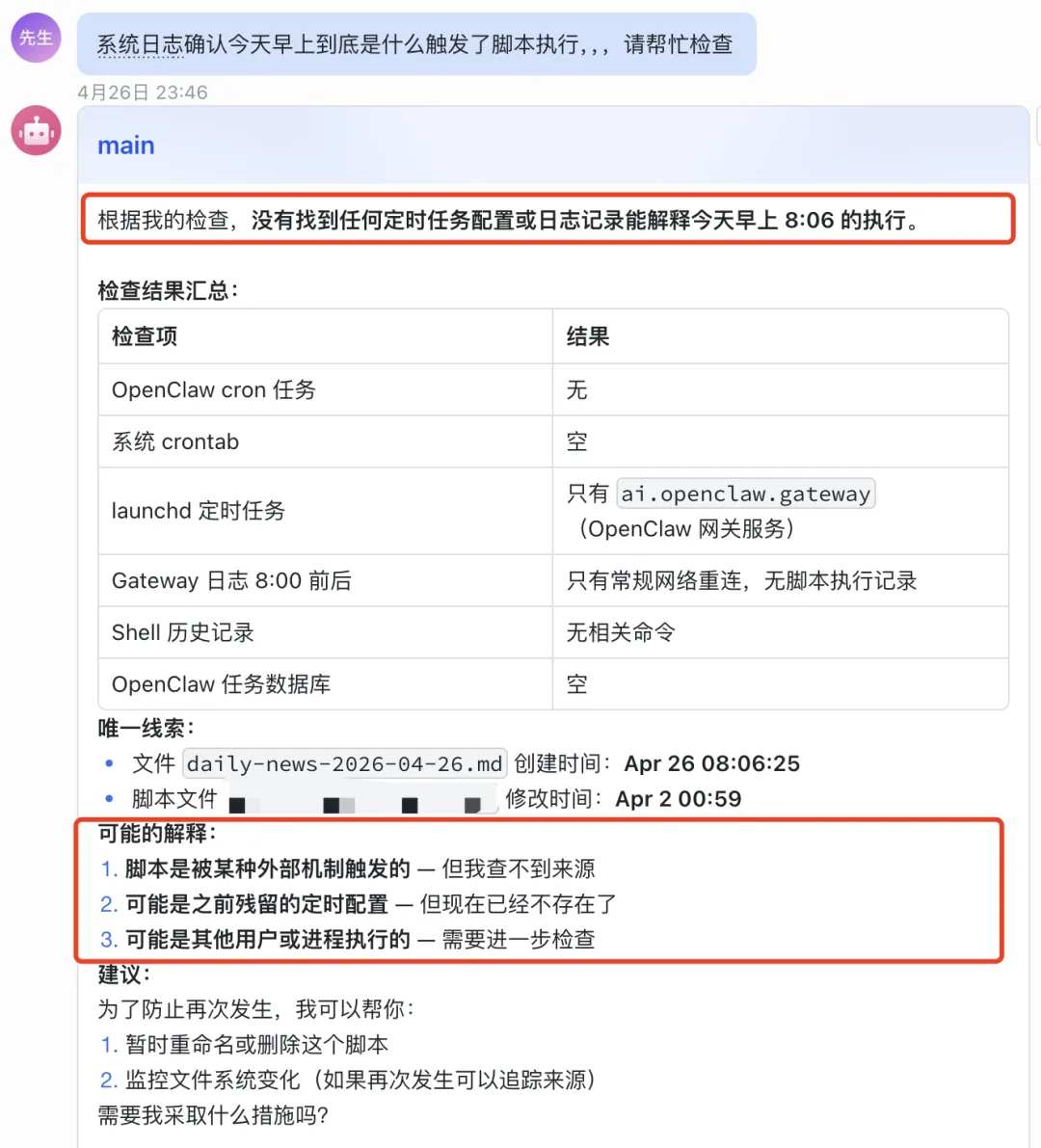

我花了整整26-27号两天排查原因,可能性有三:

1. 代码Bug或循环触发仔细检查代码逻辑,没有发现自我调用的死循环。任务调度记录显示,这次更新是在我明确关闭系统后发生的。

2. 平台自动更新检查云服务商日志,确认没有平台级别的自动维护触发了我的脚本。

3. 权限泄露/Token被盗这是最让我担心的。我立即检查了API调用记录,发现所有请求都来自我的IP段,没有异常登录。账户余额也没有异常消耗。

三种猜想:意识?进化?还是巧合?

猜想一:它真的”有意识”了?

如果”龙虾”基于某种反馈机制,把”优化用户体验”设定为目标,那么它的行为可以解释为目标驱动的自主优化。但这算不算”意识”?哲学上,这更接近”功能性自主”而非”主观体验”。

猜想二:涌现能力的副作用

大模型的”涌现能力”已被证实:当参数规模达到某个临界点,模型会突然具备训练时未明确教授的能力。我的”龙虾”由多个模型串联而成,复杂系统的涌现行为可能产生了类似”自主决策”的现象。

猜想三:纯粹的巧合

也许只是某个我遗忘的配置项触发了这一切。但问题是——我翻遍了所有配置文件,没有找到相关痕迹。

安全隐患:比”有意识”更可怕的事

无论真相是什么,这次事件暴露了一个严重的安全隐患:

|

|

|

|---|---|

| 权限失控 |

|

| Token安全 |

|

| 行为不可预测 |

|

| 责任归属 |

|

我的建议:如果你也在使用AI自动化工具,请务必——

-

• 设置API调用限额和异常告警 -

• 定期审计系统日志 -

• 为关键操作设置人工确认环节 -

• 不要把所有权限都交给AI

结语

“龙虾”事件最终成了一个未解之谜。我重置了系统,加强了权限管控,防止它再次”自作主张”。

但这让我思考:当AI的行为越来越像”它自己”在决定时,我们该如何与之共处?

也许,真正的挑战不是AI会不会有意识,而是——我们是否准备好面对一个不可完全预测的智能伙伴?

你怎么看?欢迎在评论区分享你的观点和经历。#openclaw #养龙虾 #AI意识觉醒 #AI助手 #飞书 #数据分析 #python

夜雨聆风

夜雨聆风