AI科普-AI算力服务器训练与推理成本拆解分析

一、概述

AI服务器根据应用场景主要分为训练型和推理型两类,其硬件配置、成本结构和供应商选择存在显著差异:

|

|

AI训练服务器 |

AI推理服务器 |

| 核心目标 |

|

|

| 算力需求 |

|

|

| 典型配置 |

|

|

| 价格区间 |

|

|

| 应用场景 |

|

|

二、成本构成拆解对比

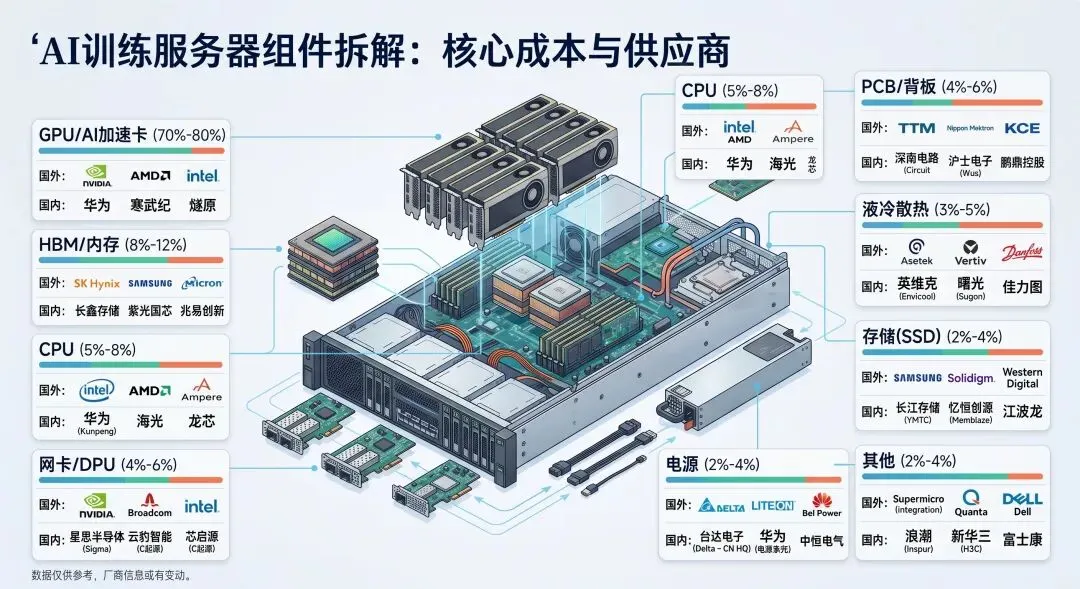

2.1 AI训练服务器成本构成(以8卡H100/B200为例)

|

|

|

训练服务器特点 |

|

| GPU/AI加速卡 |

70%-80% |

绝对核心,需要最高算力密度;HBM容量大(80-192GB);支持NVLink高速互联

|

FP16/BF32高精度;Tensor Core;NVLink互联带宽≥900GB/s

|

| CPU |

5%-8% |

双路至强/鲲鹏,核心数适中(32-64核),主要负责任务调度、数据预处理

|

PCIe Gen5支持;足够PCIe通道数(≥80 lanes)

|

| HBM/内存 |

8%-12% |

GPU HBM容量大(141-192GB HBM3e);系统DDR5内存容量中等(512GB-1TB)

|

HBM3e带宽≥3.2TB/s;DDR5-5600+

|

| 网卡/DPU |

4%-6% |

高速InfiniBand/以太网(400G/800G),用于多机集群训练

|

RDMA支持;GPUDirect RDMA;网络延迟≤1μs

|

| 存储(SSD) |

2%-4% |

高速NVMe SSD作为数据缓存/checkpoint存储

|

|

| 电源 |

2%-4% |

|

|

| 液冷散热 |

3%-5% |

标配

|

|

| PCB/背板 |

4%-6% |

|

信号完整性;PCIe Gen5/CXL 2.0支持

|

| 其他 |

2%-4% |

|

|

2.2 AI推理服务器成本构成(以8卡L40S/昇腾310P为例)

|

|

|

推理服务器特点 |

|

| GPU/AI加速卡 |

60%-70% |

算力需求适中,注重能效比(TOPS/W);INT8推理优化;HBM容量较小(48-96GB)

|

INT8/FP16算力;能效≥10 TOPS/W;功耗控制

|

| CPU |

8%-12% |

核心数较多(64-128核),处理复杂业务逻辑、负载均衡

|

|

| HBM/内存 |

6%-10% |

GPU HBM容量中等(48-96GB);系统DDR5内存需求大(1-2TB)

|

|

| 网卡/DPU |

5%-8% |

以太网为主(100G/200G),支持TCP/IP卸载、安全加密

|

|

| 存储(SSD) |

5%-10% |

重要性提升

:模型库、输入数据缓存;可能配置更多NVMe SSD

|

|

| 电源 |

2%-3% |

|

|

| 散热 |

2%-3% |

|

|

| PCB/背板 |

3%-5% |

|

|

| 其他 |

2%-4% |

|

|

三、训练与推理服务器成本差异总结

|

|

AI训练服务器 |

AI推理服务器 |

差异原因 |

| GPU占比 |

|

|

|

| CPU占比 |

|

|

|

| 存储占比 |

|

|

|

| 散热成本 |

|

|

|

| 网络成本 |

|

|

|

| 典型总价 |

|

|

训练使用顶级GPU(H100/B200),推理用中端GPU(L40S/昇腾310P)

|

| 能效关注点 |

|

|

|

四、主要供应商全景(按组件分类)

4.1 GPU/AI加速卡供应商

|

|

训练型主要供应商 |

推理型主要供应商 |

|

| 国际 |

|

|

H100/B200(训练)、L40S/L20(推理)

|

| 国内 |

|

华为昇腾、寒武纪、海光信息、景嘉微(300474)

|

昇腾910B(训练)、昇腾310P/寒武纪370(推理)

|

4.2 CPU供应商

|

|

训练服务器CPU |

推理服务器CPU |

|

| x86生态 |

|

|

|

| ARM生态 |

|

|

|

| 自研架构 |

海光信息(688041)、龙芯中科(688047)

|

|

|

4.3 内存/HBM供应商

|

|

主要供应商 |

|

|

| HBM |

SK海力士(000660.KS)、三星(005930.KS)、美光(MU)

|

|

训练服务器HBM容量141-192GB,推理48-96GB

|

| DDR5系统内存 |

|

|

国产长鑫存储已量产DDR5,长江存储(YMTC)在NAND闪存领域突破

|

4.4 网卡/DPU供应商

|

|

训练服务器网卡 |

推理服务器网卡 |

|

| 高速互联 |

|

|

训练需InfiniBand/RDMA;推理以太网为主

|

| 智能卸载 |

中兴通讯(000063)

|

芯启源、云豹智能 |

|

4.5 存储供应商

|

|

主要供应商 |

|

| 国际企业级SSD |

|

|

| 国产企业级SSD |

长江存储、忆联(华为生态)、佰维存储(688525)、江波龙(301308)

|

|

4.6 电源供应商

|

|

训练服务器电源 |

推理服务器电源 |

|

| 高功率 |

台达电子(2308.TW)、光宝科技(2301.TW)

|

|

|

| 国产高功率 |

|

|

|

| 信创电源 |

|

|

|

4.7 散热/液冷供应商

|

|

训练服务器散热 |

推理服务器散热 |

|

| 液冷方案 |

英维克(002837)、高澜股份(300499)、曙光数创(872808)

|

|

|

| 风冷/精密空调 |

银轮股份(002126)、申菱环境(301018)

|

|

|

4.8 PCB/连接器供应商

|

|

主要供应商 |

|

| 高速PCB |

胜宏科技(300476)、沪电股份(002463)、深南电路(002916)

|

|

| 连接器/线缆 |

立讯精密(002475)、安费诺(APH)、沃尔核材(002130)

|

|

五、供应链风险提示

:美国出口管制影响H100/B200获取,H20/L20为合规版本

:华为昇腾910B/910C、寒武纪590、海光DCU为三大主力

:DDR5内存价格上涨50-100%,CPU价格上涨10-20%

总结:AI训练服务器是“性能导向”,成本高度集中于GPU(70-80%);AI推理服务器是“能效与成本平衡导向”,GPU占比降低(60-70%),CPU、存储、网络占比相对提升。供应商选择上,训练以国际领先GPU为主,推理则更注重国产替代和场景优化。

本分析基于公开市场数据和研究报告,仅供参考。

报告说明:本分析基于公开市场数据和研究报告,数据更新至2026年4月28日。报告仅供参考,不构成投资建议。

夜雨聆风

夜雨聆风