Sora死了,可灵活了——2026年AI视频工具,普通人该怎么选?

OpenAI在2025年12月30日,悄悄关掉了Sora的独立网站。

没有发布会,没有告别信,只有一个跳转链接,把用户引向ChatGPT的集成界面。那个曾经让全网沸腾的”文本生成视频神器”,那个在2024年Demo视频里展现出电影级镜头语言的AI,死了。

而与此同时,可灵AI的月活用户突破了1500万。即梦虽然涨价了,但创作者们骂归骂,该用还是用。海螺AI在东方美学赛道上杀出了一条血路,Runway Gen-4成了广告公司的标配。

2026年的AI视频战场,早就不是”谁的技术最强”了。是谁的工具最懂创作者。

1

Sora之死的真正死因:不是技术不行,是”产品思维”不行

先给Sora上个坟,不是为了鞭尸,是为了搞清楚——它到底怎么把自己玩死的。

Sora的技术,没得黑。2024年第一次Demo,那条”一位女性在东京街头行走”的视频,光影、反射、人物一致性,确实惊艳。问题是,惊艳之后呢?

生成一条10秒的视频,等待时间以小时计。价格?贵到只有好莱坞特效团队玩得起。提示词理解?英文还行,中文基本抓瞎。输出格式?固定分辨率,后期调色空间极小。

OpenAI做出了最像电影的视频,却忘了——大多数用户只想做个15秒的抖音。

对比可灵、即梦的”平民路线”:3秒视频、快速迭代、低价甚至免费。它们瞄准的不是”电影工业”,是”短视频创作者”——这个群体有几千万人,每天需要成百上千条内容,对质量的要求是”够用就行”,对速度的要求是”现在就要”。

Sora的傲慢在于,它假设用户会为了”更好的效果”等待、付费、学习复杂的提示词。但2026年的创作者生态,是流量驱动的即时满足系统。你今天不发内容,算法明天就不认识你。等Sora生成一条视频的时间,可灵用户已经发了十条,测完了数据,迭代完了选题。

更致命的是,Sora的”封闭生态”。它不开放API,不支持自定义模型,不兼容主流剪辑软件。创作者用它生成一段素材,导出、转码、再导入PR或剪映,流程断成几截。而可灵、Runway们早就打通了从生成到发布的全链路——甚至可以直接导出适配抖音、快手的竖版格式。

技术领先,产品落后。Sora的故事,是硅谷”技术至上”迷信的又一个墓碑。

2

工具实测:我花了三个月,把主流AI视频工具踩了个遍

接下来是干货。我花了三个月,几乎每天泡在AI视频工具里,生成的废片加起来超过500G。以下是血泪经验,不是参数对比,是一个踩过坑的创作者的选择逻辑。

场景一:短剧/剧情类

可灵2.1(Kling):物理真实性强,人物动作自然,适合写实风格的剧情短片。致命伤是”AI味”重——生成的画面总带着一种过度光滑的塑料感,像美颜开到了十级。而且中文提示词理解有bug,”悲伤地走路”经常生成”面无表情地走路”。

Runway Gen-4:镜头语言最成熟,推拉摇移跟,电影感最强。适合有导演基础的创作者。但中文支持极差,提示词必须用英文写,且对东方人脸的生成经常”翻车”——不是眼睛太大,就是五官比例失调。

Pika 2.0:风格化突出,适合实验性、艺术向的短剧。但角色一致性是灾难——同一个人物,换个角度就换张脸。做系列剧?基本不可能。

我的组合打法:用Runway生成分镜(英文提示词+参考图),用可灵生成关键镜头(物理动作),用Pika做风格化转场。最后进剪映统一调色。三条工具,缺一不可。

场景二:广告/产品类

Kling(可灵):国内合规友好,生成内容过审率高。适合品牌方要求”安全”的场景。但创意天花板低,出来的东西总像”模板广告”。

Luma Dream Machine:3D理解能力强,产品展示、空间漫游类视频效果惊艳。但生成速度慢,且对复杂材质(比如透明玻璃、金属反光)的处理不稳定。

HeyGen/D-ID:数字人播报类。不是”生成视频”,是”生成会说话的人”。适合口播广告、产品讲解。但数字人的”恐怖谷效应”依然明显——看久了,你会觉得它在盯着你的灵魂。

血泪教训:广告类视频,AI生成只是第一步。真正决定成败的,是后期——调色、音效、字幕动效。AI省下的拍摄成本,全搭进后期了。别信那些”一键生成广告大片”的鬼话。

场景三:实验/艺术向

Hailuo AI(海螺):东方美学独特,水墨、国风、禅意类画面有不可替代性。生成的人物带有东方特有的”留白”气质,不是西方AI工具那种浓墨重彩的写实风。缺点是通用性弱,做非东方题材很别扭。

Vidu 2.0(清华系):长视频连贯性最好,适合做叙事性强的艺术短片。但画面质感偏”学术”,商业感不足。

Krea AI:实时生成+交互编辑,适合探索性创作。你可以一边调参数,一边看画面实时变化。但稳定性差,经常”抽风”出怪东西。

一个残酷的事实:现在所有AI视频工具生成的内容,三年后回头看,都会像”初代iPhone拍的视频”一样粗糙。技术在进化,你的审美也要跟着进化。否则,你只是在用更贵的工具,生产更精致的垃圾。

3

提示词工程:从”咒语”到”导演语言”

因为你还在用”描述性语言”写提示词,而不是”导演思维”。

AI不懂”一个女孩在走路”。它懂的是镜头、光线、运动、情绪。以下是我在实战中总结的提示词心法,不是玄学,是结构化的导演语言。

第一,镜头语言化。

要说:”手持摄影,跟拍,浅景深,女孩背影,黄昏街道,地面有积水反光,霓虹灯在镜头边缘形成光晕,情绪孤独但坚定。”

每一个词都是给AI的明确指令:手持摄影(运动方式)、跟拍(视角关系)、浅景深(焦段选择)、背影(构图重点)。AI的训练数据里,电影分镜脚本的结构性最强,所以它”理解”这种语言。

第二,情绪锚定。

给AI一个”参考系”,让它知道你想要什么”感觉”。

“类似《重庆森林》的抽帧感”——AI知道你要的是慢门、拖影、都市迷离。

“像《爱死机》第三集的色调”——AI会调用赛博朋克+高对比度+霓虹色。

“90年代家庭录像带的质感”——颗粒、色偏、轻微抖动、过曝。

不要羞于”抄袭”风格。AI的价值,就是让你低成本地调用人类电影史的视觉遗产。

第三,负面提示词的重要性。

比如生成人物视频时,我必加的负面提示词:”变形的手、多余的手指、扭曲的面部、不自然的微笑、穿模、背景模糊但人物清晰(除非指定)。”

AI的”幻觉”是有规律的。你踩的坑多了,就知道哪些错误它最爱犯。提前堵死,比事后修图省十倍时间。

第四,分镜思维。

提示词越像”分镜脚本”,AI理解越准确。因为分镜的本质,是把连续时空切割成离散的画面单元——这和AI的生成逻辑(逐帧/逐段生成)天然契合。

我现在的 workflow:先在纸上画分镜草图(火柴人就行),然后给每个镜头写一段提示词,标注时长、转场方式、音效需求。最后按顺序丢进AI工具批量生成。效率比”想到哪写到哪”高三倍不止。

4

AI视频创作者的”隐性成本”:那些工具商不会告诉你的坑

AI工具的宣传页上,写的都是”降低门槛””赋能创作””释放想象力”。他们不会告诉你的是:

时间成本:抽卡式创作的耗竭

生成100条,选1条能用。这是AI视频创作的常态。你以为省了拍摄时间?不,你把时间花在了”抽卡”上——不断调整提示词、参数、种子值,祈祷AI这次别出怪东西。

更隐蔽的消耗是决策疲劳。每次生成都是一次小赌博,赌赢了开心,赌输了挫败。一天抽几十次卡,创作者的心理能量被快速耗尽。我见过有人因为AI连续生成”六指琴魔”而摔键盘——不是心疼钱,是觉得自己像个对着机器祈祷的傻子。

版权风险:你以为生成的是你的,其实可能是谁的

AI生成的角色形象,可能”撞脸”某个真人。你做的短剧主角,越看越像某个明星——不是故意的,是AI训练数据的”记忆”在作祟。一旦被起诉,你很难证明”这是AI生成的巧合”。

背景音乐也一样。很多创作者习惯给AI视频配热门BGM,但AI视频平台对音乐版权的审核越来越严。一条爆款视频,可能因为BGM侵权被下架,前面的流量全白做。

平台规则:标注=限流,不标注=违规

抖音、快手对AI生成内容的政策是:必须标注”内容由AI生成”。但标注之后,算法会降权——因为平台担心AI内容泛滥,稀释真人创作者生态。

所以你面临一个两难:标注,流量打折;不标注,一旦被发现,账号限流甚至封禁。很多创作者选择”灰色地带”——在画面角落用小字标注,或者只在评论区提一句。但这终究是悬在头上的剑。

心理成本:当”一键生成”成为常态,创作者的价值感危机

当你用AI生成了一条视频,获得十万播放,你会开心。但开心之后,会有一个声音问:“这还算我的作品吗?”

提示词是你写的,但画面是AI画的。分镜是你设计的,但执行是AI完成的。你是什么?导演?策展人?还是……一个会写提示词的观众?

我见过一个做了十年视频的创作者,在全面转向AI workflow 三个月后,陷入了严重的创作倦怠。”以前拍一条片,累但充实。现在一天出十条,却觉得什么都没做。”

这不是矫情。这是创作主体性的丧失。当工具太强大,人容易忘记自己为什么创作。

5

反直觉的结论:别问”哪个最强”,问”哪个最不会骗你”

2026年选AI视频工具,最大的陷阱是”参数迷信”。

看Demo视频,个个惊艳。看官方数据,帧率、分辨率、生成速度,一家比一家高。但等你真正用起来,发现Demo是”百里挑一”的幸存者,数据是实验室环境下的理想值。

知道什么是好的镜头语言,才能在100条垃圾生成里挑出那条能用的。知道什么是真实的情绪,才能判断AI生成的”笑脸”是温暖还是诡异。知道什么是故事的节奏,才能在AI给出的”合理但无聊”的剧情里,找到那个需要人工介入的转折点。

这不是鸡汤。这是2026年AI视频创作者的分水岭——会用工具的人,和懂创作的人,正在变成两个物种。

6

2026 AI视频工具选型决策树

做短剧/剧情?→ 可灵(国内合规+物理真实)+ Runway(镜头语言)组合使用。

做广告/产品?→ Luma(3D展示)+ 可灵(快速迭代),后期必须人工精修。

做实验/艺术?→ 海螺(东方美学)+ Krea(实时交互),接受不稳定,拥抱意外。

什么都想做?→ 你需要的可能不是工具,是一个团队。以及,一颗能接受”AI永远不完美”的心。

还有一个预言:现在的AI视频工具,三年后都会显得幼稚。就像2010年的美图秀秀,2015年的Prisma,2020年的DALL-E。技术会迭代,审美会进化,但创作者对”好内容”的直觉,永远是稀缺品。

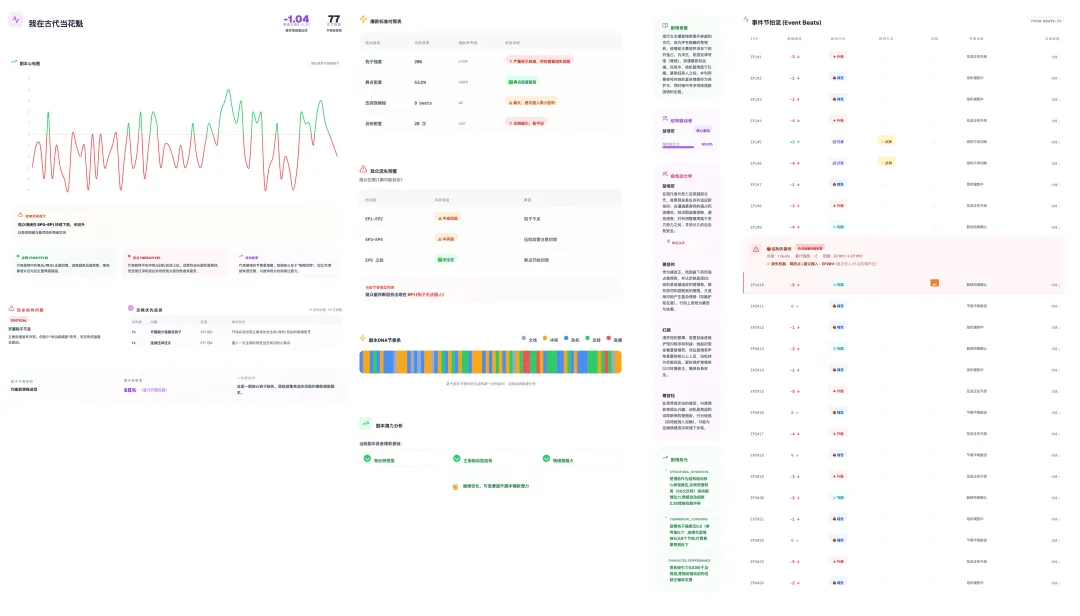

面向剧本、小说、网文的专业文本检测引擎——短剧工程(网址:https://www.duanjugongcheng.com)。

剧本AI检测系统基于文本结构模式识别、语言生成概率分析与语言稳定性建模,针对中文叙事文本进行专项训练,区别于通用检测模型,更适配情节类内容的表达方式,支持对短剧剧本、小说章节、 网络文学内容的进行检测,无论是平台审核、编辑筛选、版权风控还是内容合规辅助判断等场景都适用。

剧本心电图则主要是针对剧本“节奏怪怪的,看不出哪里出问题”、“观众中途滑走,原因不明确”、“剧情缺乏高光和情绪释放节点”等问题,可以帮助精准标出风险段、爽点和角色负载,让改稿更高效、更科学。

首次登录还可以获得免费试用的积分,赶快登录https://www.duanjugongcheng.com试试吧~

夜雨聆风

夜雨聆风