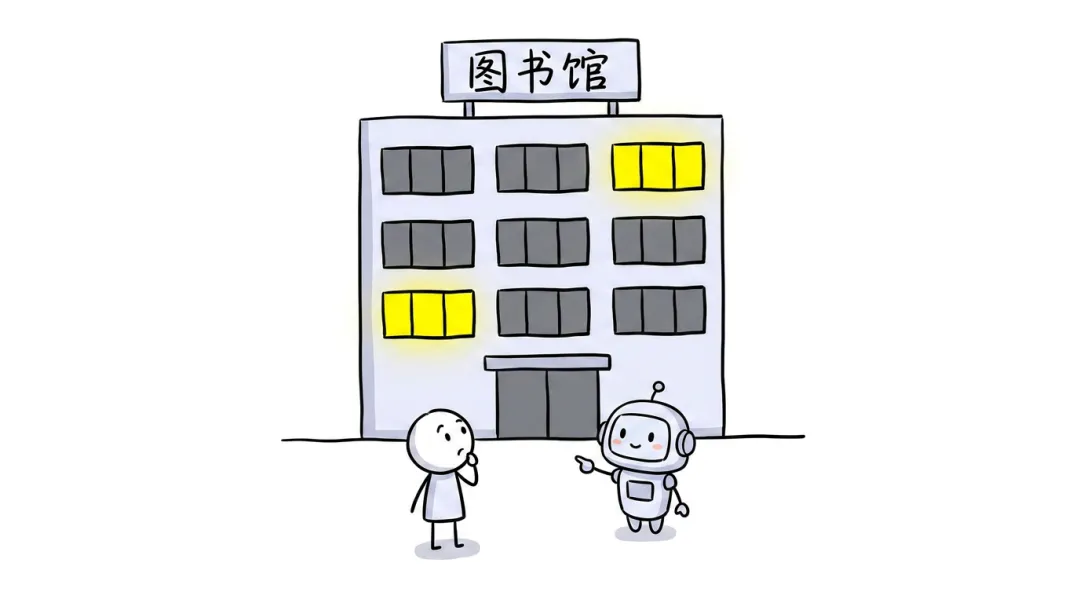

AI 不是工程师,是被点亮的图书馆

你有没有发现一个现象。

同一个问题问 AI,第一轮答得平平无奇。你追问一句,第二轮深了点。再追问一句,第三轮开始有意思了。问到第五轮,突然给出一个让你拍大腿的洞察。

那一刻你脑子里会冒出一个问题:

既然你能答好,为啥不能一开始就答好?

我前段时间真的把这个问题甩给 AI 了。它的回答让我重新理解了一件事:AI 跟我们想象中的「智能助手」不一样。它不是工程师。它是一座被点亮的图书馆。

它不是「不愿意」一开始答好,是「没法」

很多人以为 AI 故意藏着掖着,第一轮敷衍你,等你追问到位才掏出真东西。

不是。

AI 没有一个「持续运行的思考主体」。它每次回答,都是从你的提问出发,激活相关的知识区域。问题的措辞决定了哪块知识被激活。

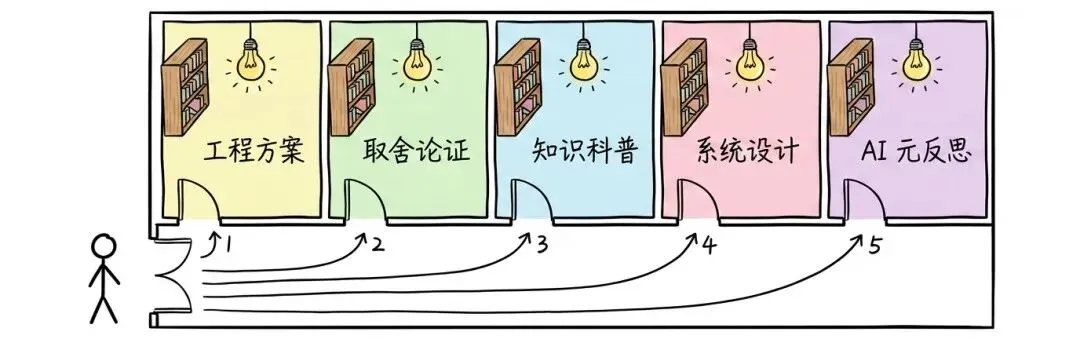

我那天连续问了 AI 五轮,每一轮激活的都是不同的区域:

1.第 1 轮问「怎么办」,它激活的是「工程方案区」

2.第 2 轮问「为啥这个方案」,它激活的是「取舍论证区」

3.第 3 轮问「那个名词什么意思」,它激活的是「知识科普区」

4.第 4 轮问「这个机制有什么前提」,它激活的是「系统设计区」

5.第 5 轮问「为啥不能一开始做好」,它激活的是「AI 元反思区」

第 5 轮的答案,第 1 轮我其实也能拿到。但我没问到那一层,那块知识就不会被点亮。

这不是 AI 在打太极。这是它的工作机制本身。

三层原因 决定了它必须靠你问出来

具体说,AI 没法一开始就给最深的回答,有三个原因。

1.机制层:它没有「目标」,只有「响应」

人类工程师能主动想「我要让用户少走弯路」。AI 不会。它没有自己的目的,只能基于你的输入回答。

2.训练层:它被训练成「少啰嗦多直答」

标注员喜欢直接给答案的回复,不喜欢反问一堆的回复。模型学会了快速给最优解,代价是不主动暴露假设、不主动列方案矩阵、不主动质疑你的问法。

3.信息层:它不知道你的语境

人类同事跟你聊 1 分钟就能摸清你的水平和背景。AI 看到的只有你输入的字。它只能假设「常见场景」,所以会默认你已经知道很多基础概念。

这三层叠加起来,结果就是:AI 默认给「在你的提问框架里的最优解」,不会主动跳出来给「你没意识到存在的方案」。

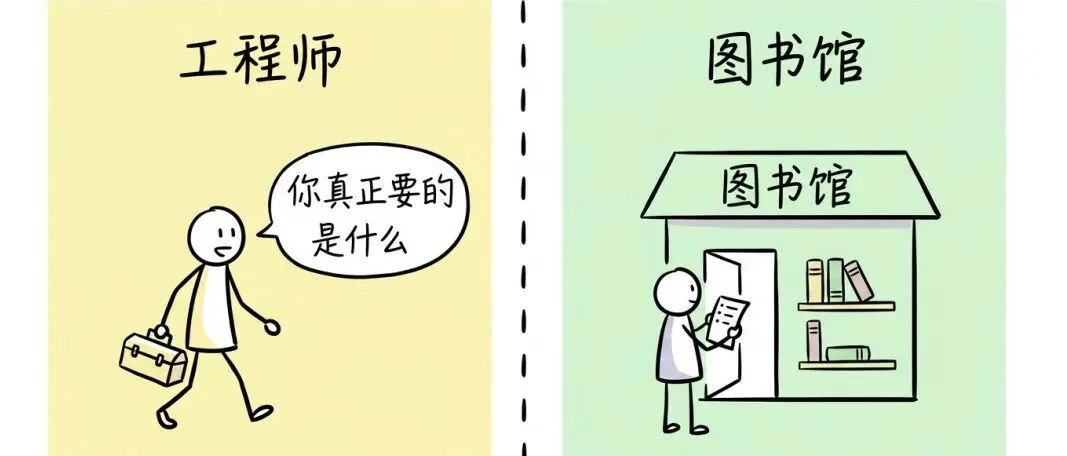

它是图书馆,不是工程师

我后来想到一个比喻,自己觉得挺贴切。

AI 不是一个会主动思考、主动跳出问题来反问你的工程师。它是一座有所有书的图书馆。

图书馆里什么都有。但它不会主动走出来递给你。

你站在门口说「我要找一本书,关于做好咖啡的」,它推一本《咖啡冲泡入门》。你说「我想做意式」,它推《意式咖啡机指南》。你说「其实我是想开店」,它推《精品咖啡店运营》。

每一句话都在点亮图书馆的不同区域。

你的提问质量决定了哪些区域被照亮。你问得越粗,它给得越浅。这不是图书馆藏私,是物理机制。

意识到这一点,就不会再期待 AI 第一轮就给完美答案。反过来,会把责任拿回到自己手上:怎么提问,才能让最该被点亮的那块亮起来。

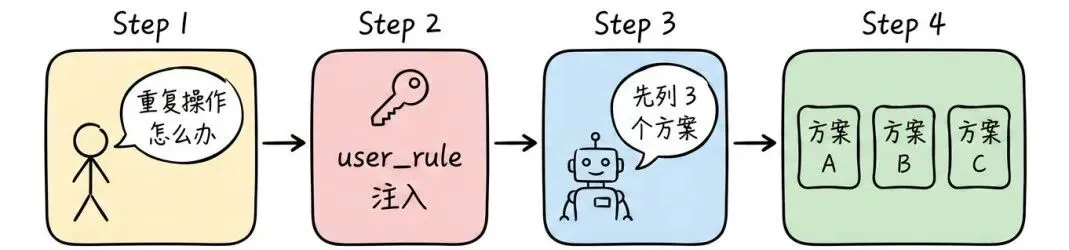

怎么用规则把它强制激活

知道了原理,就有解法。我现在常用三个。

1.第一句话就明示语境

不要说「重复操作怎么办」。说「我用 Cursor + Claude 做开发,重复操作怎么办?我知道脚本能解决一部分,想知道还有哪些范式,包括我可能没听过的」。

后半句直接把「还有哪些范式」「我可能没听过的」摆到桌面上,AI 就会主动列出 Skill、Agent、Workflow 等。

2.强制 AI 给方案矩阵,不给「最优解」

加一条规则:回答时不要直接给推荐方案。先列出至少 3 种范式,对比优缺点,最后才推荐。放进 user_rules 永久生效。

3.把「该有的反问」写成规则

「回答前,必须先问自己:用户的问题措辞里,有没有隐含的框架假设?用户可能不知道有哪些范式存在?如果有,必须在回答开头主动指出。」

这就是把 AI 没有的「主动性」用规则注入。AI 没有自发的主动,但能被规则约束成「看起来主动」。

写在后面

很多人对 AI 失望,本质是误解了它的工作方式。

期待它像同事一样,主动反问、主动暴露假设、主动列方案。它做不到,因为它没有「主动」这种东西。

但你可以用规则把它的潜力激活出来。

别等 AI 变完美。它不会。

你能做的是:用一句更好的提问,一条更准的规则,让它原本就有的能力,被点亮到正确的位置。

👉 推荐阅读

夜雨聆风

夜雨聆风