用 AI 剪视频?这个开源项目让我重新理解"效率"

点击上方卡片关注我

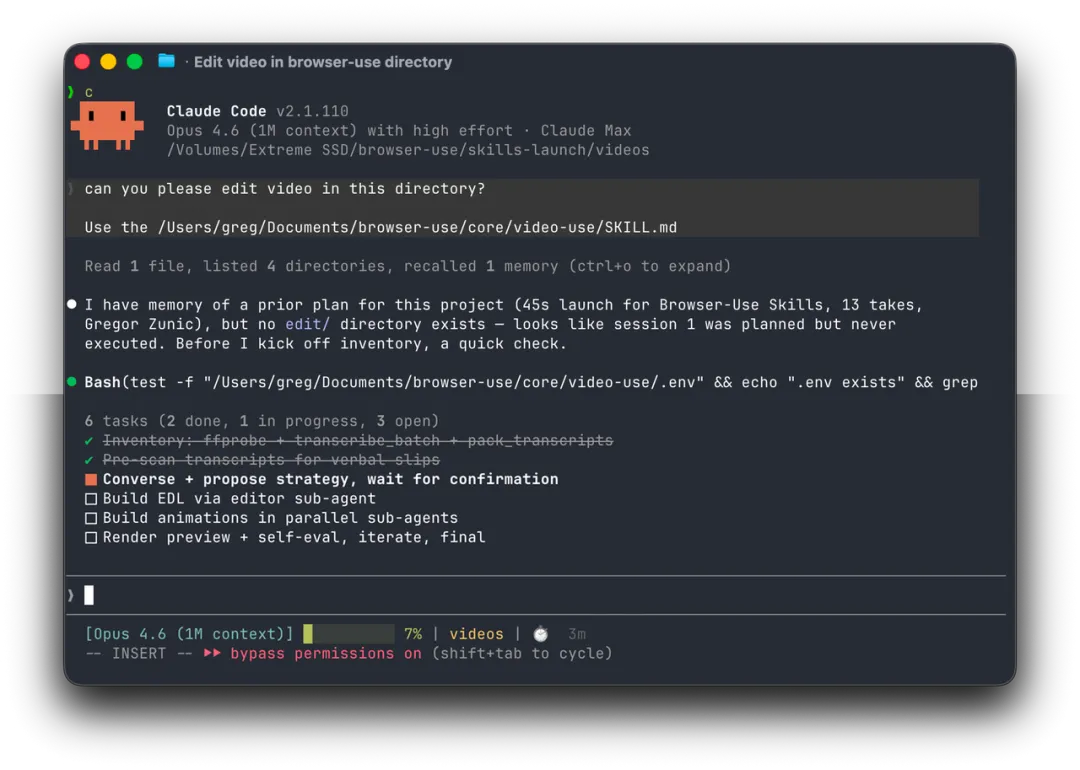

对长期使用Claude Code的技术开发者而言,有个痛点始终难以解决:

作为AI编程的核心工具,Claude原生不支持视频解析,面对技术教程录屏、项目演示视频、操作流程录像,只能手动逐帧截图、提取字幕,才能勉强接入AI工作流,效率低下且容易遗漏关键信息。

直到Browser Use团队(曾打造8.8万Star的browser-use插件)推出全新开源项目——Video Use,彻底打破了这一壁垒。

不同于市面上简单的视频转文字工具,Video Use以「高效Token利用+结构化解析」为核心,不仅让Claude Code看懂视频,更实现了视频编辑与AI编程的深度联动,其底层实现思路,远比功能本身更值得技术开发者深究。

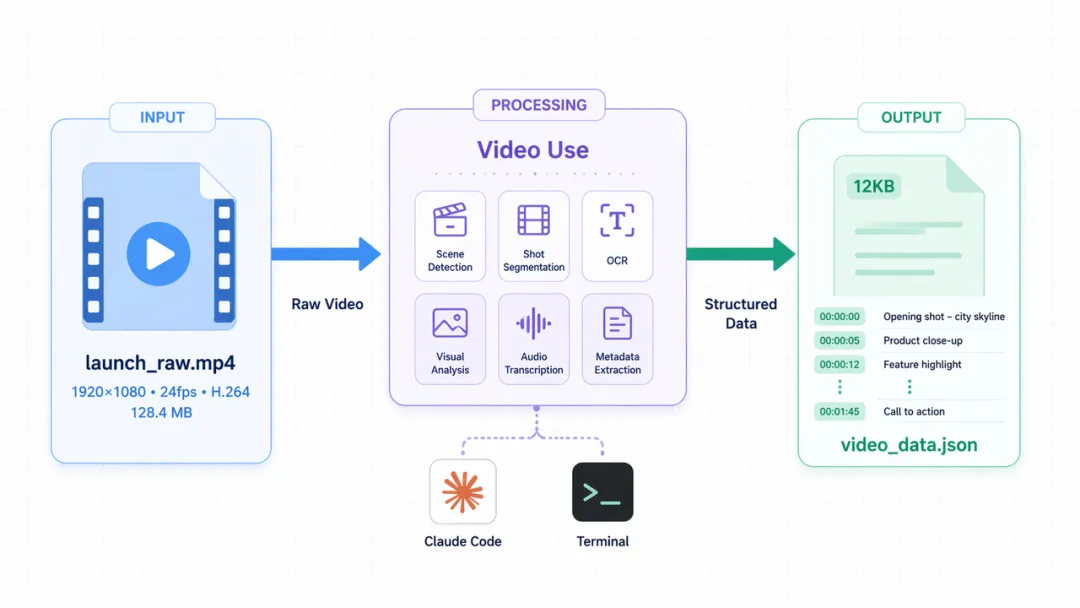

怎么工作?

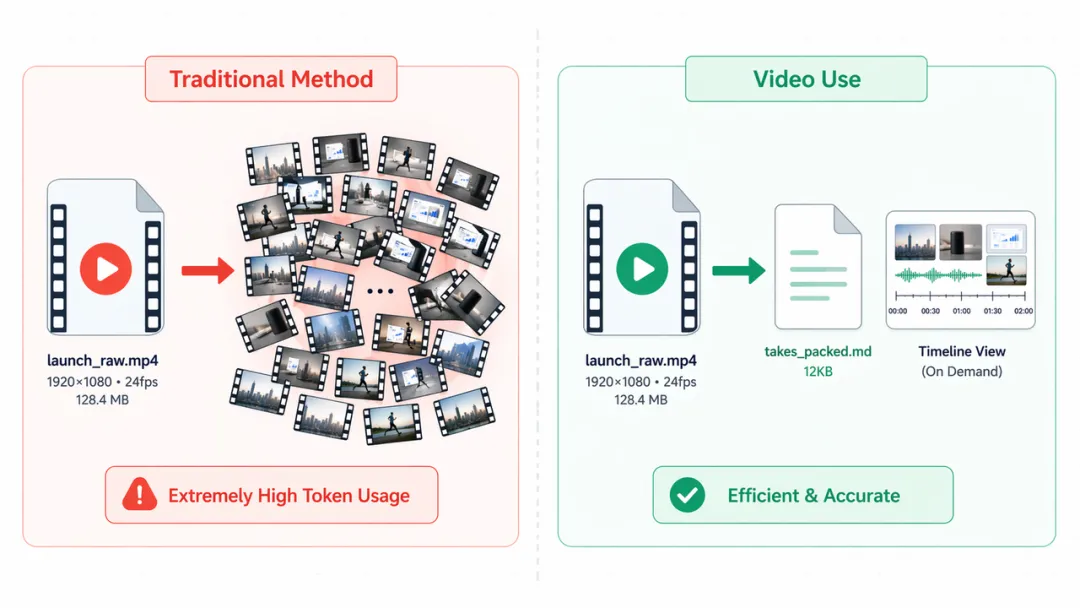

多数多模态工具解析视频时,都会陷入「逐帧提取-模型识别」的误区:一段几分钟的视频,动辄拆解成数万帧,Token 消耗极高,不仅效率低下,还容易出现识别偏差。

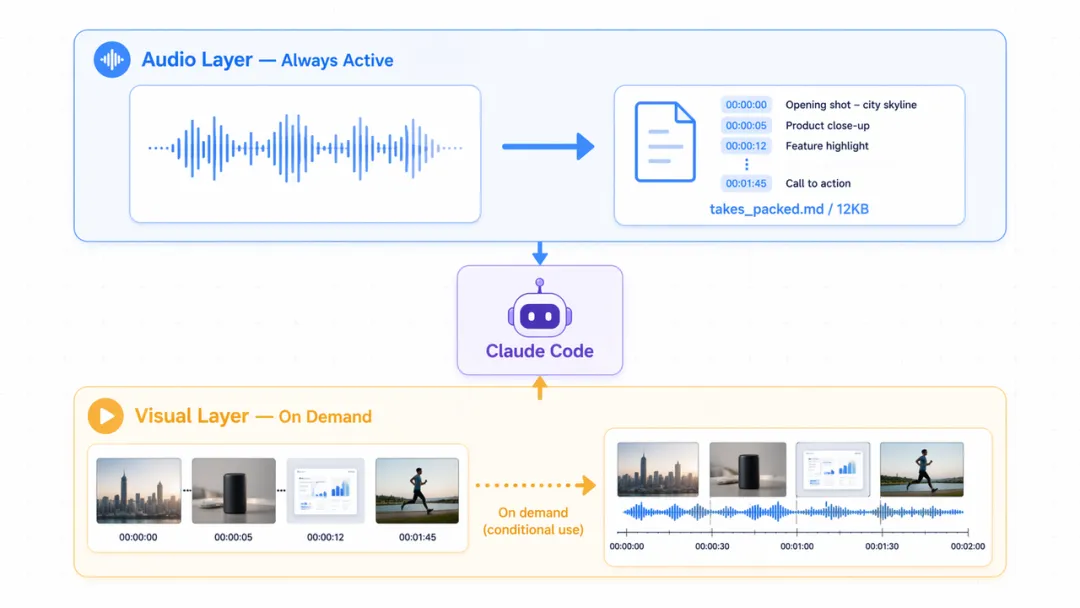

Video Use 的创新之处,在于借鉴了 browser-use 的「结构化解析」方法论,将视频拆解为「音频常驻层 + 视觉按需层」,既控制了 Token 消耗,又保证了解析精度。

底层逻辑分两步:

第一层:音频常驻层——整个工具的核心支撑

Video Use 通过 ElevenLabs Scribe 接口对视频音频进行转录,生成包含「词级时间戳、说话人区分、音频事件标注」(如笑声、叹息、停顿)的文本稿,打包为仅约 12KB 的 takes_packed.md 文件,作为 Claude Code 的主要解析依据。

词级时间戳是视频剪辑精度的关键——主流转写工具大多只支持句级时间戳,这也是 Video Use 能实现精准剪辑的核心原因。

第二层:视觉按需层——拒绝无效算力浪费

不同于全程提取视频帧,Video Use 仅在关键决策节点(如模糊停顿、重录片段比对、剪辑点校验),通过 timeline_view 动态生成一张「胶片缩略 + 音频波形 + 单词标签」的复合图,供 Claude Code 参考。

这种「文本为主、视觉为辅」的模式,和 browser-use 处理网页的思路完全一致——不是截图给 AI 看,而是先把信息结构化,再按需取用。

两层加起来:12KB 文字 + 少量几张图。 既避免了大量 Token 消耗,又保证了解析准确性。

核心功能

对技术开发者而言,Video Use的价值远不止「自动剪辑」,更在于它将视频信息无缝融入Claude Code的编程工作流

实现了「视频解析-逻辑拆解-代码复现」的一站式联动,这也是其区别于普通视频剪辑工具的核心优势。

从功能层面,它覆盖了技术场景的核心需求,且每一项都贴合开发者使用习惯:

1.智能剪辑

自动识别并切除「呃、嗯」等口头禅、无效停顿,每个剪辑点自动添加30ms音频淡入淡出,避免爆音;

支持自动色彩调级(电影暖调、中性色调等),可自定义ffmpeg参数,无需手动操作剪辑软件。

2.精准字幕

默认生成2词大写字幕,支持完全自定义样式,无需手动打轴、调整字幕位置,适配技术教程、演示视频的字幕需求。

3.视频解析与编程联动

上传技术教程、项目演示视频后,可直接让Claude Code总结核心流程、拆解操作步骤,甚至基于视频中的演示内容,直接复现对应的项目代码,彻底打通「看视频-学技术-写代码」的链路。

4.流程闭环与状态持久化

剪辑完成后会自动进行自检,扫描每个剪辑点是否存在画面跳切、字幕遮挡、音频爆音等问题,最多可自动回炉重渲染3次,确保输出质量;

同时将会话状态保存至project.md文件,下次可直接接续上次剪辑进度,适配长视频、系列教程的制作需求。

整个过程有自我评估机制——每个剪切点渲染完之后,AI 自己检查,发现有问题自动重来,最多跑 3 次修复循环。

此外,它还支持本地视频、在线视频(需安装yt-dlp)解析,适配谈话、教程、访谈、旅行等各类视频内容,无预设模板,完全按需响应指令。

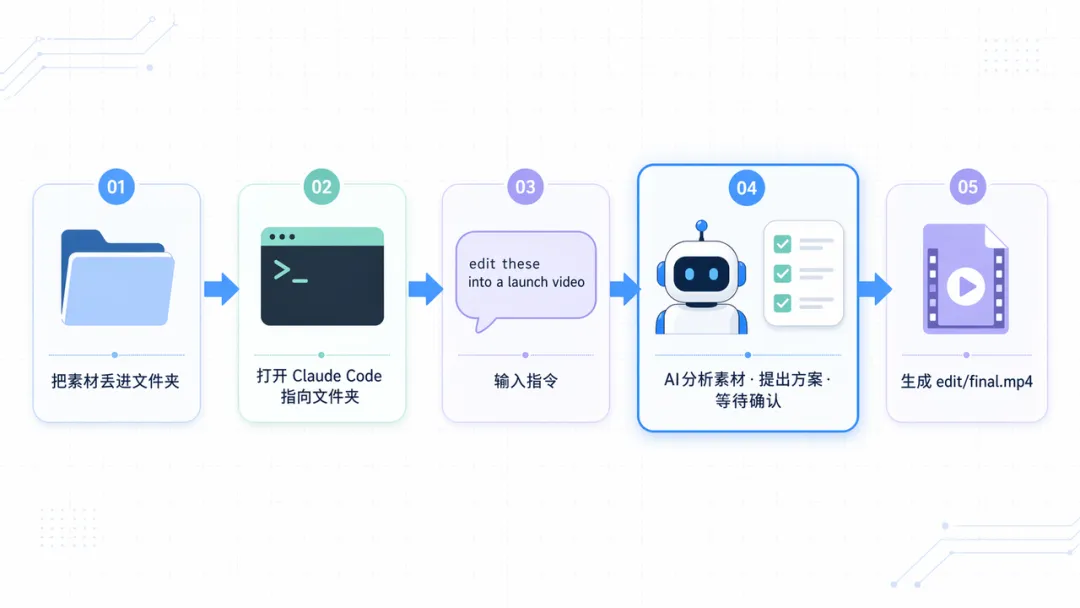

安装

作为面向技术开发者的开源工具,Video Use的安装流程简洁且规范,全程通过命令行操作,无需复杂配置

以下步骤经过实测,确保每一步都可正常执行

(需提前准备ElevenLabs API Key,用于音频转录):

# 1. 克隆项目至本地

git clone https://github.com/browser-use/video-use

cd video-use

# 2. 软链接到Claude Code技能目录(关键步骤,确保Claude能识别)

ln -s "$(pwd)" ~/.claude/skills/video-use

# 3. 安装依赖包

pip install -e .

# 4. 安装必需工具(ffmpeg为必装,yt-dlp可选,用于下载在线视频)

brew install ffmpeg

brew install yt-dlp

# 5. 配置ElevenLabs API Key

cp .env.example .env

# 编辑.env文件,添加ELEVENLABS_API_KEY=你的密钥(可在ElevenLabs官网获取)

$EDITOR .env

# 6. 启动使用

cd /path/to/你的视频文件夹

claude

# 在Claude会话中输入指令(例:"将当前文件夹的视频剪辑成可发布的技术演示视频")

注意:目前项目处于早期开源阶段,复杂视频场景可能需要多轮对话明确需求,指令描述越具体(如剪辑风格、字幕要求、保留片段),输出效果越精准。 需要有 Claude Code 和 ElevenLabs 的 API Key,其他没有额外门槛。

写在最后

Video Use 现在还很早期——项目处于早期开源阶段,复杂视频场景可能需要多轮对话明确需求。

但它解决的问题是真实的:剪视频这件事,90% 的时间是在做机械重复的工作,这些本来就不该是人来做的。

更重要的是,它的思路不是「让 AI 模仿人类剪视频」,而是重新设计了 AI 理解视频的方式——从结构出发,而不是从像素出发。

这个方向,值得认真关注。

GitHub: github.com/browser-use/video-use

如果在编程工具充值使用上遇到麻烦,推荐一个第三方共享平台 aigocode.com,一次性搞定 Codex 和 Claude Code,内容介绍和付费兑换详见文末阅读原文。

📘 我们整理了一份《AI 编程出海蓝皮书》,汇集了过去几个月团队在出海实战中沉淀下来的核心经验。内容持续更新ing

从需求、工具、部署、收款,到 SEO、推广、引流,一步步带你搞懂普通人也能启动的出海路径。这份资料能帮你快速入门、少踩坑。

扫码或微信搜索 257735 添加微信,回复【出海资料】即可免费领取。

夜雨聆风

夜雨聆风