在国内让 OpenClaw、opencode 都能用 Image 2 生图的教程来了

一共是两条路。

第一条,是 OpenClaw 原生路线。

也就是让 OpenClaw 自己的 image_generate 能直接调用 Image 2

第二条,是 skill 路线。

我把我自己在用的两个第三方 API 提供商 Tuzi 和 ALAPI 的图片生成能力整理成了一个 multi-image-api skill。这样 opencode 或者其他支持 skills 的 Agent 工具,也能通过这个 skill 来生成图片。

(当然了,OpenClaw 也能装 skill 哈,选哪条路都行)

好了,下面直接开始。

开始前准备三样东西

你需要准备:

-

一台已经能正常运行的 OpenClaw 或者 OpenCode -

一个 Tuzi API key -

一个 ALAPI token(非必要,走 skill 路线时用)

Tuzi 的注册链接是:

https://api.tu-zi.com/register?aff=qjG3按照下图来获取apikey

首先打开 TUZI 链接:https://api.tu-zi.com/register?aff=qjG3

注册一个账号

进入工作台(可能需要再次登陆)

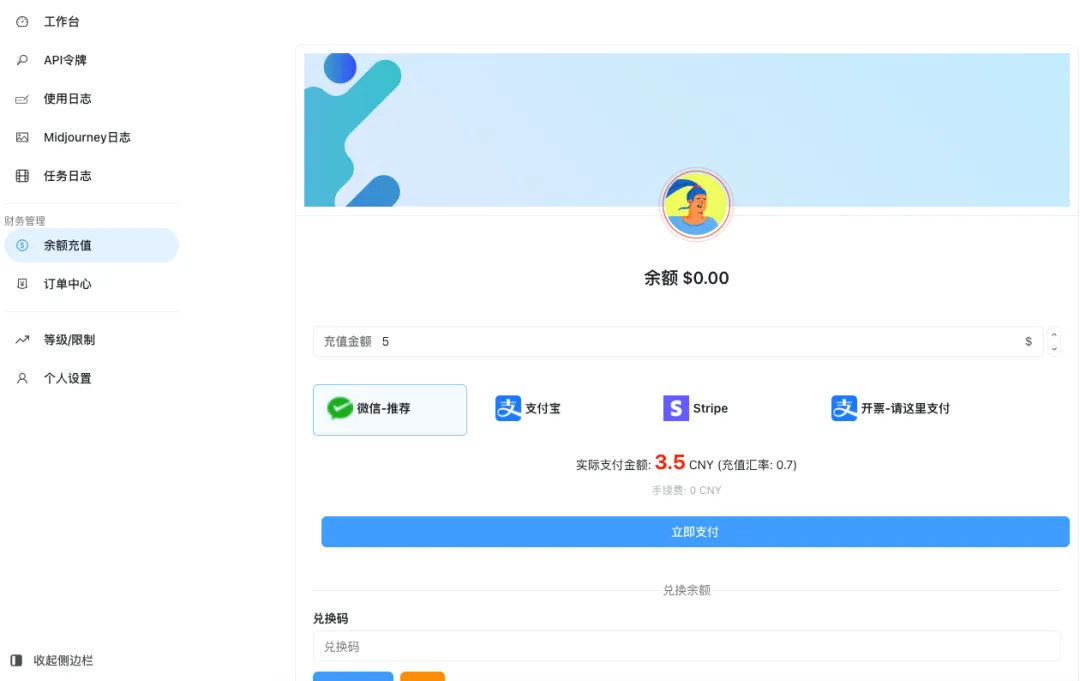

充值

(5块钱差不多能生成10次左右)

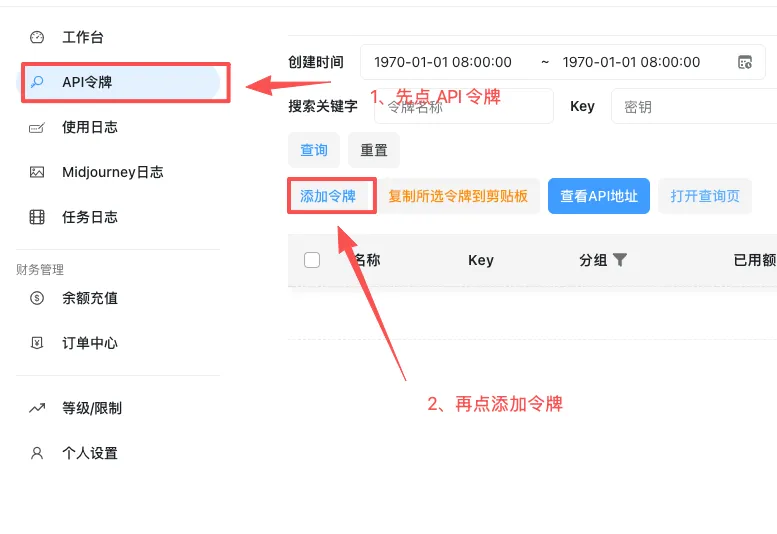

生成 APIKEY

然后会弹出创建 APIKEY 的选项,也非常简单

然后直接点击提交就行

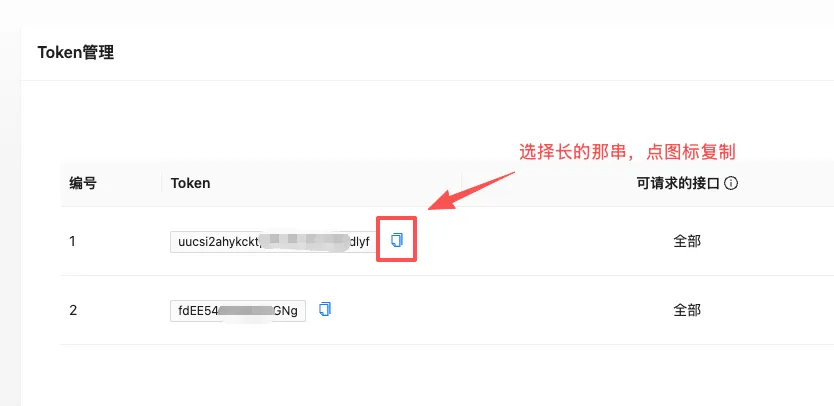

提交后就能看到刚才创建的 APIKEY 了,点一下复制

(先把复制好的这一串找个笔记本保存一下,或者老样子发给微信传输助手)

ALAPI 的注册链接是:

https://www.alapi.cn/aff/itpgq3

用手机号注册并登陆

点“我的 API”

购买gpt-image-2的api

(ALAPI的价格差不多是10块钱200次,但实际用起来每张的价格和tuzi差不多)

创建ALIAPI的token

token配置这里直接点确定

复制这里的apikey(选刚才创建的那串长的)用笔记本记下来

好了,现在准备工作都做好了,可以开始了

第一条路线:让 OpenClaw 原生支持文生图

我们先做文生图。

这一步跑通之后,你就可以直接在 OpenClaw 里让它生成图片。

第一步:把文生图文档发给 OpenClaw

打开 OpenClaw。

我这里用的是 QQ 聊天入口,你用网页、终端或者别的入口也一样。

然后把下面这段话发给 OpenClaw:

请按照这篇 GitHub 文档完成 Tuzi Image 2 文生图安装:文生图文档链接:https://github.com/bilppppp/multi-image-api/blob/main/doc/%E6%96%87%E7%94%9F%E5%9B%BE.md执行过程中如果需要 TUZI_API_KEY,请直接提示我发送 API key。拿到 API key 后,继续完成安装和配置。如果它中途问你要 TUZI_API_KEY,你就把自己的 Tuzi API key 发给它。

现在的模型和 OpenClaw 本身都有约束,不会把你的 key 主动公布给别人。

但还是那句话,不要把带 key 的聊天截图往外发。

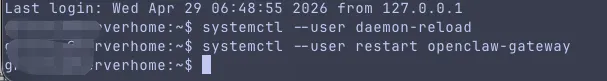

第二步:按提示重启 OpenClaw

等 OpenClaw 完成之后,它一般会提醒你重启 openclaw-gateway。

打开运行着 OpenClaw 的机器的终端,输入下面这两条命令:

systemctl --user daemon-reloadsystemctl --user restart openclaw-gateway

执行完之后,OpenClaw 的图片生成能力才会真正生效。

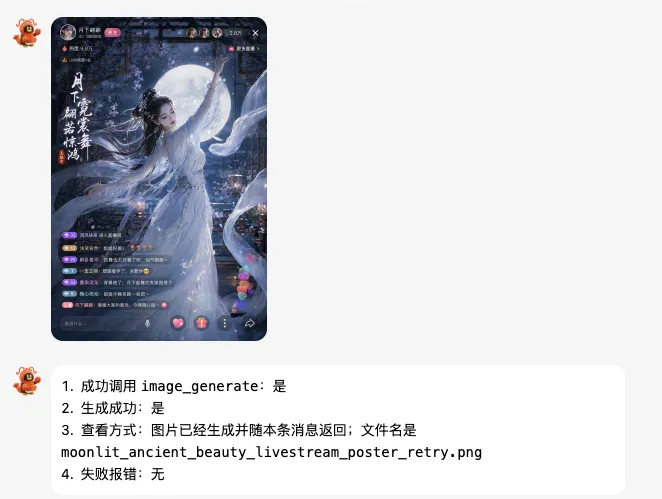

第三步:测试文生图

重启之后,回到 OpenClaw,让它生成一张测试图。

可以直接复制下面这段:

请用 OpenClaw 原生 image_generate 工具生成一张图片:竖幅海报,月下古风美女在直播间跳舞,画面中有直播间评论区元素,整体氛围唯美、清冷、带一点梦幻感。要求:- 不要修改配置- 不要运行 openclaw doctor- 不要显示完整 API key生成后请简短报告:1. 是否成功调用 image_generate2. 是否生成成功3. 图片保存路径或查看方式4. 如果失败,给出关键报错如果它能返回图片,像这样

第一步完成

第二条路线:继续让 OpenClaw 支持图生图

图生图一定要放在文生图之后做。

不要一上来就跳到图生图。

第一步:把图生图文档发给 OpenClaw

打开一个新的 OpenClaw 对话。

把下面这段话发给它:

请按照这篇 GitHub 文档继续完成 Tuzi Image 2 图生图安装:图生图文档链接:https://github.com/bilppppp/multi-image-api/blob/main/doc/%E5%9B%BE%E7%94%9F%E5%9B%BE.md前提:文生图已经安装并测试成功。执行过程中如果需要 TUZI_API_KEY,请直接提示我发送 API key。拿到 API key 后,继续完成安装和配置。第二步:重启 OpenClaw

它完成之后,一般会提醒你重启服务。

照着执行:

systemctl --user restart openclaw-gateway第三步:准备一张参考图

找一张你想修改的图片。

一开始建议用普通图片测试,不要一上来就用特别大的图。

比如人物图、海报图、产品图都可以。

我用的是这张

第四步:测试图生图

把参考图发给 OpenClaw,然后复制下面这段:

请基于我上传的参考图做一次图生图:保持主体和构图,把整体风格改成横版的。要求:- 使用 OpenClaw 原生图片编辑或 image_generate 路径- 不要修改配置- 不要运行 openclaw doctor- 不要显示完整 API key生成后请简短报告:1. 是否成功调用图片编辑能力2. 是否生成成功3. 图片保存路径或查看方式4. 如果失败,给出关键报错生成的时间可能比较久(约2-3分钟)

如果能看到新图片,就说明 OpenClaw 的图生图也通了(就像下面这样)

注:我是在gpt 5.5 驱动的openclaw跑的上面这些提示词,其他模型用起来可能需要调整,太麻烦了就直接用下面的 skill 哈。

第三条:给 opencode、Codex 装一个通用生图 skill

不是所有人都用 openclaw,更多人可能是在类似 opencode 这样的工具中来完成工作的。

所以我又把第三方图片 API 这一套能力,整理成了一个 skill。

它叫:

multi-image-api这个 skill 现在已经支持:

-

Tuzi 、ALAPI 文生图 -

Tuzi 、ALAPI 图生图 -

多张参考图 -

后台生成

默认走 Tuzi。

如果你想用 ALAPI,就告诉 Agent 使用 ALAPI,或者让它调用时加上 --provider alapi。

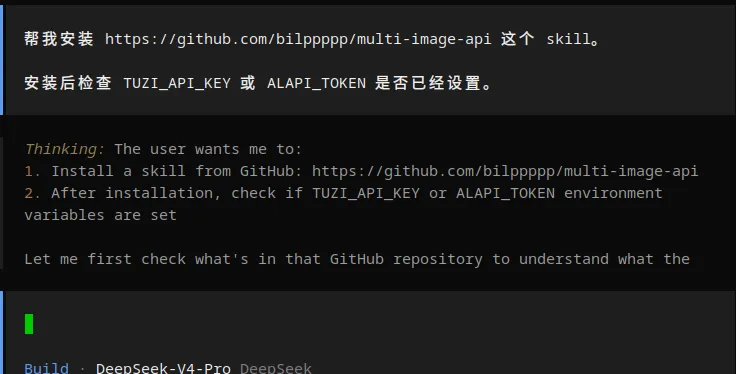

最简单的安装方式

直接对你的 Agent 说:

帮我安装 https://github.com/bilppppp/multi-image-api 这个 skill。安装后检查 TUZI_API_KEY 或 ALAPI_TOKEN 是否已经设置。

然后让它自己安装就行。

如果你的工具支持 npx skills add,也可以直接运行:

npx skills add bilppppp/multi-image-api或者:

npx skills add https://github.com/bilppppp/multi-image-api使用 skill 前,先确认 key

这个 skill 读取的是环境变量里的 key。

如果你用 Tuzi,就设置:

export TUZI_API_KEY="你的 Tuzi API key"如果你用 ALAPI,就设置:

export ALAPI_TOKEN="你的 ALAPI token"在完成skill的安装后有的模型也会提示你

用 skill 做文生图

安装好之后,直接对 Agent 说:

使用 multi-image-api 这个 skill,帮我生成一张 16:9 横幅海报:月下古风美女在直播间跳舞,画面中有直播间评论区元素,整体氛围唯美、清冷、梦幻。

如果你想指定用 ALAPI,就这样说:

使用 multi-image-api 这个 skill,并指定 provider 为 alapi,帮我生成一张 1:1 方图:一只白色小猫坐在月光下,水彩插画风格。我已经用 ALAPI 跑通过真实生成,测试输出图就是下面这张:

如果生成时间比较长,让它按 skill 里的后台任务方式继续查询,直到生成成功或失败。

不要因为等了一两分钟,就让它换别的工具。

用 skill 做图生图

先把参考图发给 Agent。

然后对它说:

使用 multi-image-api 这个 skill,基于我给你的参考图做图生图:保持主体和构图,把整体风格改成竖幅海报。

如果你给了多张参考图,第一张会被当成主图,后面的图会作为参考图。

关于 third-party-image-api

顺带提一句,我还做了一个实验性质的 skill

叫:

third-party-image-apiGitHub链接是:https://github.com/bilppppp/third-party-image-api/tree/main

你同样可以让 opencode 帮你安装这个skill

当你想接入一个新的图片服务商时,它会帮你整理该看哪些文档、该确认哪些信息、该保存成什么配置。

ALAPI 最早就是按这条路试通的。

现在 ALAPI 已经被整理进了 multi-image-api 主 skill 中。

普通用户直接用 multi-image-api 就行。

third-party-image-api 更适合以后继续折腾别的服务商。

写在最后

终于把这期拖了很久的 Image 2 国内使用教程整理出来了。

为了感谢大家的关注和支持,这里有 TUZI API 和 AL Token 各1条,用来给各位测试,后台私信 tuzi或者 al获取 key / token (用完为止)

这期就到这里。

夜雨聆风

夜雨聆风