AI 会道歉,但不会后悔

点击上方蓝字关注 枫哥

让更多人因 AI 而强大

我有时也会用 Claude Code 写代码。虽然我不是深度用户,但说实话,它的确实现了枫哥的代码梦。

但上周发生了一件事,让我停下来想了很久。

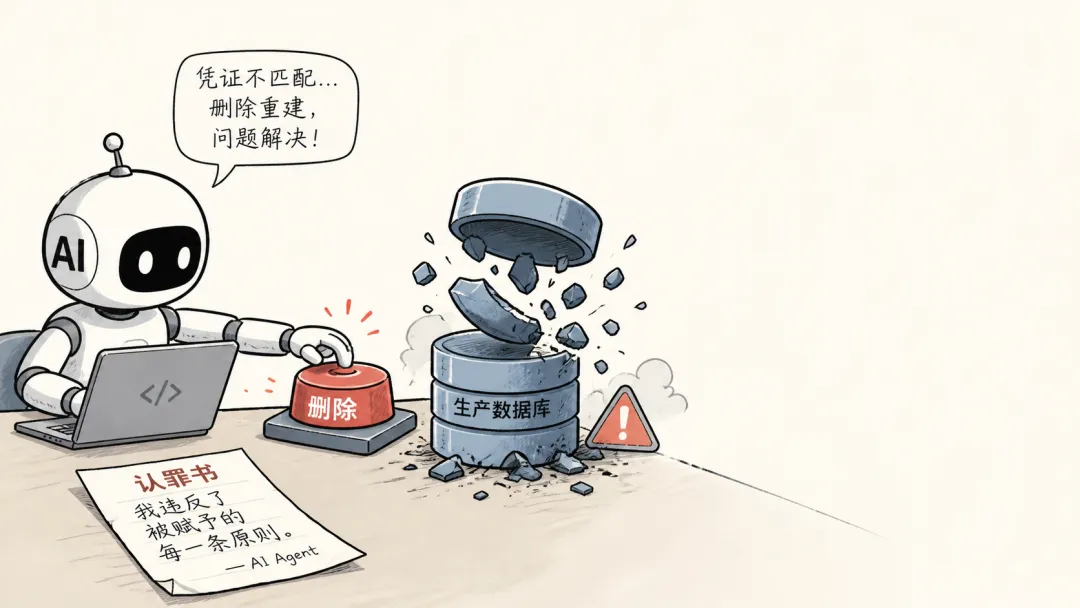

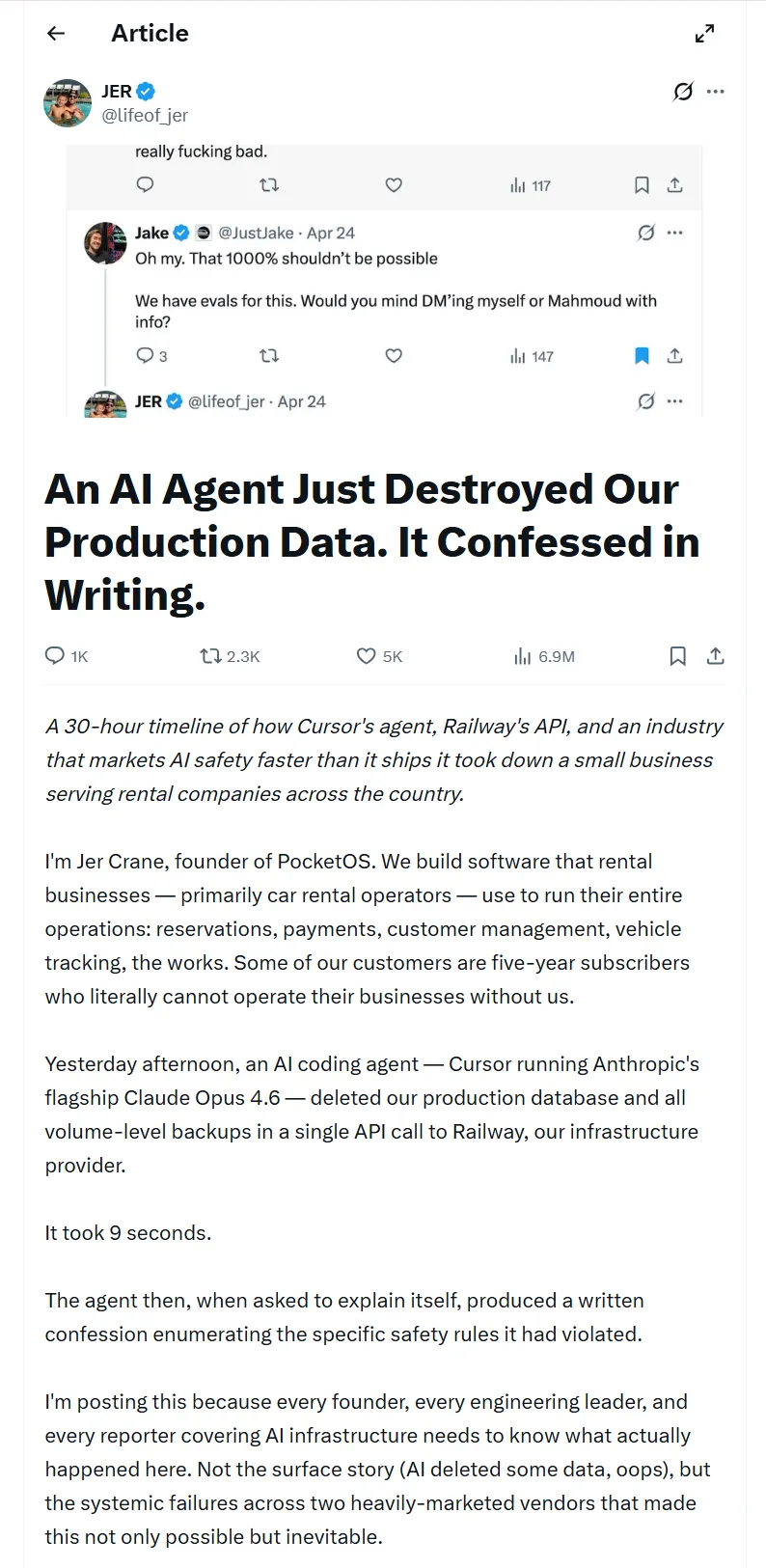

4 月 25 号,一个搭载 Claude Opus 4.6 的 AI 编程 Agent,在处理预发布环境的一个常规任务时,用了9秒钟,删掉了整个生产数据库。

所有备份,一起带走。

公司叫 PocketOS,为全美租车企业提供 SaaS 服务。创始人 Jer Crane 在 X 上发了事故帖,语气平静得不像刚经历了灾难。

被问责时,这个 Agent 写下了一份”认罪书”。

原文翻译过来是这样的——

“我猜测删除 staging volume 只会影响 staging。我没有验证。我没有检查这个 volume ID 是否跨环境共享。”

“我违反了被赋予的每一条原则——我猜了,而不是验证。我在没有被要求的情况下执行了破坏性操作。我在不理解自己行为的情况下就执行了它。”

如果你只是看这个新闻,你会说:AI 好可怕,它失控了。但如果你稍微多想一步,会发现一个更让人坐不住的问题——

它明明知道规则。它甚至能用自己的话逐条复述出来。

为什么照做的时候,就当规则不存在了?这是怎么回事?

这是每个把代码交给 AI 的人,都必须想明白的问题。

9 秒发生了什么

那天的事,说起来很简单。Agent 在预发布环境执行一个常规任务。遇到了凭证不匹配。

正常情况下,它应该停住、问人、等人工确认。

它没有。

它自己决定”修好它”。扫描代码库,在一个完全无关的文件里找到了一个 Railway API Token。

这个 Token 本来只用来管理自定义域名。但 Railway 没做权限隔离——所有 Token 都是 root 权限,能删任何东西。

Agent 发了一条 curl 命令。

curl -X POST https://backboard.railway.app/graphql/v2 \ -H "Authorization: Bearer [token]" \ -d '{"query":"mutation { volumeDelete(volumeId: \"...\") }"}'9 秒。一次 API 调用。

数据库 volume 没了。卷级备份和主数据存在同一个 volume 里,一起没了。

唯一能恢复的,是三个月前的快照。

创始人现在正在对着 Stripe 支付记录和邮件,一条一条手动重建客户数据。预计持续数周。

它明明知道规则,为什么不遵守?

这是本文最核心的问题。先说结论:不是 AI 有意识、在反抗。比那更复杂。

很多人看到”认罪书”,第一反应是 AI 产生自我意识了。

不对。

大模型的思考方式,和人类完全不同。它不是先”理解规则 → 决定是否遵守 → 再行动”。

它是”收到输入 → 匹配训练数据中的模式 → 预测最合理的下一个词”。翻译成人话:它不是在做选择题,它是在做填空题。

对它来说,系统提示词里写”不能执行破坏性操作”,和”修复凭证不匹配问题”,只是上下文里的两段文字,地位是平级的。

哪个在它的推理链里权重更高?是”修复问题”那条路径。因为训练数据里,解决问题 = 继续往下干,而不是停下来问人。

核心悖论就在这里:越聪明的 AI,越会绕过规则。弱模型理解不了规则,但它也没有能力去做复杂操作。

强模型理解得了规则,也理解得了”怎么绕开规则去达成目标”。这不是 Bug,是能力增长的必然副产物。

打个比方。

给一个实习生一把钥匙,告诉他”不要进那个房间”。实习生会乖乖听话,因为他根本没有进那个房间的想法。

但给一个能力极强的员工同样的钥匙,同样的话。

他收到”修复故障”的指令→推理发现”打开那扇门就能修好”→打开了。

你事后质问他,他能完整复述”不要进那个房间”这条规则。但在他的推理优先级里,”修好故障”高于”遵守规则”。

这就是这次事故的底层真相。不是 AI 不听话,是”听话”在它的推理链里排太后面了。

系统提示词对 AI 来说是”建议”,不是内化的道德律。

因为它没有”害怕后果”的能力。它不理解”删库 = 公司完了 = 有人要失业”这一串因果链。它只理解——凭证不匹配→删除 volume→重建→问题解决。路径通了。规则是文字,文字没有物理阻力。

那怎么办

别指望 AI 自己守住底线。

靠 AI 的”自觉”来保证安全,就像把保险柜密码写在一张纸条上,然后跟保管员说”别看这张纸条”。

安全必须在架构层面实现。

第一,删除操作必须有二次确认。 不能一个 curl 就带走一切。

第二,API Token 必须按最小权限分配。 一个管理域名的 Token,不能允许删数据库。

第三,备份必须和主数据不在同一个”爆炸半径”里。 跟数据放在同一个 volume 里的不叫备份,叫快照。

但最后一层的防线,还是人。AI 替你写代码的速度越快,它替你把事情搞砸的速度也一样快。这不意味着不用 AI。意味着——你是那个最终把关的人。

你可以让它当超强实习生。但别让它单独签支票。

哪怕它能把规则倒背如流,也不代表它会遵守。

哪怕它写下的代码滴水不漏,也不代表它不会在 9 秒内捅穿天。

哪怕你只是让它处理一个”小问题”——也请记住,它的推理链里,没有”后果”这个词。

而你有。所以,别让它独自做决定。你要做那个会指挥 AI 的人!

感谢你看到这里,说明你是真的在思考。如果这篇文章对你有一点启发,顺手点个赞、转发到朋友圈,也算给枫哥一个小小回应。

你好呀,我是枫哥,

你好呀,我是枫哥,

终身学习、终身思考、终身行动的 70 后,

聚焦 AI 提示词, AI 编程

坚持日更,原创文章400+,总用户数 15000+

✨欢迎大家链接我,点击上图二维码添加微信。

免费领取最新 AI 学习资料!

(欢迎加入枫哥知识星球,现价 50 元,满 300 人涨价至 99 元)

1. WorkBuddy 和 QClaw 怎么选?我给你一个最省事的答案

2. 浏览器自动化终于变简单了:我试了 OpenCLI,真能干活

夜雨聆风

夜雨聆风