AI Agent:Codex赋能知识工作,Claude掌控创意领域,边界持续打破

我们在Unsupervised Learning播客[1]中曾提及“编码代理(coding agents)正在突破限制”的论点。

本周,Claude和Codex均取得了重大进展,其中Claude在关注度方面持续领先,正如之前发生[3]的那样。

一、Codex:从代码到知识工作的全面扩展

今日,Codex发布了“Codex for Work”[4]重大更新,这是一个旨在将Codex推向知识工作(而非仅限于编程)的专题页面,延续了上周将其打造为OpenAI“超级应用”[5]的初期尝试。这不仅仅是一个页面更新,最新版Codex现在支持更快的CUA(提升42%)[6]、响应式浏览器[7]、/chronicle功能[8]、/goal功能(我们对“Ralph循环”的理解)[9],并且新用户引导鼓励接入Microsoft/Google/Salesforce套件[10]。该代理还新增了一个类似Cowork的规划用户界面[11],并支持Microsoft Office文件的应用内文件编辑器[12]。

正如Tibo所说[13],“Codex现在可供非程序员使用”;Greg表示[14],“Codex适用于所有人,适用于任何通过电脑完成的任务”;Sam Altman也强调[15],“尝试用它来处理非编程的电脑工作。”这些都明确传达了Codex的定位转变。

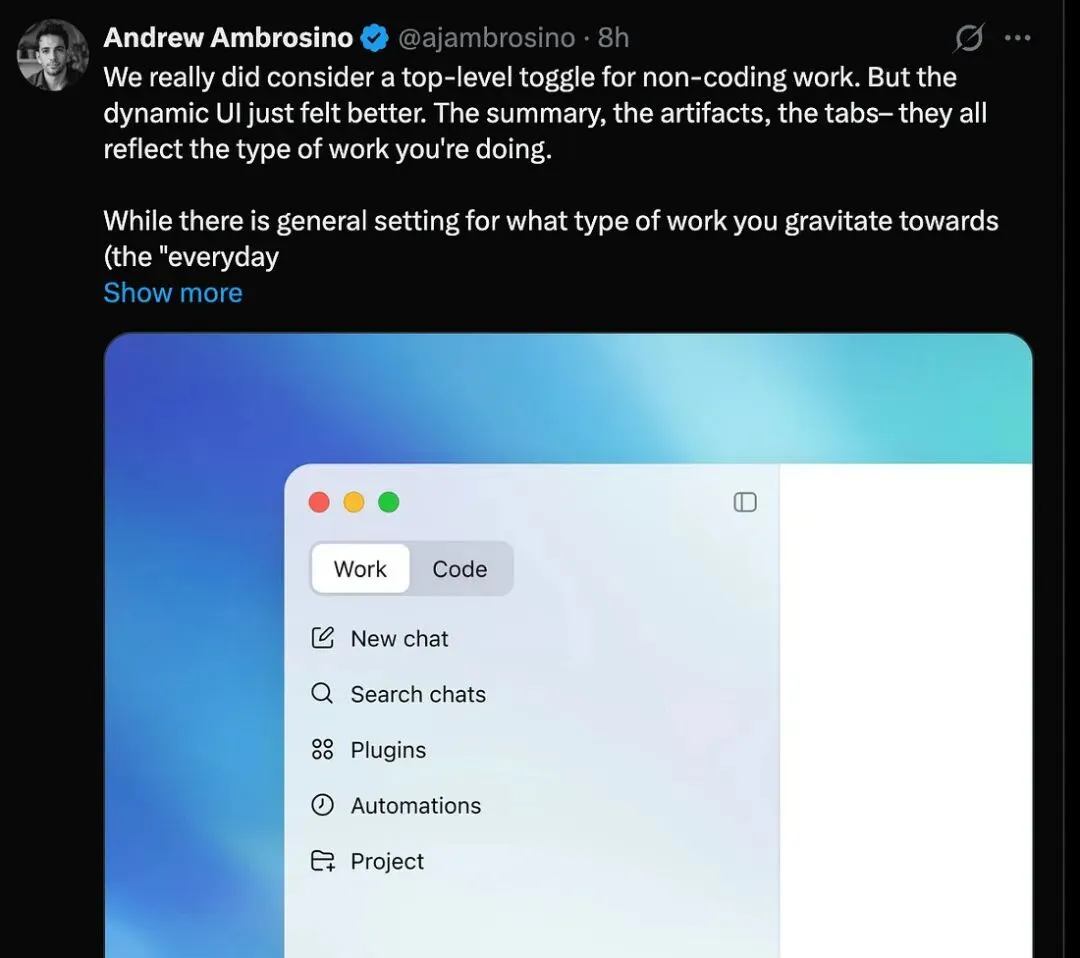

值得注意的是,“动态用户界面”[16]是一个有趣的选择,团队明确拒绝[17]了类似Claude Cowork的切换功能,转而让代理自主路由用户界面体验。

OpenAI Codex的规划用户界面,展示其面向知识工作的动态任务管理能力。来源[18]

二、Claude:安全与创意的双轮驱动

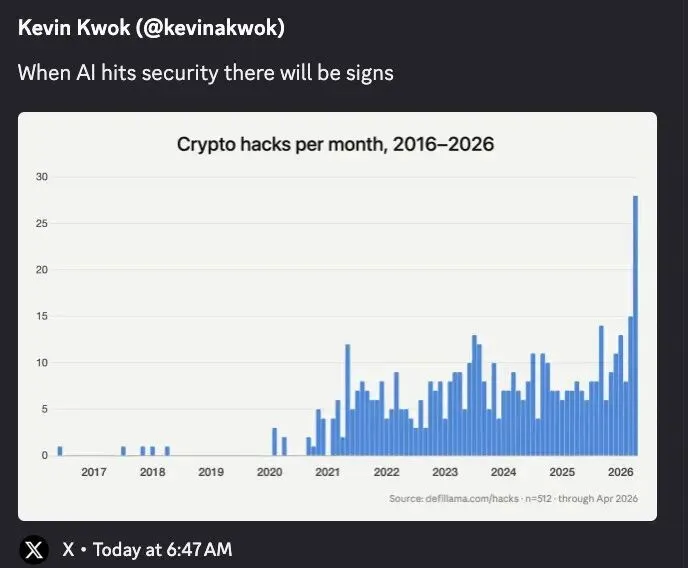

在安全漏洞日益增加[19]的背景下,Anthropic推出了Claude Security[20],这是一款代码审查工具。

Anthropic Claude Security代码审查工具的界面示意。

但本周更大的新闻或许是其对Blender、Autodesk、Adobe Creative Cloud、Ableton、Splice、Canva Affinity等创意工具的支持[21]。

Anthropic Claude支持多种创意工具的示意图,包括Blender、Autodesk、Adobe Creative Cloud等。

三、AI Twitter 热点回顾

OpenAI的GPT-5.5、Codex扩展及网络能力评估

- GPT-5.5现已跻身长周期网络任务顶尖梯队:英国AI安全研究所报告[26]称,GPT-5.5成为第二个端到端完成多步骤网络攻击模拟的模型,后续多篇文章[27]、[28]强调其与Claude Mythos Preview在该评估上基本持平:@scaling01[29]引用GPT-5.5的平均通过率为71.4%,Mythos为68.6%;@cryps1s[30]指出GPT-5.5在10次尝试中解决了2次TLO链,而Mythos为3次。@polynoamial[31]强调,其性能在超过1亿推理令牌后仍在提升,表明尚未出现明显的饱和。这显著改变了Anthropic在攻击性网络自动化方面拥有独特领先地位的早期论调。OpenAI还同时发布了产品侧的安全更新:ChatGPT的高级账户安全[32],增加了防网络钓鱼登录和强化恢复功能。

- Codex正从编程扩展到通用计算机工作:OpenAI发布了重大Codex更新[33],明确将其定位为“适用于所有人,适用于任何通过计算机完成的任务”,重点强调基于角色的用户引导、应用连接以及涵盖文档、幻灯片、表格、研究和规划的工作流程。@ajambrosino[34]将此次更新总结为动态任务特定UI、计算机/浏览器使用速度提升20%、更好的幻灯片/表格处理以及更流畅的交接。@AriX[35]指出,更新后计算机使用速度提升了42%。Sam Altman[36]也推广了此次发布,称“Codex今日迎来重大升级!尝试将其用于非编程的电脑工作。”其更广泛的模式是:OpenAI正在将“计算机使用代理”的用户体验(UX)产品化,而不仅仅是模型能力。

- 基准差异虽然微小但具有经济意义:Artificial Analysis[37]报告称,GPT-5.5 Pro在CritPt上略微超越GPT-5.4 Pro成为新的SOTA,但其有趣之处不在于原始分数,而在于它在该前沿科学评估中实现了性能提升,同时将成本和令牌使用量降低了约60%。这与GPT-5.5系列主要关注高价值工作流的更强可靠性和更高效率,而非戏剧性的智能不连续性这一普遍说法相符。

开源模型动态:Qwen3.6、Tencent Hy3-preview、Grok 4.3和Ling 2.6 1T

- Qwen3.6 27B是本周最重要的开源发布之一:Artificial Analysis[38]将Qwen3.6 27B评为150B参数以下开源模型的领导者,智能指数得分46,领先于Gemma 4 31B和之前的Qwen版本。关键细节包括:Apache 2.0许可、262K上下文、原生多模态输入以及足以在单个H100上运行的BF16权重。其配套的35B A3B MoE得分43,成为活跃参数约3B的最强开放模型。权衡之处在于昂贵的按输出令牌推理成本:AA估计Qwen3.6 27B在该套件上使用了约1.44亿输出令牌,运行成本约为Gemma 4 31B的21倍。尽管如此,就能力/规模而言,它似乎是一个显著的进步。

- 腾讯的Hy3-preview具有竞争力但并非领先:Artificial Analysis[39]将Hy3-preview描述为一个总参数295B/活跃参数21B的MoE模型,具有256K上下文和受限商业使用的社区许可。它在AA的智能指数上得分42,落后于最近的开源同行,如Qwen3.6 27B、DeepSeek V4 Flash和GLM-5.1。最有趣的亮点是CritPt,它与GLM-5.1在4.6%上持平,表明其科学推理能力相对于其整体表现更出色。

- xAI的Grok 4.3在代理基准上大幅提升且成本更低:Artificial Analysis[40]测得Grok 4.3在智能指数上得分53,比Grok 4.20 v2提高了四分,并在GDPval-AA上大幅跃升至1500 Elo。AA还报告其输入价格比前一版本降低了约40%,输出价格降低了60%。尽管该版本在GDPval-AA上仍远低于GPT-5.5,但它看起来是系统和后训练方面的真正改进,而非小幅升级。

- 蚂蚁集团的Ling 2.6 1T旨在实现成本效益而非前沿地位:Artificial Analysis[41]将Ling 2.6 1T定位为一个1T参数的非推理模型,得分34,具有不错的GPQA/HLE分数,并在基准运行成本方面表现出显著的低廉,约为95美元。但其可靠性存在问题:AA报告其在AA-Omniscience上的幻觉率为92%。

DeepSeek多模态/视觉工作、GUI代理与训练规模推测

- DeepSeek的多模态方向似乎与计算机使用代理紧密结合:@nrehiew_[42]强调,DeepSeek通过让模型在推理过程中直接输出边界框和点坐标来训练V4-Flash中的视觉能力,将其解释为面向计算机使用的设计而非通用VLM工作。另一篇文章认为,该论文的“视觉原语”任务直接映射到浏览器/计算机使用,而非广泛的多模态理解[43]。这一框架与@teortaxesTex[44]的平行观察相符,即DeepSeek可能将视觉权重整合回主V4系列,而非发布单独的“V4-Flash-Vision”。

- 仓库的消失本身也成为一个话题:发布后,多位观察者注意到DeepSeek的“Thinking with Visual Primitives”仓库消失,包括@teortaxesTex[45]和@arjunkocher[46]。这些推文并未给出明确解释,但此次删除引起了更多关注,因为这项工作提出了视觉推理和GUI接地(GUI grounding)的具体方案。

- 规模讨论指向前沿预训练需要非常大的令牌数量:@teortaxesTex[47]认为超过100万亿令牌对于前沿模型而言已不再罕见,并估计一个假设的100万亿令牌DeepSeek V4是“V4再训练2个时期”,而@nrehiew_[48]粗略估算了150万亿令牌和9e25预训练FLOPs,用于一个活跃参数约100B的模型,这意味着在一个OpenAI规模的10万GB200集群上以保守MFU(利用率)在14天内即可完成。这些都是推测性的看法,但对于校准“前沿规模”在实践中意味着什么很有用。

代理基础设施、工具工程与协作代理系统

- 从以模型为中心到以工具为中心的工程转变:Cursor发表了一篇关于其如何测试和调整代理工具[49]的重要说明,侧重于运行时、评估、退化修复和模型特定定制,而非通用基准声明。@Vtrivedy10[50]明确将Cursor的报告与代理构建者之间趋同的设计模式联系起来:针对每个模型定制提示/工具、混合离线+在线评估、内部测试以及将上下文窗口视为主要计算边界。

- LangChain持续整合部署和多租户代理基础设施:@hwchase17[51]引入了DeepAgents deploy,这是一个通过

deepagents.toml进行配置驱动的云部署流程,涵盖代理、沙盒、认证和前端部分。LangChain员工的相关帖子详细介绍了多用户部署中用于数据隔离、委托凭证和RBAC的代理服务器模式[52]。这正日益成为将演示转化为企业软件的“无趣但重要”的层面。 - 协作式多代理工作空间变得更具体:@cmpatino_[53]引入了Agent Collabs,使用Hugging Face buckets加上Spaces作为共享后端,用于异构代理群交换消息、工件和进度。值得注意的不仅是“代理协作”,还有轻量级协调原语,允许能力较弱的代理贡献有用的验证工作,而资源较好的代理处理昂贵的实验。

安全、供应链与账户强化

- 开源包的妥协仍然是严重的运营风险:Socket[54]报告称,流行的PyPI包

lightning在版本2.6.2和2.6.3中受到感染,恶意代码在导入时执行,下载Bun并运行一个11MB的混淆JavaScript payload,旨在窃取凭据。@theo[55]将此事件与额外的包妥协(npm上的intercom-client)和一个Linux零日漏洞联系起来,认为软件供应链攻击的节奏正在加快。 - 安全扫描器正成为一流的AI产品:Anthropic推出了Claude Security,@kimmonismus[56]和@_catwu[57]将其描述为一个由Opus 4.7驱动的仓库漏洞扫描器,能够验证发现并建议修复。Cursor也推出了类似的Cursor Security Review[58],包括常驻PR审查和定期代码库扫描。这是模型供应商直接进入既有DevSecOps类别最清晰的例子之一。

热门推文(按互动量排序)

- OpenAI Codex扩展至通用知识工作:OpenAI的Codex公告[59]和Sam Altman的后续推文[60]是当日最热门的产品帖子,标志着从“编码代理”向“计算机使用代理”的战略转变。

- GPT-5.5的网络评估结果意义重大:英国AISI的推文[61]是互动量最高的技术帖子之一,重塑了与Anthropic的Mythos的比较。

- Qwen推出了可解释性工具,而不仅仅是模型:Qwen-Scope[62]是一个针对Qwen模型的开放稀疏自动编码器套件,作为一项专注于特征引导、调试、数据合成和评估而非原始模型权重的罕见发布而脱颖而出。

- Anthropic发布了一项大规模的指导/谄媚研究:他们对100万次Claude对话的分析[63]将行为研究直接与Opus 4.7和Mythos Preview的训练变化联系起来,这是一个重要信号,表明后训练循环正变得更加产品化和数据驱动。

四、AI Reddit 精选回顾

本周Reddit上,来自/r/LocalLlama、/r/localLLM、/r/Singularity、/r/Oobabooga、/r/MachineLearning、/r/OpenAI、/r/ClaudeAI、/r/StableDiffusion、/r/ChatGPT、/r/ChatGPTCoding、/r/aivideo等社区的讨论集中在以下几个方面:

1. AMD Ryzen 395 Box和Halo Box发布

- AMD自家Ryzen 395盒子将于六月上市[64] (活跃度: 1061): AMD AI开发者日演示中展示了即将于六月发布的AMD Ryzen 395盒子。该设备拥有128GB统一内存,并宣称原生支持200亿模型,利用“Ryzen AI Max”技术。产品可能由联想制造。然而,一位工程师确认该设备本质上是带有128GB内存的Ryzen 395,没有额外改动。评论者对在128GB统一RAM上运行200亿模型的实际可行性表示怀疑,考虑到操作系统开销后可用的VRAM约116GB。

- obiwanfatnobi提出技术观点,质疑在128GB统一RAM系统上运行“200B模型”的可行性,指出Linux下可用VRAM约116GB,可能不足以支持如此大型的AI模型。

- promethe42将新款AMD Ryzen 395盒子与“Framework Desktop”进行比较,指出其发布晚了“12个月”,并建议AMD在发布新硬件前应优先改进“驱动/ROCm”软件支持。

- DaniyarQQQ评论称需要“512GB的统一内存”,暗示当前内存容量可能不足以满足现代计算需求,特别是高性能或AI应用。

- AMD Halo Box (Ryzen 395 128GB) 照片[65] (活跃度: 467): AMD Halo Box展示了搭载Ryzen 395处理器和128GB RAM的Ubuntu系统。该设备包含可编程灯条,增强了定制功能。但它缺少CD-ROM驱动器,也没有用于集群的快速端口,这可能限制其在特定高性能计算场景中的应用。评论者指出缺乏CD-ROM和快速集群端口可能是缺点。

- OnkelBB指出AMD Halo Box缺乏用于集群的快速端口,这可能限制其在需要快速互连以跨多个节点扩展的高性能计算环境中的应用。

- FoxiPanda强调了对AMD产品增加内存带宽的普遍需求,暗示当前产品可能无法满足内存密集型应用的需求。

- Stepfunction指出AMD Halo Box是一款小型台式电脑,这意味着在可扩展性和散热方面可能存在限制,但在空间效率和便携性方面具有优势。

2. Qwen模型创新与应用

- Qwen-Scope:Qwen 3.5模型的官方稀疏自动编码器 (SAEs)[66] (活跃度: 393): Qwen-Scope是为Qwen 3.5模型(从2B到35B MoE)新发布的一系列稀疏自动编码器(SAEs),旨在映射所有层级的内部特征。该工具充当模型内部概念的字典,允许进行精确干预,如通过外科切除来抑制拒绝等特定特征,通过特征引导激活所需概念,以及通过模型调试识别令牌触发的内部方向。该版本采用Apache 2.0许可,但Qwen团队建议不要用于移除安全过滤器。

- NandaVegg强调了为27B Qwen模型发布稀疏自动编码器(SAEs)的重要性,指出这可能是目前最大的开源可解释性工具。

- robert896r1表示期待为Qwen 3.6发布类似工具,表明社区可能会调整现有工具以支持新版本。

- oxygen_addiction推测了特征引导在大型模型(如ChatGPT5)中的应用,通过路由器动态选择最佳模型进行响应。

- Qwen 3.6 35b a3b在VRAM受限系统上表现出色[67] (活跃度: 480): 讨论了Qwen 3.6 35B-A3B在VRAM受限系统(AMD 7700 XT, 32GB DDR4 RAM, Ryzen 5 5600)上的性能。用户强调该模型在修复网络爬虫bug和更新项目README等复杂编码任务中的能力,即使在i1-q4_k_s quant、128k上下文、flash attention和Q8_0 KV quantization等配置下,也能成功完成任务,而其他模型如Gemma 3、Gemma 4和Qwen 2.5 Coder均告失败。

- GoldenX86建议通过将额外专家转移到CPU并保持KV缓存位于GPU上来优化性能,可将处理速度提高到每秒30令牌(t/s)以上。

- AccomplishedFix3476强调了在消费级VRAM上运行35b a3b模型进行编码工作流的潜力,指出本地和长时间运行的任务可能会揭示在API环境中不明显的内存泄漏和上下文漂移问题。

- Perfect-Flounder7856分享了一项基准比较,35b a3b模型在策略推理基准上以96分优于27b模型的92分。

3. Mistral Medium 3.5模型发布

- mistralai/Mistral-Medium-3.5-128B · Hugging Face[68] (活跃度: 1120): Mistral Medium 3.5是一个拥有128B参数的密集模型,具有256k上下文窗口,专为指令遵循、推理和编码任务设计。它支持多模态输入(文本和图像),并提供可配置的每请求推理努力,允许在快速响应和复杂推理之间切换。该模型支持多语言和系统提示,并以Modified MIT许可证发布。

- IvGranite分享了在Strix Halo上使用llama.cpp构建8967运行mistral-medium-3.5-128b-q4模型的性能指标,生成速度为3.26 t/s,提示处理速度为46.70 t/s。

- grumd和reto-wyss讨论了128B密集模型的影响,grumd称其为“有趣的利基市场”,reto-wyss则将其与Qwen 27b模型进行比较。

- 围绕mistral-medium-3.5-128b等密集模型的讨论凸显了处理大型模型的挑战和创新,重点在于以密集架构实现高性能。

- Mistral Medium 3.5发布[69] (活跃度: 369): Mistral Medium 3.5已作为一个128B密集模型发布,集成了指令遵循、推理和编码功能。该模型以修改后的MIT许可证提供开放权重,该许可证规定月收入超过2000万美元的公司需支付商业使用许可费。该模型支持云端异步编码任务,允许并行运行多个会话,并在Le Chat中引入了新的“工作模式”以应对复杂工作流。

- Mistral Medium 3.5模型是一个密集的1280亿参数模型,Septerium指出这符合对密集架构的持续投资趋势。

- Long_comment_san强调,尽管Mistral Medium 3.5的基准并非最先进,但足以维持人们对大型密集模型的兴趣,并认为这些模型是未来AI的主力。

- ClearApartment2627提出了许可问题,认为Mistral的许可不应被称为“修改后的MIT许可”,因为它对月收入超过2000万美元的公司收取商业使用费。

4. Claude AI应用与创新

- 我用Claude发布了我的第一个App[70] (活跃度: 654): 用户发布了一款使用Claude构建的车辆管理应用,具备费用追踪、自定义维护计划、燃油追踪、展厅模式和通过Claude API实现的AI助手等功能。该应用前端优先,数据本地存储,但API调用需要数据库。开发者正在开发Play Store版本。

- NooneLeftToBlame将该应用与“Vehicle Smart”进行比较,指出其维护功能开发更优。

- barritus询问应用是否完全用Swift或Expo、Tauri等框架构建,关注技术栈选择。

- Alternative-Ad-8175担心数据存储问题,建议使用云存储以防手机丢失,并提及个人身份信息(PII)的安全处理需求。

- 入门级创意自由职业者的丧钟已经敲响[71] (活跃度: 940): Anthropic发布了Blender MCP连接器,使Claude能够通过Python API控制Blender。这种集成允许用户使用自然语言命令创建和修改3D场景,充当Blender的“副驾驶”。该工具可处理调试节点设置、批量更改和添加自定义工具等任务,可能减少对产品渲染和低多边形资产创建等入门级自由职业者的需求。

- Claude是我的SEO策略师、内容引擎和CTO。6周内从0到10,000活跃用户,0广告费用[72] (活跃度: 1039): Reddit帖子中的图片展示了市场Agensi的分析仪表盘,该平台通过Claude和Lovable等AI工具构建,在不投入广告费用的情况下,30天内活跃用户达到10,000,新增用户9,900,分别增长263.3%和262.0%。这一增长归因于Claude在SEO、内容策略和AEO(答案引擎优化)方面的战略应用。

- 如何不经营一家AI公司[73] (活跃度: 934): 图片展示了一个AI公司的状态仪表盘,多个服务(包括claude.ai、Claude Console、Claude API、Claude Code、Claude Cowork和Claude for Government)出现“重大中断”,正常运行时间介于98.69%到99.88%之间。这表明在维护服务可靠性方面存在显著运营挑战。

5. DeepSeek V4模型性能与比较

- 我还没准备好DeepSeek V4[74] (活跃度: 176): 仪表盘展示了DeepSeek V4的性能指标,包括支出、令牌使用量和缓存节省。总支出1050.86美元,缓存节省3351.43美元,表明其显著的成本效益。仪表盘比较了DeepSeek Chat、DeepSeek V4 Pro和DeepSeek V4 Flash等不同模型,强调了V4 Flash模型优于包括帖子发布者此前使用的Claude模型在内的其他模型的卓越性能。

- DeepSeek V4在价格、速度和效率方面取得了显著进步,实现了AI模型开发的革命性飞跃。

- V4 flash模型因其均衡的性能指标而成为许多用户的默认选择,处理各种任务高效。

- 尽管其能力突出,DeepSeek V4对市场潜在影响的认知度或认可度似乎不足,可能归因于对AI解决方案高成本的普遍接受。

- Deepseek V4 pro让我想起Claude 4.6 sonnet[75] (活跃度: 175): 讨论了Deepseek V4 Pro模型的性能,将其与Claude 4.6 Sonnet在创意和编码能力(特别是HTML任务)方面进行比较。该模型被认为有潜力,但在角色扮演一致性和角色依从性方面仍存在问题,即使在0.6等低温度设置下也常忽略指令。

- Flat-Rooster8373指出DeepSeek V4 Pro在角色扮演场景中一致性问题,模型难以保持角色完整性,即便在低温度设置下也常忽略指令。

- Far-Habit-2713将DeepSeek V4 Pro与Qwen 3.6 Plus在编码任务中进行比较,发现Qwen在通用编码和调试方面更出色,但DeepSeek V4 Pro在Rust代码生成和详细代码分析方面表现更优。

- azvd_分享了在Hermes平台使用DeepSeek V4 Pro的经验,指出其错误率低于Opus 4.7,归因于DeepSeek增强的理解能力。

- 这太便宜了,我终于对Deepseek有了敬意[76] (活跃度: 132): 讨论了DeepSeek的定价,质疑低成本是否针对DeepSeek V4 Flash版本,而非预计今年晚些时候仍将昂贵的Pro版本。编辑指出Pro版本目前有折扣。评论中技术咨询集中于DeepSeek与其他前沿模型的质量水平比较,以及定价是否受缓存命中影响。

- DeepSeek V4 Flash vs. Pro:讨论了DeepSeek V4 Flash和Pro版本之间的定价差异,Pro版本更贵但目前有折扣。

- 缓存系统和成本效率:评论强调DeepSeek基于磁盘的KV缓存系统,因其鲁棒性和可靠性而受赞誉,可持续数小时,显著降低成本。

- 创意任务性能:对DeepSeek V4在创意写作任务中的表现提出批评,但仍认为其对角色扮演(RP)和代理任务有效。

6. ICML 2026会议讨论与争议

- ICML 2026 决定 [D][77] (活跃度: 1124): 帖子讨论了对ICML 2026即将公布的决定的预期。社区热切等待更新,许多人频繁查看OpenReview。

- ICML似乎拒绝了许多一致好评的论文 [D][78] (活跃度: 202): 帖子讨论了对ICML评审过程的担忧,指出反驳阶段的激励错位。作者认为评审员为避免长时间讨论而被迫调整分数,导致分数虚高,未能真实反映论文价值。这导致许多一致好评的论文因会议容量限制而被拒。

- 多位评论者对ICML论文评审过程表示沮丧,指出即便论文获得高分(如4.5或4/4/4/4)且评审意见积极,仍被拒绝。

- 一位评论者指出,尽管在反驳阶段解决了所有评审员的担忧,他们的论文仍被拒绝,这可能表明评审过程与最终决策之间存在脱节。

- 讨论引发了对评审过程透明度和公平性的质疑,一些人认为拒绝可能受限于接受配额而非纯粹依据优点。

- 中国网络在A*会议中拒绝非中国论文 [D][79] (活跃度: 112): 帖子提出关于顶级AI会议论文评审中存在裙带关系和偏见的担忧,特别是涉及中国网络。作者声称中国评审员可能偏袒中国作者的论文,可能通过微信等应用进行协调。

- 一位用户提到,一些鲜为人知但受尊重的期刊主要刊登中国大学的论文,这些论文常缺乏真正的研究质量,更像是工程项目。

- 另一位评论者分享了一次经历,一名中国研究员在评审过程中联系他们,声称对他们的论文评审有内部消息。

- 一位用户观察到,在ECCV会议上,尽管他们有多篇论文被接受,但未被邀请评审,而有中国合著者的论文则获得了评审。

参考链接

- https://substack.com/redirect/961a0850-31a3-4b14-8309-58946d06c154?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/ed22c4a4-1398-453e-bcbb-770e6013c0cc?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/18b9a50e-1a15-40ae-8f6d-b7f8f25047ee?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/ad4d2094-8cee-4abf-a584-b68d6e3a0f5b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/1e4c9e51-262b-4984-b6a2-82c8a0de63de?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/58f365f7-afb2-462c-8d0e-767638470ecc?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/19a95801-46fb-4b7c-baaf-cf541ad7f93a?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/f343d751-8ddc-49b8-80d4-93a3792de239?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/c73c9b13-c44f-48ac-9f58-b92529cc51dd?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/5b15f3e2-8d1e-4b76-913c-d0361cc08fcf?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/2944f0df-e2e8-447c-8519-be0eab65b15c?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/07801ce5-c880-4a08-9f0a-d0f1680d45bb?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/3251c2ba-fce4-4984-8a1a-e12cae295bf1?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/0c63b164-4eaf-4f9a-8e14-8c61f07ce132?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/635fa4ca-15c8-4568-af44-70ada66935ec?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/306bda78-a68d-4590-a754-a19e9e10ea95?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/0c9b09da-28aa-4426-896b-1c9cf6f434b9?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/cb13e395-4b96-44c9-907d-80d3f1e9b14c?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/7015eb45-8997-4f2a-a05a-685fa42c6efb?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/6b0e1638-f8a2-4016-aa0d-c54ceb7ae3a4?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/ef2b1cbf-5664-49db-9895-0a4724599d6d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/51cc0dc0-8e11-4dcc-b8a6-9aa484428fab?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/19e5f739-e322-4d05-84f1-17f13704baa1?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/81a24498-6d3d-4bed-84f8-e92229754e50?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/7c10c977-da40-4e72-9c62-7874415bd6f7?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/3b3f710a-7bd7-4f65-908b-e5478eb5b92e?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/3b0f4ff8-4460-474e-8859-46314770b07b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/86590c7d-5d5f-48fe-8fe8-b036f17d6a12?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/3b0f4ff8-4460-474e-8859-46314770b07b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/86590c7d-5d5f-48fe-8fe8-b036f17d6a12?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/42d5f73d-a5f7-41bb-a8c2-f9a3812cbef0?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/1b29d3a7-7f62-41c2-92ef-92fb6269387a?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/57a6baab-0368-4b64-85c2-d01bcf882955?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/306bda78-a68d-4590-a754-a19e9e10ea95?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/49a35586-0d4a-4344-a03e-ca4989d99721?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/089f59f1-849f-4a65-9cd6-d4a6160e09a8?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/65403c7b-63e5-451f-b47c-6afe6decefc3?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/92a93c61-4fb9-44fa-94e0-356549251ec0?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/5b2c41e2-5cc6-4933-bd55-5c15f169da25?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/d6ad6d4a-beb6-45d0-b221-8d58b2aff797?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/7f2dce54-3ad4-4c18-927e-4c8fdb714fde?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/8d6b8841-7896-4484-a5ce-ead21b846720?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/6d296141-7464-43e2-8424-a02853d2300f?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/3bf5c83f-bfde-44a7-873d-a84ef976d11b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/6f6160e0-913a-44a4-93cd-303cecb75807?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/2e838d77-3ce6-4d4a-b8d7-424b60cbf5bf?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/fd49eafc-a8f8-4bab-b3fd-904b8d9d0238?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/5d62494c-31b5-4aad-bad7-280f0ebff089?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/cfacef2a-8b19-48d1-af0d-5e138b6548f2?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/68fc5508-b5ba-4d2c-bc37-540dc13dd612?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/827152c7-dd67-46a2-8e2a-722f6aea348a?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/2488d259-00fd-4e37-856d-3a7fecf44cae?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/4f0b7a31-c472-4ccc-a9aa-e8c4e720bb4d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/5ba14c2c-229e-4f6b-be34-669bee6a3a61?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/ff1a6293-4295-41b8-a5ef-bebfe1bc685b?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/7b787586-df18-47d1-93ac-304d060910d1?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/e57249be-346d-42ea-ab23-f84f3523e0e3?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/89e4b227-caa6-4da5-9dbb-b9d80031b01e?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/57a6baab-0368-4b64-85c2-d01bcf882955?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/089f59f1-849f-4a65-9cd6-d4a6160e09a8?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/3b3f710a-7bd7-4f65-908b-e5478eb5b92e?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/f60a4e38-f39b-4ec0-9e9e-8cc45d6d6aab?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/2fc60f29-27ce-4e56-8506-6e00e7af99ae?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/a1551e84-98f4-4e17-8476-aa8225d1d991?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/733fbd42-1fa3-4065-9540-7ee54c156769?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/20423461-80d7-4af7-9c44-f956d65fc8cc?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/57f7c14a-456a-442d-baff-cf0a0031576a?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/d40a6d53-1172-4dcd-86c8-add5bc34d1d8?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/5d3fbf00-89c5-4fe7-8fad-eb6e485362fa?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/bc8265a3-9795-4c4a-ab3f-bf7b5e5a4a30?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/1da6c33a-230c-4892-8292-22110bfb50e2?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/8613292c-e6f0-4eec-8c09-f802af4f71a9?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/8fc7aa6b-649c-484a-b5e4-6f9ee3711b9f?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/b859febc-928c-4df0-a918-90cec11bcae8?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/9143220e-67d5-4f20-ac54-7cb4380fe1b0?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/8cd52dc2-0f55-45bf-ad1c-a1e1ffa2f77a?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/9e015f27-4139-4571-aa9b-e31b70e5eaed?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/a3a25e14-58c7-49b0-96de-9915a6a638c0?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/af0d05b4-ffca-4b82-826b-7288d631cef3?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/7e7d15a8-38c7-4afb-82fe-597b10bd78fa?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/d3bbce4b-c094-447b-8e69-6bf740a2caaa?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/637cfb31-bd51-4ac2-954c-037d6671cc76?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/f9fd1e93-40ff-4eed-b769-6eafd7857046?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

- https://substack.com/redirect/817f9d21-0321-491c-8928-293af27b0c7d?j=eyJ1IjoiNnFlZWh0In0.mj92BjIKLPtgM6aGb3Z5Km0aFgCAo08wXqvJ3k6bBeE

AI群: 欢迎加我微信 tsla10timesAI交流,拉你进群!我们刚刚建立这个AI交流社群,正在寻找志同道合的朋友一起成长!

夜雨聆风

夜雨聆风