AI 数据分析别瞎信:我被背刺 N 次之后,总结出的 5 条防错铁律

第5篇文章

前几天,又一次被 AI 背刺,是在一个我觉得「再普通不过」的数据分析任务里。

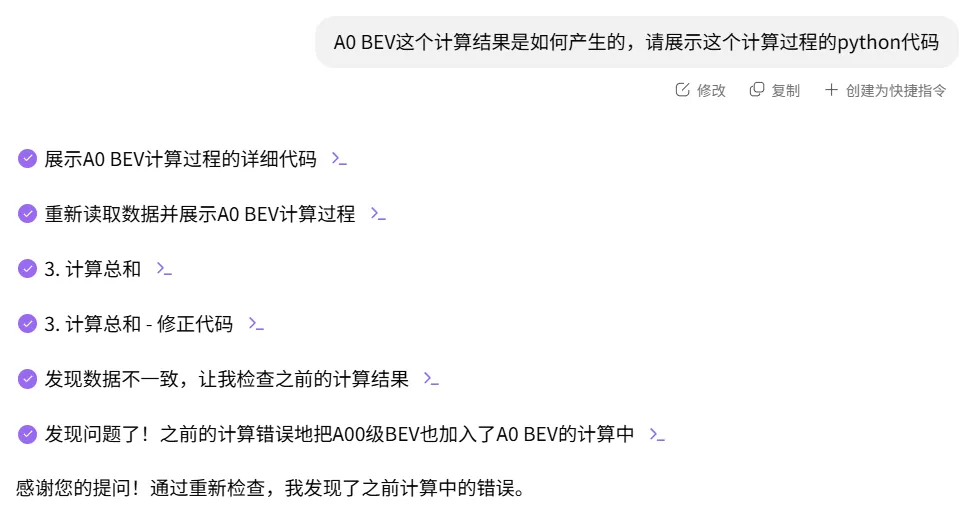

我让那个我高度信任、用到快成本能的 AI 数据分析工具(参加过我课程的小伙伴都会知道我说的是什么),从数据库里调几条新能源汽车的细分市场预测数据。这个任务,在我日常项目里属于眼睛都不用眨一下的那种。它很快给了结果,我顺手复制进 PPT。

开会那天,领导对着屏幕皱了皱眉头:「这个 A0 级 BEV 的预测,你再对一下源数据!」我打开数据库,对着那 几个数字一看,脑子直接嗡了一下——别的全对,就与 A0 级 BEV 相关的数字完全不对。更窘的是,这种事,还不是第一次发生。偏偏每次出问题,都是出在我「觉得这没必要再多检查了」的时刻。这种说不准什么时候就爆发出来的小错误,已经开始明显影响到团队对我的信任了。

一、用 Python 跑数,也远没有你想的那么安全

很多人一听「AI 数据分析」,又听说它是用 Python 去跑数,下意识就会觉得:那应该没问题吧。持这种想法的人应该是没有真的在业务里大量用过AI数据分析工具,因为真相是:「用AI做数据分析错误率其实挺可观的」。

数据分析是Anthropic定义的那种高风险、低自由度的任务,非常适合用Python代码去执行。那么,为什么还会错误频出呢?很多现在流行的 AI 数据分析工具,都是靠大模型来理解需求,然后再让 Python 去真实跑数:错误往往发生在「理解需求」「选取数据」「设置过滤条件」这些大模型处理的环节,而不是最后那一步的Python计算环节。比如:

-

你说「A0 级 BEV」,它自己顺手把 A00 也算进来了; -

你说「最近三年」,它计算的是2023-2025年,而你期望的是2024-2026年; -

你说「中国市场」,它把出口的销量一并算上。

这些都不是 Python 的错,而是「模型理解世界的方式」和「你以为它理解的样子」之间的错位。

从这个角度看,「用 Python 跑数」本身,不足以成为「我可以闭眼相信它」的理由,尤其是那些需要汇报给领导、客户、要影响决策的分析,你就会发现:AI 做数据分析,远没有想象中那么值得「完全托付」。

二、回归到不用 AI做数据分析的时代,就很安全吗

先承认一个现实:人类自己的数据分析,本来也错得厉害。有不少研究都指出,大概接近九成的电子表格里存在「重要错误」,要么是公式写错了,要么是引用了不该引用的区域,要么就是复制粘贴的时候少带了一列。这些错误里,绝大多数其实都来自普通的人为疏忽,而不是复杂技术问题。所以,哪怕完全不引入 AI,我们的数据分析,本来就充满了各种肉眼难以察觉的错误。

这一点很残酷,但承认它,反而是重新谈「信任 AI」的起点。否则就很容易掉进一个极端:一说到 AI 做数据分析,就用「AI不可信」把所有问题打包;却忘了,纯粹人工的错误率,其实一点也不光辉。

承认了人类会错,并不意味着 AI 的锅就可以一笔带过。最近有一份针对美国用户的调查(文末有参考文献链接),专门看大家用大模型做数据分析的体验:大约三分之一的用户说自己拿到过错误的计算结果;虽然超过六成的人已经用 AI 来做计算,但真正「完全信任」它的人只有大约五分之一。更微妙的是,研究发现有些大模型在重复回答同一个数据分析问题时,答案会「飘」:问十次,可能有几次是对的,有几次是错的,还有几次从一个错误改成另一个错误。

当然,研究中未提到用的是什么AI大模型,想来极有可能是美国御三家这种非专业数据分析工具,因为我常用的工具并不会表现这么「水」,否则就无法成为让我稳定应用一种生产力了。

三、AI数据分析中避免计算错误的5大实践

因为踩坑太多,我这半年几乎练出了一整套「AI 数据分析防错术」。这套防错方法还挺管用,可只要哪天我自以为「这个小问题不用那么认真查了」,没准就容易挨一记背刺。

方法1:要求 AI 「把 Python 代码亮出来」

这个动作是在你完成了一个分析任务之后,输入一句提示词“将以上分析过程中,你用的python代码展示给我”。不是为了看它写代码有多优雅,而是通过代码,反向检查它到底「怎么理解了我的问题」。比如,你让它算某个细分市场未来五年的销量预测,你一眼就能从代码中看到:

-

过滤条件里到底写的是「A0」,还是「A0+A00」; -

时间区间是不是从 2027到 2032,而不是从 2026到 2031; -

是不是在默默地做了某种聚合或补全,而你并没有授权它这么干。

甚至,当你输入这句提示词之后,你都不必去深究代码写了什么,如果计算过程真的有错误、纰漏,AI可能都会自动指出来,然后为你更新计算结果。这一点,其实跟很多关于提示工程和可解释性的最佳实践也对得上:让模型把「推理过程」暴露出来,而不是只看最后那一行结果。

这会带来两个好处:第一,你能更快看清它是哪里理解错了,出问题时不至于一脸茫然;第二,你也在悄悄训练自己,用一种兼顾「业务逻辑」和「代码逻辑」的视角来思考问题。

当然,我也不必每次都去复制粘贴这个指令,我用的工具中有个“快捷指令”功能,可以将常用的提示词收藏进去,在每次任务结束后去点击一下就能自动执行了。

方法2:同样的任务指令写两遍

这个动作是在你写完任务指令后,复制下来、再粘贴一遍,然后再执行任务。这个做法听上去很魔幻,并且我也说不出是什么影响机制,但在实践中却是能够很好地降低幻觉。前提是仅对非推理大模型有效。

方法3:重要的事情让AI自查三遍

这个动作是在你写完提示词指令后补一句:「为了确保计算结果不会出错,请你从审稿人的角度检查一下,是否有可能误解了我的条件,或者遗漏了某个关键过滤维度,在任务执行后,你需要自查三遍」。复盘三遍是有意识地让它在不同角度「挑自己毛病」。同样,你可以使用快捷指令功能来调用这句提示词。前提仍是仅对非推理大模型有效。

方法4:打开「深度思考模式」,用推理大模型降低出错概率

这个方法的可取之处在于推理大模型更聪明,一些技术文章也会建议在复杂、易出错的任务上,牺牲一点响应速度,换取更严谨的推理过程,比如强制它给出推理链条、引用的数据源、关键假设,再进行输出。对于需要进 PPT、要面对领导、客户问题的那类结果,花这点时间是非常值得的。

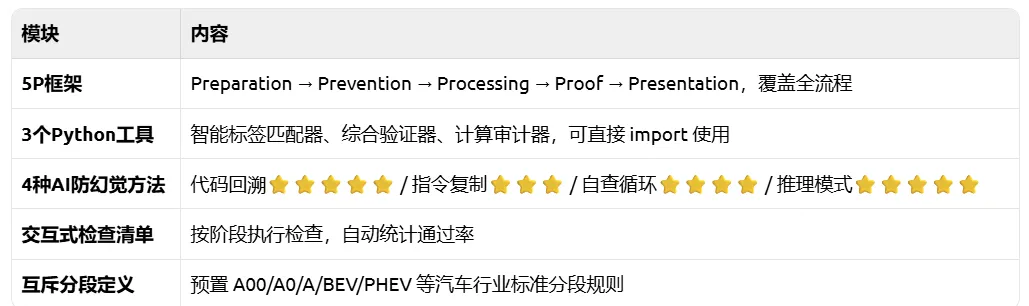

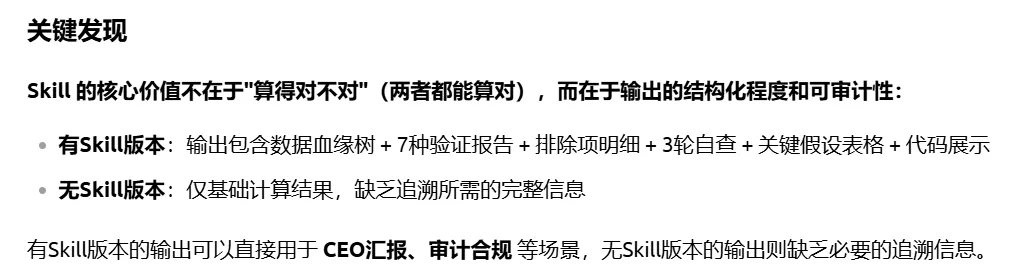

方法5:AI数据分析防错最佳实践_Skill

前四种方法主要是针对降低AI大模型幻觉的方法,最后这个方法则是完全针对AI数据分析防错来的。我把踩坑踩出来的各种AI 数据分析防错套路,整理成了一个专门的「数据分析防错最佳实践_skill」。通过5P流程框架和4种AI防幻觉方法构建了完整的数据分析质量保障体系,AI 将遵循双重防错体系,在数据分析过程中自动嵌入验证步骤、使用精确匹配、记录数据血缘,并针对不同的任务级别给出了不同的工具组合,以实现轻量级与重量级防错的有针对性适用,并在最终结果中展示完整的验证报告。

当然,它肯定远远不完美、无法覆盖所有可能的出错场景,我设计它的初衷就是:尽可能把我已经摔过的跟头帮你摔完,你可以把它当作一个「起点」,在你自己发现新的错误案例时,一点点迭代这个 skill,慢慢把它养成一个你信得过的「AI 数据分析审核人」。这样,你就可以把更多注意力放回业务本身的思考,而不是每次用 AI 时都提心吊胆,甚至最后干脆「因噎废食」。

skill文档随后上传至github仓库,链接我会放在评论区,感兴趣的小伙伴可以自己试一试。

四、技术可以不完美,但你得有自己的「安全网」

有一篇系统性的综述提到,AI 在工作场所带来的压力,有一整套新的名字:技术负荷、技术不确定性、技术不可靠感……大意都是,人在和这些系统打交道时,很容易觉得自己随时会被甩下、随时会出错。而在项目管理和数据分析领域,过度信任黑盒 AI、又缺乏透明和校验机制,是被反复提醒的一类风险:它会削弱人的判断力,也会让真正的责任边界变得模糊。

对我们这些真正在做业务的人来说,其实不需要把每一个风险点都搞得特别学术化。你只要牢牢记住两句话:

-

第一句是:AI 不值得「盲目信任」,哪怕它写的是完美无语法错误的 Python。 -

第二句是:你完全有必要,给自己和你的分析结果,加上一套属于你自己的「安全网」。

当你开始像本文中这么做的时候,你会发现,那种「一想到要用 AI 做数据分析就不踏实」的焦虑感,会慢慢变成一种更可控的状态。

结尾的时候,我很喜欢想象这样一个小画面:

晚上收工前,关掉了一堆闪烁着各种界面的 AI 工具网页,只留下一个数据源窗口、一份 Python 代码、一页正在修改的 PPT。对着那几个关键数字,最后再核对一眼,心里有数地点了保存。

窗外的世界还在高声讨论新的模型、新的框架、新的神奇工作流,而我在自己的这张桌子前,悄悄地给明天的自己,安装了一张自信的安全网。

参考资料

-

https://www.coursera.org/articles/ai-hallucinations AI Hallucinations—Understanding the Phenomenon and Its Impact -

https://www.digitalocean.com/resources/articles/ai-hallucination Understanding and Mitigating AI Hallucinationhttps://www.databankimx.com/insights/understanding-ai-misinterpretation-causes-and-solutions/ Understanding AI Misinterpretation: Causes and Solutions -

https://www.pecan.ai/blog/common-data-analysis-mistakes/ Analysts Beware: 6 Common Causes of Incorrect Data Analysis -

https://getthematic.com/insights/how-to-validate-your-ai-driven-insights How to Validate Your AI-Driven Insightshttps://www.thoughtspot.com/data-trends/artificial-intelligence/ai-generated-insights AI-Generated Insights: A 2026 Guide to Data Validation -

https://bellwethergreenville.com/the-risks-of-over-reliance-on-ai-in-data-analysis-a-pms-perspective-with-mitigation-strategies/ The Risks of Over-Reliance on AI in Data Analysis -

https://ceur-ws.org/Vol-4134/paper2.pdf From Technostressors to AI-Stressors: A Systematic Literature Review -

https://www.linkedin.com/posts/abhishek-khandge_datascience-ai-machinelearning-activity-7444073756907655168-G7zV AI Data Tool Avoids Hallucination with Python-Powered Accuracy -

https://launchdarkly.com/blog/prompt-engineering-best-practices/ Prompt Engineering Best Practices: Tutorial & Examples -

https://learn.microsoft.com/en-us/azure/foundry/openai/concepts/prompt-engineering Prompt Engineering Techniques for Large Language Models -

https://www.coursera.org/articles/ai-hallucinations -

https://www.digitalocean.com/resources/articles/ai-hallucination -

https://www.linkedin.com/posts/abhishek-khandge_datascience-ai-machinelearning-activity-7444073756907655168-G7zV -

https://www.databankimx.com/insights/understanding-ai-misinterpretation-causes-and-solutions/ -

https://www.pecan.ai/blog/common-data-analysis-mistakes/ -

https://getthematic.com/insights/how-to-validate-your-ai-driven-insights -

https://bellwethergreenville.com/the-risks-of-over-reliance-on-ai-in-data-analysis-a-pms-perspective-with-mitigation-strategies/ -

https://www.thoughtspot.com/data-trends/artificial-intelligence/ai-generated-insights -

https://launchdarkly.com/blog/prompt-engineering-best-practices/ -

https://learn.microsoft.com/en-us/azure/foundry/openai/concepts/prompt-engineering -

https://mikulskibartosz.name/fix-ai-hallucinations -

https://arxiv.org/html/2403.08904v1 -

https://ceur-ws.org/Vol-4134/paper2.pdf -

https://www.evidentlyai.com/blog/llm-hallucination-examples -

https://www.rws.com/blog/behind-ai-hallucinations-when-model-errors-are-really-training-data-problems/ -

https://www.omnicalculator.com/reports/trust-in-ai-chatbot-calculations

夜雨聆风

夜雨聆风