AI 根本不用“学”:搞懂这 30 个词,你就超过了 90% 的人

这几年,AI 火得一塌糊涂,但说实话,大多数人都是”听了,但没懂”。

大模型、智能体、算力、参数、微调、多模态、RAG……这些词天天往耳朵里灌,结果越灌越懵。

这篇文章就一件事:用大白话,把 AI 最常见的 30 个核心概念一次说清。读完你会明白——AI 到底在搞什么,现在的大模型为什么突然这么强,它们是怎么”学”出来的?

01

先搞懂 AI 到底是什么

1. 人工智能(AI)

人工智能即Artificial Intelligence,是赋予机器类人智能的技术统称。这类智能涵盖识别、理解、推理、决策与生成等能力。AI并非单一模型或产品,也不止聊天机器人,而是囊括大模型、图像生成等多元方向的综合技术体系。

2. 机器学习(Machine Learning)

机器学习是AI核心方向。传统程序由人设定规则,机器学习让机器从数据自主习得规则。以垃圾邮件识别为例,传统依靠手动编写判断条件,机器学习通过海量样本训练模型自主区分,核心是模型从数据总结规律,而非固化规则。

3. 深度学习(Deep Learning)

深度学习是机器学习分支,更是十余年间AI爆发的核心动力。它依托多层神经网络,能从海量数据自主提取复杂特征,在图像、语音识别及自然语言处理等领域优势显著。机器学习是让机器从数据学习,深度学习则靠更深更复杂模型,挖掘抽象规律。

4. 神经网络(Neural Network)

神经网络是深度学习基础,灵感源于人脑神经元连接,并非真实复刻。它是多层信息处理系统,输入数据经逐层运算转换后输出结果。以图片识别为例,网络分层抓取边缘、五官等特征,最终完成判断,核心价值在于自动分层提取特征。

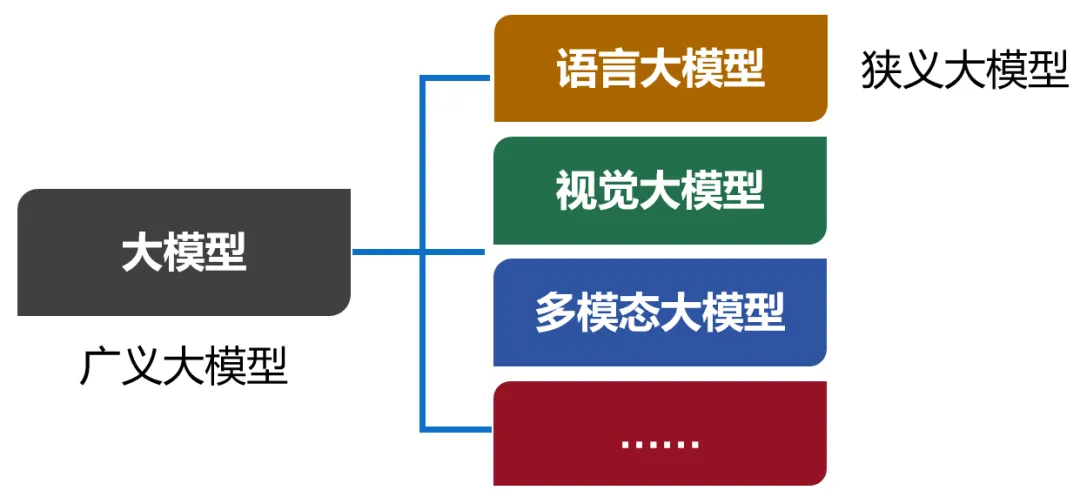

5. 大模型(Large Model)

大模型是参数庞大、经海量数据训练、泛化能力突出的模型。日常提及的大模型多为大语言模型,图像、视频大模型同样归属此类。其核心优势不止规模,更在于扩容后拥有小模型缺乏的理解、生成、迁移与协同等高阶能力。

02

为什么大模型这么强

6. 参数(Parameters)

参数是模型内部可学习数值,也是其承载世界规律的关键。训练即持续调整参数,优化模型输出结果。参数越多,模型理论表达能力越强,但并非越大越好,其潜力能否释放,取决于数据、训练方法与算力条件。

7. 数据集(Dataset)

数据集是模型训练所用数据集合,涵盖文本、图像、音视频等单一或混合形式,其质量决定模型能力上限与偏差根源。模型习得的从来不是真实世界,而是数据呈现的世界,数据中的偏见、错误与噪声,都会被模型一并习得。

8. 训练(Training)

训练是模型依托大量样本调整参数的过程。模型初始不懂标准答案,只会对比输出差异,借算法持续修正,如同学生刷题改错,逐步形成稳定能力。

9. 推理(Inference)

推理是模型训练后的实际使用阶段。输入内容后,模型依托已有参数生成输出,即为AI推理。它并非狭义逻辑推理,而是模型上线后的执行过程,好比训练是上学,推理则是考试与工作。

10. 算力(Compute)

算力是依托GPU、TPU等高性能芯片的核心计算资源,模型、数据与任务越复杂,算力需求越高。企业争抢GPU,正是因为算力不足会阻碍模型落地,更是AI时代的关键基础设施。

03

大模型是怎么工作的

11. 语言模型(Language Model)

语言模型核心是依托上下文预测下一词或token。该目标看似简单,却能让模型依托海量文本,拥有极强的语言理解与生成能力。它本质是超强续写系统,不靠完整认知表达,而是通过学习海量语言模式,形成近似理解的能力。

12. Token

Token是模型处理文本的基本单位,不等同于字或单词,可单字、片段、词汇或标点。理解token很关键,模型以其切分、编码与计算文本,上下文、成本及生成速度均与它直接相关。

13. 上下文窗口(Context Window)

上下文窗口是模型单次可处理的内容范围。窗口越大,模型能调取的文档、聊天记录、代码等信息越丰富,但窗口大不代表理解更深,仅代表接收内容更长,抓取重点的能力仍单独区分。

14. 提示词(Prompt)

提示词是给模型的输入指令,决定AI回复内容,可包含背景、格式、角色、示例等。和AI沟通不靠玄学,核心是输入设计;优质提示词能明确问题边界、任务目标与输出形式。

15. 提示工程(Prompt Engineering)

提示工程是围绕提示词设计的完整方法,涵盖任务明确、上下文补充、步骤拆分、示例提供与格式约束等,核心是稳定发挥模型能力,而非刻意诱导。模型升级后它不再神秘,但信息组织方式仍直接决定输出质量,依旧关键。

04

为什么大模型

绕不开 Transformer

16. Transformer

Transformer是现代大语言模型的核心基础架构,最初用以解决序列处理与长距离依赖难题。当下主流大模型大多基于它或其变体打造,更是推动AI发展的关键分水岭,奠定了现有大模型的规模与性能。

17. 注意力机制(Attention)

注意力机制是Transformer核心,能让模型动态聚焦文本关键信息。例如语句中,它可帮助模型精准判定代词指代关系。

18. 预训练(Pretraining)

预训练是大模型首要成长阶段,依托海量通用数据学习语言、知识与规律,形成宽泛的通识基础,为模型筑牢通用能力底座。

19. 微调(Fine-tuning)

微调是预训练后,以精准小数据续训模型,适配特定任务、行业与风格。通用模型虽通识全面,却难胜任法律文书等专业场景;借助领域数据微调,即可将通用模型转化为专业工具,核心就是让通才转变为专才。

20. 对齐(Alignment)

对齐是让模型输出贴合人类目标与使用预期的过程。强能力的模型未必行为合规,易答非所问或产出危险偏激内容。对齐核心不在于模型能否做到,而在于规范其行为、把控内容边界。

05

模型如何变得更懂人类意图

21. 强化学习(Reinforcement Learning)

强化学习依托奖惩机制优化行为,不靠标准答案,而是持续试错迭代最优策略。在大模型中,它可提升输出质量、贴合人类需求,兼顾结果正误与体验优劣。

22. 人类反馈强化学习(RLHF)

RLHF即基于人类反馈的强化学习,先由人类给模型回答打分对比,再将偏好反馈给模型,使其输出更贴合人类期待的内容。这让聊天模型不止能文本续写,更具备自然交流能力,精准贴合人类表达偏好。

23. 指令微调(Instruction Tuning)

指令微调依托海量指令-回答样本,使模型按人类需求完成总结、翻译、要点罗列、风格写作等各类任务。微调后模型不再局限于文本预测,转变为实用任务助手,大幅提升实际可用性。

24. 多模态(Multimodal)

多模态模型可处理文字、图片、音视频等信息并建立关联,仅能聊天的为单模态模型。未来AI竞争将侧重多模态理解与行动能力,而非单纯语言能力。

25. 智能体(Agent)

智能体是可感知环境、理解目标、自主规划并调用工具落地任务的AI系统,不止答疑,更能实际办事。

面对整理会议资料、撰写邮件这类需求,普通模型仅能提供建议,智能体却可拆解流程、处理文件、总结内容并起草文稿,实现AI从被动应答到主动执行的升级。

06

为什么模型看起来很聪明?却依然不可靠

26. 幻觉(Hallucination)

幻觉是模型一本正经编造错误信息、事实与数据,其最大隐患是内容极具迷惑性。模型核心只为生成合理内容而非求真,缺乏依据时便会编造通顺答案。

27. 知识截止(Knowledge Cutoff)

知识截止即模型训练数据存在时间边界,后续事件、新品与法规更新,模型往往无法知晓。这也是多数模型难答最新资讯、政策及版本变动的原因,其本质是依托历史数据生成的系统,无法实时对接现实世界。

28. 检索增强生成(RAG)

RAG即检索增强生成,核心是模型先检索外部资料,再结合内容作答,能减少幻觉、补充新信息、提升专业准确率,相当于为模型赋予开卷作答能力。

29. 嵌入(Embedding)

嵌入可将文本、图片等转为向量,语义相近内容的向量距离更近,支撑相似度搜索、语义检索与推荐。RAG 精准查找相关文档,核心依靠 embedding,也是内容理解与检索的关键纽带。

30. 泛化(Generalization)

泛化是模型应对全新任务、场景并稳定发挥的能力。优质模型不止局限于训练内容,更能迁移所学规律。大模型的惊艳之处,正是拥有跨任务迁移的泛化能力,而非机械记忆答案。但泛化存在局限,面对陌生、高风险及强实时性问题,模型容易出现偏差。

夜雨聆风

夜雨聆风