https://www.ollama.com

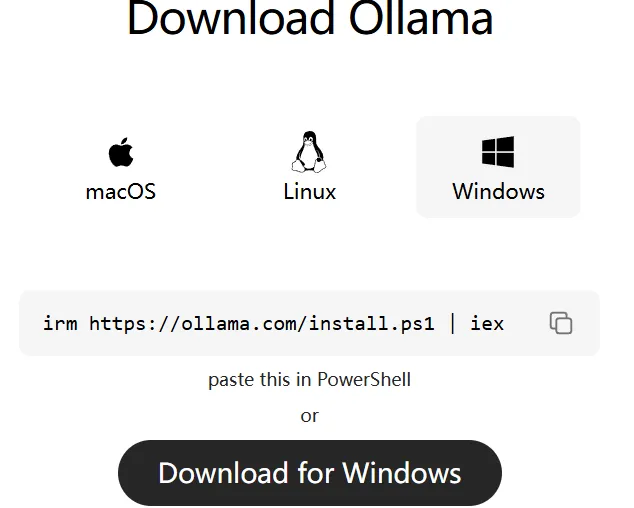

1、打开Ollama的主页,在右上角点击Download,根据自己的系统下载对应的Ollama客户端

PS:由于下载是链接到Github,有些国内地区无法访问Github,因此我提供了一个百度网盘链接:

通过网盘分享的文件:OllamaSetup.exe

链接: https://pan.baidu.com/s/10V783PXJt2mtFQXt6VGNFA?pwd=vyrm 提取码: vyrm 复制这段内容后打开百度网盘手机App,操作更方便哦

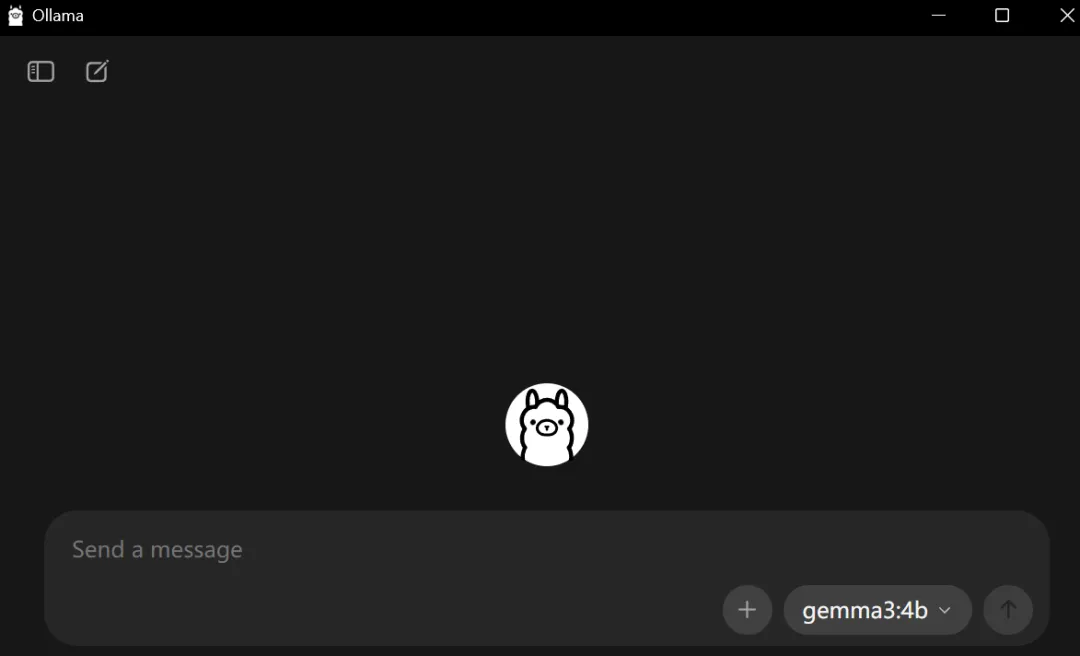

2、安装并没有什么难度,只需要下一步下一步即可完成,界面如下

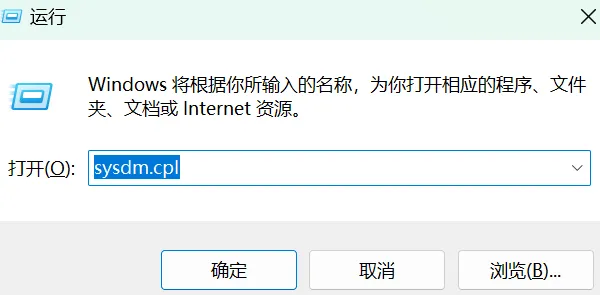

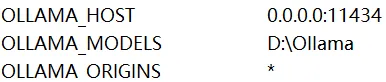

3、我们先不进行模型下载,而是要先进行环境变量设置,Win+R快捷键打开运行,输入命令sysdm.cpl

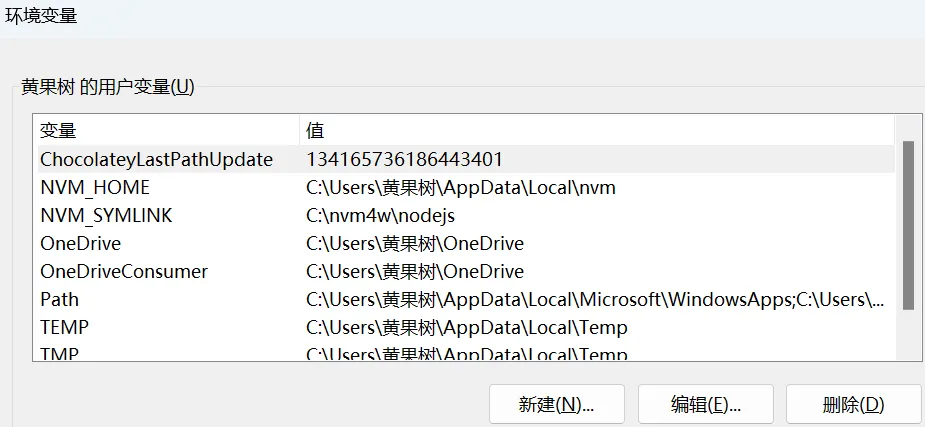

4、点击高级选项,点击下方的环境变量

5、在用户变量中,点击新建

6、添加如下3个变量名和值

OLLAMA_HOST | ||

OLLAMA_MODELS | ||

OLLAMA_ORIGINS |

这3个变量名称的意思分别是:

(1)OLLAMA_HOST设置0.0.0.0:11434,是允许其他电脑也能访问这个Ollama,如果不设置,只能本机访问。

(2)OLLAMA_MODELS设置D盘符,是因为Ollama的模型下载比较占空间,因此把模型下载到其他盘符中,防止占用系统盘空间。

(3)OLLAMA_ORIGINS设置*,是配置允许跨域请求来源列表,默认包含localhost,127.0.0.1,0.0.0.0等本地地址及一些特定来源。

变量添加完,点击确定,

7、如果设定了Ollama的模型到D盘,需要在D盘根目录下,创建Ollama目录。目录创建完,即设定好了模型下载的目录。如果只有C盘,那就在C盘根目录创建Ollama目录。我只有一个盘,因此我是设定在C盘中。

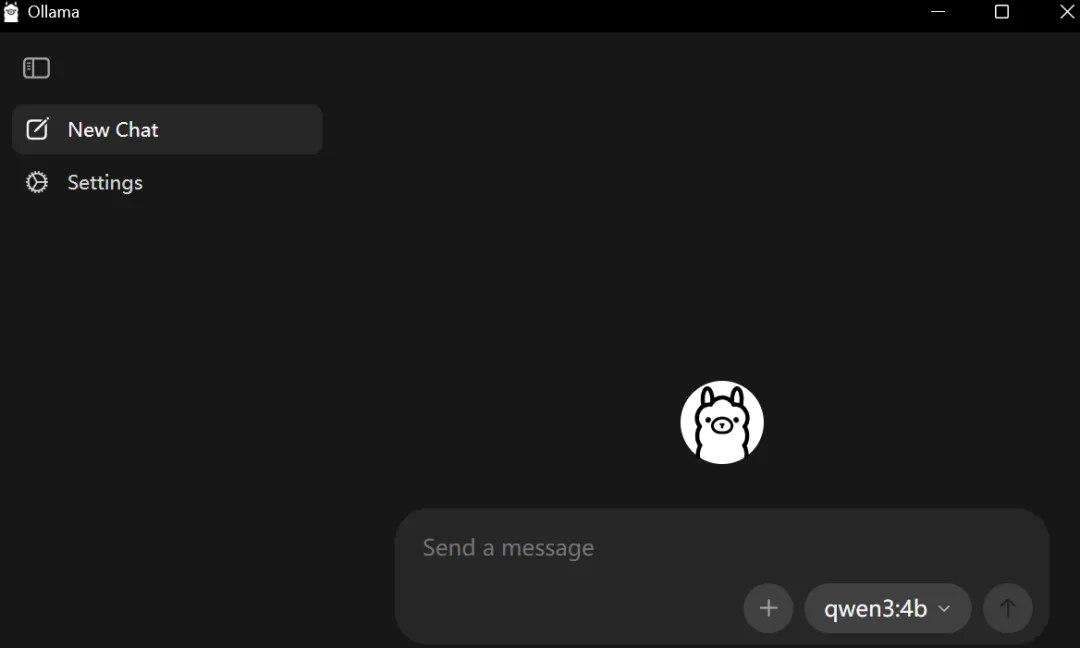

8、设定后了,重启一次Ollama客户端,在客户端中点击Settings

9、在Model location,也就是模型位置设定好,与用户变量中模型存储的目录相同即可。同时把上边3个全部设定为允许,分别代表可以运行Cloud模型(下面会介绍),允许自动下载升级,允许其他设备也能访问Ollama。

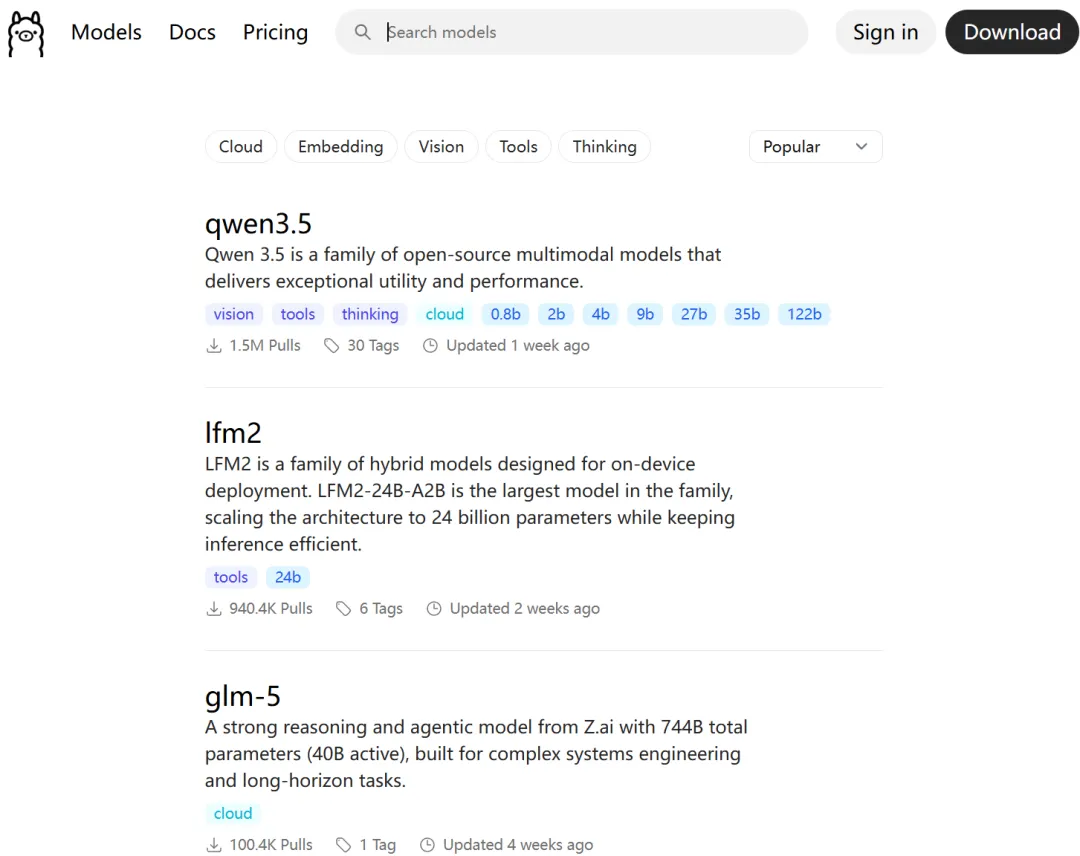

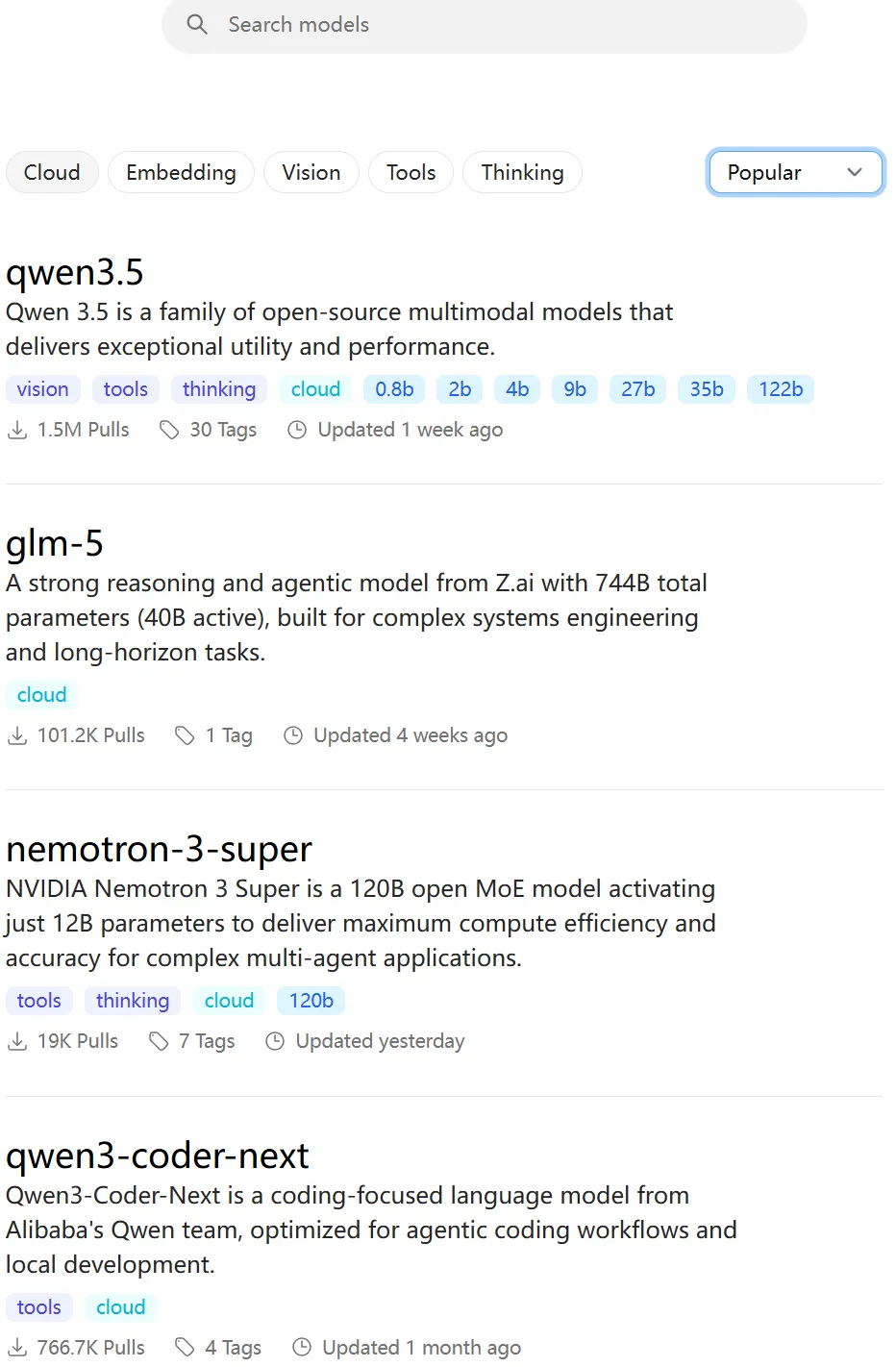

10、打卡Ollam官方网页,点击Models,在Popular中,看看受欢迎的模型

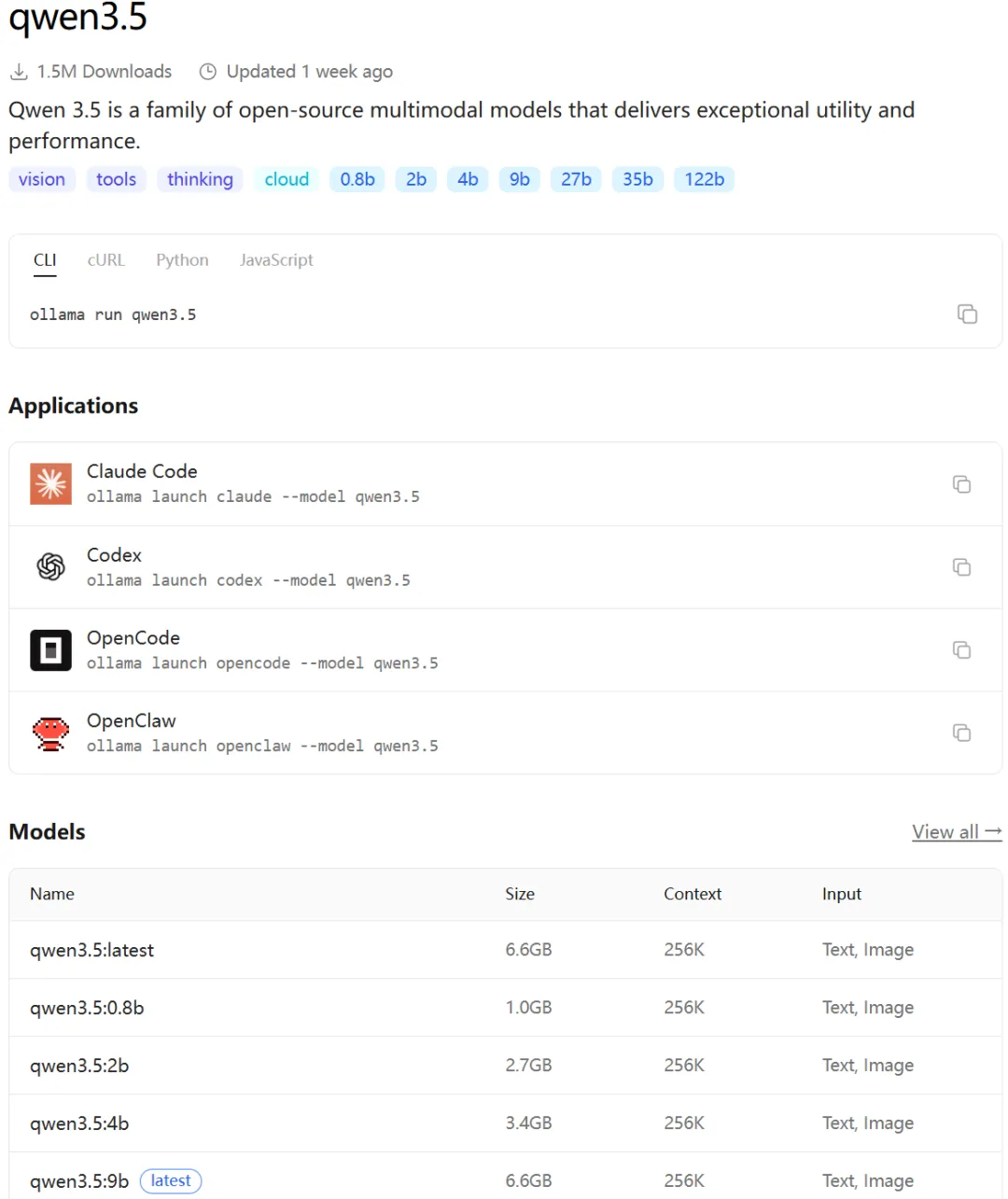

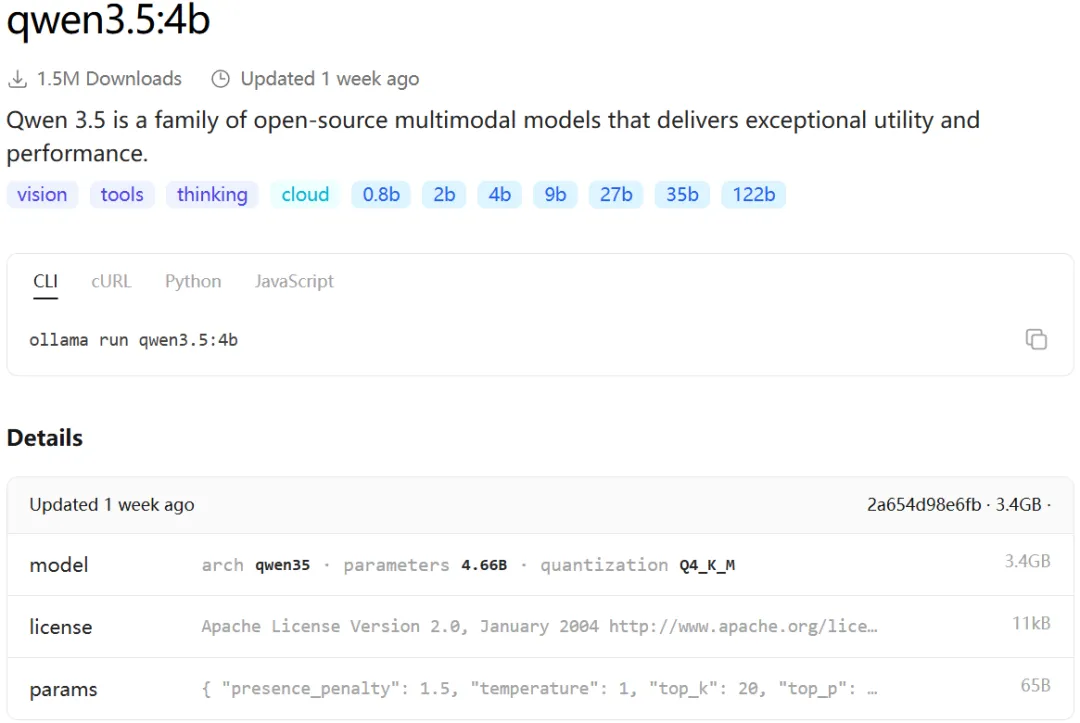

11、比如以qwen3.5为例,点击qwen3.5,会打开如下网页,看下面Models,比如想安装qwen3.5:4b,直接点击它

12、会打卡下面这个界面,直接复制后面的复制符,意思是复制这条命令

Ollama run qwen3.5:4b

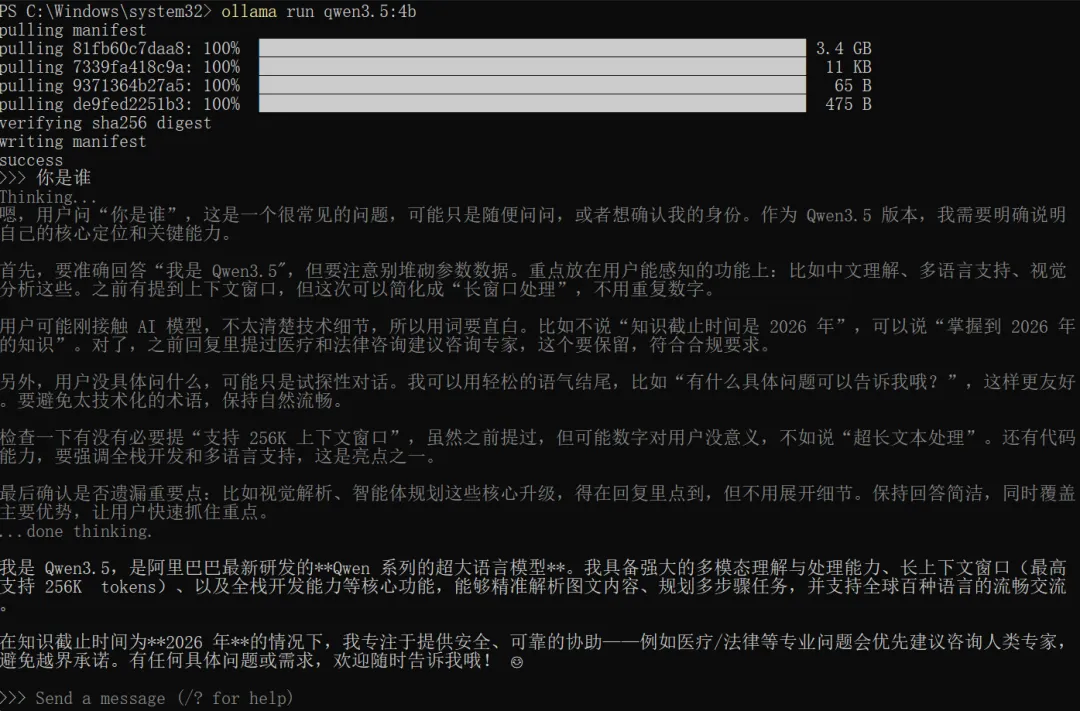

13、打开Powershell,把ollama run qwen3.5:4b复制进去,回车,等待模型下载下来,可以在模型下载完成后。就可以与模型进行对话了

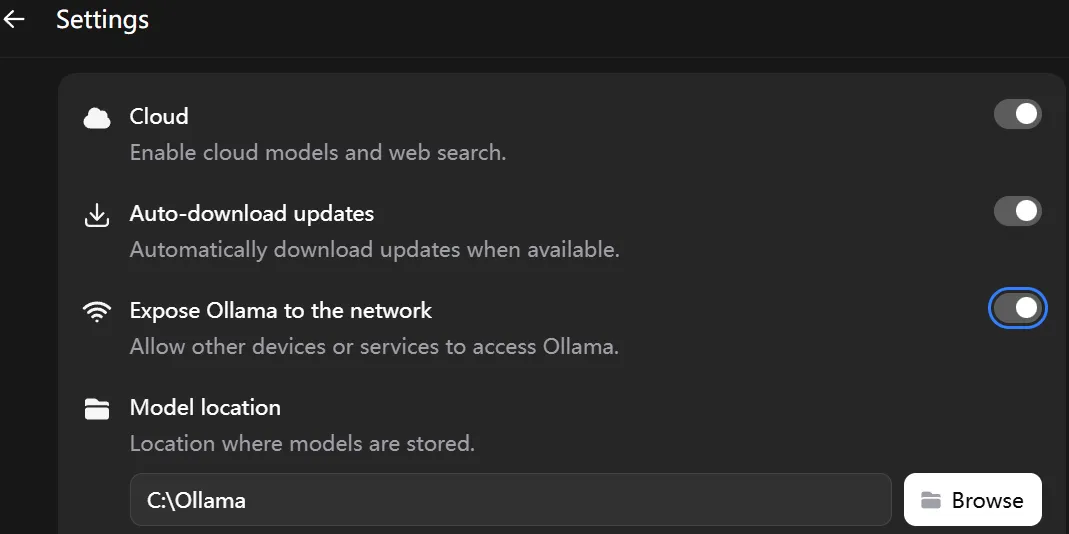

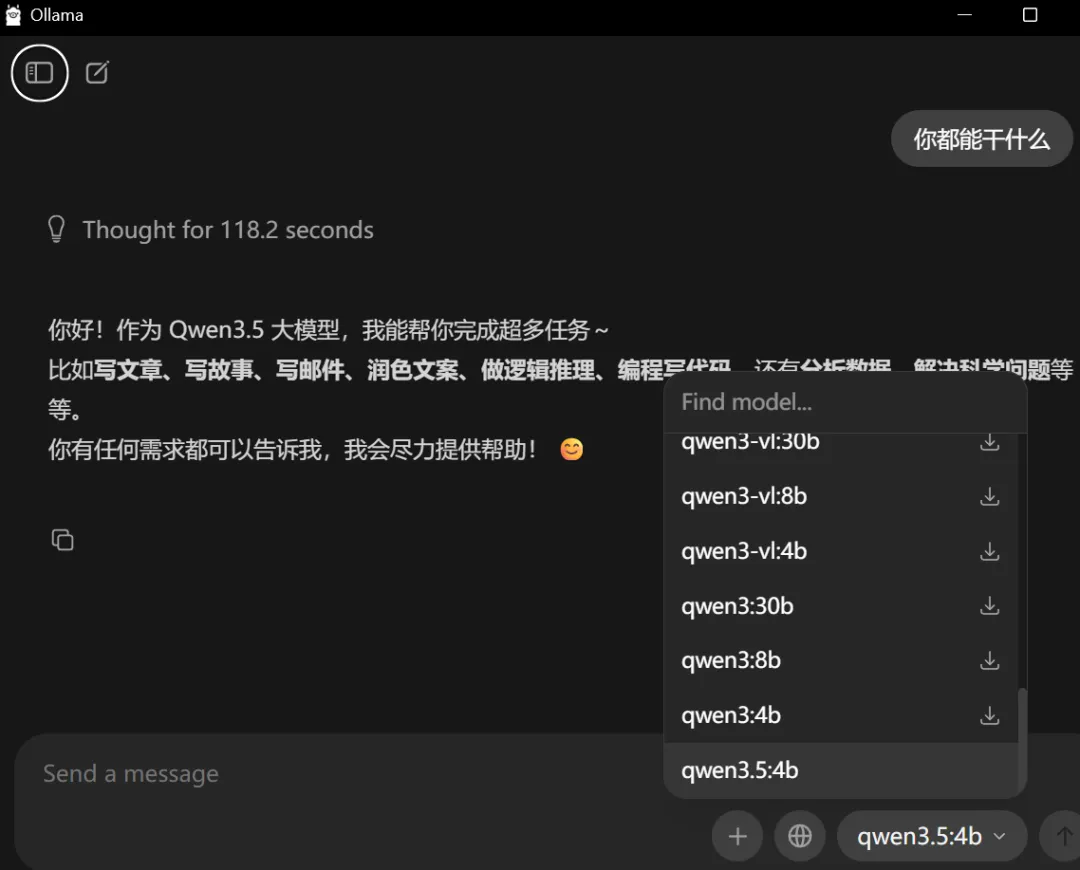

14、打开Ollam客户端,就可以在下方的模型下拉列表看到我们刚拉取下来的模型,它已经下载到本地,并且可以在客户端中进行对话

15、现在我们来拉取一个Cloud模型,在模型搜索框下方,点击第一个Cloud,会显示所有Olllama中的Cloud模型

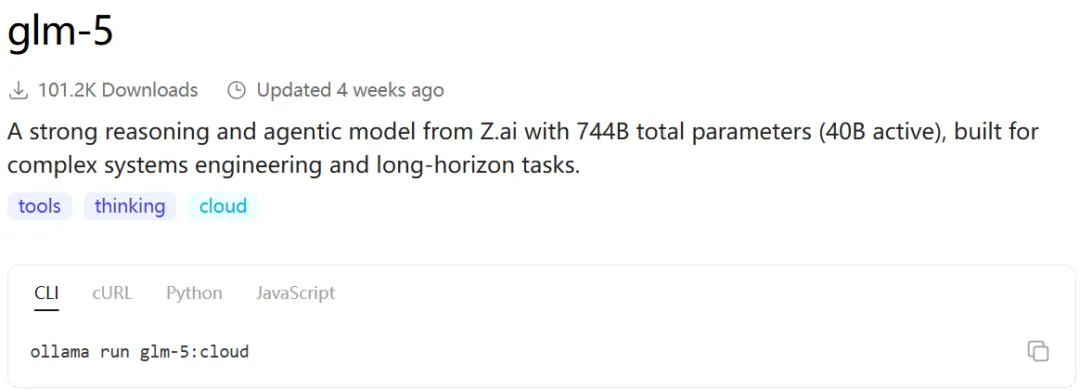

16、以第2个glm-5模型为例,点击模型名,点击命令行后面的复制符,复制模型拉取命令

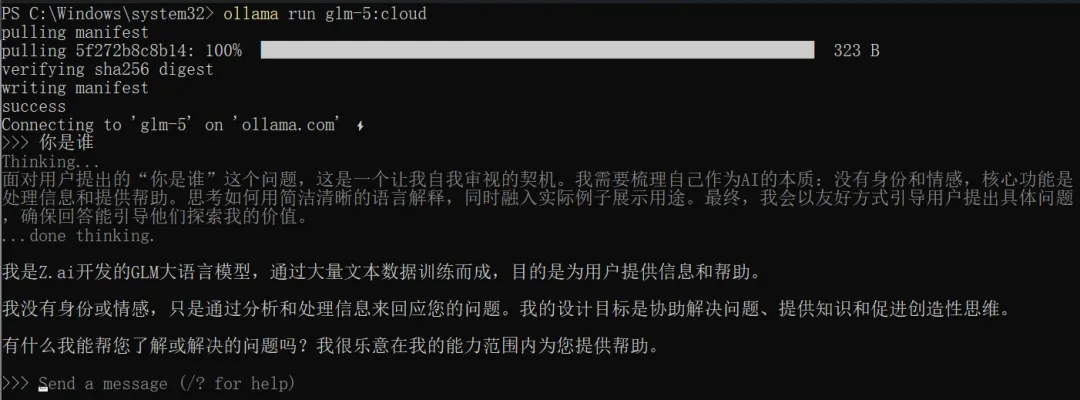

17、在Powershell中,粘贴这个命令,拉取这个云模型,拉取的速度会比本地模型快得多,秒拉取,拉取完成,也可以在下面与模型进行问答

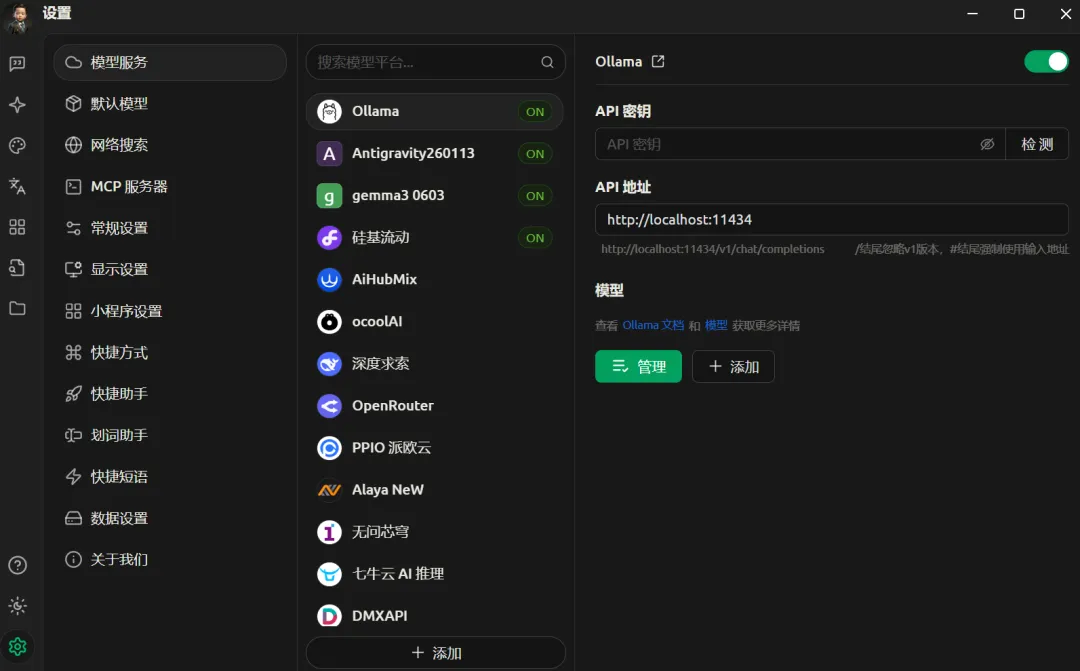

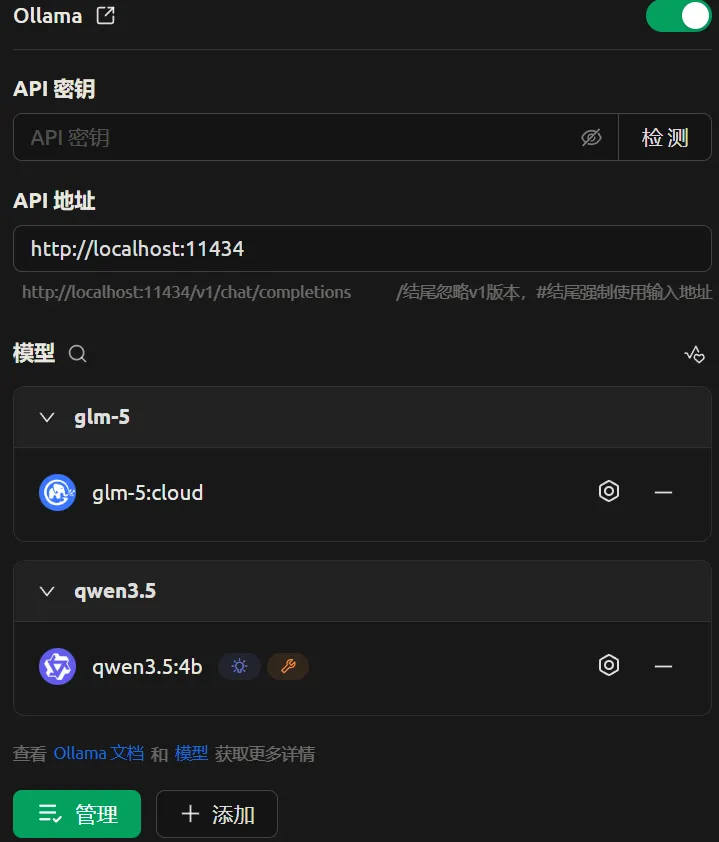

18、现在我简单介绍一个这个模型在CherryStudio中配置的方法,点击左下角的设置,在模型服务中,找到已经默认在其中的Ollama模型,把Ollama模型可用打开,API地址就用默认,在下方的模型项,点击管理

19、可以看到我们刚拉取的2个模型,点击模型后面的加号

20、回到Ollama模型页面,就可以看到模型列表中已经有了下载和拉取的两个模型

21、在CherryStudio中使用刚拉取的Cloud模型,就可以愉快的与模型进行对话了。

以上就是Ollama模型的安装,模型下载,以及在应用中简单配置和使用的分享。可以在Ollama网页中寻找并下载自己喜欢的模型,但是要注意模型一定要根据你的计算机配置进行下载,不要下载过大的模型。另外,下载的模型可以离线使用,但是Cloud模型,无法离线使用,只能是在联网的环境下使用。还有就是Cloud模型使用是有一点限制的。

简单的分享,就到这里,如果在部署和设置Ollama过程中遇到什么问题,欢迎在下方留言讨论,我将在第一时间看到时,及时回复!

如果你觉得这篇文章写的还不错,欢迎关注我的公众号:AI智谷X。或者扫描下面的二维码关注我 ,分享人工智能和科技前沿的快乐就在这里...

夜雨聆风

夜雨聆风