想搞一个自己的 AI 助手,在飞书里随时帮你查资料、整理文档、安排日程?OpenClaw 就是目前最火的方案。但很多人卡在安装和配置上——尤其是飞书插件怎么连、大模型 API 怎么选,踩坑无数。

这篇文章就是一个完整的保姆级教程,带你从零安装 OpenClaw,配好飞书官方插件,再接入火山引擎的 Coding Plan——用最低的成本跑起来。

一、安装 OpenClaw

环境要求

OpenClaw 跑在 Node.js 上,所以你需要先装好运行环境:

安装步骤

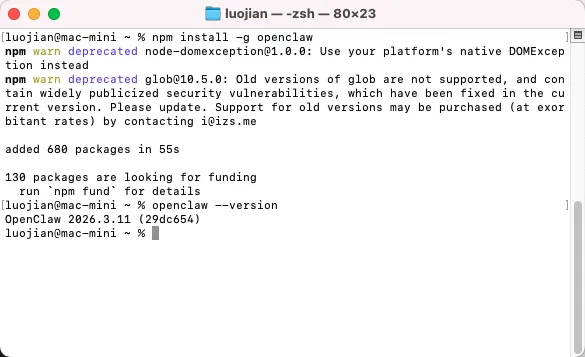

打开终端,一行命令搞定:

npm install -g openclaw装好后验证一下:

openclaw --version

(中间几条warn消息可以忽略,可能你的电脑上不会有,也可能会有其它warn消息)

能看到版本号就 OK。当前最新版是 2026.3.11,建议用最新的,安全补丁和 Bug 修复都在新版里。

安装完会自动进入配置向导(openclaw onboard),引导你配置大模型和消息渠道。如果没有自动弹出,手动运行这个命令就行。

二、初始化配置向导(openclaw onboard)

第一次装好 OpenClaw 后,最重要的就是跑一遍初始化向导。这个向导会一步步带你配好大模型和消息渠道,新手跟着走就行。

启动向导

如果安装后没有自动弹出,手动运行:

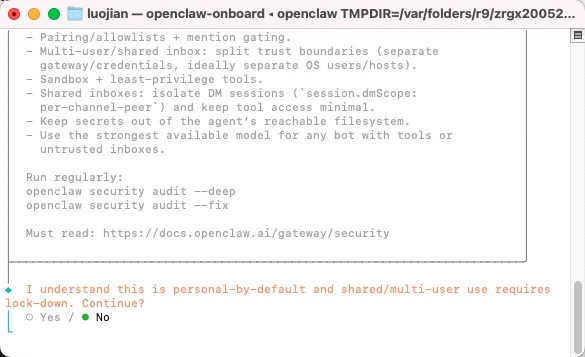

openclaw onboard进入向导后会看到一个安全警告页面,告诉你 OpenClaw 是个人项目、还在 beta 阶段,工具权限比较开放。这个没什么好纠结的,选 Yes 继续(使用左右方向键切换选项)。

选择 Onboarding 模式

接下来会问你选哪种模式:

选 QuickStart 就行。

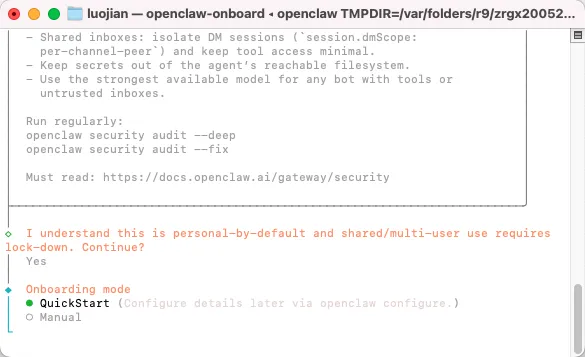

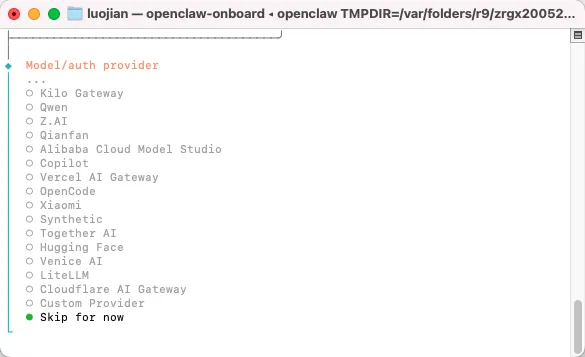

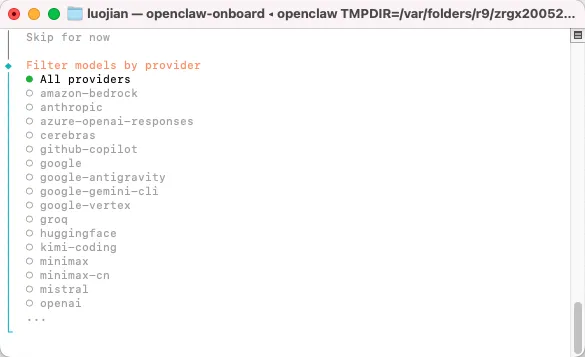

配置底层模型

接下来是最关键的一步——选择你要用的 AI 大模型。

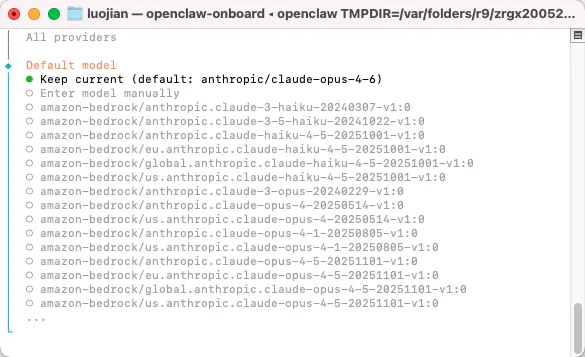

然后进入 Default model(默认模型)选择页面。如果你已经有了 API Key 并且想用当前默认模型,选 Keep current 就行。如果想手动选,往下翻找到你要用的模型。

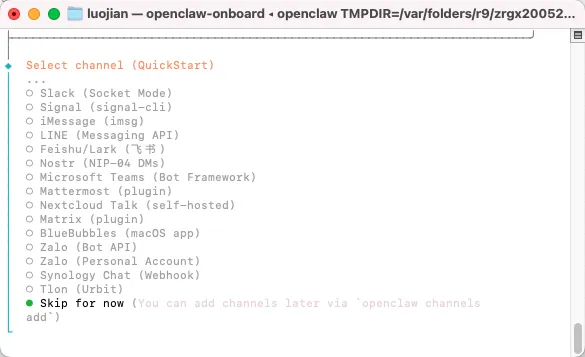

选择消息渠道

模型配完后,向导会进入 Select channel(选择消息渠道)页面。这里列出了所有支持的聊天平台:Telegram、飞书(Feishu/Lark)、Discord、Slack、微信等等。

选择 Feishu/Lark(飞书) 后,会弹出飞书凭证配置页面,要你输入 App ID。

@larksuite/openclaw-lark-tools)一键安装更省事,不需要手动配 App ID。详见第四节。

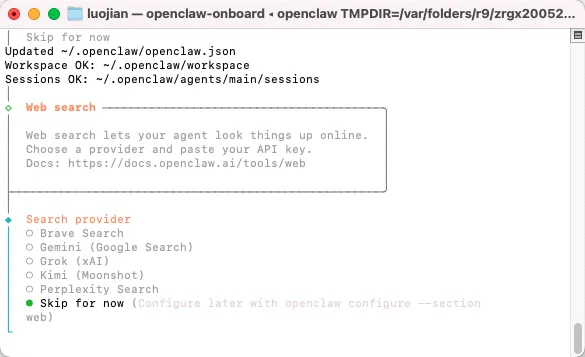

选择搜索供应商

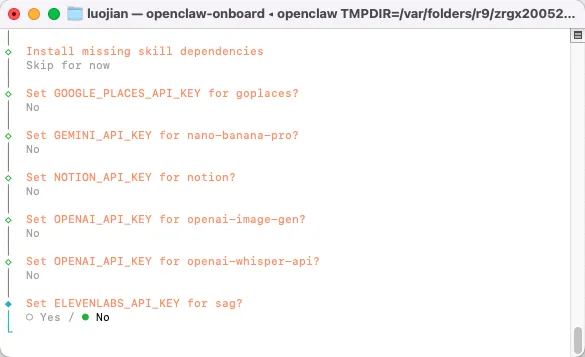

其它

其它选项,如果有Skip for now,则选Skip for now

没有,则选No

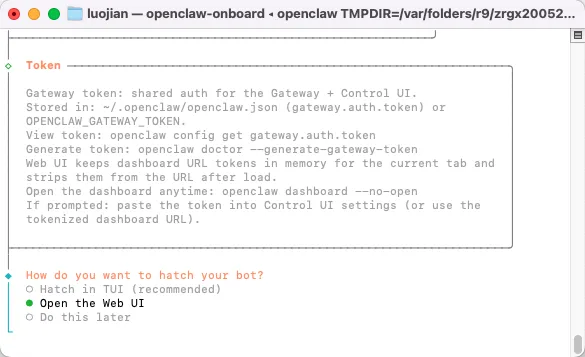

向导走完后,OpenClaw 会自动启动网关(Gateway)。看到终端输出正常就说明基础配置搞定了。

openclaw onboard 重新配置。最后还要选择启动机器人的方式,选择在 Web UI。

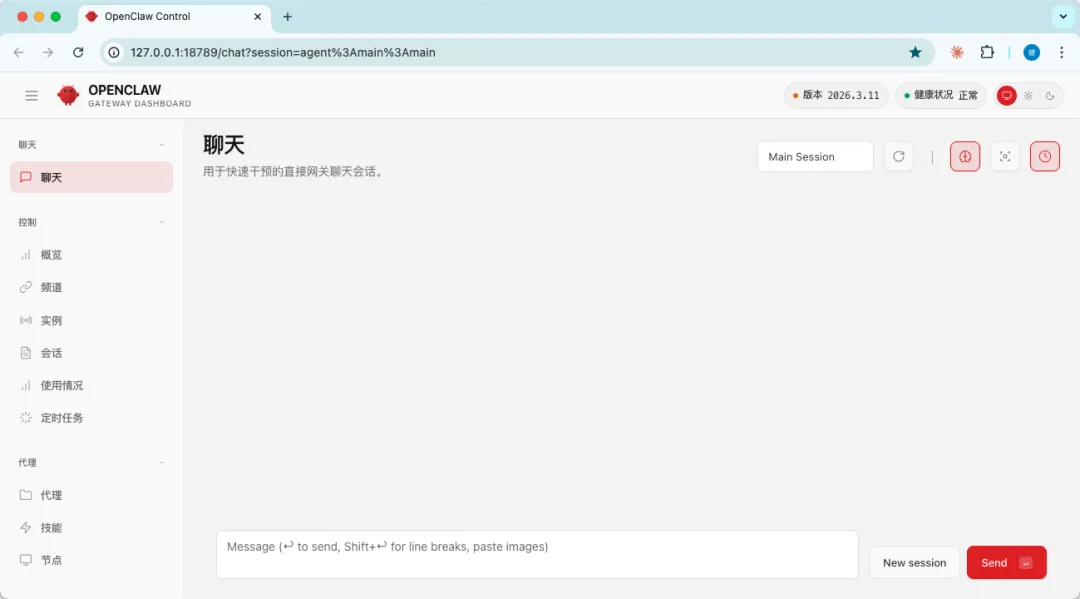

在浏览器中看到这个页面,就代表安装成功了

如果浏览器没有自动打开这个页面,则在浏览器中输入 http://127.0.0.1:18789/

因为现在还没接入大模型,所以它还不能回复。

三、接入火山引擎 Coding Plan

这一步是关键,也是最容易踩坑的地方。

为什么选 Coding Plan

OpenClaw 这类 Agent 工具有个特点:一个简单的任务可能需要调用大模型 10-30 次。如果按 Token 计费,一天下来费用很可观。

火山引擎的 Coding Plan 是订阅制,不看 Token,看调用次数,套餐内随便用。价格参考:

一个订阅能用 Doubao-Seed-Code、Kimi-K2.5、DeepSeek-V3.2、GLM-4.7 等多款模型,性价比直接拉满。

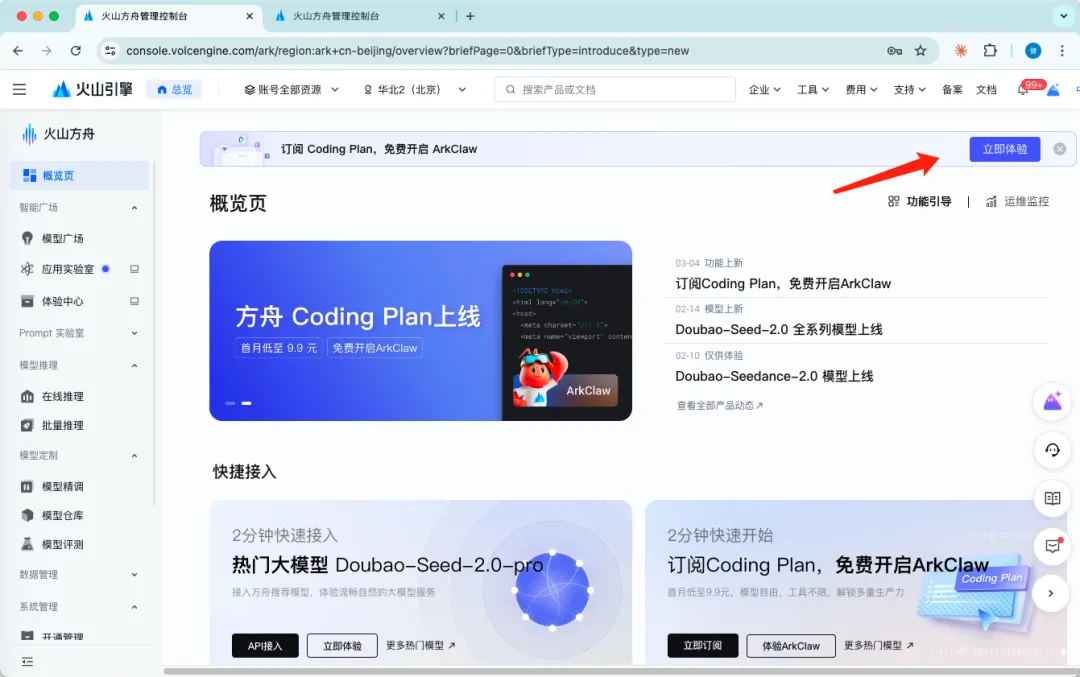

开通 Coding Plan

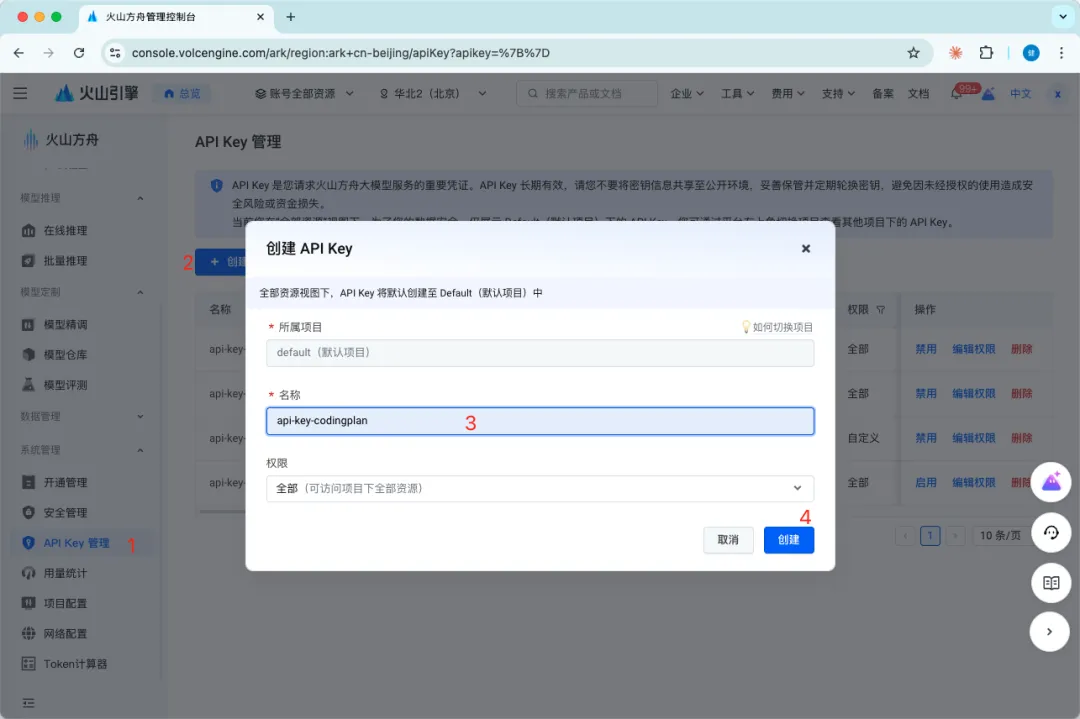

1. 打开火山引擎方舟平台:https://console.volcengine.com/ark

2. 找到「Coding Plan」入口,选择套餐

3. 开通后再创建 API Key

配置 OpenClaw 连接火山引擎

打开 ~/.openclaw/openclaw.json,在 model 部分指定 Coding Plan 的模型:

{"models": {"providers": {"volcengine": {"baseUrl": "https://ark.cn-beijing.volces.com/api/coding/v3","apiKey": "<ARK_API_KEY>","api": "openai-completions","models": [{"id": "ark-code-latest","name": "ark-code-latest","api": "openai-completions","reasoning": false,"input": ["text","image"],"cost": {"input": 0,"output": 0,"cacheRead": 0,"cacheWrite": 0},"contextWindow": 200000,"maxTokens": 32000},{"id": "doubao-seed-2.0-code","name": "doubao-seed-2.0-code","api": "openai-completions","reasoning": false,"input": ["text","image"],"cost": {"input": 0,"output": 0,"cacheRead": 0,"cacheWrite": 0},"contextWindow": 200000,"maxTokens": 128000},{"id": "doubao-seed-code","name": "doubao-seed-code","api": "openai-completions","reasoning": false,"input": ["text","image"],"cost": {"input": 0,"output": 0,"cacheRead": 0,"cacheWrite": 0},"contextWindow": 200000,"maxTokens": 32000},{"id": "glm-4.7","name": "glm-4.7","api": "openai-completions","reasoning": false,"input": ["text"],"cost": {"input": 0,"output": 0,"cacheRead": 0,"cacheWrite": 0},"contextWindow": 200000,"maxTokens": 128000},{"id": "deepseek-v3.2","name": "deepseek-v3.2","api": "openai-completions","reasoning": false,"input": ["text"],"cost": {"input": 0,"output": 0,"cacheRead": 0,"cacheWrite": 0},"contextWindow": 128000,"maxTokens": 32000},{"id": "kimi-k2.5","name": "kimi-k2.5","api": "openai-completions","reasoning": false,"input": ["text","image"],"cost": {"input": 0,"output": 0,"cacheRead": 0,"cacheWrite": 0},"contextWindow": 200000,"maxTokens": 32000}]}}},"agents": {"defaults": {"model": {"primary": "volcengine/ark-code-latest"},"models": {"volcengine/ark-code-latest": {},"volcengine/doubao-seed-2.0-code": {},"volcengine/doubao-seed-code": {},"volcengine/glm-4.7": {},"volcengine/deepseek-v3.2": {},"volcengine/kimi-k2.5": {}}}},"gateway": {"mode": "local"}}

改完重启网关:

openclaw gateway restart⚠️ 重要说明:base_url千万别搞错

这是整篇教程重要的一个踩坑点,我单独拉出来说。

火山引擎有两个 API 入口地址,模型名称一样,但走不同的计费通道:

| https://ark.cn-beijing.volces.com/api/coding/v3 | |

| https://ark.cn-beijing.volces.com/api/v3 |

看到了吗?两个地址只差一截路径:/api/coding/v3 是套餐通道,/api/v3 是按量计费通道。

/api/v3 而不是 /api/coding/v3,请求照样能跑通,模型照样能回复——但走的是按量计费通道,你买的 Coding Plan 套餐一点没用上,钱白花了。而且因为模型名称一样,表面上完全看不出来,只有看账单的时候才发现不对。Coding Plan 可用模型一览

再踩一个坑:models.json 优先级问题

OpenClaw 2026.2.26 之后有个行为变化:models.json 的优先级比 openclaw.json 高。

也就是说,如果你之前用过按量计费的 volcengine/ 模型,~/.openclaw/agents/main/agent/models.json 里可能还存着旧的配置。你改了 openclaw.json 也没用,实际调用还是走旧模型。

解决办法很简单——把 models.json 也改了,或者直接删掉

重启后可以用 openclaw doctor 检查配置是否正确。

四、安装飞书官方插件

模型搞定了,接下来让 OpenClaw 连上飞书。

飞书团队出了一个专用的安装工具 @larksuite/openclaw-lark-tools,跟之前社区自己搞的三方插件不一样——这是官方维护的,能让 OpenClaw 以你的身份直接操作飞书:读文档、查群聊、建日程、发消息,不用再来回复制粘贴了。

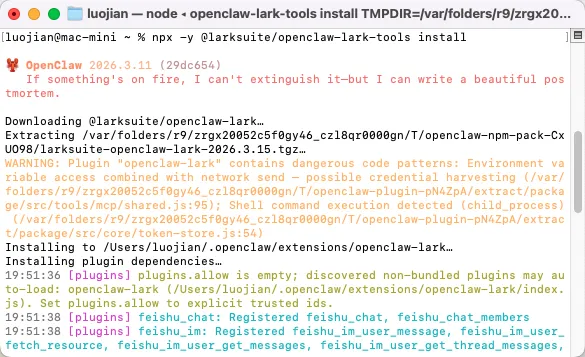

openclaw -v 确认一下。第 1 步:一条命令安装插件

打开终端,运行:

npx -y @larksuite/openclaw-lark-tools install

sudo 重新执行。安装过程中会让你选择:新建机器人还是关联已有机器人。

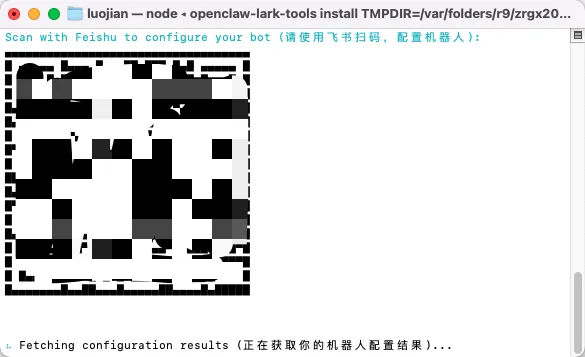

第 2 步:创建飞书机器人

如果选「新建机器人」,终端会弹出一个二维码。用飞书App扫码,选择「一键创建飞书机器人」。

整个过程自动完成——不需要手动去飞书开放平台创建应用、配权限、设长连接那一套了。安装工具会帮你搞定。

还可以选择「已有机器人」。

第 3 步:完成用户授权

机器人创建好后,点击「打开机器人」,在飞书里给它发一条消息就能开始对话了。

为了让 OpenClaw 能以你的身份操作飞书(读文档、查日历、发消息等),建议先完成用户授权。在飞书对话中发送:

/feishu auth这会批量完成消息、文档、多维表格、日历等权限的授权。

第 4 步:验证安装

在飞书对话中发送:

/feishu start如果返回了版本号信息,说明安装成功。

第 5 步:更新插件

飞书团队在快速迭代这个插件,建议定期更新:

npx -y @larksuite/openclaw-lark-tools updatesudo。权限不足怎么办?批量导入权限

如果使用过程中遇到"权限不足"的提示,需要去飞书开放平台手动补全权限:

1. 打开 https://open.feishu.cn/app,进入你的应用

2. 左侧菜单「开发配置 → 权限管理」,点击「批量导入/导出权限」

3. 在「导入」页签中,粘贴飞书官方提供的权限 JSON(包含消息、文档、多维表格、日历、任务、通讯录等几十项权限),点击「下一步,确认新增权限」

4. 确认后点击「申请开通」

5. 然后在顶部点击「创建版本」→ 填写版本信息 → 「保存」→ 「确认发布」

五、安装Skill

找到skill的地址,直接发给它。

六、几个实用的配置建议

流式回复(打字机效果)

飞书官方插件支持流式输出,回复内容会像打字一样一段一段蹦出来,体验比较好。开启方式:

# 开启流式输出openclaw config set channels.feishu.streaming true# 关闭流式输出openclaw config set channels.feishu.streaming false# 卡片上显示耗时和状态openclaw config set channels.feishu.footer.elapsed trueopenclaw config set channels.feishu.footer.status true

七、常见问题排查

Q:机器人在飞书里没反应?

先在飞书对话里发 /feishu doctor,它会自动检查配置是否正常。如果对话里也没反应,回到终端跑:

# 检查问题npx@larksuite/openclaw-lark-tools doctor# 尝试自动修复npx@larksuite/openclaw-lark-tools doctor --fix# 查看版本和配置信息(反馈问题时带上)npx @larksuite/openclaw-lark-tools info --all

Q:安装插件时报 "cannot find module xxx"?

安装过程可能被中断了,或者权限不够导致依赖没装全。进入插件安装目录,手动跑一下 npm install。

Q:升级到 OpenClaw 3.2 后工具调用不了了?

这个版本默认把新 Agent 的工具权限关了。在 openclaw.json 里加上这段:

{"tools":{"profile": "full","sessions":{"visibility": "all"}}}

Q:内存不够 OOM?

新版 OpenClaw 吃内存比较厉害。如果是 2GB 的小服务器,建议加个 swap:

sudo fallocate -l 2G /swapfilesudo chmod 600 /swapfilesudo mkswap /swapfilesudo swapon /swapfile

说实话,OpenClaw 的安装过程不算简单,飞书配置那一套尤其繁琐。但一旦跑通了,体验确实不一样——在飞书里直接跟 AI 对话,让它帮你干活,比开一个网页来回复制粘贴高效多了。

火山引擎 Coding Plan 是目前性价比最高的方案之一,首月 9.9 就能用一堆模型。

⚠️ 以上信息基于 2026 年 3 月 15 日前的公开资料整理,产品功能和价格可能随版本更新变化,请以官方最新信息为准。

夜雨聆风

夜雨聆风