在过去的一个多月的时间里,🦞小龙虾的概念如此之火,感觉所有企业和个人都开始养虾。于是也有很多人开始教大家如何利用 ai agent 来帮助自己抓取信息 or 整理笔记,搭建自己的第二大脑。我自己也试图用 cursor+cline 来搭建自己的个人知识库助手,跟着ai的一步步指引,工具之间的牵手很容易,但让它搭建一个全自动的流程确实还有很多问题(权限/安全/错误处理机制和token消耗等等)。

我让 cursor+cline 自动抓取互联网信息做 ai 日报的测试案例,ai 陷入了对小问题的无休止修复,但对方向选择和不可能边界的理解有明确的缺陷。我感觉现在这个阶段的 ai agent / 小龙虾像一台精密的 f1 跑车,只有受过专门训练的赛车手才能发挥其作用,普通人直接上手其实性价比挺低的。

还是看了 b 站 up 主「杰森的效率工坊」关于 obsidian x n8n 的详细使用教程,在部分重复性高且流程确定的任务中,我放弃了追求目前无法掌控的"全自动机器人",变成了追求构建一条稳定&不出现幻觉的“自动化流水线”。

当然,搭建流水线比使用机器人在前期要更费人,需要学习的内容和知识更多,但过程更确定,所有的问题都可以一个个解决。而且流水线一旦搭建完成,后期只在固定节点消耗 token,而不像 ai agent 需要每一个环节思考&执行消耗 token。感觉单为了更省 token(钱)这一点,重复性高且流程确定的任务就应该冲 n8n。

今天这一篇就分享一下,如何利用 n8n 来进行收集&总结互联网 ai 新闻自动化同步到 obsidian 个人知识库。

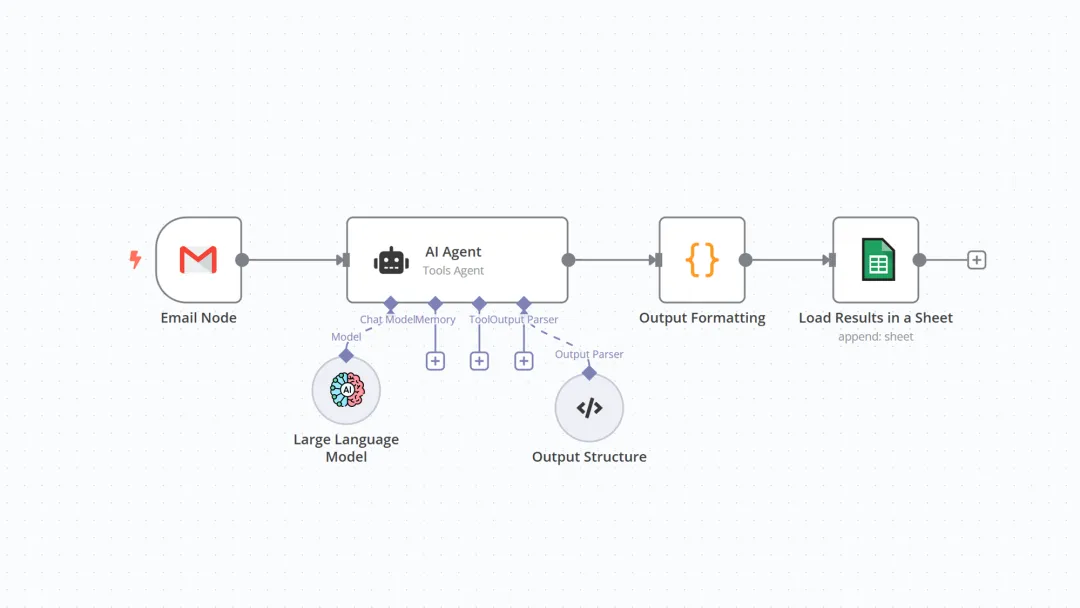

*图片来自互联网,为简单n8n工作流展示,非ai日报工作流

🔹 n8n 是什么?

n8n 是一个工作流工具,整个流程可视化(如上图),用户容易理解 n8n 官方设定了很多封装好的工具,小白用户可以直接使用。比如选择 RSS Read节点,用户填入具体的新闻来源,n8n 就可以拉取优质信息。

🔹 如何利用 n8n 收集信息每天自动化同步到 obsidian?

obsidian 内安装插件,得到专供 n8n 使用 api key 和本地端口,让 n8n 可以读写 obsidian 指定文件夹(沙盒) 在 n8n 新建工作流,接入互联网 ai 新闻源头数据 在工作流中添加 ai 节点,提取 ai 新闻关键内容 让上一步 ai 抓取的关键信息接入 obsidian 生成专属于个人的 ai 新闻日报

夜雨聆风

夜雨聆风