具身智能相关论文开源代码推荐20260327

点击下方卡片,关注【具身智能小站】公众号

📅 2026年3月

👋 大家好!

来了!2026 年新开始的一个系列,主要是整理具身智能领域最近发表的提供开源代码或数据集的项目(论文),希望对相关领域的小伙伴有所帮助。获取这些论文的开源项目链接,可以直接在本文中查看。欢迎转发和关注!!👇

📊 今日数据统计

|

|

|

|---|---|

|

|

|

🤖 开源论文(重点板块)

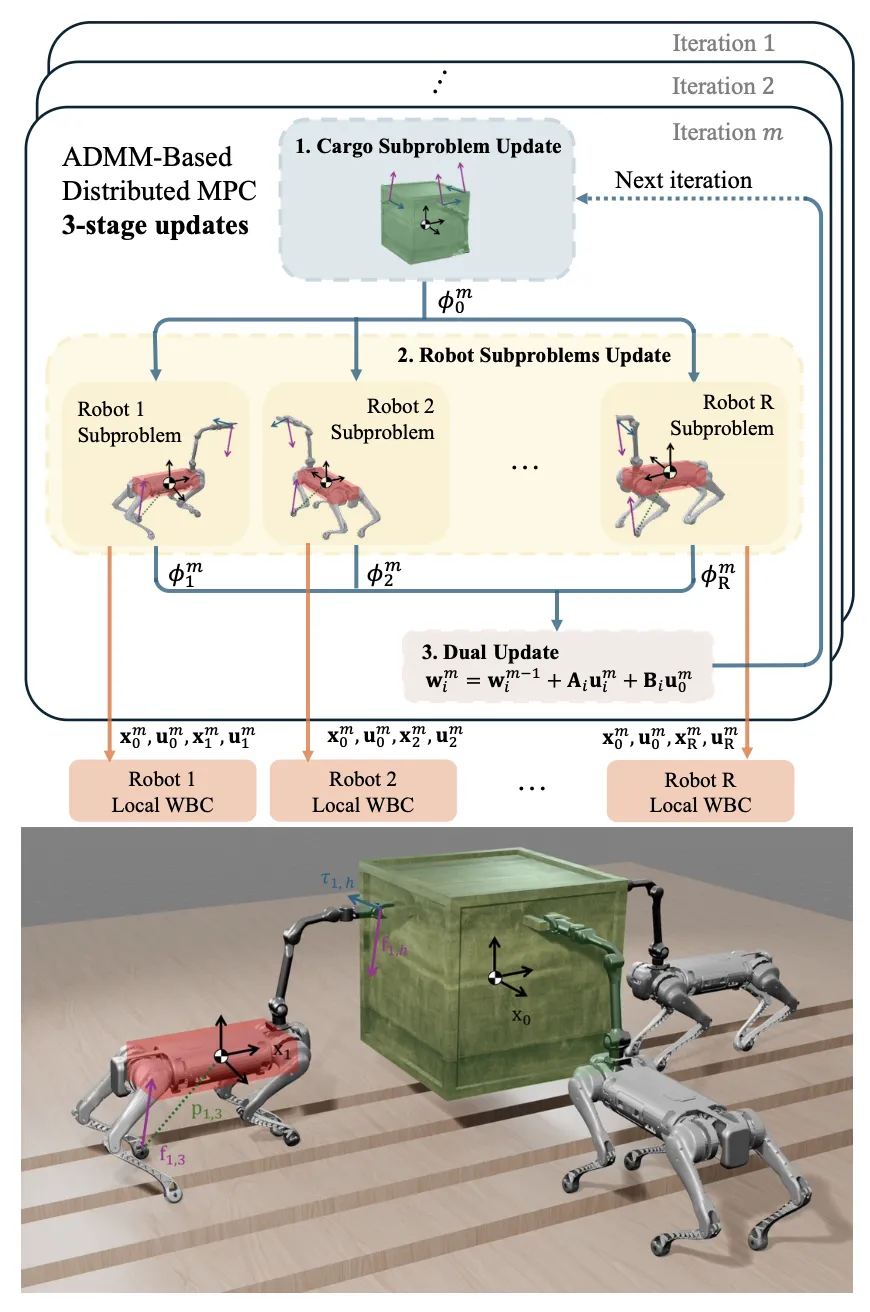

🔬 基于ADMM的分布式协同足式操作运输

📌 Legged Manipulation · Collaborative Transportation · Distributed Optimization · Model Predictive Control

✨ 利用ADMM算法将多机器人协同运输的集中式优化问题分解为并行的单机子问题,在保证动力学耦合精度的同时,实现了计算时间的线性增长,显著提升了系统可扩展性

📖 利用足式机器人团队协同运输重型负载在复杂非结构化环境中至关重要。集中式规划方法虽能捕捉机器人与负载间的动态耦合,但随系统规模扩大,计算复杂度急剧增加,难以实时应用。本文提出一种基于交替方向乘子法(ADMM)的分布式模型预测控制(MPC)框架,用于多足式操作机器人的协同运输。通过利用负载引起的星形耦合结构,将全局最优控制问题分解为并行的单机器人子问题,并辅以共识约束。该分布式规划器以滚动时域方式运行,只需少量ADMM迭代即可快速收敛。结合一个力觉感知的全身控制器执行规划轨迹。多达四个机器人的仿真实验证明了该方法的可扩展性、实时性以及对模型不确定性的鲁棒性。

💡 巧妙地利用了协同运输问题天然的“星形”耦合结构(所有机器人仅通过负载耦合),使得ADMM算法能够高效地将问题分解,实现了性能与可扩展性的最佳平衡。

🔗 项目链接:https://admm-clm.github.io/

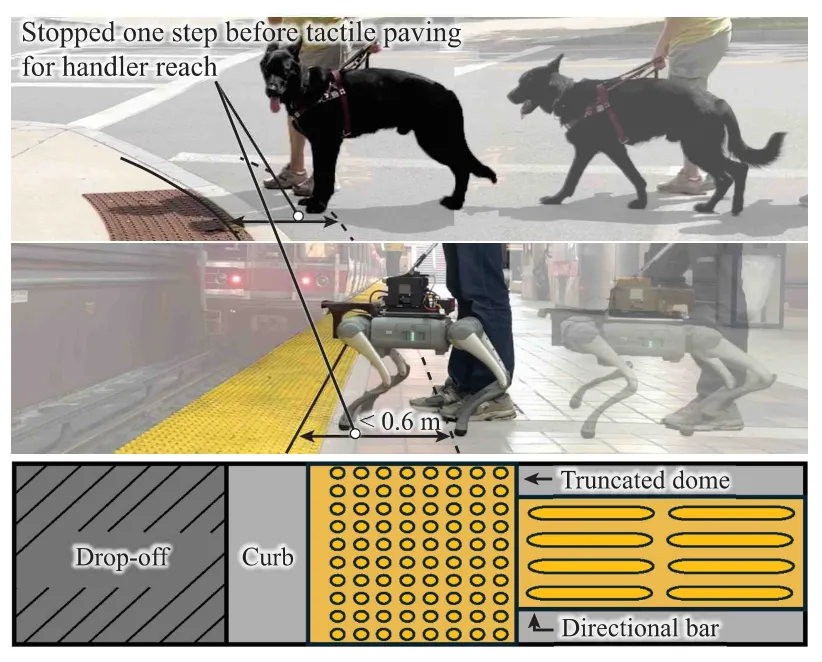

🔬 GuideTWSI: 面向盲人导航的合成与真实图像触觉路面指示器数据集

📌 Robotics for BLV · Tactile Perception · Dataset · Semantic Segmentation

✨ 构建了迄今为止最大、最多样的触觉路面指示器(TWSI)数据集GuideTWSI,通过大规模合成数据增强,使机器人对关键的安全警示区域(如圆顶状警示块)的分割精度提升高达29 mIoU,并实现了96%的精准停止成功率

📖 触觉路面指示器(TWSI)是视障人士识别路口和危险区域的关键地标。然而,TWSI在现有数据集中严重缺失,且存在视角单一和地理偏差(主要为东亚的条形引导砖)的问题,导致模型无法泛化到欧美常见的圆顶状警示块。本文发布了GuideTWSI数据集,包含人工整理的开源数据、机器人采集的真实数据,以及通过虚幻引擎生成的超1.5万张涵盖多种材质、光照、天气和机器人视角的合成圆顶警示块数据。实验证明,合成数据增强将圆顶警示块的分割精度最高提升了29 mIoU。在真实机器人上,该系统在未知环境中的圆顶警示块处实现了96.15%的精准停止成功率。

💡 对于安全攸关的长尾视觉问题(如特殊路砖),利用高保真仿真合成数据来弥补真实数据的不足,是提升模型鲁棒性和系统可靠性的有效途径。

🔗 项目链接:https://guidedogrobot-tactile.github.io/

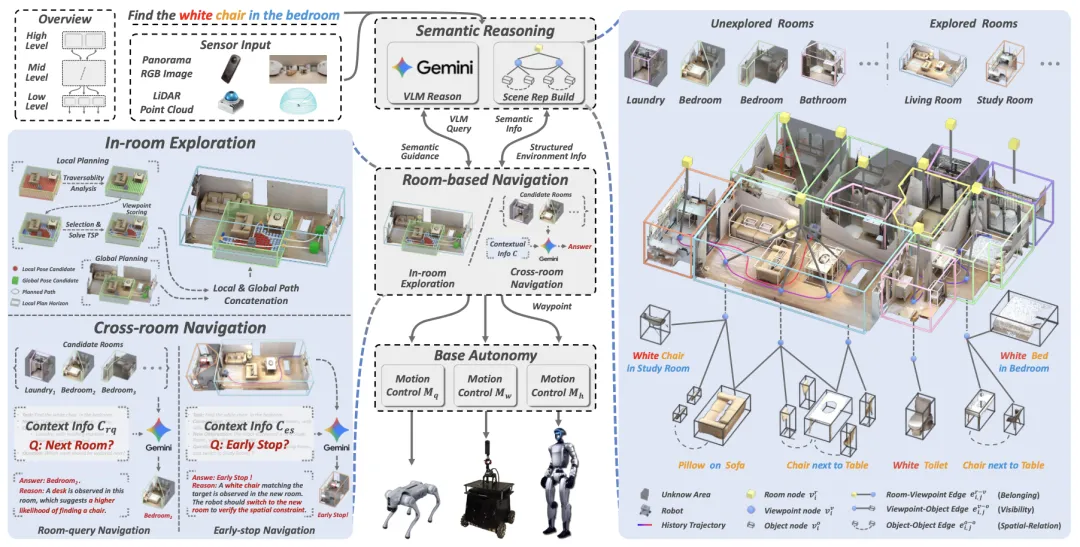

🔬SysNav: 面向真实世界和跨形态的物体导航系统

📌 Object Navigation · Vision Language Model · Robotics System · Embodied AI

✨ 构建一个三层解耦的导航系统,通过结构化场景表示和分层“房间级”导航策略,首次实现了在复杂真实环境中可靠、高效的大规模物体导航

📖 真实环境下的物体导航(ObjectNav)是一个复杂的系统级问题,需要同时处理空间结构、长时程规划和语义理解。本文提出SysNav,一个专为真实世界部署和跨形态泛化设计的三层物体导航系统。该系统将语义推理、导航规划和运动控制解耦。高层利用结构化场景表示和VLM进行语义引导;中层引入分层房间导航策略,保留VLM用于房间级决策,同时利用高效经典探索算法进行房间内搜索,平衡了推理能力与系统效率;低层则通过形态特定的运动控制模块执行规划航点。该系统在轮式机器人、Unitree Go2四足机器人和Unitree G1人形机器人上进行了190次真实世界实验,在成功率和效率上均有显著提升,首次实现了在复杂真实环境中可靠、高效地完成建筑尺度长程物体导航。

💡 将VLM的“常识”用于宏观决策(下一步探索哪个房间),将传统算法的“精确”用于微观执行(如何在房间里走),是构建鲁棒、高效真实世界导航系统的关键。

🔗 项目链接:https://cmu-vln.github.io/

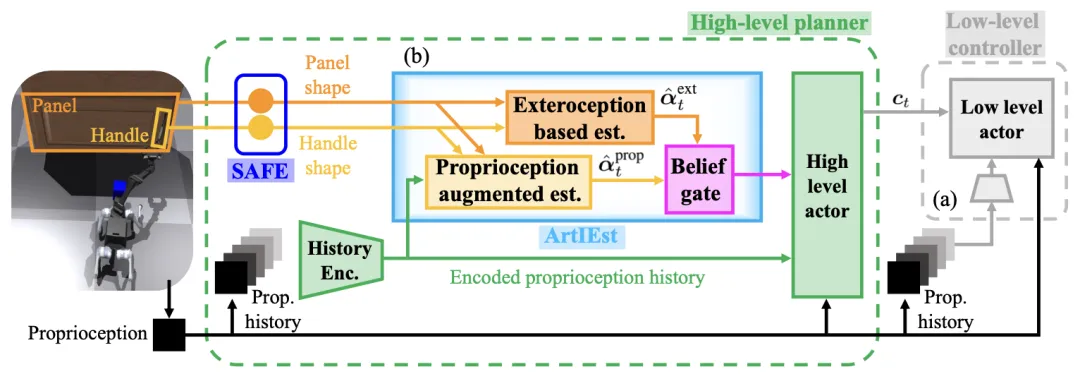

🔬 OpenHEART: 利用足式操作机器人开启异构铰接物体

📌 Legged Manipulation · Reinforcement Learning · Articulated Objects · Robotics

✨ 提出SAFE特征提取和ArtIEst估计器,用低维表示编码物体几何与关节信息,实现单策略足式机器人在异构门、抽屉等物体上的零样本泛化操作

📖 足式操作机器人具备高移动性和灵活操作能力,但开启异构铰接物体(如门、抽屉、柜子)仍具挑战,因为物体关节类型多样且机器人自身动力学复杂。本文提出了一个鲁棒且采样高效的框架OpenHEART,用于足式机器人开启异构铰接物体。该框架引入基于采样的抽象特征提取(SAFE),将把手和面板几何编码为紧凑的低维表示,提高跨域泛化能力。同时,提出关节信息估计器(ArtIEst),自适应地融合本体感觉与外部感知,以估计每个物体的开启方向和运动范围。该框架在仿真和真实世界的多种异构铰接物体上进行了部署和验证。

💡 对于复杂的操作任务,与其让策略直接从高维感知中学习,不如先提炼出与任务强相关的几何和物理特征(如把手形状、开启方向),这能极大提高样本效率和泛化能力。

🔗 项目链接:https://openheart-icra.github.io/OpenHEART/

🔬 CDF-Glove: 一种用于灵巧遥操作的绳驱力反馈手套

📌 Teleoperation · Haptic Feedback · Dexterous Manipulation · Imitation Learning

✨ 一种轻量化、低成本(约230美元)的高自由度绳驱力反馈手套,通过精确的运动映射和触觉反馈,显著提升了模仿学习演示数据的质量和最终策略的性能

📖 高质量的遥操作演示数据是模仿学习在灵巧操作中取得成功的瓶颈。触觉反馈能为操作者提供实时接触信息,使其能实时调整手指姿态,从而提高演示质量。本文介绍了CDF-Glove,一种轻量、低成本的绳驱力反馈手套。它能实时获取20个手指自由度(其中16个直接感知,4个被动耦合)的状态,并开发了相应的运动学和控制系统。实验表明,该手套的远端关节重复定位精度达0.4°,力反馈延迟约为200毫秒,能将无反馈遥操作的任务成功率提升4倍。利用该手套收集的双臂数据集训练的扩散策略,相比动觉教学,平均成功率提高了55%,平均完成时间缩短了约15.2秒(相对减少47.2%)。

💡 为遥操作提供真实的力觉临场感,不仅是提升操作体验,更是为了从根本上产生更符合物理规律、更高质量的演示数据,这是提升下游模仿学习策略性能的关键。

🔗 项目链接:https://cdfglove.github.io/

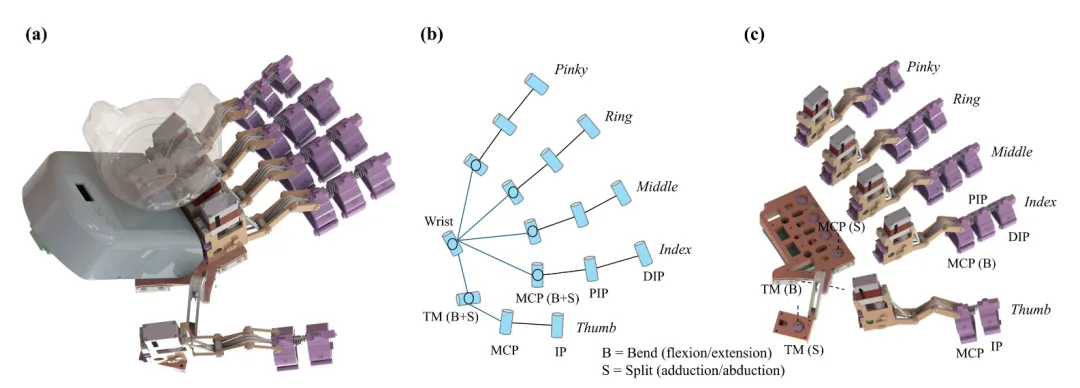

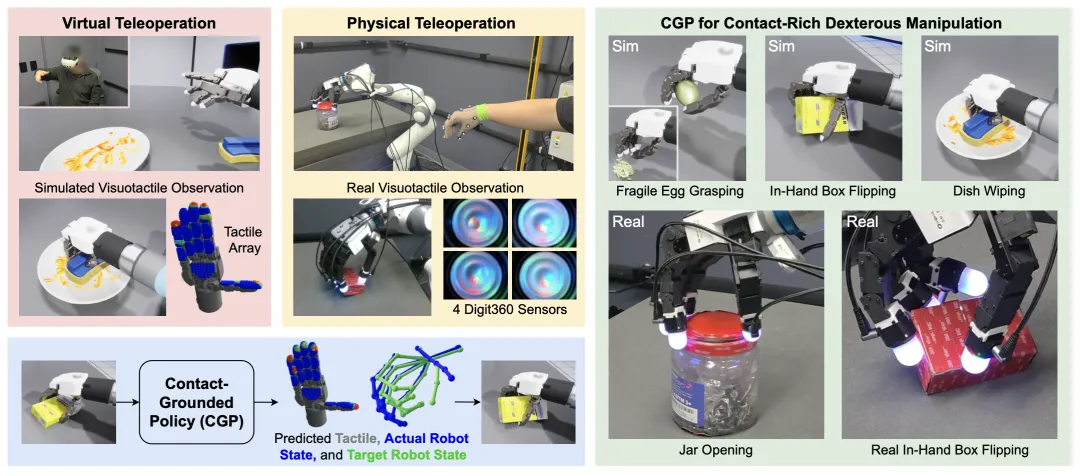

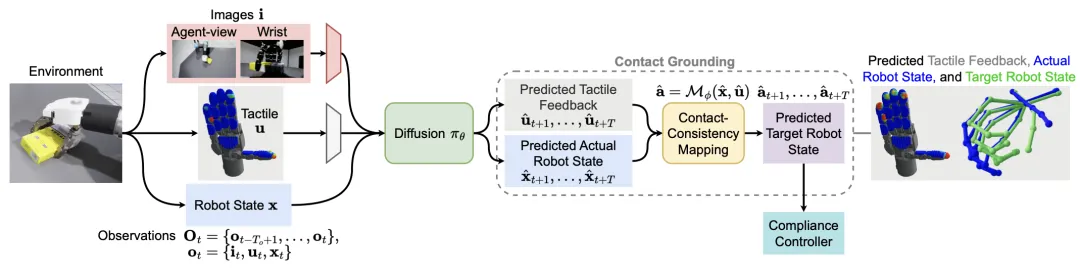

🔬 Contact-Grounded Policy: 基于接触锚定的视触觉灵巧操作策略

📌 Dexterous Manipulation · Tactile Sensing · Imitation Learning · Diffusion Policy

✨ 通过预测机器人真实状态与触觉反馈的耦合轨迹,并利用学习到的“接触一致性映射”将其转换为控制器可执行的目标,从而实现对复杂接触演变的精准控制

📖 与多指手的接触丰富灵巧操作因其多触点动态演变的特性而极具挑战性。本文提出接触锚定策略(CGP),一个通过学习锚定多点接触来提升操作性能的视触觉策略框架。CGP不将触觉信号仅用作额外观测,而是通过两个核心组件实现接触锚定:(i) 一个条件扩散模型,用于在压缩的潜空间内预测未来的机器人状态和触觉反馈;(ii) 一个学习到的接触一致性映射,将预测的状态-触觉对转换为可被柔顺控制器执行的目标状态。通过在物理Allegro手(Digit360传感器)和模拟Tesollo手(密集触觉阵列)上进行的一系列灵巧操作任务(如手内操作、易碎品抓取、工具使用)的评估,CGP的性能超越了现有的视动觉和视触觉扩散策略基线。

💡 让策略学会预测“接触的结果”(状态+触觉)并懂得如何通过控制器去“实现这个结果”(映射为目标),比直接学习动作本身更能捕捉接触丰富的操作本质。

🔗 项目链接:https://contact-grounded-policy.github.io/

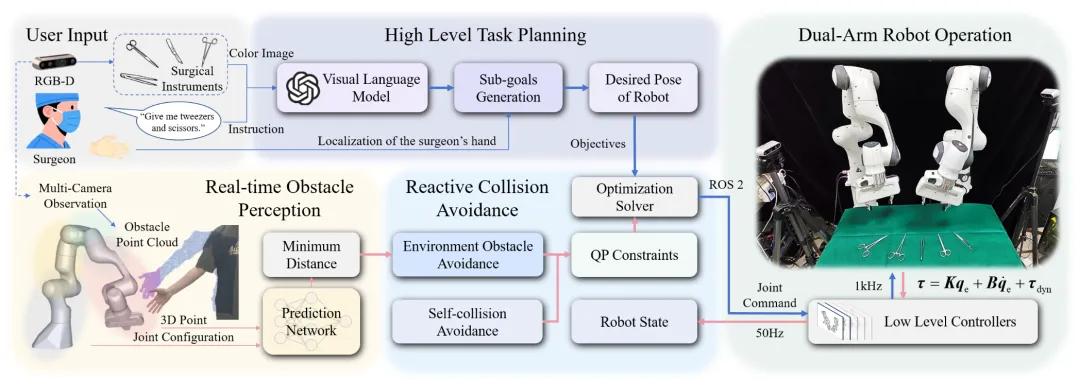

🔬 Give me scissors: 面向器械传递的无碰撞双臂手术辅助机器人

📌 Surgical Robotics · Dual-arm Manipulation · Vision Language Model · Collision Avoidance

✨ 结合VLM的零样本任务规划能力与基于QP框架的实时避障,实现了在动态手术环境中自主、无碰撞地传递手术器械

📖 手术中,洗手护士需要频繁传递器械,易导致疲劳和注意力下降。现有的机器人研究依赖于预定义路径,泛化性差且存在安全隐患。本文提出一种无碰撞的双臂手术辅助机器人,用于执行器械传递任务。它利用视觉语言模型(VLM),根据医生的指令以零样本方式自动生成抓取和传递轨迹。同时,提出一种实时的障碍物最小距离感知方法,并将其集成到统一的二次规划(QP)框架中,确保双臂机器人在动态环境中自主移动时能够进行反应式避障和自碰撞避免。大量实验验证了该系统在器械传递任务中达到了83.33%的成功率,且全程保持无碰撞的平滑运动。

💡 将高层语义理解(VLM任务规划)与低层物理约束(QP避障)解耦并分层整合,是构建安全、自主的辅助机器人系统的关键。

🔗 项目链接:https://give-me-scissors.github.io/

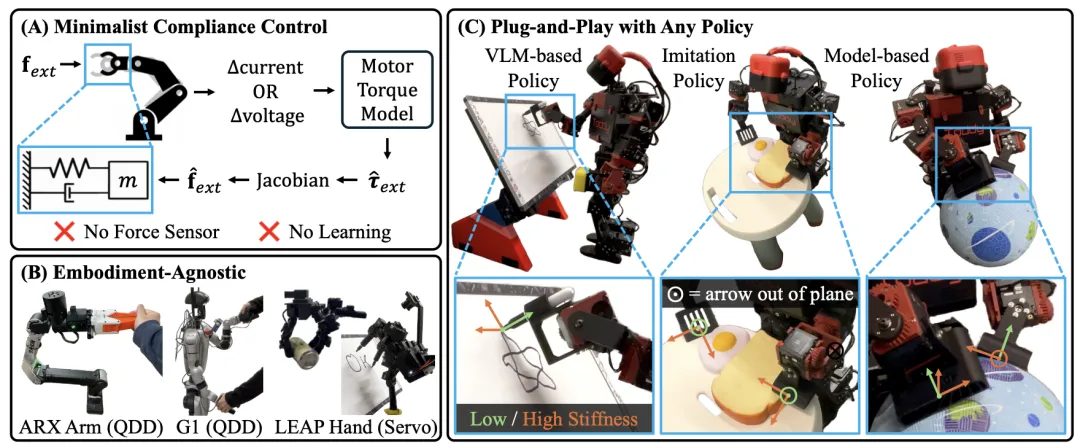

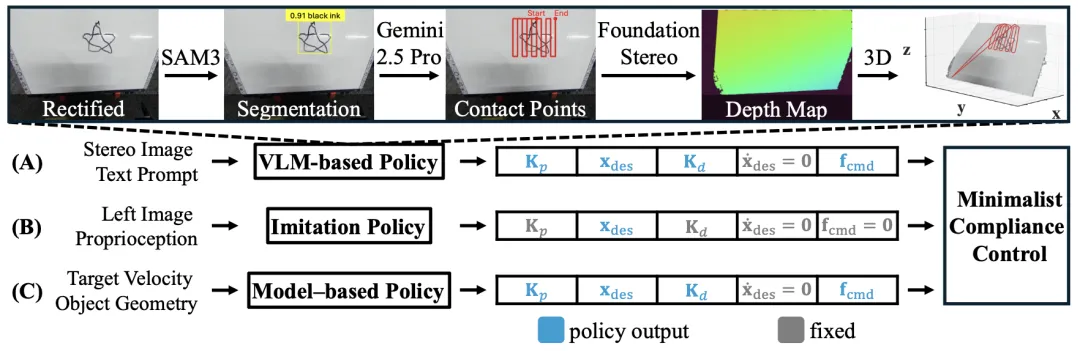

🔬 Minimalist Compliance Control: 面向机器人的极简柔顺控制

📌 Compliance Control · Force Estimation · Admittance Control · Embodied AI

✨ 仅利用电机电流或PWM信号估计外力,无需力传感器和强化学习,实现一种即插即用、跨形态通用的极简柔顺控制方法

📖 柔顺控制对于安全物理交互至关重要,但其应用受限于昂贵的力/扭矩传感器硬件。本文提出一种极简柔顺控制方法,仅利用现代伺服电机或准直驱电机中普遍存在的电流或电压信号,即可实现柔顺行为。该方法通过电机扭矩模型和雅可比矩阵从执行器信号中估计外力,并驱动一个任务空间导纳控制器更新位置参考。该方法无需力传感器、电流控制或学习,能跨不同机器人形态(机械臂、灵巧手、人形机器人)泛化,并能与各类高级规划器(如VLM、模仿学习策略、基于模型的规划)即插即用。在多种接触丰富任务上的实验验证了其鲁棒、安全和有效的交互能力。

💡 柔顺控制的核心不在于力的精确幅值,而在于力的正确方向和频段响应,这为利用低成本、低精度的内禀信号实现有效柔顺控制提供了理论基础。

🔗 项目链接:https://minimalist-compliance-control.github.io/

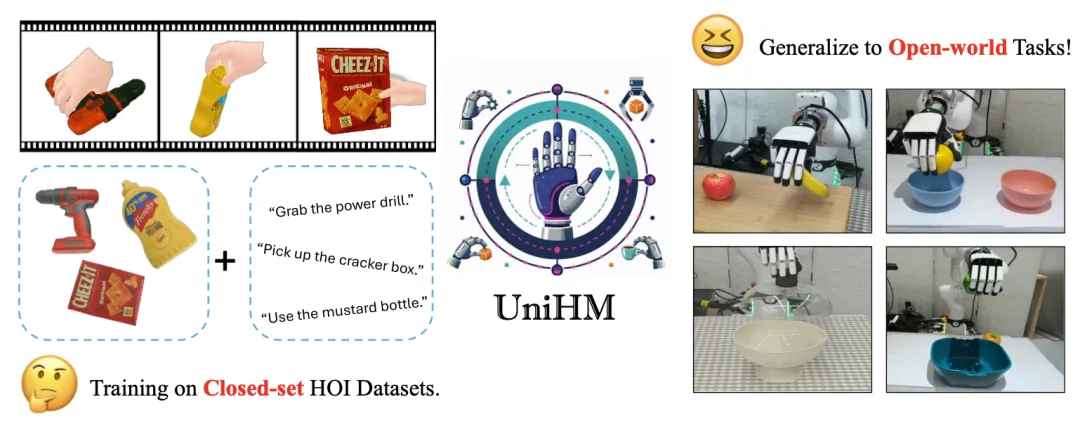

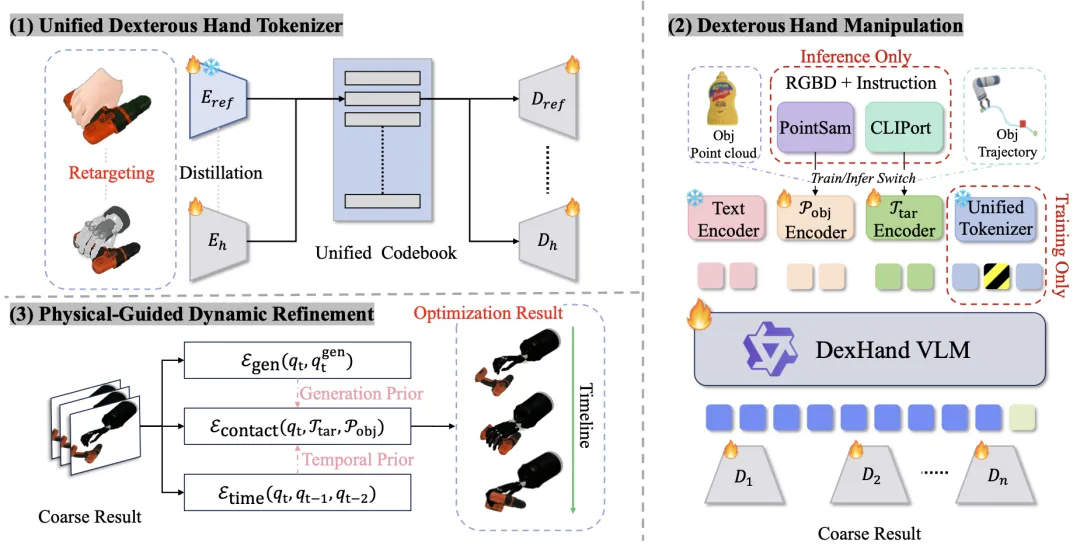

🔬 UniHM: 基于视觉语言模型的统一灵巧手操作框架

📌 Dexterous Manipulation · Vision Language Model · Imitation Learning · Physics-based Optimization

✨ 首次实现通过自由形式语言指令统一生成多种灵巧手动态操作序列,无需真实遥操作数据,并利用物理引导优化确保动作可行性

📖 规划物理可行的灵巧手操作是机器人操作和具身智能的核心挑战。以往工作通常依赖以物体为中心的线索或精确的手-物交互序列,忽略了开放词汇指令的丰富组合性。本文提出UniHM,首个由自由形式语言指令引导的统一灵巧手操作框架。它引入一个统一的手部-灵巧标记器,将异构的灵巧手形态映射到共享代码本,提升跨手泛化能力。该视觉语言动作模型仅使用人-物交互数据进行训练,无需大规模真实遥操作数据集,能从开放指令生成类人操作序列。最后,通过一个物理引导的动态优化模块,在生成先验和时间先验下进行分段联合优化,生成平滑且物理可行的操作序列。实验结果表明,UniHM在多个数据集和真实世界评估中均达到最先进水平。

💡 将复杂的高维灵巧手操作解耦为“语义理解-轨迹生成-物理优化”三阶段,是应对数据稀缺和保证物理合理性的有效范式。

🔗 项目链接:https://unihm.github.io/

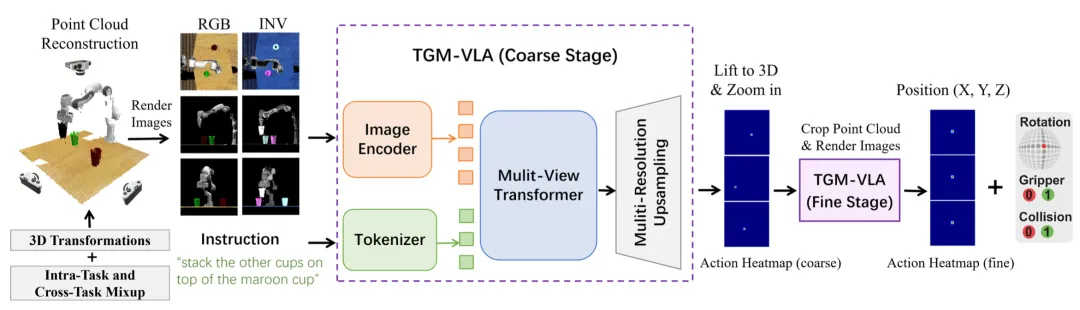

🔬 TGM-VLA: 面向采样高效与鲁棒机器人操作的任务导向型Mixup

📌 Robotic Manipulation · VLA · Imitation Learning · Data Efficiency · Robustness

✨ 提出任务导向型混合策略(TGM),同时优化数据采样、视觉对比与动作分布,在RLBench上实现90.5%的成功率,并将训练速度提升5倍

📖 机器人模仿学习的性能受限于数据质量和训练策略。现有方法在RLBench基准上存在关键帧冗余和时间分布不平衡的问题,导致内存使用低效和优化不稳定。同时,将点云重投影到黑色背景的多视图图像中,会导致深色物体难以被识别和操作。本文提出了一个全新的整体框架TGM-VLA,通过优化关键帧采样策略(减少80%内存消耗,提速5倍)、引入色彩反转投影分支来解决深色物体感知模糊问题,并提出了任务导向型混合(Task-Guided Mixup)技术,动态融合点云和动作热图,增强模型对干扰物的鲁棒性和多目标场景下的性能。实验结果表明,该方法在RLBench上达到90.5%的最新成功率,在COLOSSEUM基准的干扰设置下达到68.8%。

💡 核心在于将数据质量(采样策略)和模型架构(视觉增强与动作混合)视为同等重要的优化目标,共同决定了VLA模型在复杂操作任务中的最终性能。

🔗 项目链接:https://github.com/PuFanqi23/TGM-VLA

一般的星球时间限制是1年,我们是终身制星球,进来就是长期陪伴,还能遇见同频的朋友

🎁 公众号粉丝专属 50元优惠券 已备好点击领取,直接锁定终身席位 👇

夜雨聆风

夜雨聆风