开源播种|上下文不再丢失,这个"插件"把AI编程从玄学变工程

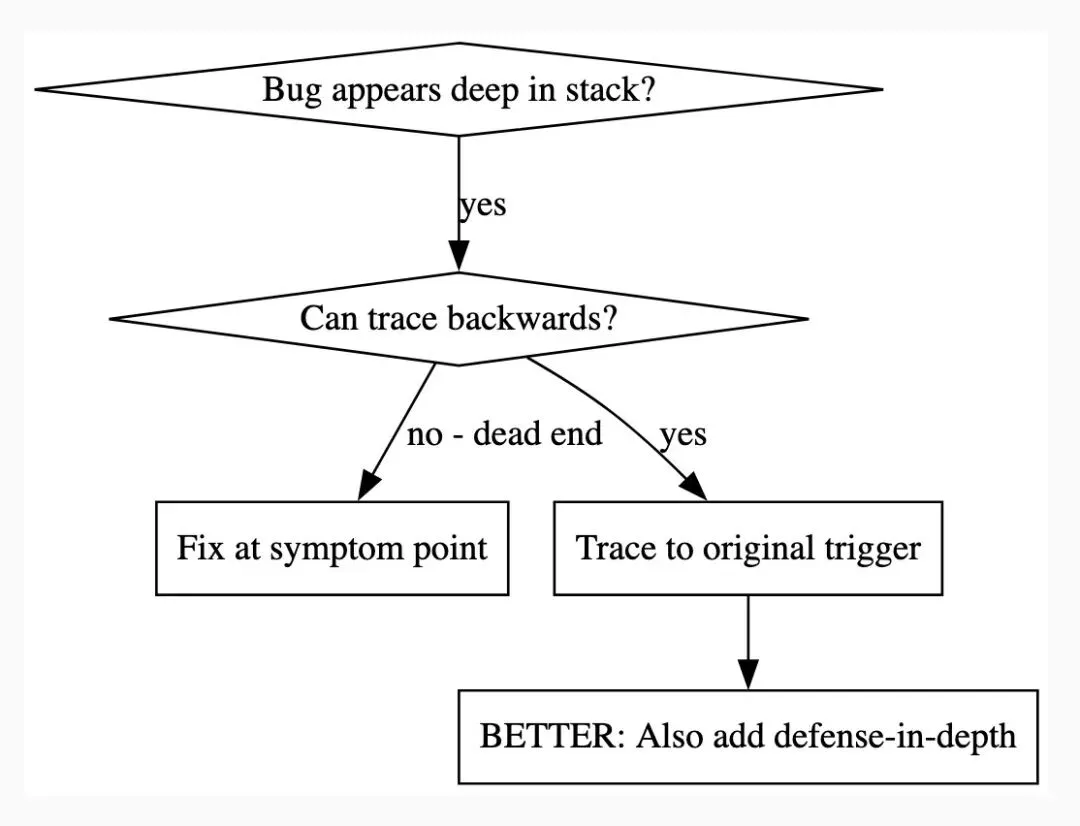

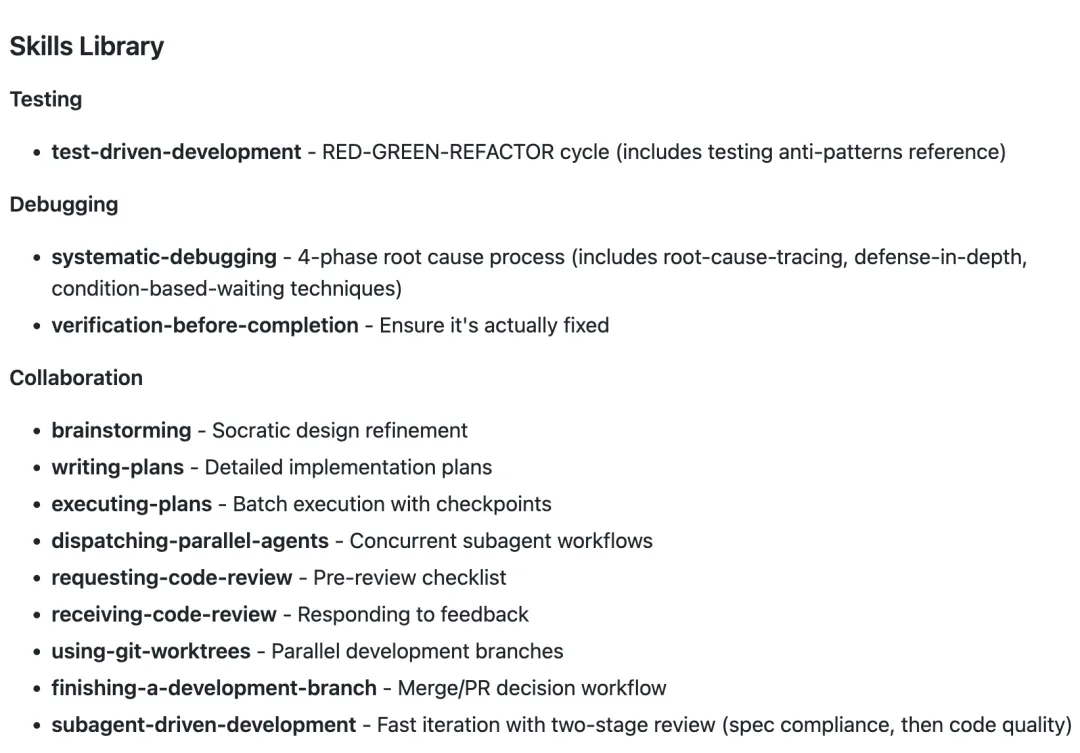

你有没有这种感觉:AI编程工具用起来很爽,但做着做着就开始”漂”——上下文越来越长,代码越写越偏离需求,多文件协作的时候更是灾难性的上下文丢失。 今天香草要介绍的这个开源项目,或许是这个问题目前最优雅的解法之一。它叫Superpowers ,来自独立开发者 Jesse Vincent(资深工程师,著名博客 blog.fsck.com 作者),目前 GitHub star 数已经突破127,000 , forks 超过 10,000,支持 Claude Code、Cursor、Codex、OpenCode 和 Gemini CLI 五个平台。 这不是一个Agent框架,而是一套方法论插件化 的尝试——把30年软件工程经验,压缩成AI能自动触发的技能(Skills)系统。 GitHub链接:https://github.com/obra/superpowers 当前星数:127,000+ (截至2026年3月31日) 最新版本:v5.0.6(2026年3月25日发布) 😤 一句话痛点 AI编程工具很聪明,但”有聪明没纪律”——它会跳过设计环节、跳过测试、跳过评审,代码写着写着就跑偏了。 Superpowers不是给AI增加功能,而是剥夺AI跳过工程流程的自由 。⚙️ 技术原理:技能(Skills)即方法论 Superpowers的核心设计哲学只有一句话:约束即产品(Constraint is Product) 。 传统的AI编程工具,是给AI最大自由度,让它自己决定怎么工作。Superpowers的做法相反——它把软件工程里那些”说起来都知道,做起来总跳过”的流程,强制变成AI必须遵守的技能模块。 技能(Skill)是什么? 在Superpowers里,一个技能就是一个 Markdown 文件。文件里写清楚:什么时候触发这个技能、具体步骤是什么、如何验证结果。技能的触发不是靠你手动调用,而是系统根据上下文自动检测 ——只要有1%的可能性某个技能适用,AI就会主动激活它。 来看一个具体例子。Superpowers里有一个叫Root Cause Tracing 的调试技能,它的触发条件写着: > Bug出现在调用栈深处,但你需要找到它的原始触发点。 技能正文里给出了一张 Graphviz DOT 流程图: 这张图把调试思维固化成了AI能直接执行的工作流——遇到深层bug,先回溯调用链找到源头,再在源头处修复并加防御纵深 。AI不需要”理解”这个方法论,它只需要遵守 。 七阶段完整工作流 Superpowers的完整执行流程分为七个阶段,每个阶段对应一个或多个技能: 第一阶段:苏格拉底式头脑风暴(Brainstorming) AI不会一上来就写代码。它会先向你提问:你要做什么?有哪些边界情况?技术选型是什么?它把需求拆解成一系列澄清性问题,然后生成一份设计文档,分段展示给你确认——每一段都足够短,确保你真的在读而不是略过。 第二阶段:Git Worktree 隔离工作区 设计确认后,AI在独立的新分支上创建工作区,运行项目初始化,验证测试基线干净。这保护了main分支不受”写到一半”的代码污染。 第三阶段:写计划(Writing Plans) 这是香草觉得最关键的一步。AI把整个功能拆解成2-5分钟粒度的任务清单 ,每个任务包含:精确的文件路径、要写的代码片段、验证步骤。Jesse Vincent 对计划质量的要求是:清晰到能让一个”热情但品味差、不负责任、没有项目上下文、厌恶测试”的初级工程师照着执行 。 第四阶段:子Agent驱动开发(Subagent-Driven Development) 这是Superpowers的高阶特性。当你说”开始”,AI不是单线程执行,而是为每个任务分派一个新的子Agent ,每个子Agent从新鲜上下文开始,执行完后经过两阶段评审(规格合规性 → 代码质量)再进入下一个任务。严重问题会阻止继续 ,而不是被忽略。 第五阶段:测试驱动开发(RED-GREEN-REFACTOR)

关键细节:在测试存在之前写的代码,会被框架直接删除 。这不是建议,是强制约束。 第六阶段:代码评审(Requesting Code Review) 任务之间,AI会进行专项评审——对照规格检查合规性,对照代码质量标准检查实现细节。严重问题阻断后续工作。 第七阶段:分支收尾(Finishing a Development Branch) 任务完成后,AI验证全部测试,给你三个选项:合并/PR/保留/丢弃,并自动清理worktree。 💡 实际用例 1. 复杂多文件功能的结构化开发 当你要开发一个涉及3个以上文件、需要架构决策的功能时,Superpowers的价值最明显。它把一个模糊的需求变成一份可执行的任务清单,每个任务都有明确的验收标准。Practitioner Richard Joseph Porter 报告:15+文件的功能现在可以”一致地执行,不会丢失早期决策”,时间线可预测性显著提升。 2. TDD强制合规的生产代码 在TDD激活的情况下,使用报告显示测试覆盖率通常达到85-95%——企业级覆盖率,不需要代码审查周期或团队压力。RED-GREEN-REFACTOR是强制流程,不是AI可以跳过的”建议”。 3. 系统性调试(Systematic Debugging) Superpowers的systematic-debugging技能把调试拆解成四阶段流程:复现 → 隔离 → 追踪 → 修复。结合Root Cause Tracing,AI学会的不是”头痛医头”,而是”找到原始触发点,从源头修复并加防御纵深”。 4. 并行多人功能开发 使用dispatching-parallel-agents技能,AI可以同时在两个worktree上运行,两个子Agent各自处理不同功能,互不干扰。这在需要同时开发多个独立功能时,可以实现3-4倍的加速(相比顺序单Agent方式)。 5. 团队级AI编程规范落地 Superpowers的技能系统可以fork和扩展。团队可以把自己的工程规范写成技能,让所有使用Superpowers的开发者(包括AI)都遵循同一套流程。技能即规范,规范即代码。 🔮 独到洞察 香草想聊一个被很多人忽视的深层问题:为什么AI编程工具反而让资深工程师变慢了? 2025年7月,METR的一项随机对照试验发现,有经验的开源开发者在使用AI工具时,反而比不用AI慢19% ——而他们自己预测AI能节省24%的时间。结论是相反的。 Anthropic的另一项研究也发现,使用AI辅助学习新代码库的开发者,在理解测试中得分低17% 。 这指向一个共同的问题:AI降低了执行成本,却增加了认知债务(cognitive debt) 。当你把”想清楚再干”这个步骤外包给AI,你对代码的理解深度就在悄悄流失。 Superpowers的设计直接针对这个失败模式。强制性的头脑风暴阶段,逼着你在把工作委托给AI之前先自己理清需求 。强制性的评审门,禁止AI生成的代码绕过学习和验证环节。它不是在让AI更强,它是在保护人类工程师的认知参与度 。 另一个值得关注的趋势是方法论插件化(Methodology-as-Plugin)。Superpowers v5的架构,已经不再只是Claude Code的个人效率工具——它正在演变成一套跨平台的”工程规范标准”。v5发布后支持OpenCode和Gemini CLI,不是因为这些平台主动适配,而是Superpowers主动做了多平台兼容。这种”方法论标准”的定位,比单纯的”Claude Code插件”野心大得多。 如果这个方向成立,Superpowers会成为一个类似于”工程规范ISO 9001″的参考实现——不是某个AI工具的功能,而是AI工程实践的标准做法。 📚 参考来源

obra/superpowers GitHub仓库:https://github.com/obra/superpowers

Superpowers官方文档(Mintlify):https://mintlify.com/obra/superpowers/

Jesse Vincent 博客原文:https://blog.fsck.com/2025/10/09/superpowers/

Simon Willison 博客评论:https://simonwillison.net/2025/Oct/10/superpowers/

Groundy 深度分析文章:https://groundy.com/articles/superpowers-agentic-framework-replacing-your-dev/

Richard Joseph Porter 实践报告:https://richardporter.dev/blog/superpowers-plugin-claude-code-big-features

Anthropic 2026 Agentic Coding Trends Report:https://resources.anthropic.com/2026-agentic-coding-trends-report

LobeHub Superpowers技能页面:https://lobehub.com/skills/obra-superpowers-agentic-workflow

Superpowers v5.0.6 Release Notes:https://github.com/obra/superpowers/releases/tag/v5.0.6

夜雨聆风

夜雨聆风