用了半年 AI 工具之后,我整理了一份「概念生存指南」

> 不讲原理,只讲人话。给每一个正在用 AI 但被术语搞懵的人。

—

半年前,我对 AI 的理解还停留在”跟聊天机器人说话”的层面。Token、API、RAG、Agent——每一个词都像在说外语。

半年后,我不敢说自己是专家,但至少能听懂行内人在聊什么,也能把 AI 真正用进自己的学习和工作流里。

这个过程中最大的感受是:**AI 领域最大的门槛不是技术,是术语。** 大量有用的信息被包裹在一层行话里,让普通用户望而却步。

所以我把这半年踩过的坑、搞懂的概念,用最直白的方式整理了出来。不追求面面俱到,只挑那些**你真正会碰到、碰到了不懂就会卡住**的核心概念。

## 一、先搞清楚你在跟什么东西说话

你每天用的 Claude、ChatGPT、DeepSeek,它们背后都是同一种技术:**大语言模型(LLM)**。

LLM 做的事情其实只有一件——预测下一个词。它读完你的输入,然后一个词一个词地”猜”出回答。听起来很简单,但当模型足够大、训练数据足够多的时候,”猜词”就变成了”推理”。

这里有几个基础概念需要建立:

**参数**,可以理解为模型内部的”旋钮”数量。70B 就是 700 亿个旋钮。旋钮越多,模型通常越聪明,但也越贵越慢。同一家公司会出不同规格的模型,比如 Anthropic 的 Opus 是旗舰款,Sonnet 走性价比,Haiku 主打轻快——就像同一品牌的不同车型。

**训练和推理**,是两个完全不同的阶段。训练是让模型读完海量数据、调好所有参数的过程,耗时数月、花费数千万美元。推理是模型训练好之后回答你问题的过程。你每次跟 AI 对话,它都在做推理。一个比喻:训练是上四年大学,推理是毕业后上班。

**知识截止日期**,模型的训练数据有个终点。超过这个日期的事情,模型不知道,需要靠联网搜索来补充。所以如果你问 AI 今天的新闻而它答不上来,不是它笨,是它的”大学”还没教到这一课。

—

## 二、Token——你必须理解的”AI 货币”

Token 是 AI 处理文本的最小单位。它不等于一个字,也不等于一个词,而是模型自己的”分词”方式。

粗略换算:1 个英文单词大约等于 1-2 个 token,1 个中文字大约等于 1-3 个 token。

为什么普通用户也需要知道这个?因为两个直接影响你体验的东西都跟 token 有关:

第一,**上下文窗口**。每个模型一次能处理的 token 数量是有上限的,这就是它的”工作台”大小。如果你跟 AI 聊了很久,前面的对话内容会被”挤出”工作台。你会发现 AI 突然”忘了”之前说过什么——不是它变笨了,是工作台满了。

第二,**费用**。如果你用 API,费用是按 token 计算的,而且输出 token 比输入 token 贵好几倍。让 AI 写一篇长文比让它读一篇长文烧钱得多。

—

## 三、提示词——决定 AI 输出质量的关键变量

Prompt 就是你输入给 AI 的所有内容。很多人觉得 AI 时好时坏,其实问题往往不在模型,在 prompt。

几个实用概念:

**System Prompt(系统提示词)**,是在对话开始前就设定好的”隐藏指令”,用户通常看不到。比如告诉 AI”你是一个临床药学专家,请用中文回答”。很多平台允许你自定义 system prompt,善用它等于给 AI 装了一个”专业人格”,比每次重复交代背景高效十倍。

**温度(Temperature)**,是控制输出随机性的参数。温度低,回答更确定、更保守,适合写代码做分析;温度高,回答更发散、更有创意,适合写故事和头脑风暴。如果你觉得同一个问题 AI 每次回答都不一样,可能就是温度设得比较高。

**提示词工程(Prompt Engineering)**,不是什么高深技术,就是”怎么把需求说清楚”。给 AI 几个示例(Few-shot)、让它分步推理(Chain-of-Thought)、指定输出格式——这些技巧不难,但效果立竿见影。多花 30 秒把 prompt 写清楚,输出质量可能翻倍。

—

## 四、幻觉——AI 最危险也最容易被忽视的问题

**幻觉(Hallucination)**,指的是 AI 一本正经地编造虚假信息。

引用一篇不存在的论文,捏造一个不存在的 API 参数,给你一段看起来能跑但逻辑完全错误的代码——它全程语气确凿,毫无心虚。

这不是某个模型的 bug,而是当前所有大语言模型的通病。因为模型本质上是在做”概率预测”,它不真正”理解”事实,只是在拼接最可能出现的下一个词。

应对方法只有一条原则:**关键信息永远自己验证。** 把 AI 当成你见过的最聪明的实习生——效率极高、知识面广,但它说的话你不能不核实就直接用。

—

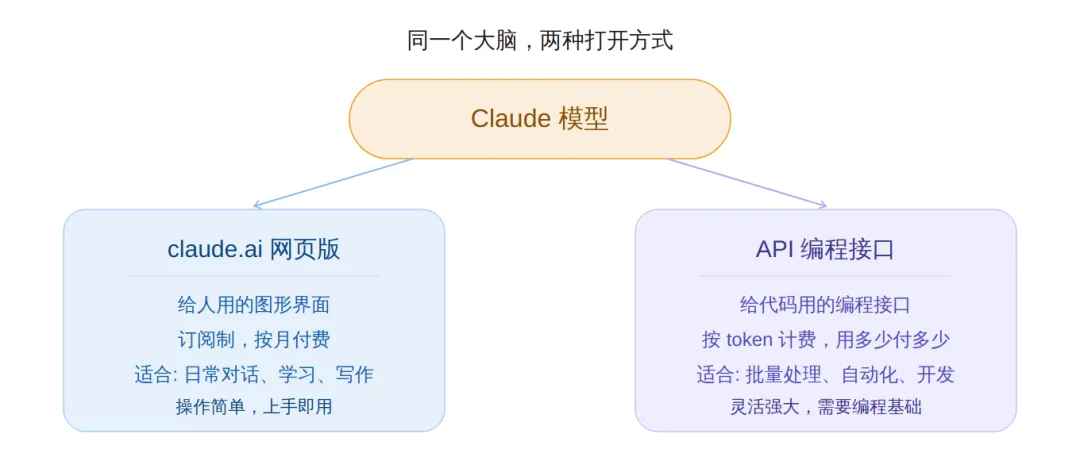

## 五、API vs 网页版——同一个大脑,两种打开方式

这是很多新用户搞不清楚的地方。

**网页版**(比如 claude.ai)是给人用的图形界面。你打开浏览器,打字对话,操作简单直观。

**API** 是给代码用的编程接口。你写一段程序,通过 API 向模型发送请求,模型返回结果——整个过程不需要打开任何网页。

两者背后调用的是同一个模型,但用法和计费方式完全不同:

网页版是订阅制,按月付费,有用量上限但不用操心每条消息花了多少钱。API 按 token 计费,用多少付多少,灵活但需要自己控制成本。

日常使用选网页版就够了。如果你需要批量处理、自定义参数、或者把 AI 嵌入自己的工作流——那就需要 API。

—

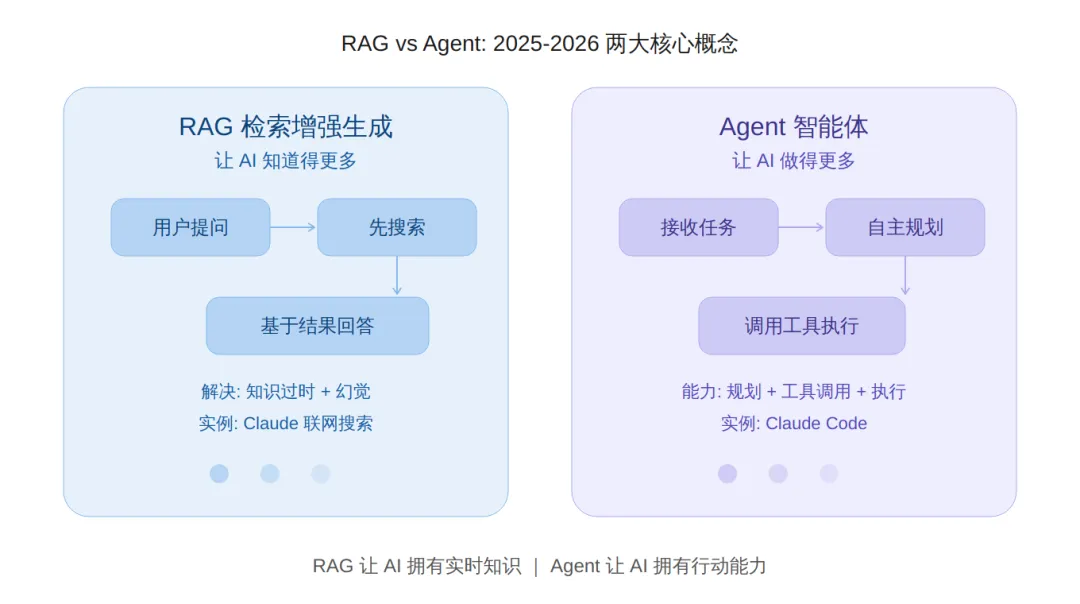

## 六、2025-2026 年最值得理解的两个概念

如果你只能记住两个前沿概念,记这两个:

**RAG(检索增强生成)**。AI 在回答之前,先去搜索相关资料,再基于搜索结果生成答案。Claude 的联网搜索本质上就是 RAG。它解决了两个核心痛点:知识过时和幻觉。

**Agent(智能体)**。传统 AI 是”你问我答”,Agent 是 AI 自己规划步骤、调用工具、执行任务。你说”帮我把这份数据整理成图表发到邮箱”,Agent 会自己拆解步骤、打开文件、生成图表、调用邮件接口,一条龙完成。Claude Code 就是一个典型的 Agent。

一句话区分两者:**RAG 让 AI 知道得更多,Agent 让 AI 做得更多。**

整个行业正在从”对话”向”代理”快速转型——这不是未来,这是正在发生的事。

—

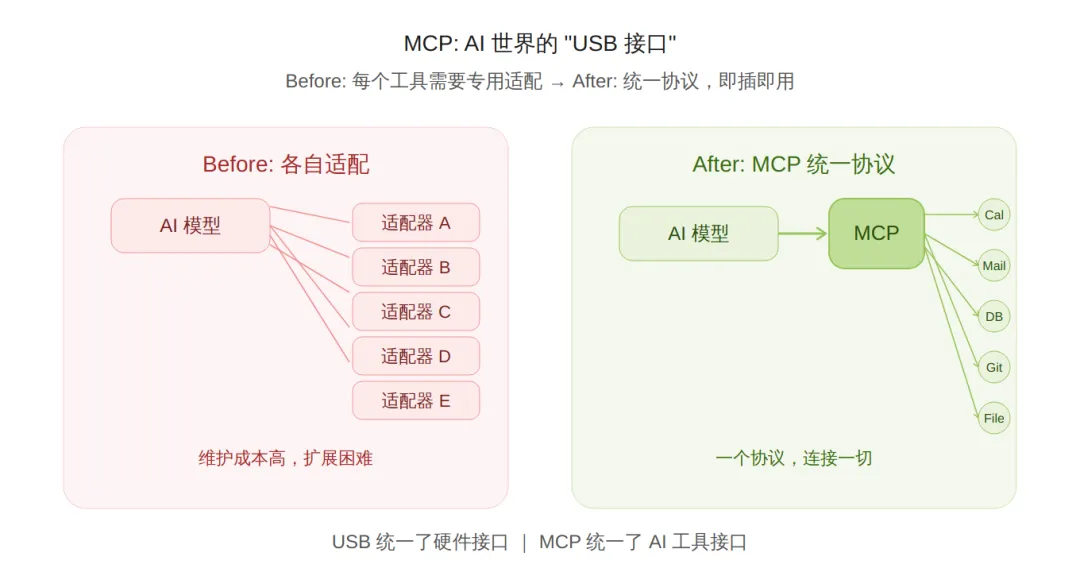

## 七、MCP——AI 工具生态的”USB 接口”

MCP(Model Context Protocol)是 Anthropic 提出的一个开放协议。

它做的事情用一个类比就能说清楚:在 USB 出现之前,打印机、鼠标、键盘各用各的专用接口,换个设备就要换根线。USB 出现之后,所有外设都用同一个口。

MCP 对 AI 工具生态做的是同样的事。它让 AI 可以用一套统一的标准连接外部工具——日历、邮件、数据库、代码仓库,全部通过 MCP 接入,不用每个工具单独适配。

为什么要关注它?因为 AI 的能力边界正在从”语言”扩展到”行动”,而 MCP 是让这件事规模化发生的基础设施。

—

## 写在最后

说实话,上面这些概念没有一个是我”先学后用”搞懂的。全部是用着用着碰壁了,回头一查才恍然大悟。

AI 工具迭代极快,三个月前的最佳实践今天可能已经过时。与其追求一次性学会所有东西,不如保持一个习惯:**碰到不懂的术语就停下来查清楚,然后继续走。**

AI 时代真正稀缺的不是知识——知识已经被 AI 拉平了。稀缺的是你能不能把跨领域的知识串联起来,形成自己的判断力。

而这件事,没有任何 AI 能替你完成。

—

*如果这篇对你有用,欢迎转发给同样在用 AI 但被术语困住的朋友。*

夜雨聆风

夜雨聆风