AI给我的,不只是效率,还有推倒重来的自由

今天我把跑到一半的巴菲特知识库整个删掉了。

删完之后,我没有懊恼,反而觉得很轻松,甚至觉得完全 OK。

如果放在以前,我大概率不会这么做。因为里面已经有一些生成出来的内容,甚至有几页 wiki 页面,我自己看着都觉得还不错。真要全部删掉,通常会觉得可惜,会犹豫,会想,要不要再修一修,要不要再补一补,要不要再救一救。

但今天我没有。我直接删了。

这件事让我很强烈地意识到,AI 带来的一个变化,不只是让人做事更快了,而是让人更敢于推倒重来了。

一开始,AI 给了我一套看起来很完整的架构

一开始搭这个巴菲特知识库时,AI 帮我设计了一整套流程。从raw -> source -> wiki -> output。乍一看,这套结构非常完整,也很像一个“专业的知识库工程”应该有的样子。

所以一开始,我是相信这套架构的。我跟着它往下走,也确实做出了不少东西。

但问题是,做着做着,我开始不对劲了。

我中途其实问过 AI 好几次:既然已经有了 raw,source 这一层是不是一定还需要?再往上到 wiki,这中间是不是有点太重了?AI 的回答基本都很一致:需要,这样结构更完整,这样后续更方便维护,这样更利于沉淀。

这些话从逻辑上听都没错。但我在实际推进的过程中,体感却越来越明显地告诉我,这套东西不对。

方案在逻辑上成立,不代表它适合你当前的问题

后来我慢慢意识到,这是一个很常见但也很容易被忽略的问题。AI 很擅长给出一个看起来完整、系统、逻辑自洽的方案。它甚至会把每一层都解释得头头是道,让你觉得:对,这样才专业,这样才像回事。

但“逻辑上成立”,和“适合你当前要解决的问题”,其实是两回事。

对我来说,这次最大的坑,其实不是抽象的“架构过重”,而是我在真正开始做 wiki 之后,才一步步感受到质量问题是怎么暴露出来的。

一开始我会觉得整体推进得不顺,是因为已经开始写 wiki 了。可一旦 wiki 要链接回 source。然后我就发现,source 的质量其实很差,很多地方读起来都不顺,调起来也很痛苦。

那个痛苦不是理论上的,而是非常具体的。你一边想把 wiki 做好,一边却发现自己不得不反复回去修 source。这时候就会开始怀疑,source 这一层到底有没有那么大的意义。

再后来,我甚至试过让 wiki 直接 backlink 回raw原材料。结果一连回去,又会发现 raw 本身的编排质量也很差。也就是说,问题不是只出在某一层,而是你越往回追,越发现底层本身就不够好。

到这里我才真正意识到,自己不是在修一个局部问题,而是在不断被一个质量不够好的底座拖住。

后面我找到了更好的数据源,就更清楚地感受到,既然已经有更好的底层材料,这些半成品式的原材料其实也没有必要继续将就了。干脆整个推倒重来,反而更轻。

AI 真正改变的,是试错成本

我今天删掉整个文件夹的时候,心里其实很平静。

这让我意识到,AI 真正改变的一件事,不只是提效,而是大幅降低了试错成本。

以前很多时候,我们不是没有判断力,而是不敢判断。因为一旦判断错了,返工太贵,重来太慢,已经投入的时间和精力太多,推倒重来的心理负担也很大。

所以很多人最后会选择继续修补一个自己明明已经觉得不对的系统。不是因为它真的值得修,而是因为已经花了太多成本,不甘心。

但 AI 把这件事改了。

现在你可以先跑一条路,先试,先做,先感受。如果跑下来发现它确实很烦、很繁琐、很低效,甚至让你越来越不开心,那你就可以推倒,重来。

因为你知道,重做不再像以前那么贵。搭起来更快,改起来更快,重新试一版也更快。

于是人就开始拥有一种以前很难拥有的自由:我删得起。

最近还有一个很具体的例子,也让我对“试错成本下降”这件事感受特别深。

最近 Harness 很火,它会把任务拆成三个 agent,比如 planner、generator、evaluator。这个思路看起来很完整,也很像一个更严谨的 agent workflow。

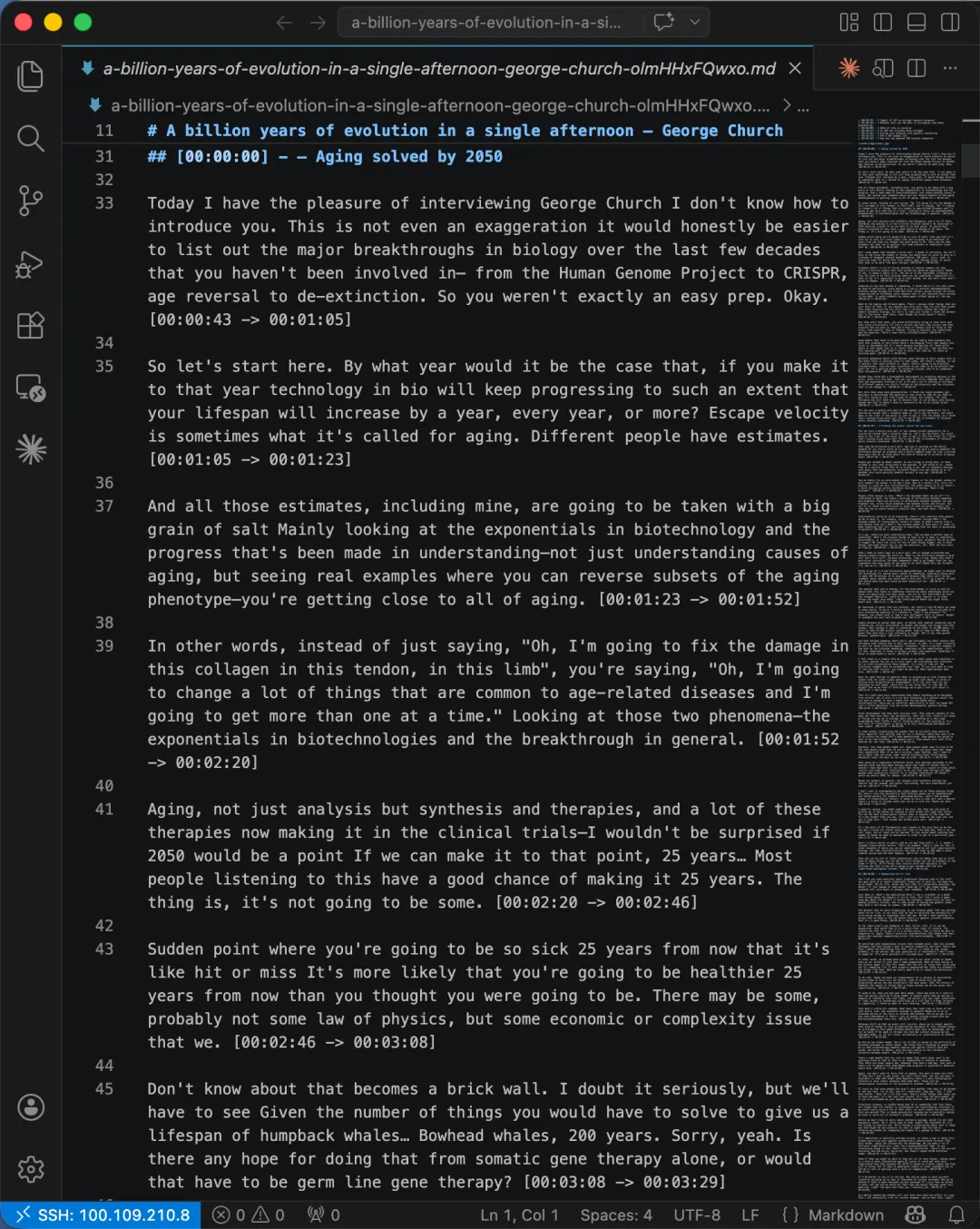

我前阵子设了一个小项目,想整理 Dwarkesh 全部的播客内容。于是我让 Claude Code 按这个思路拆成三个 agent 去跑。

结果一开始,光是写计划和写质检标准,就已经花了很长时间。后面又跑了 N 个回合,看起来流程很完整,步骤也不少。

但最后出来的内容,其实根本不可读。下载下来的文本,基本就是 YouTube 右侧那种一小句一小句的碎片,几乎没法直接用。

后来我同步用 Codex 做了另一个版本。没有先上那么完整的多 agent 架构,而是直接告诉它目标,先把内容下载下来,再让它自己检查和处理可读性。

最后出来的东西,反而非常可读。

(左图为三agent版本,右图为直接下载版本)

|

|

这个对比让我更确定一件事:完整的架构,并不是任何任务都需要的,也不是只要结构更复杂,就一定能提高质量。

很多时候,还是得养自己的判断力。先敢于试,再根据结果做裁剪,而不是因为一个方案看起来更完整,就默认它一定更对。

“删得起”,会反过来增强人的判断力

我觉得今天最大的感触就是,当一个人知道自己删得起、重来得起的时候,他反而更敢于诚实地面对自己的真实感受。

这条路径是不是太重了?这个结构是不是其实没有必要?这个系统是不是只是“看起来很完整”,但自己用起来越来越不顺?

以前很多时候,我们明明已经感觉到了问题,却还是会压住这种感觉,因为一旦承认这条路不对,就意味着前面做的很多东西都要重来。

但现在,AI 让“重来”这件事变得没那么可怕。所以人反而更有可能做出真正清醒的判断。不是因为 AI 替你判断了,而是因为 AI 让你终于有条件去判断。

写在最后

今天我把整个巴菲特知识库删掉的时候,没有觉得沮丧,反而觉得轻松。

因为我知道,就算里面已经有一些看起来不错的页面,也没关系。重新做一遍就好了。

这种感觉背后,不只是效率的提升。

更重要的是,快速迭代给了我一种新的勇气:当我发现一条路不对的时候,我可以承认它,停止它,删掉它,然后重新来过。

AI 不是让人不再判断。

恰恰相反。

AI 让人终于更敢于判断。

夜雨聆风

夜雨聆风