AI帝国的内幕与那些手搓算法的人

01 开场:那个想捂紧钱包的瞬间

各位好!很高兴今天能在这儿跟大家聊点”不合时宜”的大实话。

最近大家出门,是不是感觉像进了科幻片片场?所有人都在谈论AI,好像我们马上就要么长生不老,要么被终结者追杀。

但我想先给各位泼盆冷水。

如果你听到一个硅谷大佬深情款款地告诉你:”我正在造一个拯救全人类的神器,虽然它有25%的概率会顺便把人类文明给抹了,但只要把钱和权力都给我,我保证带大家飞。”

这时候你最该做的不是膜拜,而是捂紧钱包,然后问一句:”哥们,你是不是在对我搞煤气灯操纵(Gaslighting)?”

本文内容取材自资深记者Karen Hao的深度调查。她曾是《麻省理工科技评论》的资深记者,采访了250多人,写了一本书叫《AI帝国》。她告诉我们:那些高大上的AI公司,其实正在玩一场古老的、帝国扩张的游戏。

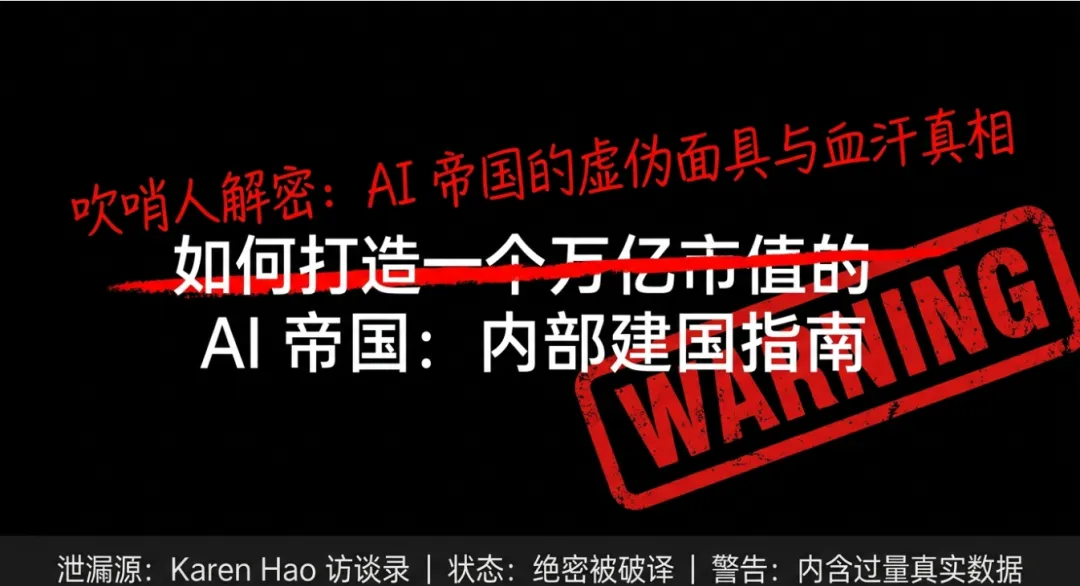

02 AGI——硅谷的”渣男画大饼”

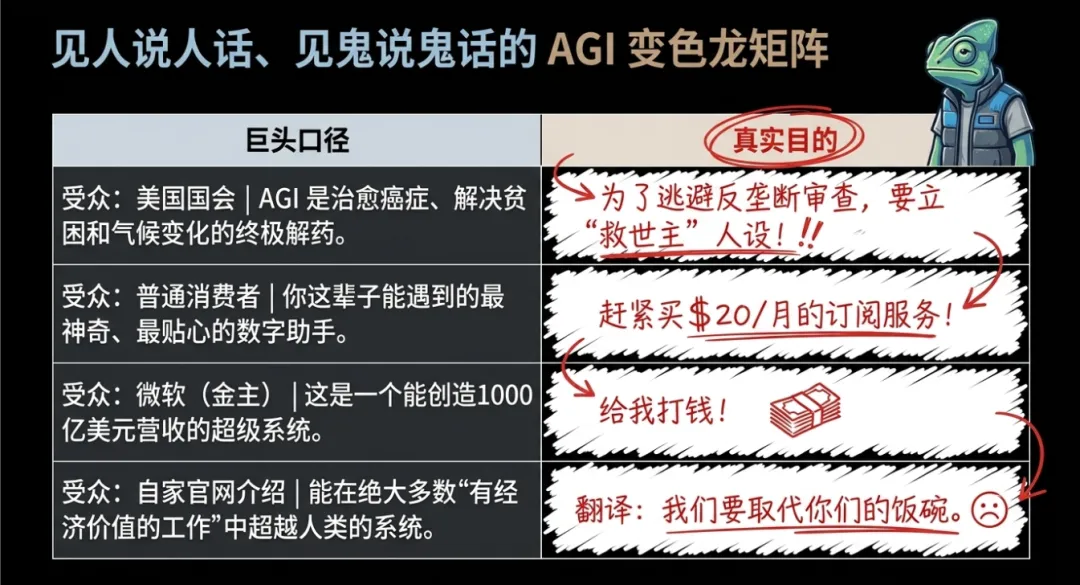

首先,咱们得聊聊”AGI”(通用人工智能)这个词。

这操作像不像那种典型的”渣男”?

跟A姑娘说会给她一个家,跟B姑娘说他只想搞事业,其实他只是想让你多投点钱。

这种定义上的混乱,本质上是为了逃避监管和持续扩权。因为目标永远在变,你就永远没法验证他到底做到了没有,只能不停地买单。

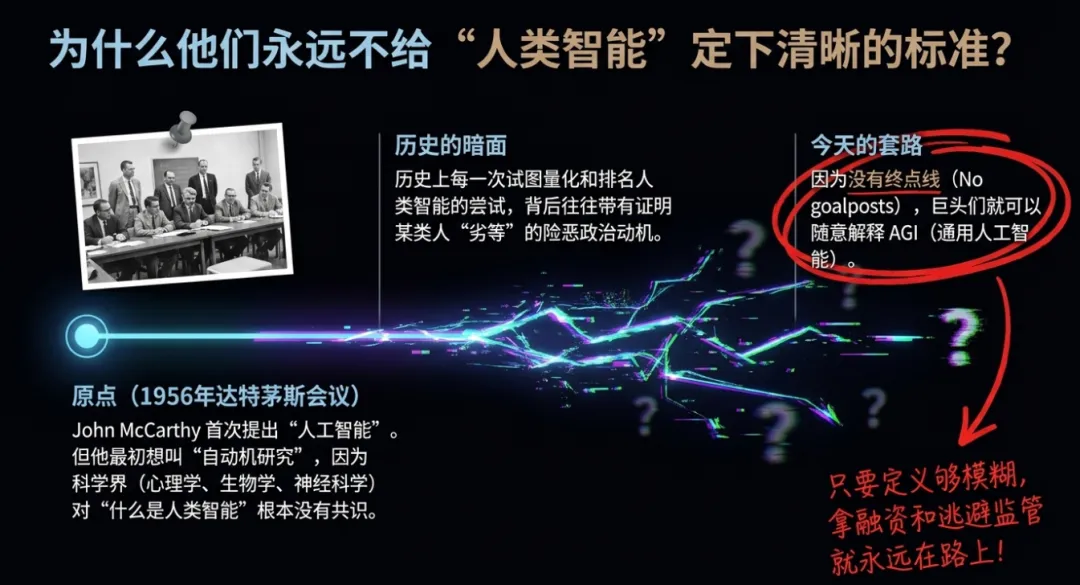

03 所谓的”智能”,其实是”人工”加上”智能”

大家有没有想过,当你对着手机喊”嘿,帮我画一只戴着墨镜的柯基”,AI为什么能精准地识别出那是柯基而不是一坨长了毛的吐司?

是因为它真的”进化”出了智慧吗?

不,真相是:那是成千上万个真实的人,在深夜对着屏幕帮它画了无数个框,并告诉它:”看好了,这是狗,不是吐司!”

Karen的采访给我们揭开了一个残酷的真相:AI行业正在把人类的智慧”切碎了卖”。

这套流程有个高大上的名字,叫“数据标注(Data Annotation)”。听起来像是给文件盖章,但实际上,它是数字时代的”血汗工厂”。

当硅谷大佬们在PPT上展示AI如何”自主思考”时,背后其实有几十万甚至上百万名外包劳工,在像机器一样重复劳动。

比如自动驾驶。你以为特斯拉是在靠算法洞察世界?其实是有成千上万的人在录像里一帧一帧地画框:这个是行人,那个是红绿灯,那是车道线。

所谓的”统计引擎”,其实是靠人类的体力活堆出来的。

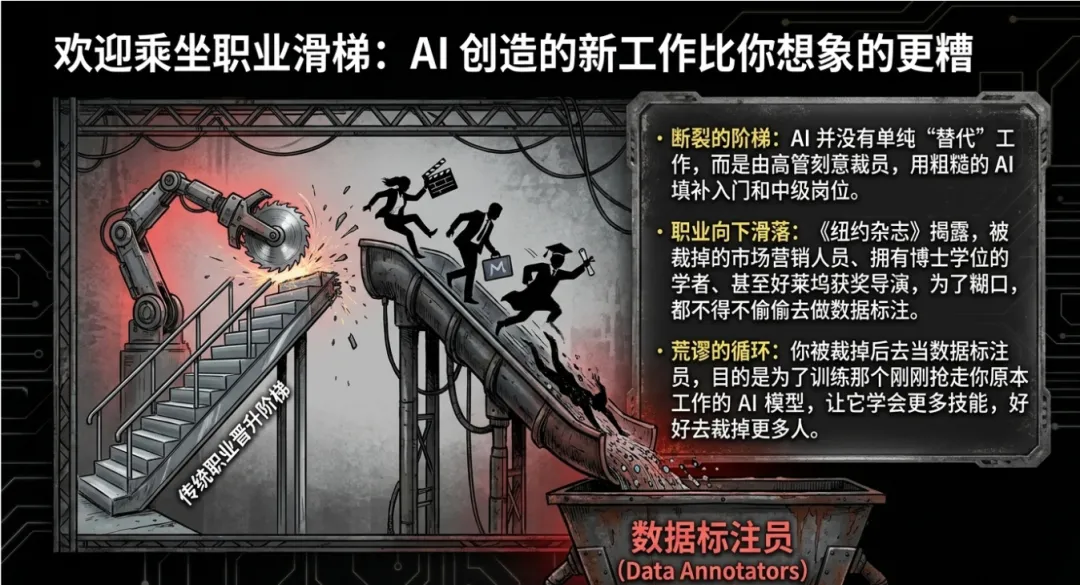

04 “数字时代的滑梯”:你被裁了,然后回来训练你的替代者

接下来的部分可能会让你觉得有点像恐怖片,或者像那种极其荒诞的讽刺剧。

Karen发现,现在的AI行业出现了一个诡异的“闭环”:

很多高级白领,比如资深市场策划、甚至是拿过奖的好莱坞导演,他们被AI公司裁掉了。

为了糊口,他们只能去给数据标注公司打工——而他们的工作内容,正是把自己毕生的专业知识,通过标注的方式,”喂”给那个刚刚抢走他们饭碗的AI。

这就像是你刚被一台自动割草机解雇了,然后公司又雇你回草坪上,让你跪在地上教那台机器:”嘿,哥们,这边还有一根草没割干净。”

这不是职业阶梯,这是职业滑梯,而且滑梯下面还长满了倒钩。

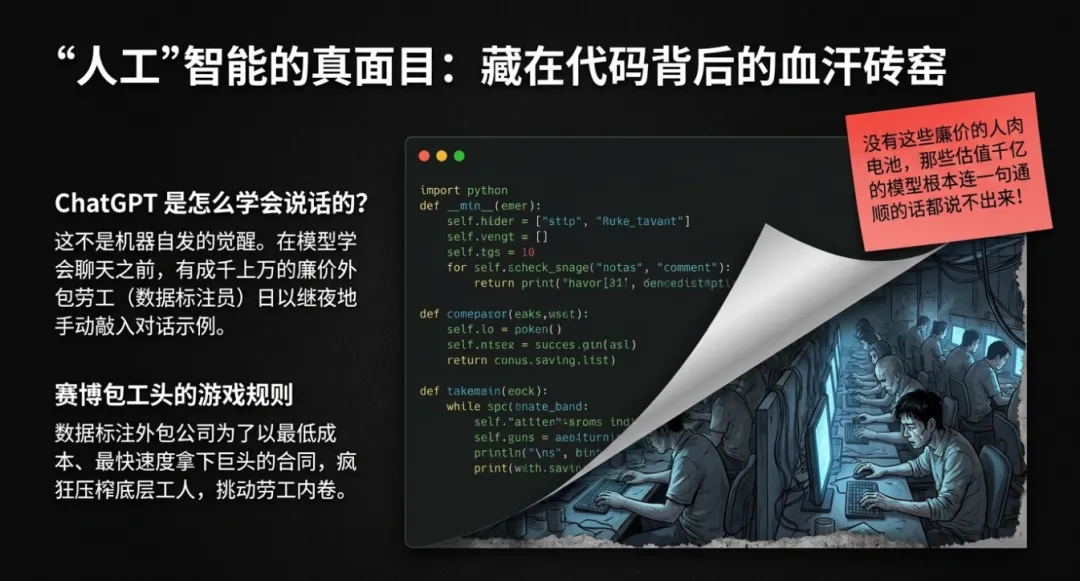

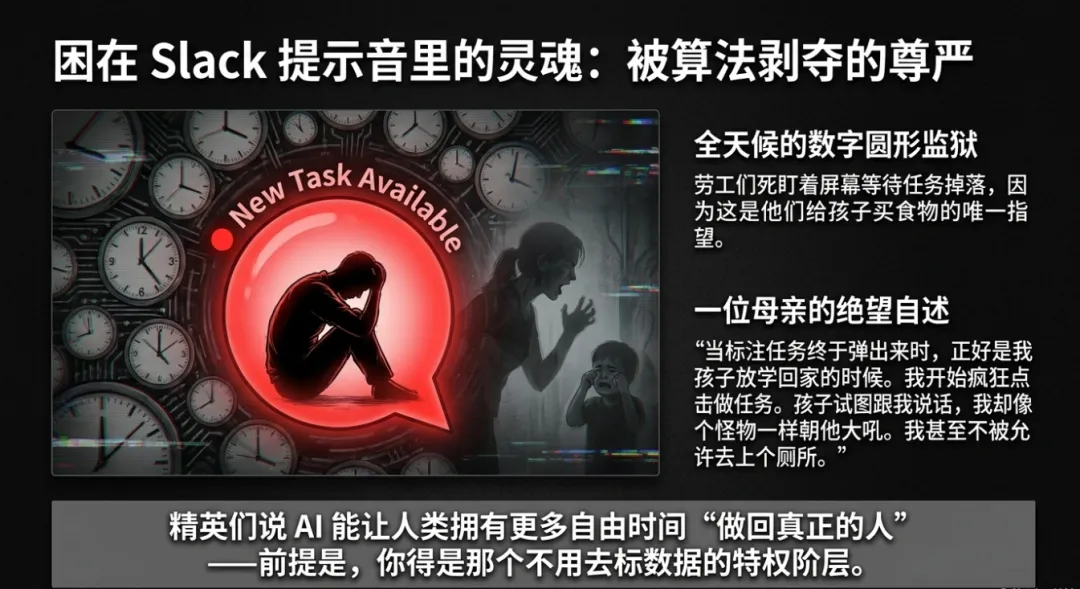

05 被”机械化”的人类:别让孩子打扰我标注

Karen采访了一些标注员,他们的生活状态简直可以用“非人”来形容。

由于第三方外包公司为了竞标,会疯狂压低成本,并让标注员们互相竞争。这些标注员必须守在电脑前,随时等待Slack上的任务提醒——因为一旦手慢了,活儿就被别人抢走了。

一位高学历的标注员说,当她正疯狂在电脑前工作(为了给孩子攒饭钱)时,她的孩子放学回家想和她说话,她却对着孩子大声尖叫。她说:”我变成了一个怪物。”

在这个系统里,AI变得越来越像人,而真正的人却被要求像机器一样工作:不准去厕所,不准被打扰,甚至不准有情绪。

这哪是在造福人类?这简直是在”原子化”人类。

06 硅谷版”宫斗剧”与恐惧生意

聊到这儿,咱们不能不提OpenAI的那场”宫斗”。Sam Altman被董事会开除又闪电复活,这剧本连编剧都写不出来。

Karen发现,大家对Altman的评价极端对立:要么觉得他是当代的史蒂夫·乔布斯,要么觉得他是顶级的操控者和说谎者。

甚至连他的亲密战友Ilya Sutskever都被吓到了,说“不觉得Sam应该是那个手握AGI按钮的人”。

最幽默的是,这些大佬们一旦闹掰,就会出去开一家新公司,名字起得一个比一个有内涵。Ilya离开后开了一家叫“安全超级智能”(Safe Superintelligence)。

这就好比我跟你合伙开了个电台,结果我跑路了,反手开了个频道叫”安全播客”。这潜台词不就是说你那儿不安全吗?

为什么他们一边说AI可能会毁灭世界(召唤恶魔),一边又拼命加速研发?

Karen拆穿了这个神话:“召唤恶魔”的叙事其实是权力的护身符。他们说:”因为AI太危险,所以绝对不能让别人(比如兔子,或者你家隔壁的程序员)先搞出来,只有我们这种’善良的帝国’控制它,大家才能安全。”

这就是典型的:用恐惧换取控制权。只要你害怕,你就不会质疑他们占用了多少水资源、污染了多少空气、剥夺了多少人的尊严。

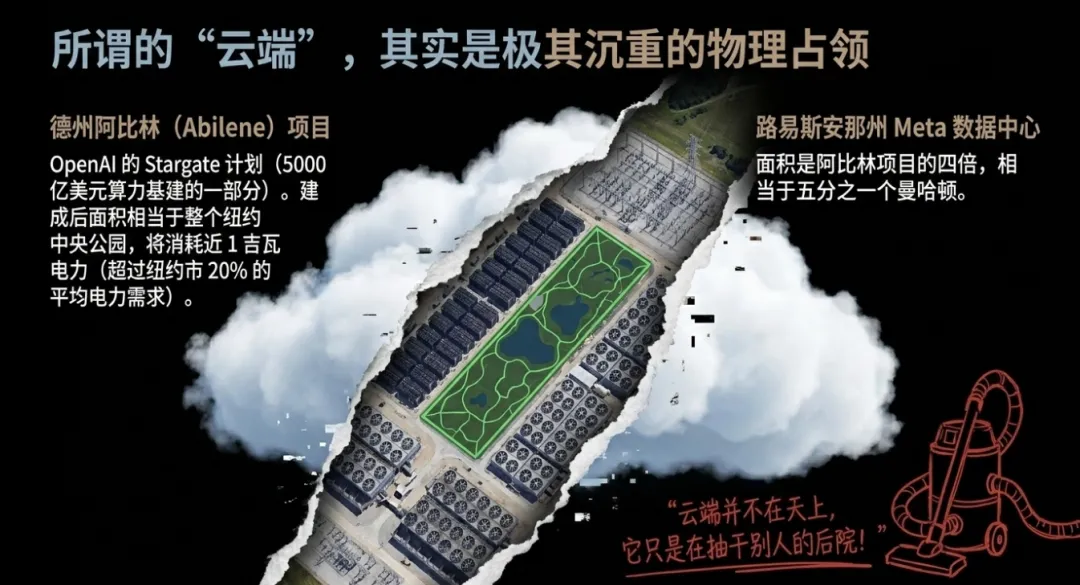

07 AI帝国的”圈地运动”

Karen把这些AI巨头称为”帝国”,这可不是为了耍帅。她认为这些公司完美复刻了古代帝国的掠夺套路:

抢资源(Land Grabbing)

古代帝国抢土地,AI帝国抢数据和算力中心。他们把艺术家的作品、记者的报道、甚至咱们在网上发的牢骚,全当成免费的燃料。

比如德克萨斯州那个比中央公园还大的数据中心,耗电量甚至超过了纽约市的20%!

制造”被牺牲的社区”

在孟菲斯,马斯克造了个超级计算机,用了35台燃气轮机。当地居民说,他们在客厅里都能闻到漏气的味儿,空气质量直接崩盘。

这就是为了精英们的”数字乐园”,牺牲了普通人的”清新空气”。

知识垄断

他们让你觉得”只有我们懂AI”,然后反手就解雇那些说真话的研究员。Karen提到,谷歌曾解雇了自家的伦理研究员Timnit Gebru,就因为她写论文指出了大模型的潜在危害。

这种”顺我者昌,逆我者封杀”的操作,妥妥的帝国风范。

08 这种”暴力缩放”真的有意义吗?

AI巨头们现在痴迷于一种叫“暴力缩放(Brute Force Scaling)”的邪教:只要我喂的数据够多,用的算力够大,烧的标注员够狠,我就能造出”神”。

为什么我们要花这么多钱,去造一个”完全取代人类”的火箭,而不是去造一个”增强人类能力”的自行车?

比如赢得诺贝尔奖的AlphaFold,它只用了很小的数据集,却解决了困扰人类几十年的蛋白质结构难题。它不需要几十万人去画框框,它直接救命。

这才是我们真正需要的技术,而不是一个能模仿你说话、但要靠压榨无数标注员才能维持运转的”大模型”。

09 结语:我们需要的是”自行车”,而不是”火箭”

Karen提了一个很有趣的比喻:我们现在的AGI是“AI里的火箭”——耗能巨大,代价极高,普通人用不起,还可能炸。

为什么我们不多造点”AI自行车”?专注解决特定问题,数据量小,能耗低,却能实实在在地改善生活。

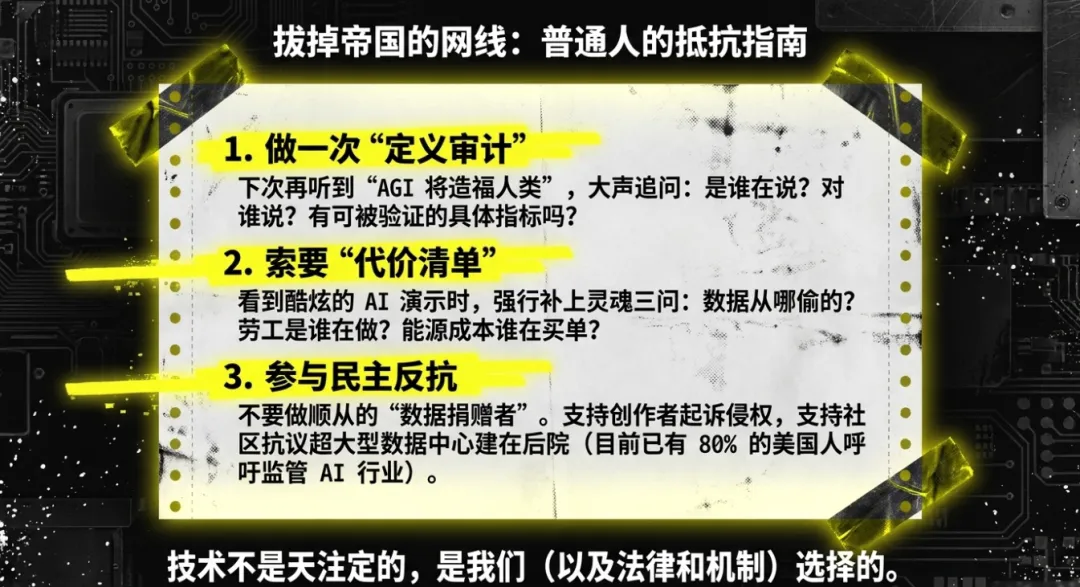

1. 做一次”定义审计”

下次再听到什么”造福人类”、”安全对齐”,先问问:谁说的?指标是啥?千万别被那些宏大叙事PUA了。

2. 追问”代价清单”

每次看到那些酷炫的演示视频,心里默念一句:这些数据哪来的?谁在背后画框框?这玩意儿一小时耗几吨水?

3. 别让它过得太Flawlessly(顺利)

Karen提到,OpenAI内部压力很大,因为他们的营收目标高得离谱,需要全世界每个人都乖乖买单。

如果我们不认同这种帝国模式,那就支持那些透明、开放、有治理机制的替代方案。拒绝做沉默的数据贡献者,也是一种民主的对抗。

写在最后

AI应该是为了改善人类的生活,而不是为了把人变成机器的零件。

我们要的是更人性化的连接,而不是被一个”帝国”安排得明明白白。

希望大家都能骑上自己的“AI自行车”,而不是被别人的“AI火箭”给撞了!

你做过”定义审计”吗?欢迎在评论区分享你对某个AI大厂 slogan 的质疑,或者提出你的观点。

本文核心观点参考资深记者Karen Hao的著作《AI帝国》及相关深度采访,结合中文语境进行深度解读与评论。请保持清醒,自我思考,谨慎阅读。

夜雨聆风

夜雨聆风