ClaudeCode爆款插件推荐之caveman,你的省token神器

“ 不是在学习,就是在学习的路上。。。。。。”

Caveman是一个为ClaudeCode设计的插件,目的是减少与AI交互时的Token消耗。它不改变模型本身,而是通过修改输入提示词的结构,让AI输出更紧凑、更高效的内容。其核心机制是“语义压缩”,强制AI删除语言中的冗余部分,只保留技术核心

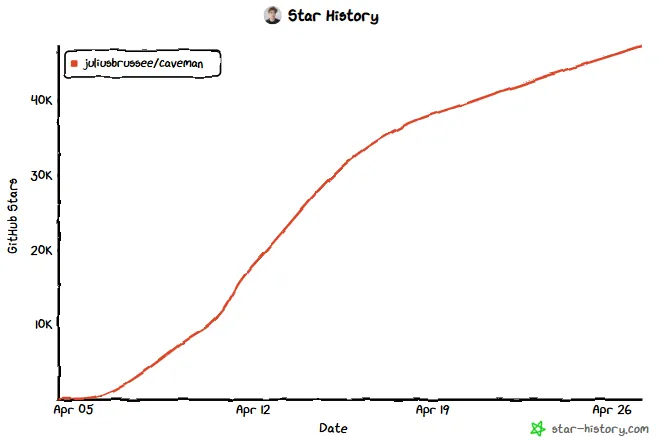

地址:https://github.com/JuliusBrussee/caveman

特点

Caveman的主要特点是通过去除冗余词汇来降低Token使用量,并在特定场景下提升任务效率。

效率与成本数据对比

|

任务场景 |

平均Token节省率 |

关键性能变化 |

|

代码生成 |

65% |

复杂问题最高节省87% |

|

错误诊断与调试 |

50%-70% |

首次尝试成功率从64%提升至71% |

在内部技术讨论、代码重构和错误日志摘要等场景中,Caveman能有效减少资源占用。但在需要情感交流或详细解释的场景(如教学材料、外部API文档)中,其输出的可读性会下降,不适合直接使用。

怎么用

使用Caveman需要在与AI交互的提示词中加入特定的约束规则。

1. 删除冗余:在指令中明确要求AI剔除冠词(a/an/the)、填充词(just/really)、客套话(sure/certainly)和犹豫性表达

2. 保留骨架:允许使用短句和碎片句,不要求完整语法,但必须保留技术术语、代码块和错误信息的完整性

3. 模式化表达:采用“[thing][action][reason]”的结构进行输出。例如,将“请帮我写一个Python函数来计算斐波那契数列”压缩为“Write Python function: Fibonacci(n). Return nth value.”

夜雨聆风

夜雨聆风