AI知识库,正在变成每个行业的第二大脑

这两年大家用 AI,最常见的一个感受是:

模型很聪明,但它不认识你的世界。

你问它通用问题,它能回答得头头是道。可一旦进入具体业务,它就开始犯迷糊。

一家律所想让 AI 看合同,它不知道你们过往的判例、模板、风险偏好。

一家医院想让 AI 做辅助诊疗,它不了解科室内部的流程、历史病例和质控规范。

一家制造企业想让 AI 帮忙排查设备问题,它不知道你们产线上的真实故障记录。

一家咨询公司想让 AI 写行业分析,它不了解你们多年沉淀下来的方法论、客户案例和调研材料。

这就是今天很多企业用 AI 的尴尬:

AI 有大脑,但没有你的记忆。

所以,AI 知识库这件事,重要性正在快速上升。

它本质上解决的,是把一个组织、一个人、一个行业长期积累的信息,整理成 AI 能检索、能理解、能调用、能持续更新的形态。

如果说大模型是一个通用大脑,那么知识库就是它的“第二大脑”。

它决定了 AI 到底是一个泛泛而谈的聊天机器人,还是一个真正懂你业务、懂你行业、懂你历史的人机协作伙伴。

为什么每个行业都需要自己的 AI 知识库?

过去的信息系统,更多是在“存资料”。

企业有网盘,有文档系统,有 CRM,有 ERP,有邮件,有飞书群,有微信聊天记录,有会议纪要。

问题是,资料越存越多,人却越来越难找到。

很多公司的知识,其实散落在三个地方:

一个在文件夹里。

一个在老员工脑子里。

还有一个在没人愿意翻的聊天记录里。

这就造成了一个很常见的现象:

新人入职,重新问一遍。

客户来了,重新整理一遍。

项目复盘,重新翻一遍。

老板要汇报,重新拼一遍。

知识没有真正流动起来。

AI 知识库的价值,就在这里。

它可以把原来散落的信息,重新变成一个能被 AI 使用的系统。

对法律行业,知识库可以沉淀法规、判例、合同模板、过往项目经验,让 AI 更快找到相似案例和风险点。

对医疗行业,知识库可以整合指南、论文、病例、诊疗路径、药品信息,辅助医生做更稳妥的判断。当然,医疗场景必须强调合规和人工审核。

对教育行业,知识库可以沉淀课程内容、学生问题、教学案例、题库和学习路径,让 AI 从“会讲知识点”升级成“懂学生情况”。

对制造业,知识库可以整理设备手册、维修记录、工艺参数、质检报告,帮助一线人员快速定位问题。

对金融行业,知识库可以连接研报、政策、客户画像、风控规则和历史交易数据,让 AI 更像一个随时在线的分析助理。

对媒体和内容行业,知识库可以沉淀选题库、采访资料、历史文章、人物关系、行业脉络,让创作不用每次都从零开始。

你会发现,AI 知识库真正改变的,不只是“查资料”这件小事。

它改变的是一个组织调用知识的方式。

过去是人去找资料。现在是 AI 帮人理解资料、串联资料、生成新内容。再往后,AI 甚至可以主动维护这些资料。

这就是“第二大脑”的核心价值。

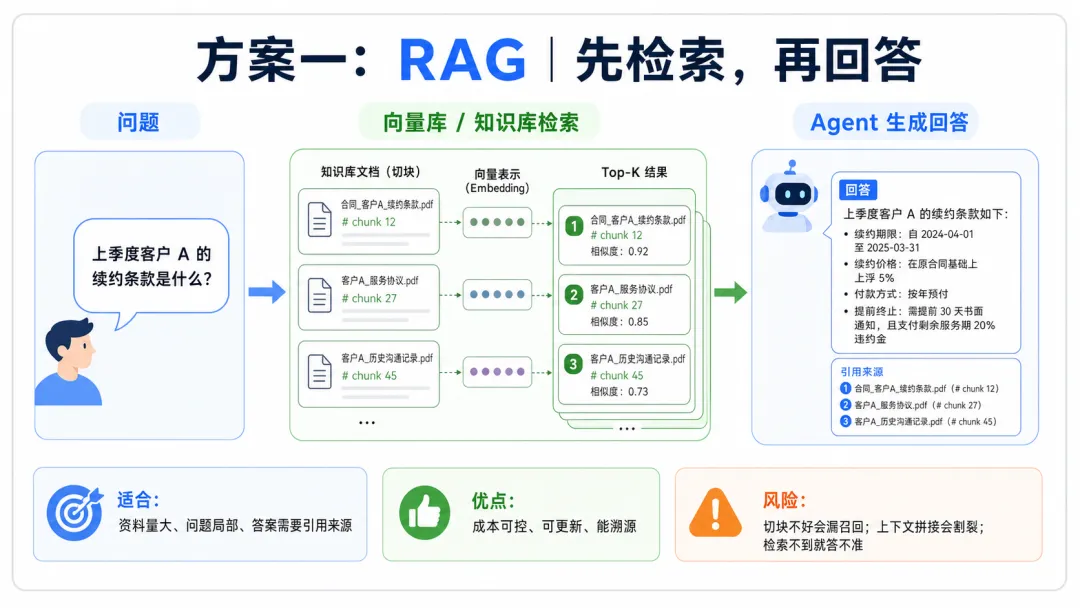

第一代方案:RAG,先解决“AI 不知道”的问题

说到 AI 知识库,最早被大量使用的方案就是 RAG。

RAG,全称是 Retrieval-Augmented Generation,中文一般叫“检索增强生成”。

听起来很技术,其实逻辑很朴素。

你问 AI 一个问题。系统先去知识库里检索相关内容。再把检索到的资料塞给大模型。最后让大模型基于这些资料回答。

它像一个“带资料夹的 AI 助理”。

你问:“这个产品的售后政策是什么?”它先去文档里找售后政策。找到相关段落后,再组织成一个自然语言答案。

RAG 的出现,解决了大模型一个很关键的问题:

模型训练时不知道你的私有资料,也不知道最新资料。

大模型本身再强,也不可能天然知道你公司昨天更新的产品文档、上周的会议纪要、今年刚签的客户合同。

RAG 把外部知识接进来,让 AI 能基于指定资料回答问题。

这一步很重要。没有 RAG,很多企业 AI 应用根本落不了地。

RAG 的优势很明显。

第一,成本低,落地快。

企业原来有一堆 PDF、Word、网页、知识库文档,把它们切分成文本块,做向量化,放进向量数据库,再接到大模型上,一个基础问答系统就能跑起来。

第二,对大模型要求没那么高。

模型自己不知道没关系,外部检索能把材料补上。

第三,可以降低胡说八道的概率。

如果回答能引用到具体文档,可信度会比纯靠模型“凭印象回答”高很多。

第四,适合大规模资料库。

当资料特别多,比如几万份合同、几十万条客服记录、海量产品文档,直接全塞给模型不现实,检索就成了必要步骤。

所以,RAG 到今天依然很有价值。尤其在企业知识问答、客服机器人、合同检索、政策查询、内部文档助手这些场景里,RAG 还是主流方案。

但 RAG 的问题,也越来越明显。

RAG 最大的问题,是它把“找资料”这件事交给了一套检索系统。

如果检索没找到,后面的回答就很难好。

很多人做过 RAG 项目,都会遇到几个经典坑。

第一个坑:切块切不好。

文档要切成小块,方便检索。切太小,语义断了。切太大,噪声多了。标题、表格、脚注、图片说明、跨页内容,都会让切块变得很麻烦。

一个合同条款,前半句在上一段,后半句在下一段。系统只检索到其中一块,AI 就容易误解。

第二个坑:检索不一定懂业务。

向量检索擅长找“语义相近”的内容,但业务问题经常没这么简单。

用户问的是“这个客户能不能走特殊审批”。真正相关的信息,可能藏在客户等级、历史付款记录、合同条款、审批制度、部门惯例里。

这些东西不一定出现在同一个文档里。

检索系统如果只找到了其中一两段,答案就会很片面。

第三个坑:召回和精度很难同时做好。

召回多一点,资料变杂,模型容易被噪声干扰。召回少一点,关键证据可能漏掉。

这就是 RAG 工程里特别头疼的地方。

你需要调 chunk size、top-k、reranker、metadata、过滤规则、混合检索、query rewrite……一套下来,越来越像搜索引擎工程。

第四个坑:RAG 缺少长期记忆的组织能力。

RAG 很擅长“临时找一段资料”。

可它不太擅长把资料长期整理成结构化知识。

今天查了一次 A 公司,明天查了一次 B 公司,后天又问某个行业趋势。这些问答通常不会自动沉淀成一套越来越完善的行业知识网络。

用完就散了。

这也是为什么很多 RAG 系统刚上线时很惊艳,用久了之后大家发现:它能回答问题,但不一定真的“懂业务”。

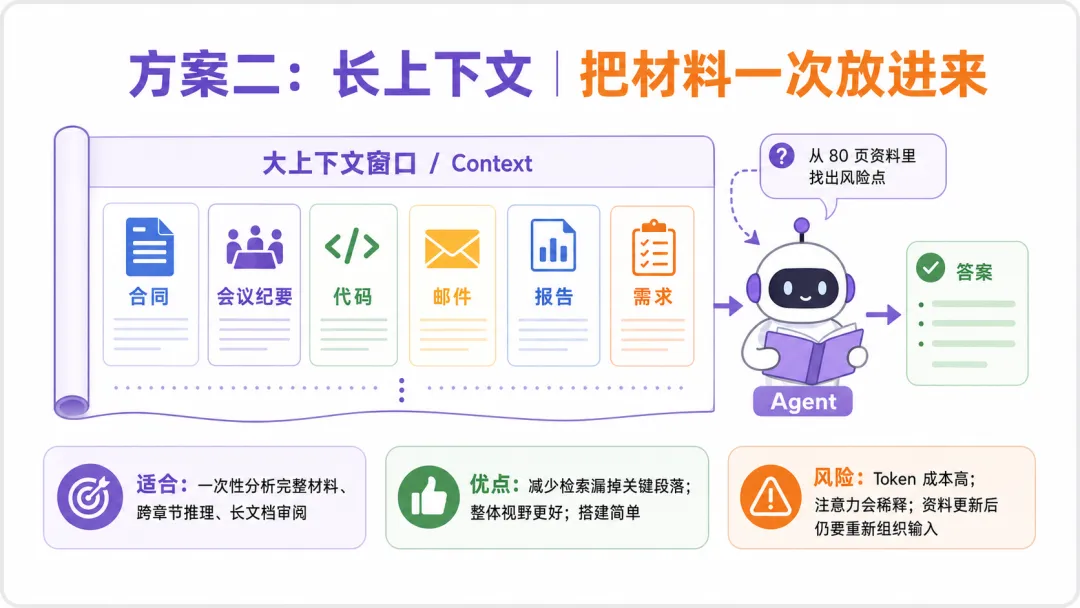

第二代方案:上下文工程,把资料直接交给大模型

随着大模型上下文窗口越来越长,很多人开始尝试另一种方式:

既然模型现在能读几十万字、上百万 token,那我干脆把文档全塞进去,让它自己看。

这就是近一年特别火的“上下文工程”。

它的核心思路是:先把和任务相关的文档、规则、历史记录、示例、工具说明,组织成一个高质量上下文,再交给模型处理。

在一些场景里,这招非常好用。

比如你只有几十份文档。比如你要分析一个项目资料包。比如你要让 AI 读完整的产品说明书、会议纪要、用户反馈,再写一份总结。比如你要让 AI 理解一个代码仓库里的规范、架构和历史讨论。

这时候,全量上下文比 RAG 更自然。

因为模型拿到的是完整材料,它不需要先猜“该检索什么”。

这点很关键。

很多复杂问题,在提问的时候根本不知道该搜哪个关键词。

你让 AI 判断一个项目为什么失败,它可能需要同时看战略文档、会议纪要、客户反馈、财务数据和团队复盘。

用长上下文,模型可以通读材料后自己建立判断。

所以,上下文工程的优势是:

信息更完整,推理更连贯,适合复杂分析。

这也是为什么现在很多 AI 编程工具、AI Agent、文档分析工具,都越来越重视上下文工程。

Claude Code 读 CLAUDE.md。Codex 读项目说明。各种 Agent 读 AGENTS.md、README、任务文件、历史日志。

本质上都是在给 AI 搭一个“工作现场”。

但全量喂知识,也有自己的麻烦。

很多人一听上下文变长,就觉得知识库问题要被彻底解决了。这个判断有点乐观。

上下文长了,确实能装更多东西。但“装得下”和“用得好”是两回事。

第一个问题:成本高。

你每次问一个问题,都把大量文档塞进去,token 成本会很快上来。

对个人还好。对企业级应用来说,如果每天有几千、几万次调用,这个成本会非常明显。

第二个问题:速度慢。

上下文越长,模型读得越慢。用户只是问一个小问题,系统却让模型读一大堆材料,体验会变差。

第三个问题:注意力会被稀释。

长上下文并不等于模型对每个细节都同等敏感。

资料太多,模型可能抓住了前面的内容,忽略了后面的关键点。也可能被一些无关信息带偏。

这就像开会。

把所有人、所有材料、所有聊天记录都拉进来,不代表会议质量会更高。有时候反而更乱。

第四个问题:全量上下文很难持续维护。

文档会更新。旧版本会过期。不同部门会有冲突说法。同一件事在不同文档里可能有不同描述。

如果只是“全量喂进去”,模型很难知道哪个是最新、哪个是权威、哪个只是草稿。

所以,第二代方案虽然绕开了 RAG 的一部分检索问题,但也带来了新的上下文治理问题。

这就引出了第三种思路。

第三代方案:Karpathy 的 LLM Wiki,让 AI 自己整理知识

最近 Karpathy 提到一个很有意思的做法:LLM Knowledge Bases。

也有很多人也叫它 LLM Wiki。

这个思路一下子火起来,是因为它戳中了很多知识工作者的痛点。

Karpathy 的做法大概是这样:

他把文章、论文、代码库、数据集、图片等原始资料放进一个 raw/ 目录。

然后让 LLM 增量“编译”出一个 Wiki。

这个 Wiki 是一堆结构化的 Markdown 文件。里面有主题页、摘要、互链、索引、图表、概念解释。

后续他问问题时,AI 可以读取这个 Wiki 来回答。回答完之后,一些有价值的输出还可以再写回 Wiki。

这里最有意思的词,是“编译”。

Karpathy 把原始资料看成源代码。把结构化 Wiki 看成编译产物。LLM 扮演的是编译器和维护者的角色。

这个类比很妙。

因为人类真正需要的,通常不是原始资料本身。

我们需要的是被整理过、压缩过、互相连接过、可复用的知识。

一篇论文是一份资料。十篇论文放在一起,只是一堆资料。可如果 AI 能把它们整理成“某个技术路线的演进”“关键人物和机构”“核心争议”“未来趋势”“相关概念解释”,那就开始像知识了。

LLM Wiki 的价值就在这里。

它让知识库从“资料仓库”,变成“会生长的知识网络”。

LLM Wiki 的优势很明显。

第一,它更适合长期积累。

RAG 常常是问一次、检索一次、回答一次。LLM Wiki 更像一个持续更新的资料室。

今天加入一篇文章,AI 更新相关主题页。明天加入一份报告,AI 补充行业趋势。后天加入一次访谈,AI 把新的观点挂到对应概念下。

时间越久,这个 Wiki 越厚。

第二,它降低了临时检索的压力。

如果知识已经被整理成主题页、索引和互链,AI 查询时就不必每次都从原始材料里大海捞针。

它可以先看索引,再读相关页面,再必要时回到原始资料。

这更接近人类专家的工作方式。

专家回答问题时,也不会每次从几百份 PDF 第一页开始翻。他脑子里有结构,有目录,有关键概念,有案例记忆。

LLM Wiki 就是在给 AI 搭这个结构。

第三,它让知识更容易复利。

这是我觉得最重要的一点。

一次好的问答,一次好的分析,一次好的总结,如果能沉淀回知识库,下一次就不用重来。

这对咨询、投研、内容创作、科研、产品、法律、教育都很重要。

很多行业的核心竞争力,说到底就是知识复利。

谁能把每天发生的信息整理成可复用的知识,谁就会越用越强。

第四,它对个人知识管理特别友好。

Obsidian、Markdown、本地文件、文件夹结构,这些东西都很轻。

它不像很多企业知识库系统,一上来就要复杂权限、复杂数据库、复杂部署。

个人研究者、内容创作者、产品经理、投资人、咨询顾问,都可以用很低成本跑起来。

当然,这个方案也有坑。

第一个问题:AI 整理出来的 Wiki 可能会出错。

LLM 在“编译知识”的过程中,可能误读、漏读、过度概括,也可能把不同来源的信息揉在一起,产生看似合理但不准确的结论。

这对法律、医疗、金融、科研这些场景尤其危险。

所以,LLM Wiki 一定要保留来源引用。

每个关键结论最好能回链到原始资料。AI 生成的总结,也要和原始来源分层存放。

否则时间一长,你会分不清哪些是一手资料,哪些是 AI 二次加工后的观点。

第二个问题:维护规则很重要。

Wiki 会越长越大。

如果没有命名规范、目录规范、更新规则、去重规则、引用规则,它也会慢慢变乱。

一开始是“第二大脑”。用久了可能变成“第二个垃圾堆”。

所以,LLM Wiki 更像一套知识治理流程。

你要告诉 AI:哪些资料是权威来源,哪些页面可以改,哪些内容只能追加不能覆盖,如何处理冲突信息,如何标注时间,如何区分事实、观点、推测,如何做定期健康检查。

第三个问题:规模上来后,还是需要检索。

如果只是几百篇文章、几十万字,一个 Markdown Wiki 加长上下文可能够用。

但如果到了企业级规模,几百万、几千万、上亿字资料,单靠文件目录和索引就不够了。

这时候,RAG、搜索引擎、知识图谱、数据库查询、权限系统都要回来。

所以 LLM Wiki 更像一个新的中间层。

它把原始资料整理成 AI 更容易使用的知识形态,但底层可能仍然需要搜索、向量库、结构化数据库来支撑。

第四个问题:权限和合规会更复杂。

企业知识库里有大量敏感信息。

客户合同、人事资料、财务数据、商业计划、医疗记录、交易信息。

如果 AI 可以自由读取、总结、改写、再写回 Wiki,权限控制必须非常细。

谁能看什么,谁能改什么,AI 生成内容是否需要审核,输出是否会泄露敏感信息,这些都不是小问题。

个人用 LLM Wiki 很轻松。企业真正落地时,治理成本会明显增加。

更现实的答案:未来知识库会是混合架构

如果把 AI 知识库的发展简单分成三代:

第一代是 RAG。

第二代是上下文工程。

第三代是 LLM Wiki。

这当然方便理解,但真实世界不会这么线性。

在实际行业应用里,最靠谱的方案往往是混合架构。

我更倾向于这样理解:

RAG 负责找。\ 上下文工程负责组织现场。\ LLM Wiki 负责长期沉淀。\ 知识图谱和结构化数据库负责确定性。\ Agent 工作流负责持续更新。

这几个东西会组合在一起。

举个例子,一家企业要做内部 AI 知识助手,比较合理的架构可能是:

最底层,是原始资料库。包括文档、邮件、会议纪要、业务系统数据、网页、图片、音视频转写。

往上一层,是结构化处理。做 OCR、转写、清洗、去重、切分、时间戳、权限标签、来源标注。

再往上一层,是检索层。包括关键词搜索、向量检索、混合检索、reranker、metadata 过滤。

再往上一层,是知识编译层。让 LLM 把高价值资料整理成 Wiki、FAQ、流程卡片、案例库、概念页、行业地图。

再往上一层,是上下文工程层。根据不同任务,动态组装最合适的上下文。

最上层,才是用户真正看到的 AI 助手。它可以问答、写报告、做分析、出方案、生成 SOP、辅助决策。

这套架构听起来复杂,但方向很清楚:

不要把知识库理解成一个“文档搜索框”。

它应该是一个把信息变成知识、再把知识变成行动的系统。

接下来还会出现几类重要方案

除了 RAG、上下文工程、LLM Wiki,我觉得 AI 知识库还会继续往几个方向发展。

GraphRAG:用知识图谱补上关系理解。

很多行业知识不是孤立文本,而是关系网络。

公司和股东的关系。药物和疾病的关系。法规和条款的关系。设备、零件、故障、工艺之间的关系。人物、事件、时间线之间的关系。

普通 RAG 找文本相似度,容易漏掉这些关系。

GraphRAG 的思路,是先把实体和关系抽出来,形成知识图谱,再结合大模型生成答案。

这类方案特别适合金融风控、企业情报、法律案件、医药研发、供应链分析。

它的缺点也明显:建设成本高,实体抽取容易出错,图谱维护很麻烦,业务规则需要专家参与。

但在高价值行业里,它会越来越重要。

Agentic RAG:让 AI 自己规划检索路径。

传统 RAG 通常是一次检索、一次回答。

可复杂问题往往需要多步查证。

比如用户问:“这家公司未来三年最大的风险是什么?”

AI 可能要先查公司业务,再查财报,再查行业政策,再查竞争对手,再查舆情,再综合判断。

Agentic RAG 就是让 AI 像研究员一样,多轮检索、多步推理、边查边改问题。

它更适合复杂研究任务。但它的代价是速度更慢,成本更高,过程更难控。所以它适合高价值问题,不适合所有客服问答。

Memory Layer:把用户和组织的长期记忆沉淀下来。

未来 AI 知识库还会有一层非常重要的东西,叫长期记忆。

它会记住用户偏好、组织习惯、项目背景、历史决策、常用表达、协作方式、哪些答案曾经被采纳、哪些方案曾经失败。

这类记忆,会让 AI 越来越懂你。

个人场景里,它像真正的第二大脑。企业场景里,它像组织经验的沉淀系统。

但这里也会带来隐私和边界问题。AI 记什么,不记什么,谁能改,谁能删,多久过期,都要设计清楚。

多模态知识库:让 AI 读懂文字以外的东西。

未来知识库不会只有文字。

大量行业知识藏在图片、视频、音频、图纸、表格、仪表盘里。

制造业有设备照片和工艺图。医疗有影像和检查报告。教育有课堂视频。零售有门店照片。建筑有 CAD 图纸。媒体有采访录音和视频素材。

多模态知识库会让 AI 不只会读文档,还能理解图像、表格、语音、视频。

这对很多行业会是一次大升级。

Human-in-the-loop:人机共建知识库。

最后还有一点特别重要:高质量知识库不能完全交给 AI 自己长。

它需要人的审核、纠偏和标注。

尤其是高风险行业,专家必须参与进来。

更合理的模式是:AI 负责初步整理,人负责确认关键事实,AI 根据反馈更新知识库,系统记录来源、版本和责任人。

这样知识库才会越来越可靠。

否则,它可能只是一个看起来很聪明、实际上真假混杂的信息堆。

AI 知识库真正解决的,是“信息怎么被使用”

很多人一提知识库,脑子里想到的是资料管理。

文件夹、标签、搜索框、权限、文档分类。

这些当然重要,但 AI 时代的知识库,已经不只是资料管理系统了。

它更像一个新的信息操作系统。

过去,知识库的核心问题是:资料在哪里?

现在,AI 知识库要回答的是:

资料之间有什么关系?

哪些信息可信?

哪些内容过期了?

这个问题该调用哪些知识?

这些知识能生成什么判断?

这些判断能变成什么行动?

这就是 AI 知识库和传统知识库最大的区别。

传统知识库帮人找到资料。AI 知识库帮 AI 使用资料。

这一步变化非常大。

因为一旦 AI 能更好地使用组织知识,它就能进入更多核心工作流:

写方案。

做研究。

审合同。

看报告。

辅助销售。

培训新人。

诊断问题。

生成课程。

复盘项目。

支持决策。

它会从“问答工具”慢慢变成“工作伙伴”。

每个组织都该认真搭建自己的第二大脑

AI 知识库的重要性,未来会越来越高。

因为大模型本身的能力会继续提升,通用智能会越来越便宜。真正拉开差距的,反而是每个人、每家公司、每个行业自己的知识资产。

你的文档。

你的案例。

你的经验。

你的流程。

你的客户理解。

你的失败教训。

你的行业判断。

这些东西如果只是躺在硬盘、网盘、群聊和老员工脑子里,就很难被 AI 调用起来。

一旦它们被整理成 AI 能理解、能检索、能生成、能使用的知识库,价值就会被重新释放。

RAG 是一个起点,它让 AI 能查资料。

上下文工程往前走了一步,它让 AI 进入完整任务现场。

LLM Wiki 又打开了新的想象,它让 AI 开始长期整理和维护知识。

未来最好的 AI 知识库,大概率会把这些方案都融合起来。

它既能检索原始资料,也能维护结构化 Wiki。既能读长上下文,也能调用知识图谱。既能回答问题,也能沉淀答案。既能辅助个人,也能服务组织。

AI 知识库的本质,是把分散的信息重新整合起来,让 AI 更好地检索、理解、生成和使用。

这会成为每个行业进入 AI 深水区之后绕不开的基础设施。

现在很多人还在问:“我该不该做自己的 AI 知识库?”

我的判断很直接:

如果你的工作依赖信息、经验、判断和复用,答案基本就是:应该。

因为未来真正厉害的 AI,不只是模型厉害。

它背后一定站着一个持续生长的第二大脑。

夜雨聆风

夜雨聆风