AI 这门生意,账根本算不平:GitHub Copilot 改按量计费,是补贴时代的第一声丧钟

先把这件事说清楚——

2026 年 6 月 1 日起,GitHub Copilot 全部订阅档位改成按 token 计费。 你交 19 美金月费,拿到的不是「不限量」的 GPT-5 mini,也不是 300 次 Claude Opus 4.6 的 premium request,而是价值 19 美金的 token 余额——烧完就是烧完。

微软的官方公告把这件事包装得非常委婉:「Copilot 已经不是一年前那个 Copilot 了,它进化成了能跑多步骤 agent 任务的平台,算力需求也水涨船高。」

翻译一下——

「我们不能再继续给两百万开发者补贴算力了,再补下去 Amy Hood(微软 CFO)会拿球棒来揍人。」

这句话 Ed Zitron 在上周那篇万字长文里写得很狠。我反复读了三遍,越读越觉得,这不是又一篇「AI 泡沫论」的口水文,是一份冷静、带数字、有时间表的判决书。我把它用中文重写了一遍,结构大体保留,但讲法和口气是我自己的,最后还加了几条我作为开发者每天用 Claude Code 写代码的注脚。

一、月费制是一场结构性的造假

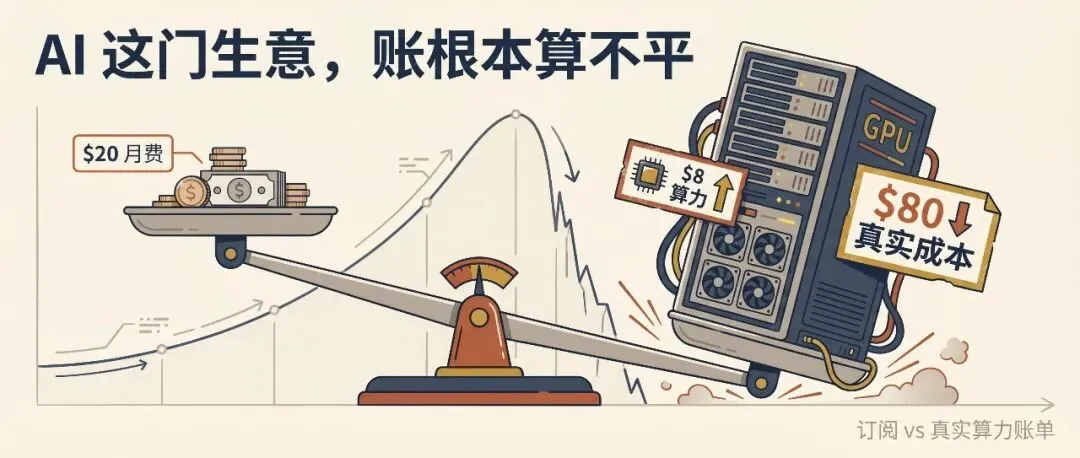

这件事如果你看过《华尔街日报》2023 年那条报道,应该不会陌生——

「GitHub Copilot 个人版定价 10 美金/月。今年前几个月,微软平均每个用户每月亏 20 美金以上,部分重度用户的成本高达 80 美金/月。」

——The Wall Street Journal, October 2023

也就是说,过去整整三年,微软在拿自己的资产负债表给开发者补贴算力,每一份 10 美金的订阅背后是 30 到 90 美金的真实成本。这不是策略性的获客补贴,这是结构性的赔本买卖。

Anthropic 那边更夸张——直到最近为止,你交 1 美金订阅,可以烧掉 8 美金的算力。OpenAI 类似,只是不那么透明。

为什么所有人都这么干?因为他们都在赌同一件事——

「先把用户拉进来用上瘾,等真涨价那天,他们已经离不开了。同时模型成本会随时间下降,到时候我们就盈利了。」

这两个赌注全部输了。

模型成本不仅没下降,还涨了。新一代「reasoning model」每完成一次任务烧的 token 是上一代的好几倍,账面上每百万 token 的单价确实下降了,但每个任务消耗的 token 数翻倍翻倍再翻倍——结果就是单位输出的总成本反而上升。

而用户呢?用户被训练得完全不知道自己在烧多少钱。

二、Uber 比喻不成立——AI 订阅是更恶劣的版本

Ed 这一节写得特别精彩。我直接把他的比喻拿过来——

「想象一下另一个平行宇宙的 Uber:你交 20 美金月费,可以坐 100 次 100 英里以内的车。油价 150 美金一加仑,而 Uber 替你出油钱——因为投资人坚信石油总有一天会便宜到不用计量。」

「然后某一天 Uber 撑不住了,决定改规则:你还是交 20 美金,但每次坐车的油钱自己出。于是一次 10 英里的短途变成 26 美金。 用户当然要造反。」

这就是 AI 订阅的真实结构。

而 Uber 真涨价那次,底层经济学没变——司机还是司机,乘客还是乘客,油钱还是司机自己付。Uber 的亏损来自市场补贴和那个最终烂尾的自动驾驶研发,不是来自「每一单都在亏」。

AI 订阅则是每一单都在亏,而且用户的使用习惯完全建立在这个亏损结构之上。

GitHub Copilot 上有人扒出来:以前一个 premium request 大概要烧 11 美金(60,000 token 的上下文 + 几次工具调用 + 多轮内部 turn)。原本订阅一个月给你 300 个 premium request,相当于价值 3300 美金的 token,定价 19 美金。

补贴比是 1 : 173。

这不是「Uber 式的市场培育」,这是把账藏起来不让你看见。

拓展阅读:我之前写过 《Claude Code 限额烧光的真相:不是模型抠,是你的 Harness 在漏 token》[1]——同一份工作流,把 cache、context、模型选择、输入格式四件事做对,账单可以从 750 砍到 100。但那是在补贴还在的前提下省钱。补贴一旦撤掉,你省下来的每一块也是真金白银。

三、为什么月费制对 LLM 服务从根本上不成立

健身房可以卖月卡,因为每个会员的边际成本相对固定——一台跑步机能跑多少人是有上限的,水电成本可预测。

Google Workspace 可以卖月卡,因为存文档的边际成本几乎是零。

LLM 服务没有任何一项符合这个条件——

-

• 一个用户可能只是偶尔问两句话; -

• 另一个用户可能往里面塞几百页 PDF、refactor 整个 codebase、自动化生成 PPT; -

• 同一个任务,用 Opus 跟用 Haiku 算力成本能差 30 倍; -

• “Reasoning model” 出来之后,模型自己决定要 think 多久,用户对算力的控制权完全消失。

这种情况下卖月卡,相当于健身房说「20 美金一个月任意使用」——但有的会员每天来跑两公里,有的会员每天来开私教游泳课配按摩师。前者赚翻,后者亏到亲妈不认。

而服务商手里只有几招很丑陋的工具来「治理」这种不平衡——

-

• 偷偷把 context window 砍小; -

• 偷偷把你的请求 route 到更便宜的小模型上; -

• 设置「每 5 小时多少次」这种你完全看不懂的限额; -

• 突然改 rate limit,让你的工作流莫名其妙卡死。

这些事 Anthropic、OpenAI、Cursor 全都干过。而且他们都不告诉你 token 烧到哪了——你只看到一个百分比进度条,不知道一个任务到底花了 0.3 美金还是 30 美金。

这是一种故意的不透明。Ed 用了一个我特别认同的判断:「这是一种欺骗性的、操纵性的、滥用性的商业模式,它存在的唯一目的,是让大多数人永远不接触到生成式 AI 的真实成本。」

四、开发者的 273 到 7560 美金/年

这一节我得停下来说点 Ed 没写但我亲身体感强烈的事。

Anthropic 自己的 Claude Code 文档,4 月初还写着——

「平均每个开发者每天 6 美金,90% 的用户每天低于 12 美金。」

这周,悄悄改成了——

「企业部署中,平均每个开发者每个活跃工作日 13 美金,每月 150-250 美金。90% 的用户每个活跃工作日低于 30 美金。」

按一个月 21 个工作日算——

|

|

|

|

|

|---|---|---|---|

|

|

|

|

3,276 美金 |

|

|

|

|

7,560 美金 |

一支 10 人开发团队按 30 美金/天的 90 分位算,一年是 75,600 美金。如果其中三个月飙到 50 美金/天,是 88,200。如果有一个月平均冲到 100 美金/天,到 102,900。如果稳定在 300 美金/天,是 75.6 万美金/年。

我自己开 Claude Code 的体感——

30 美金/天根本不够用。

这话不是我酸 Anthropic。Claude Opus 4.7 是 5 美金/百万 input token + 25 美金/百万 output token。一百万 token 大概是 5 万行代码。一个稍微复杂点的 refactor,agent 自己 plan、自己探索 codebase、自己写测试、跑红了再修——输入和输出各烧两三百万 token 是家常便饭。

我做过一次很认真的对比:同一个 feature,开着 Claude Code agent 模式,从开 issue 到 PR 跑通 CI,单个 session 烧 18 美金。这还只是早上一杯咖啡的工夫。

所以 Anthropic 文档里那句「90% 的用户每天低于 30 美金」——大概率成立的前提是你的工作里有相当一部分是 chat 模式而不是 agent 模式。但行业现在的方向是反过来的:所有人都在被推着用 agent 模式、长任务、自主探索 codebase。

Anthropic 自己就是把月费 20 美金的用户训练成 agent 重度用户的人。然后在文档里悄悄改一行字,把心理预期从 6 美金/天提到 13 美金/天。

接下来会发生的事,我赌是这样——

-

1. 6 个月内:Anthropic 跟进 GitHub Copilot,把 20 美金月费档改成「20 美金 token 余额」。 -

2. 企业 Teams 套餐:125 美金/座位的 Teams 会被默默改成 250 起步,rate limit 进一步收紧。 -

3. 18 个月内:所有 LLM 月费产品全面切换 token 计费。Cursor、Lovable、Perplexity 这一批都跟。 -

4. 真正的塌方:当 OpenAI 或 Anthropic 整建制把所有订阅用户切到 token 计费那一刻——Ed 用了一个特别精准的词,叫 pale horse——那才是这个泡沫的真正落幕信号。

五、数据中心:账面美得不像真的

Ed 这一节是全文最硬核的一段,我尽量把数字保留下来。

行业基础数字(来自 TD Cowen 分析师 Jerome Darling)——

-

• 一个数据中心每兆瓦造价约 1400 万美金; -

• 关键 IT(GPU + 配套硬件)每兆瓦另外约 3000 万美金; -

• 看到「100MW」就想成「44 亿美金」——其中大头给 NVIDIA。

号称到 2028 年底要建出 114GW 的 AI 数据中心——目前真正在建的只有 15.2GW。而「在建」的定义可以低到「有个坑挖在那儿」。

我们用一个理论模型走一遍:北达科他州 Ellendale,100MW 数据中心,假设它有 85MW 真正能计费的 critical IT 容量,所有 GPU 都是 NVIDIA Blackwell B200。

收入侧: 假设它满租、全年无休,每兆瓦每年 1250 万美金的 hyperscaler 计费 → 年收入 10.63 亿美金。

成本侧:

-

• 工业电价 6.31 美分/度 → 电费 5,540 万美金/年 -

• 维护、人力、电源更换等运营成本 ≈ 收入 12% → 1.28 亿美金 -

• Colocation 费(按 130 美金/千瓦/月)→ 1.33 亿美金 -

• IT 设备折旧(31.26 亿美金 / 6 年)→ 5.21 亿美金

总成本 8.37 亿美金 → 毛利 1.69 亿美金 → 毛利率 16.7%。

这个 16.7% 是理想中的理想——满租、零空窗、零事故、客户每月按时打款。

现实里——

-

• GPU 装机和客户上线要花 1-2 个月,这期间一天亏 327 万美金。这一个月直接吃掉 1.02 亿美金。重新算下来毛利率掉到 6.6%。 -

• 你没有现金全款付 GPU,是借的——80% LTV 的 6 年期资产抵押贷款,6% 利率 → 借了 28 亿美金。 -

• 第一年只付利息 1.68 亿美金 → 总成本干到 10.05 亿美金,毛利率 5.19%。 -

• 从第二年开始还本金 → 每月 5410 万美金、每年 6.49 亿美金 → 毛利率干到 -40%。

而这一切,都是「100% 满租 + 客户准时付款」的前提下算出来的。

AI 数据中心是一个只允许完美的生意。任何一点瑕疵——空窗一个月、客户欠款一次、利率上浮 2 个点——账就崩了。

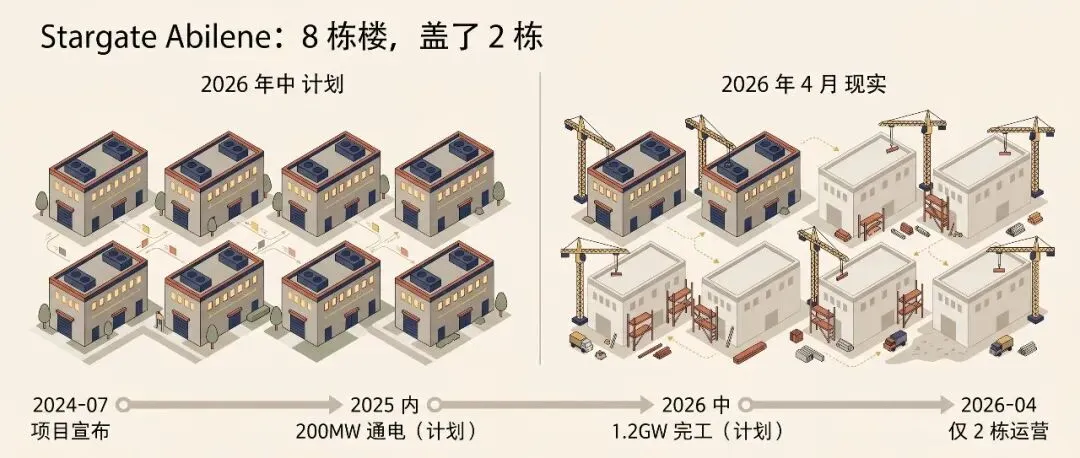

六、Stargate Abilene:八栋楼,盖了两栋

如果说理论模型告诉你账面有多脆,Stargate Abilene 就是现实告诉你当账面真的不完美时会怎样。

这是 Oracle 给 OpenAI 在德州 Abilene 盖的旗舰项目——8 栋楼、1.2GW 总功率、824MW critical IT、总投资 528 亿美金。

时间线:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

| 2026 年 4 月 27 日(现在) | 只有 2 栋楼运营、第三栋几乎没装 IT 设备 |

Oracle 在 4 月 22 日发推说「200MW 已经在运行,8 栋楼按计划交付」——但这 200MW 是总电力还是 critical IT 也没说清,无论怎么算,8 栋只盖出 2 栋的进度绝对谈不上「按计划」。

更要命的是商业逻辑——OpenAI 只能为已经存在的算力付费。第三栋楼至少还要一个月(甚至一个季度)才能开始产生收入。也就是说OpenAI 现在每天能付的钱,连 528 亿美金投资里 25% 都没回收。

而 Oracle 上个季度的自由现金流是 -247 亿美金。

七、OpenAI 必须在四年内凑出 8520 亿美金,否则带 Oracle 一起死

Ed 在文章里反复砸了一组数字,我把它单独立出来——

OpenAI 自己漏给媒体的内部预测:

-

• 2030 年前总营收:6730 亿美金 -

• 2030 年前总烧钱:8520 亿美金 -

• 也就是说,未来 4 年它需要靠营收 + 融资 + 借债总共凑出 8520 亿美金

这意味着什么?

「2 年内,OpenAI 项目的年营收要超过 TSMC。3 年内,接近 Meta。4 年内,等于今天微软全公司的年营收。

也就是说,它要在 4 年内增长 250%/年,相当于到 2030 年要变成一个完整的微软。」

OpenAI 的 CFO Sarah Friar 自己怎么说的?《华尔街日报》最近报道——

「Friar 已经多次告诉公司其他高管,她担心 OpenAI 可能付不起未来的算力合同,如果营收增长跟不上的话。」

「她还警告董事会,OpenAI 目前不具备公开上市所要求的财报严谨性——而 Sam Altman 主张更激进的 IPO 时间表。」

这话是 OpenAI 自己的 CFO 说的。不是 Ed Zitron 说的,不是我说的。

而 Oracle 这边——

-

• 当前年营收:约 640 亿美金 -

• 上季度自由现金流:-247 亿美金 -

• 已经为 Stargate 借了约 1150 亿美金的债 -

• 还需要至少 1500 亿美金才能完成 Stargate Abilene -

• Larry Ellison 个人质押了 3.46 亿股 Oracle 股票——约 615 亿美金——做个人贷款抵押

如果 OpenAI 凑不出那 8520 亿美金 → Stargate 付不起 → Oracle 营收预期崩 → Oracle 股价崩 → Larry Ellison 触发 margin call → 被迫抛售 Oracle 股票 → 进一步触发 margin call → 雪崩。

Larry Ellison 这辈子最值钱的家底,绑在 Sam Altman 能不能在 4 年内把 OpenAI 做到微软那么大这一件事上。

八、谁来买这 1.18 万亿的算力?

这是 Ed 在结尾扔的最尖锐的一个问题,我想再放大一次。

按目前公开的规划:

|

|

|

|---|---|

|

|

1568 亿美金/年

|

|

|

1.18 万亿美金/年

|

作为参考,CoreWeave——目前最大的 neocloud,客户包括 Meta、OpenAI、Google(替 OpenAI)、Microsoft(替 OpenAI)、Anthropic、NVIDIA——2025 年总营收 51 亿美金,预计 2026 年达到 120-130 亿美金。

51 亿 ↔ 1.18 万亿。

谁会买这 1.18 万亿?

仔细数一下——AI 算力的真实买家其实只有两类:

1. 巨头——它们买算力主要是想把 capex 从自己资产负债表上挪走(参见微软 / Google / Amazon 跟 CoreWeave 的合同); 2. 不赚钱的 AI 创业公司——靠 VC 和债务在烧钱。

所以这 1.18 万亿的算力买家,本质上全靠风险投资和私人信贷市场继续相信「生成式 AI 是史上最大的事」。这个信念一旦松动,整个链条断在哪一环都不奇怪。

九、我想说的几句

我作为一个每天 8 小时开着 Claude Code 写代码的人,对这篇文章的感受是非常分裂的——

一方面,我必须承认 Claude Code 这两年实质性提高了我的产出。某些 refactor 和探索性任务的速度,没有 agent 工具是根本不可能达到的。

另一方面——

-

1. 我现在用的体验,建立在每月 200 美金的 Max 订阅 + Anthropic 给我补贴 4-8 倍算力之上。 -

2. 一旦真按 token 收费,我的实际月成本会跳到 800-1500 美金——这个价格我不会付,绝大多数独立开发者也不会付。 -

3. 那么真实的均衡价格是多少?应该是 400-600 美金/月——但这个价位上,AI 编码工具就从「每个开发者人手一份」变成「中型团队的奢侈品」。 -

4. 用户基数会以数量级的速度收缩。

Ed 把这件事比作 Uber 时代的「主观价格幻觉」我觉得还不够狠。Uber 当年至少有一条朴素的护城河——司机被锁定在车贷里,用户被锁定在没车里。AI 没有这个。AI 工具的切换成本接近零,模型替代品越来越多,开源 + 本地推理的可能性也在快速接近实用线。

用户对补贴的依赖比 Uber 时代深得多,但用户对供应商的忠诚度比 Uber 时代浅得多。 这是一个非常糟糕的组合。

我个人的判断——

-

• 未来 12 个月内:所有 LLM 月费产品集体改按量计费(GitHub Copilot 是第一张多米诺)。 -

• 未来 18 个月内:第一波个人开发者大规模逃离,转向开源模型 + 自部署 + 本地小模型混合方案。 -

• 未来 24-36 个月内:要么 OpenAI / Anthropic 中至少一家发生重大资本事件(被收购、被切割、被注资稀释到不像自己),要么补贴重新被换一种皮回来——比如「巨头预付云额度」式的隐形补贴。

这不是看空 AI 这个技术,而是看空 AI 当前这个商业结构。两件事完全不是一回事,我希望我们这个行业能学会区分这两层。

十、后记

Ed 在原文的最后写了一段,我觉得比我能写的更像一个时代的注脚——

「一切都贵得离谱,又乏味得不行。它令人厌烦地无聊,毫无幽默感和俏皮感。每一个跟你讲’我用 AI 怎么怎么节省时间’的人,听上去都像是身处一段精神控制关系——带着一种隐隐的绝望感反复说服你『你也得加入』,因为他们自己其实并没有从中得到快乐。」

这段我读了三遍。

不是说 AI 没意义——它有,而且是真的有。但今天这个被资本、被预期、被押注、被 KPI 绑架到失真的「AI 行业」,它的账本现在终于要被翻开了。

GitHub Copilot 在 6 月 1 日要做的那件事,是这一切的开始。

来源

本文是基于 Ed Zitron 在 Where’s Your Ed At 发表的文章 《AI’s Economics Don’t Make Sense》[2] (2026-04-28) 的中文重写。原文核心论证、数据和引用全部来自 Ed 的报道,所有观点和数字归功于原作者。本文在结构和讲法上做了重新组织,并补充了我作为 Claude Code 重度用户的若干注脚,最后的预测部分为本人观点,与原作者无关。

如果你想看 Ed 的全部弹药库——包括他的 Subprime AI Crisis、Hater’s Guide To OpenAI、Hater’s Guide To The SaaSpocalypse——非常推荐订阅他的 premium newsletter。这是过去两年我看到的对 AI 行业最一以贯之的批判性写作。

引用链接

[1] 《Claude Code 限额烧光的真相:不是模型抠,是你的 Harness 在漏 token》: https://whatsdot.site/claude-code-limits-not-the-model[2] 《AI’s Economics Don’t Make Sense》: https://www.wheresyoured.at/ais-economics-dont-make-sense/

夜雨聆风

夜雨聆风