装了这个插件,我的 Claude 进化成了能记住一切的超级 AI

AI 工具深度解析🧠

你的 AI 每次都在”失忆”这个工具让它永远记住你

claude-mem 原理深度解析 · 附真实使用场景

你有没有这种绝望的经历——

昨天跟 Claude 聊了整整两个小时,把项目架构讲清楚了,踩的坑也都说明白了,它给出了一套让你眼前一亮的方案。

今天你打开新对话,输入第一句话:“我们继续昨天聊的那个项目……”

它回复你:

💬 “您好!我是 Claude,很高兴认识您。请问您需要什么帮助?😊”

完全不记得了。干干净净,一点不剩。

就好像你昨天用心跟一个天才合作了一整天,今天他换了个人,什么都不知道,还特别热情地跟你打招呼。

这不是 bug,这是 AI 大模型的先天局限:它没有跨会话记忆。每次对话都是一张白纸,上下文窗口关了,一切归零。

而今天要介绍的这个工具,就是专门来解决这个问题的——

claude-mem:给 Claude Code 装上一个「永不失忆」的海马体

先搞清楚:AI 为什么会失忆?

要理解 claude-mem 的价值,我们得先弄明白 AI “失忆”的根本原因。

大语言模型(LLM)本质上是一个无状态的函数:你给它输入,它给你输出,然后它就忘了。这不是偷懒,是架构使然。

每次对话有个”上下文窗口”,就像一张有限大小的白板,所有信息都写在上面。对话结束,白板擦干净。下次对话,新白板,重新写。

🔬 技术小科普:上下文窗口(Context Window)是 LLM 一次能”看到”的最大文本长度,以 Token 计算。GPT-4 约 128K tokens,Claude 最高 200K tokens。但无论多大,会话一旦结束,窗口内容就消失了。模型本身不存储对话历史。

这对普通用户来说还好,聊聊天、写写文章,每次重说一遍也无所谓。

但对开发者来说,这是灾难级的体验——

你的项目有几十个模块,有历史遗留问题,有约定好的代码规范,有你踩过的那些坑……每次都要重新解释?那跟直接写代码有什么区别?

claude-mem 的核心思路

给 Claude Code 装上一个”外挂记忆系统”,一句话概括:

把 Claude 做过的每一件事,自动总结成结构化的记忆碎片,存下来;下次会话开始时,精准地注入回去。

注意,不是把整个对话记录塞回去——那太浪费 token 了,而且信噪比极低。

而是经过 AI 提炼的语义摘要:哪些决策做了、哪些 bug 修了、哪些文件改了、哪些坑踩过……只留有价值的信息,压缩后存档。

技术实现:它是怎么做到的?

说说具体的技术架构,这部分稍微硬核,但不难理解——

① 生命周期钩子(Hooks)

claude-mem 注册了 5 个生命周期钩子,监听 Claude Code 的关键时刻:会话开始、用户提交 Prompt、工具调用完成、会话结束……这些钩子就像埋在 Claude 工作流里的”神经元”,全程感知它在干什么。

📌 举个例子

Claude 刚刚修改了 worker-service.ts 文件

PostToolUse 钩子立刻触发 → AI 生成摘要:”修改了 worker-service.ts,新增了 HTTP 端点 /api/search,原因是需要支持向量检索功能” → 写入数据库存档。

② Worker 服务(后台常驻进程)

这是一个跑在 localhost:37777 的后台 HTTP 服务,由 Bun 运行时管理。你甚至可以打开浏览器,实时看到 Claude 正在形成的记忆流——像看一个人脑子里在想什么一样,有点赛博感。

③ SQLite + 向量数据库双引擎检索

记忆存在本地的 SQLite 数据库里(带 FTS5 全文索引),同时接入 Chroma 向量数据库,支持语义搜索。

💡 关键区别:普通关键词搜索是「字符串匹配」,而向量搜索是「语义匹配」。你问”我们之前怎么解决那个 Oracle 字符问题的”,即使你描述和当时不完全一样,它依然能找到相关记忆。

真实场景:它能改变什么?

🧩 场景一 · 长期项目开发

三个月的项目,Claude 记住了每一个决策

你在做一个 Spring Boot 项目,用了 MyBatis-Plus,数据库是 Oracle。三个月前你们定下”所有 SQL 末尾不加分号”的规矩(因为踩过 ORA-00911 报错)。昨天 Claude 帮你写了个新的 INSERT 语句……有了 claude-mem,它不会再在末尾加分号了。因为它记住了。

🐛 场景二 · 跨会话 Debug

“我们上次修过这个 bug 吗?”

你遇到了一个似曾相识的报错,直觉告诉你三周前好像处理过类似的问题。直接问它:”我们之前修过这类 NPE 吗,怎么修的?”mem-search 技能自动触发,从历史记忆里找到当时的修复方案,连当时踩的坑都告诉你。

👋 场景三 · 新成员入职

让 AI 给新人讲项目历史

新来的同事需要了解项目背景。你让 Claude 总结一下过去两个月的项目演进、关键决策和已知的技术债……它可以从记忆库里梳理出一份完整的项目时间线。

一个有意思的设计哲学

claude-mem 有个很聪明的设计叫「渐进式披露」(Progressive Disclosure)。

它不是一股脑把所有历史记忆都塞进上下文——那样 token 会爆炸,而且大量无关信息反而会干扰 AI 的判断。

而是按照相关性分层加载:最近最相关的摘要优先展示,更深的历史按需检索。

🎯 这个设计揭示了一个 AI 工程的核心命题:给 AI 的上下文不是越多越好,而是越精准越好。噪声比空白更危险。

怎么用?两行命令搞定

如果你正在用 Claude Code,安装极其简单:

> /plugin marketplace add thedotmack/claude-mem> /plugin install claude-mem

重启 Claude Code,之后所有的操作记忆都会自动开始积累。不需要任何配置,不需要手动触发,它就在后台默默工作。

Node.js 18+Claude Code本地 SQLite 存储开源 AGPL-3.0自动安装依赖

说实话:它不是万能的

说了这么多好话,也得说实话——

claude-mem 解决的是”跨会话上下文丢失”的问题,但它不能替代清晰的 Prompt 和良好的项目文档。记忆的质量取决于 Claude 操作的质量——如果它做了一堆无意义的操作,记下来也是噪声。

另外,向量搜索需要额外安装 uv(Python 包管理器)和 Chroma,初次配置对新手有一定门槛。

但话说回来,对于认真在用 Claude Code 做长期项目的开发者,这个工具几乎是必装级别的。

你花时间教会 AI 的每一件事都不应该白费。claude-mem 就是为此而生的。

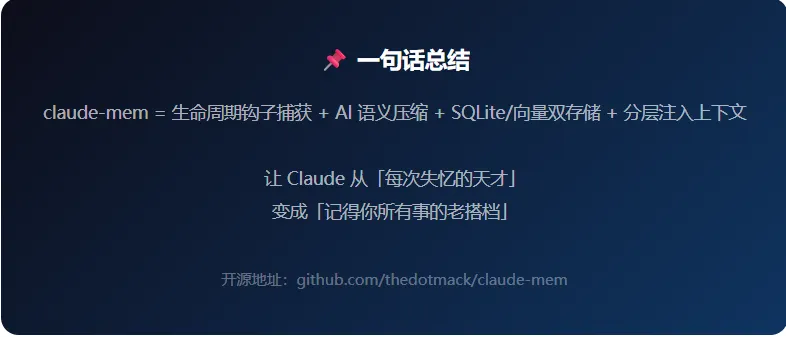

📌 一句话总结

开源地址:github.com/thedotmack/claude-mem

— 如果觉得有用,转发给你的开发者朋友 —

公众号战略合作作者:AI研究院-李博士

夜雨聆风

夜雨聆风