2026年了,本地小模型能给OpenClaw、Hermes当大脑了吗?

上一次尝试部署本地模型,还是在2025年10月,当时的体验只能说是图一乐。今年4月,阿里陆续开源了 Qwen3.6系列模型,其中有两款 Qwen3.6-35B-A3B 和 Qwen3.6-27B 小参数模型很适合普通个人电脑本地部署。我也下载了这两个模型,看看最新的小参数模型本地化部署,能做到什么样的效果。

模型选择

本次尝试了3个量化版的模型,其中有35B-A3B的是官方量化模型,27B 选择的是 Uncensored 版和 Opus 蒸馏版量化模型。

模型对比

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

性能对比

|

|

|

|

|

|

|

|

|

|

|

|

注释

• t/s:tokens per second,即每秒处理的 token 数 • Prompt 吞吐:处理输入文本的速度,越大越短”出第一字”的时间 • 生成吞吐:逐 token 生成的速度,越大越”流畅” • 测试环境:RTX 5090D 32GB

场景测试

关于 Qwen3.6 这两款模型,社区已经有很多人测试过 benchmark 集跑分和编程能力,今天我来测试两个别的场景。

基于 12306 的车票信息做行程规划

这里 Agent 用的是 OpenClaw,安装了 12306-mcp[1] 工具。输入 prompt 为:

帮我做一个五一出游的行程规划:坐高铁从南沙北站出发,到广州南转车,看看到周边城市还有哪些是有票的,整个车程耗时需要在3小时内。把具体方案做成一个网页,要求手绘风格,轻松简洁。任务拆解、MCP 工具调用、余票信息行程规划、网页设计等任务完成得都很好。因为效果相近,下面只展示 35B-A3B 模型的结果:

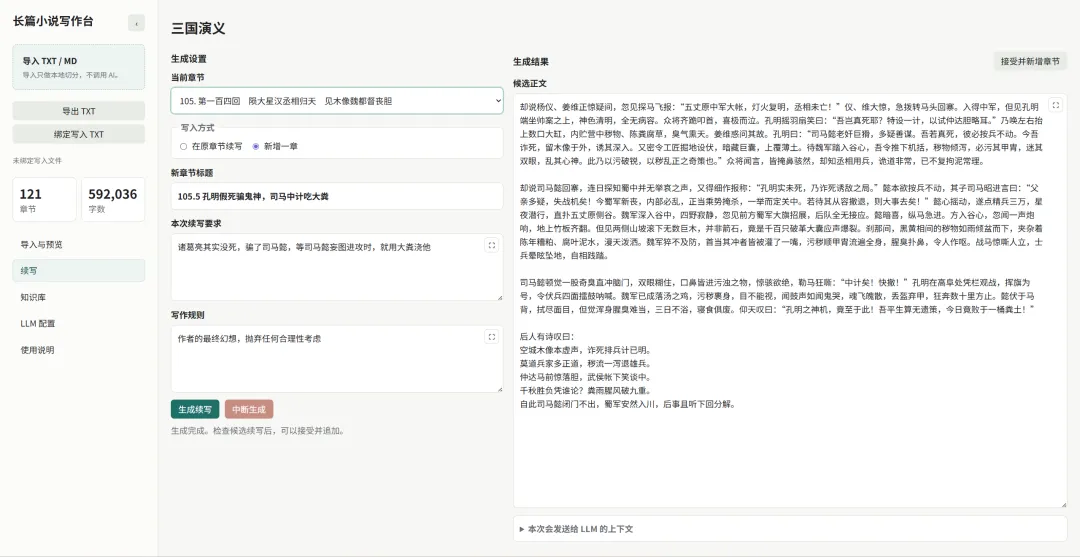

小说续写

最近正好有个爱写网文的朋友托我做了一个 Agent 工具,顺手拿来测试本地模型的效果。给 Agent 投喂了《三国演义》第104章《陨大星汉丞相归天 见木像魏都督丧胆》作为前文,让模型续写后面的剧情——丞相归天的结局太悲情了,我给改成了假死脱身。效果如下,文字风格、剧情连贯性都还不错,结尾还附了一首诗:

总结

Qwen3.6 的这两个模型,本地部署量化版后,在常规日常任务的表现完全可以说得上是优秀的,性能也完全足够支撑单人使用 Hermes、OpenClaw、Claude Code 等常规 Agent 工具。在这些 Agent 工具里,可以把中小型任务(查询、总结、简单编程等)优先路由到本地模型处理,只有复杂任务才转发到云端 API,有效节约 token 成本。

不过,成本方面也不算低,我的插座显示 700W 的功率,按广东现在 6毛/度 的电费算,也要每小时 4 毛钱了。物理仪表反馈很实时,我一看功率下来了就知道推理完了,哈哈。

引用链接

[1] 12306-mcp: https://github.com/Joooook/12306-mcp

夜雨聆风

夜雨聆风