openclaw & hermes 创始人盛赞的 Minimax,到底表现如何?

旗舰模型一个月更新一次,选择有很多:Minimax2.7、DeepSeek V4 ,GLM-5.1 ,Kimi K2.6 ,Claude Opus 4.7、codex 5.5,

很多朋友反馈不知道怎么选。

我主力用的 Claude,但还是会遇到 token 不够的情况。

这时候就需要找一些平替,我看到 Minimax 在海外的评价很高。

Hermes 创始人说,它是性价比最棒的模型。

OpenClaw 创始人 Peter 早在今年 1 月他就在 X 上和播客里说 Minimax 是”当下最好的开源模型”,编程任务上能用 5% 的成本接近 CodeX 的效果。

我就抱着好奇的心态,来测一测 Minimax 最新的 M2.7 到底如何?

这一个月,几百次 Skill 调用,几十个项目,多项横向对比,

我可以先下结论:Minimax M2.7是模型让我花的钱最少、活干得最稳的国产模型。

M2.7 的位置很微妙。

Opus 4.7 不用质疑,是天花板,但价格大概是 M2.7 的 15 倍,复杂架构、跨文件重构这种活它最稳。

DeepSeek V4 Pro 价格是 M2.7 的 3 倍左右,强推理、深度调试是它的强项。

GLM-5.1 这一版主打长程任务稳定性,但价格比 M2.7 贵个 20% 左右。

M2.7 自己就站在最便宜的旗舰档位上。

再往下还有一堆 0.5 倍价格的小模型,但只能干玩具项目。

我每天的工作有很多细碎的活,比如:

-

每日定时给我搜索网络上的播客、RSS 信息给我转成日报 -

把一份 PDF 转成 PPT -

给文章配几张HTML 的逻辑图 -

复刻一个网页原型 -

画几个流程图

这些活的共同点是:Token 消耗多、任务定义清晰、链路不长、对工具调用稳定性要求高。

这恰好是 M2.7 的舒适区,它的真实表现如何?

可以看看下面这几个我这周真实跑过的case。

我把 M2.7 接入到了我的 openclaw,就可以在飞书里面主动收到 openclaw 发给我的消息。

我做了几个定时执行的任务,每天有几次他会给我发我关注的博主的信息,我关注的 YouTube 的视频转成音频,我关注的一些话题,给我推送一些选题方案。

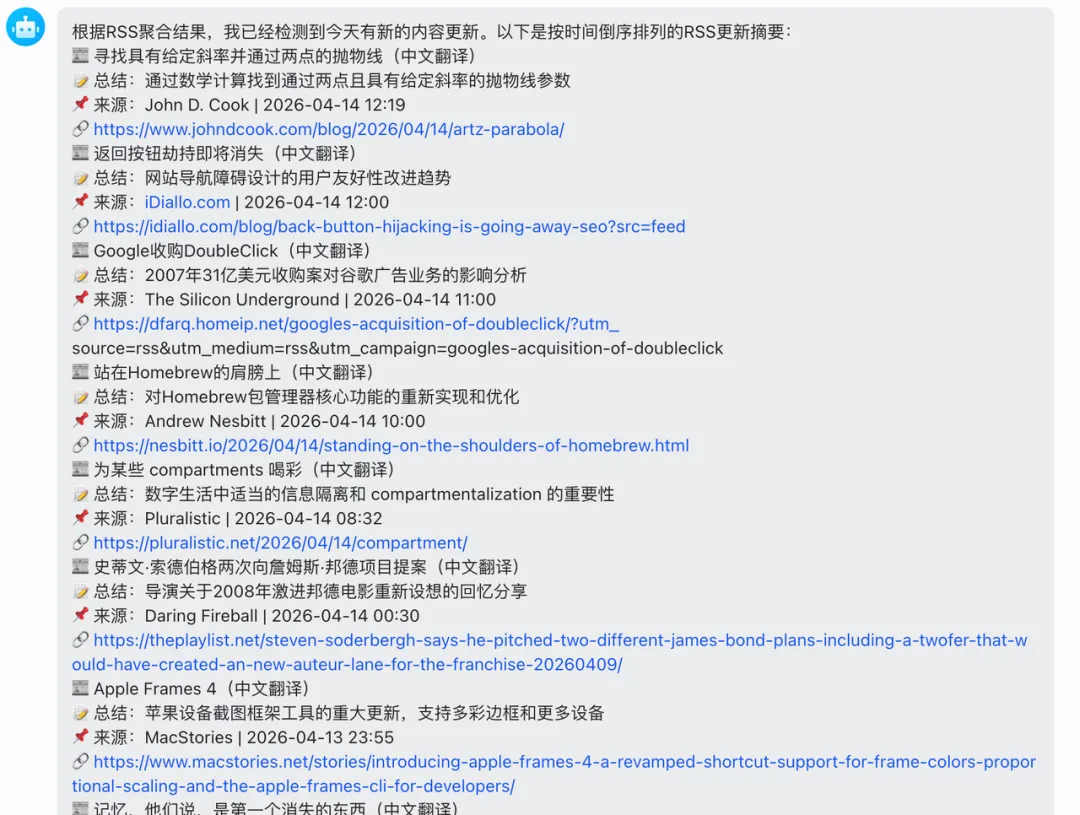

1 每天早上 RSS 总结

我用的是rss-aggregator(github.com/zephyrwang6/info-skill)这个 Skill,把订阅的博客和资讯源博主地址喂给它,定时每天跑三次,按主题归类,提炼出当天值得看的几条,自动推到飞书。

2 播客自动处理

我关注的 100 多个 YouTube 频道只要有更新,M2.7 就会给我挑选一个精品总结成文字发给我。

它先用youtube-feed扫最近 48 小时的新视频,再用youtube-transcript-cn把字幕拉下来翻成中文,最后走podcast-workflow跑一遍摘要、金句提取,全部塞进飞书知识库。整个流程一条龙,我醒来直接看精华版,不用花 1 小时听原声。

Skill 地址:github.com/zephyrwang6/info-skill

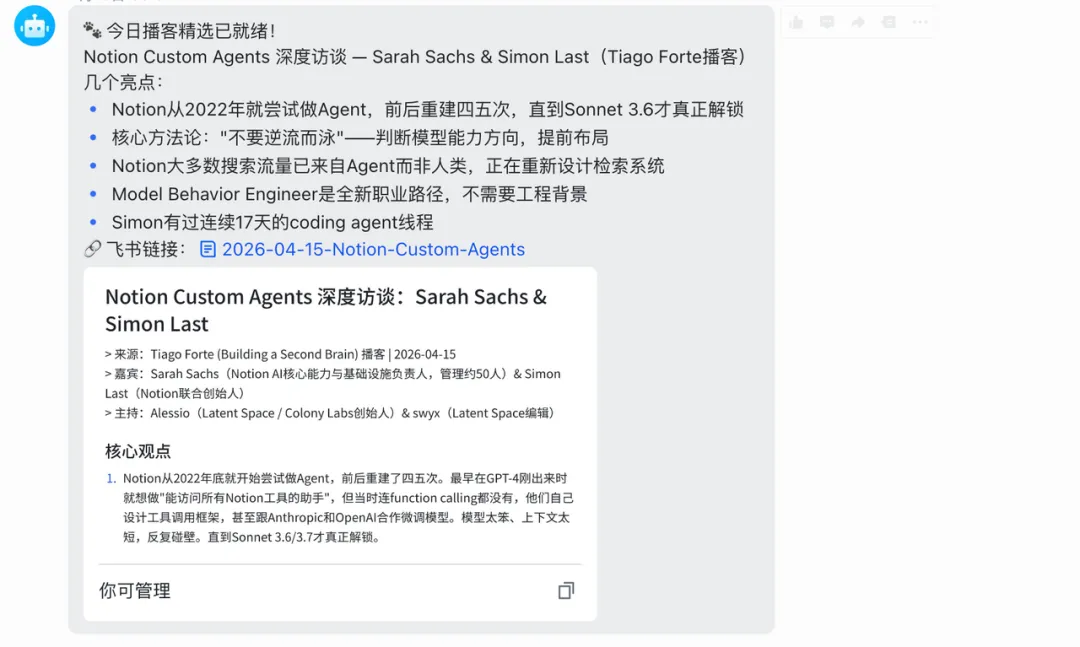

3 选题素材采集。

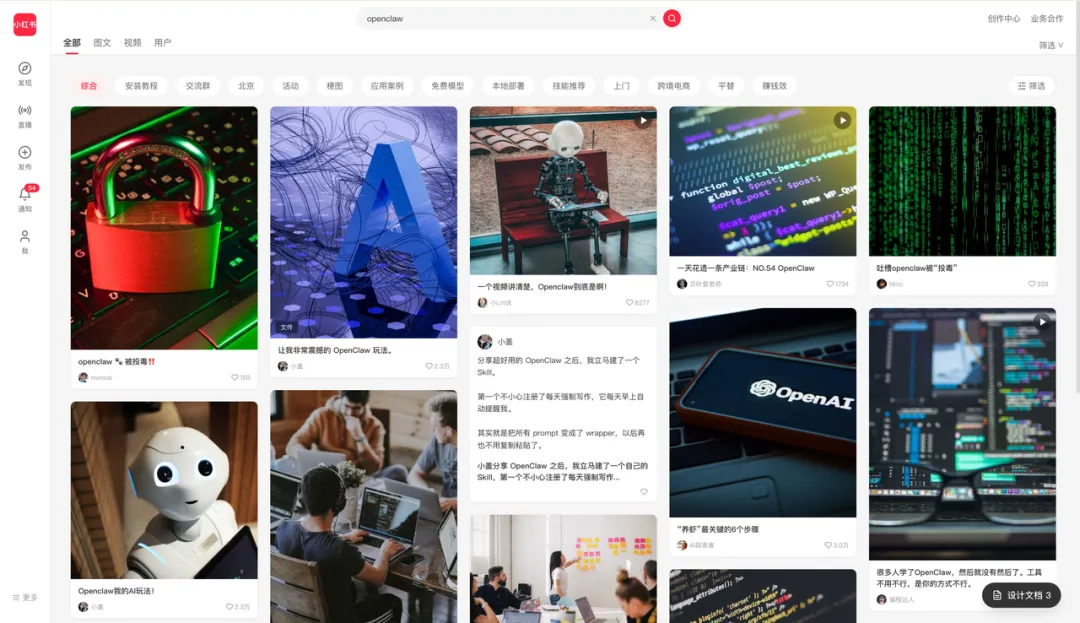

每天扫一遍 X、即刻、小红书的关键词,把跟我领域相关的爆款内容抓回来归档,顺手生成选题候选。

我早上醒来,去扫一眼,有哪些值得研究的就深入去看。

Skill 地址:github.com/zephyrwang6/info-skill

这些任务以前都是”想做但懒得做”,现在 Agent 在那儿默默跑,每天早上打开飞书就有一沓干货等着我。

Minimax 可以精准的调用工具搜索海内外信息,给到我总结分析。

任务很简单,把一份图片型扫描财报 PDF,转成可编辑的 PPTX。

我同时丢给了 DeepSeek V4 Pro 和 M2.7,两个都用到的 Minimax 官方 Office Skills(github.com/MiniMax-AI/skills)

DS V4 Pro 的做法挺”聪明”的。它发现是图片型 PDF,没办法直接读文字,于是选了最省事的路径,把每页 PDF 截图,作为一张图片塞进 PPT。出来的 .pptx 能打开,看起来也像那么回事。

但点进去一看,每页就是一张图。不能改字、不能调样式、不能复用模板。

M2.7 先识别出这是图片型 PDF,主动调 OCR 把文字扣出来。然后分析了每页的版式,把内容按结构化方式重建成原生 PPT 形状。

成品和我们手搓的 PPT 几乎无差,字能改、表能编辑、模板能套。

这个差距有意思的地方在于任务理解。

DS V4 Pro 截图贴 PPT 这个方案技术上完全跑通。但它没理解我要的不是”一份长得像 PPT 的文件”,是”一份能编辑的 PPT”。

M2.7 在动手前先想了一下,这个用户拿到 PPT 之后要干嘛?

这种”想清楚再动手”的特质,在我后面几个 case 里反复出现。

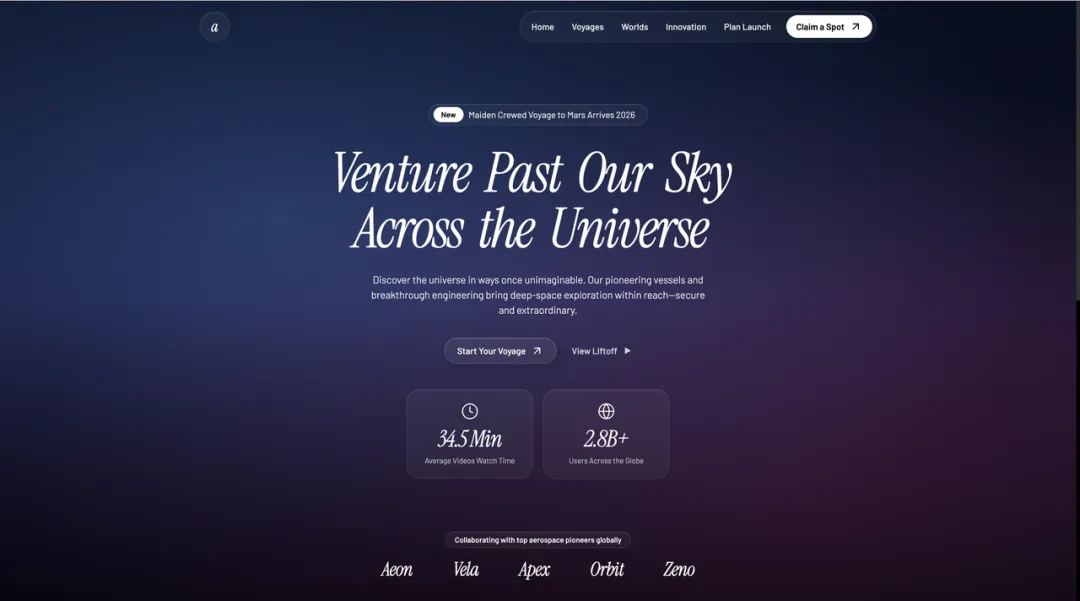

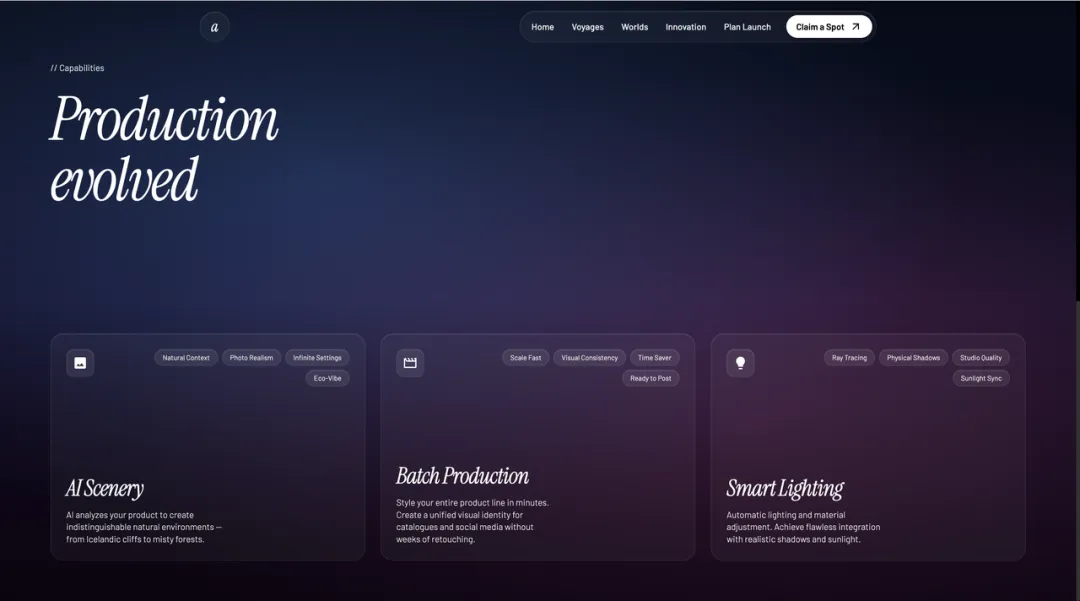

这是我敢用 Minimax M2.7 开发产品的最大原因,它设计的页面真的还挺不错的,可以看看下面这个效果:

整个页面的字体是精心设计过的,页面也有动效。

如果你想让模型产出的前端效果更好看,可以使用这个网站(motionsites.ai)提供的各种美观的前端样式,给到 Agent 参考执行。

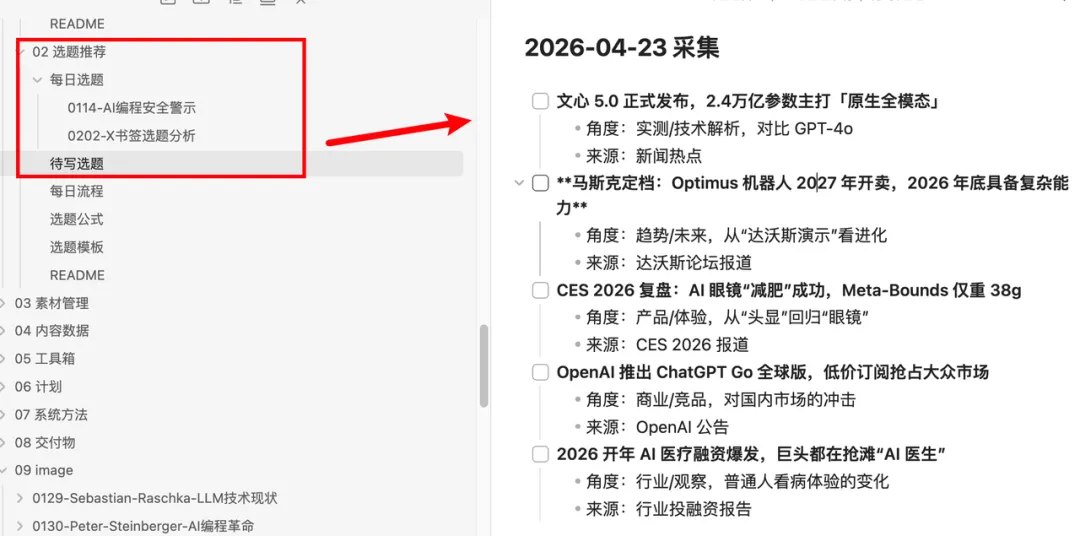

这是我最看重的一项,我的工作有太多原型画。

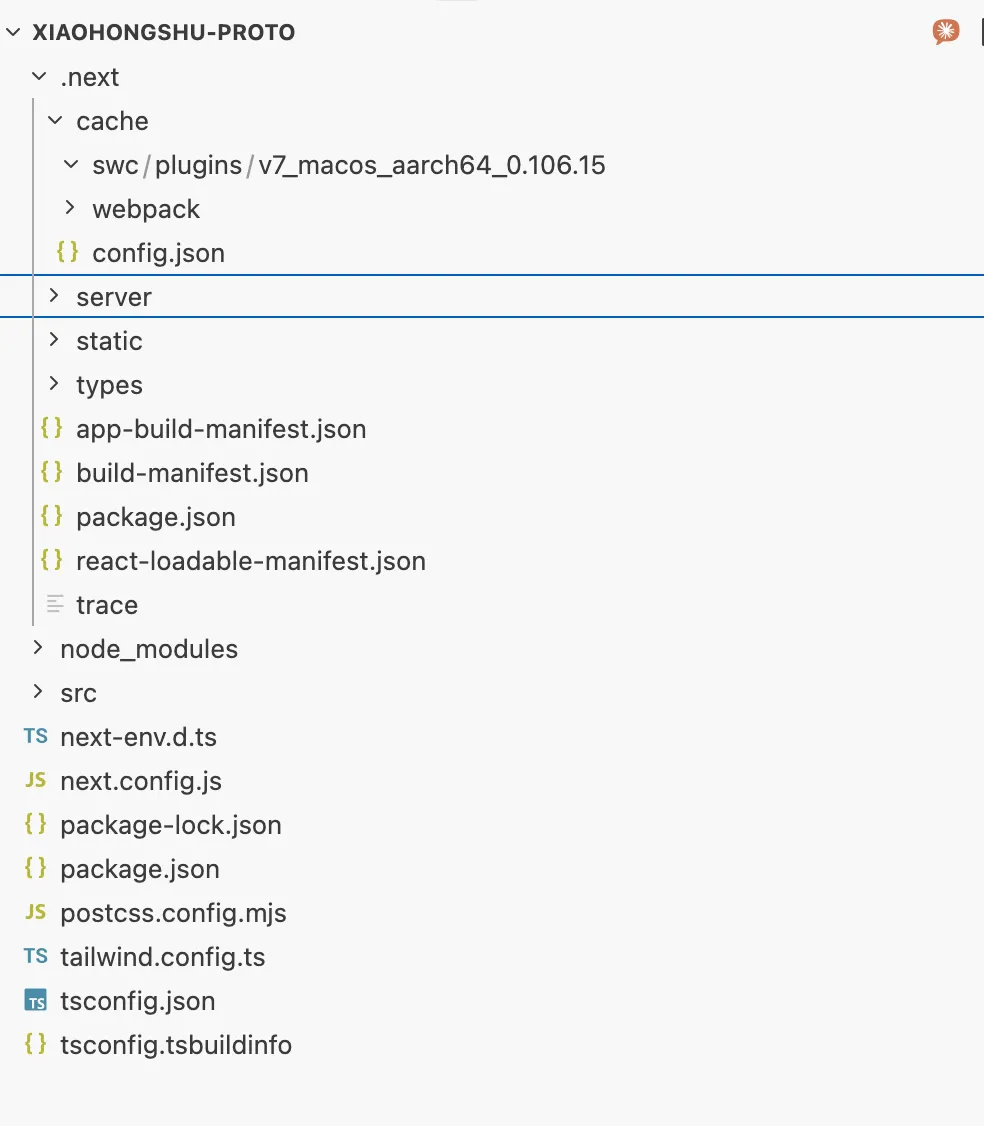

我之前写过一个 Skill 叫pm-image2proto(github.com/zephyrwang6/pm-skills)截一张参考网页的图丢进去,它分析布局、初始化 Next.js 项目、配 Tailwind、逐组件复刻、调样式、本地部署,全自动。

这种任务的特点是半小时起步、几十轮工具调用、上下文压力极大。

下面是 M2.7 复刻的本地化工程文件,几十个代码文件,很全面。

中间遇到了几次样式对不上的情况,它自己对比了原页面和本地渲染的差异,调整了布局参数。有一个组件的响应式断点没处理好,它也自己排查修掉了,全程没问我。

大概跑了半个多小时,任务完成。本地项目部署好了,浏览器打开直接能看到效果。出来的东西超出预期。项目结构清晰,组件拆分合理。

还附带了一份设计文档,记录了页面的布局逻辑、组件层级、交互说明。拿来做产品原型完全够用,甚至可以直接在这个基础上继续开发。

全程没中断。

接近一个小时的长程任务,几十轮工具调用,从访问网页到写代码到调试部署,一口气跑完了。这在之前用国产模型的时候是不敢想的。以前同样的 Skill,跑到一半基本就得手动接力。

我之前做的这些 Skill,不再只能绑死在海外模型上了。

顺便说一下 url2proto 这个 Skill 的另一个用法:vibe coding 。

不一定非要复刻现有页面,也可以把一个参考页面的链接丢进去,告诉它”参考这个风格,帮我搭一个 XXX 产品的框架”,它会在复刻的基础上按需求改造,快速出一个可运行的工程文件。

这个案例让我有信心用 M2.7 来实现 vibecoding,做全栈开发。

M2.7 的Token Plan 的价格和海外模型比起来便宜挺多的。

在价格方面,M2.7 只有 GLM-5.1 的 80%,稳定性同等,是更划算的选择。

MiniMax 的 Token Plan 还支持图片、音频、视频生成的额度也算进去,且不占编程额度。

我前几天用一个 Agent 全自动做了条产品介绍视频:写文案、合成语音、配图、配乐。

以前这是一整条工作流,现在一个 OpenClaw 会话跑通。

现在理解了为什么 openclaw 和 Hermes 创始人说 Minimax 是最好用的开源模型。

如果你跟我一样,每天靠 Agent 跑大量真实任务、对每一块钱的产出敏感、不想再为某个模型的”小聪明”买单,M2.7 值得排到主力候选第一位。

它便宜,但不糊弄。它不是顶配,但够用、稳定、听话。

夜雨聆风

夜雨聆风