AI 工程师盛会来袭!Grok 4.3、DeepSeek V4 Pro 与智能体基建大爆发

AI 工程师世界博览会开启第二轮征集,详细介绍了自主研究、记忆、世界模型等新主题。同时,本期内容全面回顾了 2026 年 4 月末至 5 月初的 AI 生态热点,包括 Grok 4.3 的发布、DeepSeek V4 Pro 的崛起、OpenAI Codex 的产品扩张,以及关于智能体基础设施和本地 LLM 生态的重要进展。

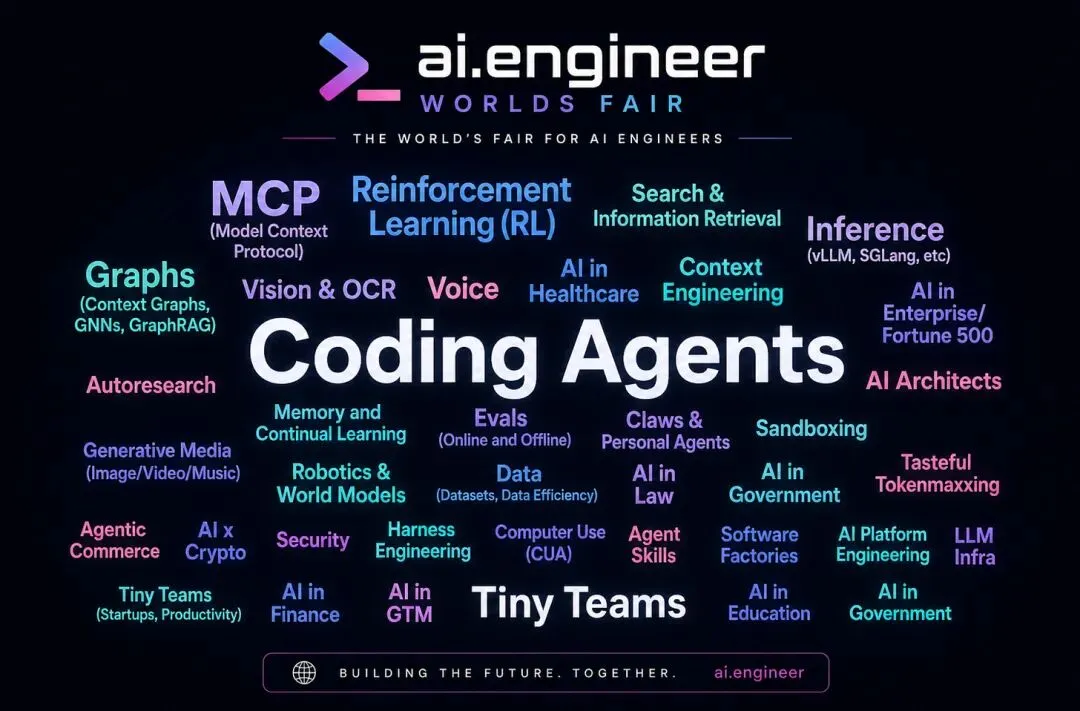

🚀 AI 工程师世界博览会:扩展新主题,征集演讲者

本期 Latent Space 的 AINews 带来了激动人心的消息:AI 工程师世界博览会(AI Engineer World’s Fair) 正式开启第二轮演讲者征集!

今年夏天,博览会将重返旧金山的 Moscone West 展馆。随着 AI 工程领域的快速演进,博览会新增了多个核心主题,旨在展示本年度最具影响力的研究与产品工程成果。

🌟 新增重点议题:

- 自主研究(Autoresearch)

:探索在实验框架和模型训练中的递归自我改进循环。 - 记忆(Memory)

:研究智能体和模型如何随着用户的使用而不断进化。 - 世界模型(World Models)

:如何解决空间智能和对抗性推理问题。 - Token 最大化(Tokenmaxxing)

:作为团队负责人,如何让 AI 工程团队实现 10 倍的 AI 原生化,同时避免无效的资源浪费? - 智能体商务(Agentic Commerce)

:智能体如何为数据、API 甚至其他智能体支付费用? - 垂直领域 AI

:在法律、医疗、GTM(进入市场策略)和金融等特定领域的深度应用。

此外,今年还将设立机器人演示区(甚至欢迎人形机器人参加,但需有人陪同)和创业战场(Startup Battlefield),为 Pre-A 轮的初创公司提供向顶级 VC 展示的机会。

🐦 AI Twitter 热点回顾

1. Grok 4.3 发布:性价比跃升与可靠性争议

xAI 正式推出了 Grok 4.3,其核心卖点在于显著提升的性价比,但社区反馈却褒贬不一。

- 性能表现

:根据 Artificial Analysis 的测试,Grok 4.3 在智能体任务(GDPval-AA)上表现强劲,但在非幻觉指标上却下降了 8 个百分点。这引发了人们对其在实际应用中可靠性的担忧。 - 价格优势

:输入价格降低了约 40%,输出价格降低了约 60%,显示出极强的竞争性。 - 开源 vs 闭源

:社区对此反应两极分化。有人认为其迭代速度惊人,也有人指出它在某些基准测试上甚至落后于顶尖的中国开源模型。

2. DeepSeek V4 Pro:开源权重编码模型的新标杆

DeepSeek V4 Pro 正在成为编码和智能体任务领域最受瞩目的开源权重模型。

- 实测体验

:开发者报告称,DeepSeek V4 Pro 是首个在多轮编码任务中真正能与 OpenAI Codex 或 Claude Code 媲美的开源模型。 - 架构优势

:支持 100 万上下文,采用混合 CSA/HCA 注意力设计,KV 缓存减少至 10%,在长上下文下的推理开销大幅降低。 - 视觉增强

:DeepSeek 的多模态方向专注于显式空间接地(Explicit Spatial Grounding)。其技术报告提到了一种多模态 CoT 系统,可以在推理过程中直接嵌入坐标点和框,从而解决计数、迷宫和路径追踪等难题。

3. Codex 的产品狂飙 vs 智能体运行时之争

OpenAI 的 Codex 展现出了惊人的产品进化速度,而不仅仅是模型能力的提升。

- 极致体验

:Codex 新增了设备工具栏、CI 状态集成以及极具趣味性的“宠物系统”。OpenAI 正在构建一个完整的协作环境,而非简单的 API 端点。 - 运行时竞争

:竞争的焦点正从“模型智商”转向“智能体运行框架(Harness Design)”。无论是 Devin 的 Shell 集成,还是 Hermes 的 /goal循环,亦或是 Cloudflare 的持久化执行,都在强调记忆系统、任务持久化和人机协作原语的重要性。

4. 前沿研究:递归多智能体与自我改进

- ReaLM-Retrieve

:研究表明,推理模型需要在推理过程中进行检索,而非仅在开始前。这种方式将 F1 值提升了 10.1%。 - 递归多智能体系统

:智能体之间不再通过纯文本对话,而是通过**共享潜空间(Shared Latent Space)**进行递归计算通信,显著提升了速度并减少了 75% 的 Token 消耗。 - Meta FAIR 的新思路

:提出“自我改进预训练”,通过强模型重写训练数据并评判生成质量,显著提升了模型的事实性和安全性。

🤖 AI Reddit 社区洞察

1. Qwen(通义千问)模型的进阶与基准测试

- PFlash 技术

:一种针对长上下文的推测性预填充技术,在 RTX 3090 上实现了相比 llama.cpp 10 倍的预填充加速。虽然存在“有损压缩”的争议,但为本地大模型运行提供了新思路。 - Qwen 3.6 vs Gemma 4

:在本地 LLM 开发 Pac-Man 游戏的竞赛中,Gemma 4 在逻辑一致性和简洁性上略胜一筹,而 Qwen 则在视觉样式和创意上更具特色。 - Qwen-Scope 发布

:Qwen 团队发布了针对 2B 到 35B MoE 模型的稀疏自动编码器(SAEs)。这是一个强大的可解释性工具,允许开发者精确操纵模型的内部特征(如强制输出法律术语或 Python 代码)。

2. 本地模型的创意应用

有用户分享了使用 Qwen 3.6 27B 模型生成 SVG 矢量图的案例,成功创作出了“骑自行车的鹈鹕”和“读报纸的维多利亚时代机器人”等创意图像。这展示了本地模型在处理复杂指令和跨模态任务上的巨大潜力。

💡 笔者锐评

本周的 AINews 再次向我们展示了 AI 领域的“中国力量”——DeepSeek V4 Pro 和 Qwen 3.5/3.6 的强势表现,让开源社区看到了追赶闭源顶尖模型的希望。

值得反思的是,当硅谷已经在讨论“智能体商务”和“显式空间推理”时,国内的开发者生态是否过于关注单一的“刷榜”?AI 工程师世界博览会提出的“Tokenmaxxing”和“垂直领域 AI”其实给了我们很好的启示:AI 的未来不在于做出一个全能的神,而在于如何将 AI 能力深度嵌入到具体的工程实践和商业流程中。

特别是智能体运行时的崛起,提醒我们:模型只是发动机,而决定用户体验和业务上限的,往往是那套复杂的“变速箱”和“底盘系统”——即智能体框架、记忆系统和持久化执行能力。

求点赞 👍 求关注 ❤️ 求收藏 ⭐️你的支持是我更新的最大动力!

夜雨聆风

夜雨聆风