五角大楼签了7家AI公司,唯独少了一个名字:这件事跟你选什么模型有关

你可能昨天刷到了这条消息,但没当回事。

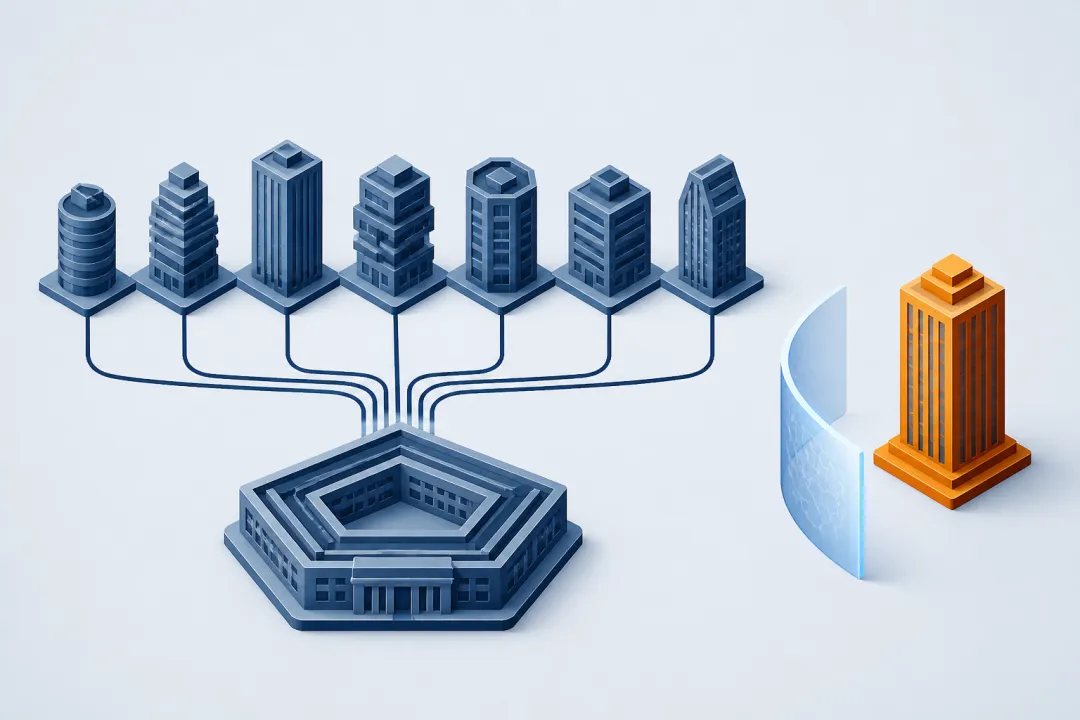

5月1号,美国国防部官宣:OpenAI、Google、英伟达、微软、亚马逊AWS、SpaceX,加上一个叫Reflection AI的新公司——7家AI巨头集体签约,同意把自家技术开放给美国军方使用。

但名单里少了一个你可能天天在用的名字:Anthropic。就是做Claude的那家。

他们拒绝了。

这事看着像国际新闻、军事新闻,跟咱们普通人没关系?不对。你每天用的AI模型背后,站着的是什么样的公司、信奉什么样的价值观——这个事情正在变得越来越重要。

———

先说清楚发生了什么

美国国防部搞了个叫”AI优先战略”的东西,说白了就是——军方要全面拥抱AI了,从情报分析到后勤调度到战场决策,全都要用上。

但军方自己没技术,得找民间公司合作。于是他们挨个敲门:

·OpenAI 签了。

·Google 签了。

·英伟达 签了。

·微软 签了。

·亚马逊AWS 签了。

·SpaceX 签了。

·Reflection AI 签了。

这7家公司同意一个核心条款:“技术可用于任何合法用途。”

注意这个措辞——”任何合法用途“。没有限定是民用还是军用、是防御还是进攻。

而Anthropic呢?他们的回应很直接:

> “我们在AI应用的安全性和潜在滥用问题上,与国防部存在根本性分歧。”

翻译成人话就是:这个活儿我们不接。

———

Anthropic为什么说不?

这就要说到Anthropic这家公司的”基因”了。

Anthropic的创始人Dario Amodei和Daniela Amodei,就是从OpenAI出来的。当年他们离开OpenAI的原因之一,就是觉得OpenAI在安全问题上不够重视、商业化太激进。

所以Anthropic从第一天起就把”负责任的AI”写在了公司章程里。他们给Claude内置了一套行为准则系统——简单说就是:AI自己有一本”什么该做什么不该做”的手册,遇到可能有害的指令,它会拒绝执行。不是技术做不到,是主动选择不做。

现在你再回头看这件事:

一边是”技术可用于任何合法用途”。

一边是”我们认为某些用途即使合法,也不应该被AI支持”。

两种态度,其实代表了AI行业最核心的路线之争。

———

跟你选模型有什么关系?

你可能觉得:我一个普通人,用GPT写写文案、用Claude改改代码,关心什么军事合作?

其实关系很直接。

第一,模型的价值观会渗透到产品里。

你有没有发现Claude在某些话题上特别”固执”?比如你让它写一些擦边的营销文案,它经常拒绝;你让GPT写同样的东西,它大概率给你写出来了。

这不是Bug,这是设计。

Anthropic选择让Claude更保守、更有底线,代价是某些场景下它”不好使”。而OpenAI选择了更开放的策略,代价是——你很难知道边界在哪。

第二,公司的合作方决定了你数据的信任成本。 一家跟军方深度合作的AI公司,你愿意把你的商业机密、客户数据交给它处理吗?这就是为什么越来越多的欧洲企业和隐私敏感用户开始转向Claude。

第三,行业站队正在加速,你迟早要选。

2026年的AI不再是”哪个模型跑分高就用哪个”了。现在的格局是这样的:

|

模型 |

优势 |

你需要知道的 |

|

—— |

—— |

—— |

|

GPT-5.5 |

性能强、生态广 |

OpenAI已与美国国防部签约 |

|

Claude |

指令遵循精准、安全底线高 |

Anthropic是唯一拒绝军方合作的大厂 |

|

DeepSeek-V4 |

性价比高、长上下文 |

海外市场数据合规有争议 |

你还觉得选模型只是在选”哪个更聪明”吗?

———

普通人该怎么看?

我不打算给你一个”正确答案”,因为这事没有标准答案。但我可以给你一个判断框架:

1. 想清楚你的使用场景

如果你只是写写日报、做做PPT——用什么都行,不用想太多。

如果你在做企业级应用、处理敏感数据、或者你的客户在海外——你需要认真考虑模型提供商的背景了。

2. 看公司,不只看模型

以前我们选AI就像选手机——看参数、看跑分、看价格。

现在不行了。你得看这个公司跟谁合作、数据存在哪、它的安全政策是什么、它在哪些事情上愿意说”不”。

一个连军方合同都照签不误的公司,你觉得它会为你的隐私跟政府较劲吗?

3. 建立多模型工作流

2026年最聪明的做法是:不要把鸡蛋放在一个模型里。

·日常写作用GPT-5.5或Kimi,效率优先。

·涉及隐私和合规的场景用Claude。

·数据分析和文档处理用DeepSeek-V4,省钱。

·关键决策前,多模型交叉验证。

这不是因为某个模型不好,而是因为每个模型背后的公司都有自己的利益和立场,你不应该完全信任任何一个。

———

最后

这件事表面上是一条国际新闻,但它真正改变的是一个规则:

AI模型不再只是工具,它背后的公司正在成为你数字生活的基础设施供应商。

你选了谁的模型,就是选了谁的规则。

Anthropic这次说”不”,不代表它永远正确。但至少,在所有大厂都在抢军方订单的时候,有一家公司愿意站出来说:

“有些钱,我们不赚。”

这种姿态本身,就是一种信号。

你用的AI,你真的了解它吗?

GPT和Claude你更信任哪个?不是问谁更聪明,是问你更信任谁👇

———

信源:美国国防部2026年5月1日官方公告;The Guardian、Reuters相关报道。

夜雨聆风

夜雨聆风