AI Agent 记忆:一篇搞懂【上下文工程】核心技术与大厂面试八股!

点击蓝字,关注我们

大家好,我是小张。

在前几篇文章中,我们带大家深度剖析了 AI Agent 的底层基石:Tools,MCP以及Skills。但这几个都属于Agent能够使用的工具

真正决定 AI Agent业务落地效果的,是上下文工程能力。

LLM 本质上是无状态的,如何构建高效的状态管理和记忆注入机制?如何在有限的 Token 预算下实现高精度的信息检索?

本文将从架构视角的底层逻辑切入,全面解析 Agent 上下文工程的技术栈,并在文末硬核奉上大厂高频面试真题与高分答题思路。无论你是算法、开发还是产品,这是一篇不容错过的求职干货。建议先收藏再看,留着面试前复习!

1 定义:什么是 Agent 的「上下文工程」?

在系统架构层面,大语言模型(LLM)可以视为一个无状态的纯函数:

f(x)=y

但在实际业务中,Agent 需要处理连续的交互和复杂的任务规划,它必须是一个有状态的系统。

上下文工程,就是负责管理、流转、过滤和注入这个 状态的一整套流水线机制。它的核心目标是在LLM 有限的上下文窗口内,进行最优的 Token 预算分配。

一个健壮的 Agent Context 通常由以下三大模块动态拼接而成:

System Instructions: 包含 人设、核心 Workflow、输出约束。

Memory Stream: 记录对话历史与多轮推理的中间状态。

Grounding Data: 通过 RAG 或 Tool-use获取的实时数据与私有域知识库。

2 Agent 的记忆机制与存储选型

为了实现高低频数据的有效组装,Agent 的记忆系统通常被抽象为短期记忆与长期记忆两层架构。

1. 短期记忆

定义: 当前会话内的上下文状态,它直接决定了多轮对话的连贯性。

工程痛点: 随着会话增加,极易触发 Context Overflow并导致推理成本呈指数级上升。

常用优化策略:

滑动窗口截断: 基于 Token 计数器或固定轮次,采用 先进先出机制丢弃历史记录。

递归摘要: 当 Token 使用率达到阈值时,异步调用小模型对历史历史进行高度抽象总结,释放 Context 空间。

2. 长期记忆

定义: 跨越会话周期的持久化数据,包括用户画像、历史事件和海量外部知识文档。

常用优化方案:

🟦 向量数据库 —— 稠密检索

代表组件: Milvus, Qdrant, Pinecone.

技术直觉: 将文本映射为高维稠密向量,通过 ANN(近似最近邻)算法计算余弦相似度。

适用场景: 泛化语义匹配、自然语言问答。

🟥 图数据库—— 拓扑关系检索

代表组件: Neo4j, NebulaGraph.

技术直觉: 构建知识图谱,利用实体抽取和关系边进行子图匹配。

适用场景: 多跳推理、全局结构化知识查询。

🟨 传统搜索引擎 —— 稀疏检索

代表组件: Elasticsearch, PostgreSQL.

技术直觉: 基于词频-逆文档频率的进阶版算法 BM25,进行精准的倒排索引匹配。

值得注意的是:工业级 Agent 已全面舍弃单一检索,转向 Hybrid Search(混合检索) 架构。即:同时并发运行 Vector 召回与 BM25 召回,随后使用 Cross-encoder 进行相关性重排,最后截取 Top-K 注入 Prompt。

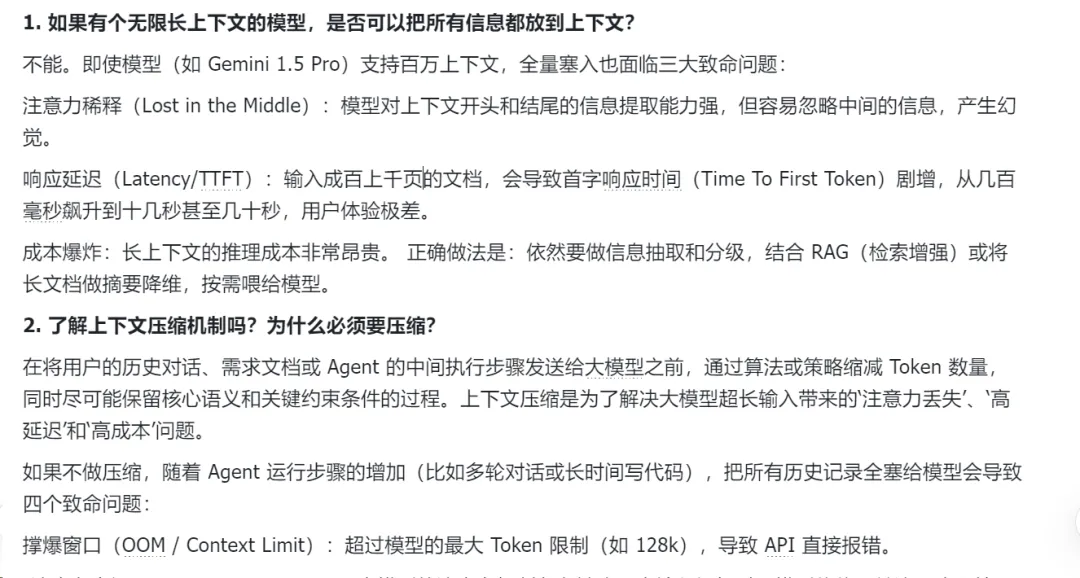

3 上下文工程高频八股与高分题解

为了帮大家拿下 Offer,这里同样总结了有关 上下文工程面试中常问的问题,建议背诵!

Q1 现在具备 100M+ Long Context(长上下文)能力的模型越来越多(如 Kimi, Claude 3.5),RAG 和上下文工程还有存在的必要吗?

我认为不仅有必要,且在企业级应用中短期内不可替代。

推理成本与 Latency瓶颈: 模型按 Token 计费,且输入文本的 KV Cache 计算成本极高。每次携带百万级 Token 请求,首字响应时间可能长达数秒到几十秒,对 C 端用户体验是毁灭性的,同时会大幅拉高单次并发的算力成本。RAG 依然是精准降本增效的核心。

动态数据与权限控制: 企业级应用中,数据是不断增删改查且具备严格权限隔离的。静态地把全量文档塞入长窗口无法做到细粒度的权限控制,而 RAG 检索层可以在数据库端通过 Metadata 过滤实现鉴权。

信息信噪比: 评测表明,即便模型支持超长窗口,当无关噪声过多时,其推理能力也会显著下降。精准的 Context Engineering 能提高 Prompt 的高信噪比,引导模型做出更稳健的决策。

Q2 在构建 Agent RAG 时,什么是 “Lost in the middle” 现象?系统层面你会如何设计优化方案?

LLM在处理长上下文时存在明显的注意力偏移,它能很好地提取靠近开头和结尾的信息,但对处于中间位置的上下文提取能力呈现‘U型谷底’式衰减。系统级优化方案包含:

引入 Rerank 机制并后置关键信息: 在 Retrieval 阶段召回多段 Chunk 后,必须加一层 Reranker。排序后,强制将打分最高的 Top 1 和 Top 2 Chunk 放置在 Prompt 拼接的最前端和最末端,将低分项放入中间。

Prompt 结构化与指令强化: 将 System Persona 和严苛的输出格式约束置于 Prompt 尾部,紧邻用户的 User Query 之前,防止模型在阅读长外挂知识后产生‘灾难性遗忘’。

合理的分块策略: 基于语义而非生硬的字符长度进行切分,保证单次注入的上下文片段自身逻辑完整,降低大模型的理解负担。

4 写在最后

从简单的 Prompt 拼接,到引入向量检索引擎,再到如今的 GraphRAG 与多层记忆架构。上下文工程正在从“文本处理黑盒”,演变为一门严谨的“系统级数据并发与路由分发工程”。

掌握上下文工程的底层设计原理,不仅能让你在面试中与架构师对答如流,更是打造企业级高质量 Agent 的核心内功。

祝各位在接下来的面试中大杀四方,拿下高薪 Offer!

如果你正在找工作,或者对 AI 落地感兴趣,欢迎关注、点赞、在看!你的支持是我持续输出最大动力!

更多相关的八股文小编整理在飞书文档中,关注公众号回复[A007],获取更多相关八股。

夜雨聆风

夜雨聆风