AI:如虎添翼,还是更虎?

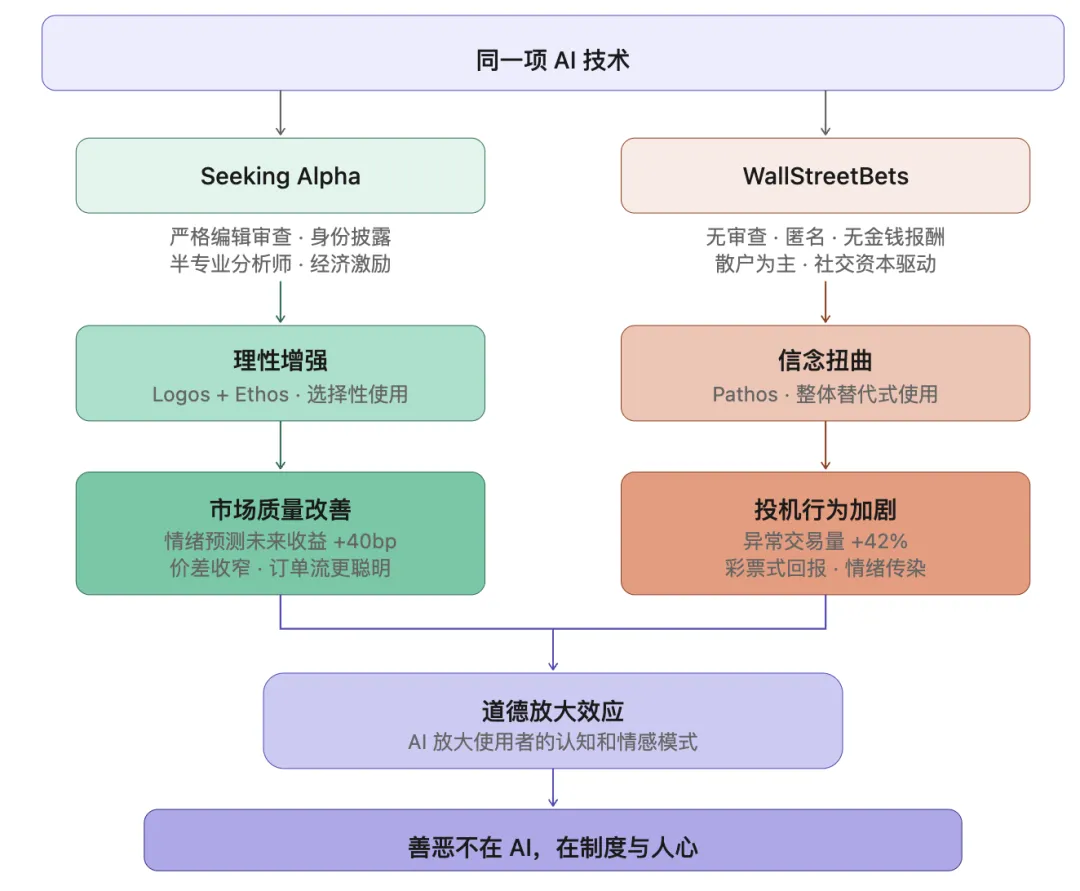

在Seeking Alpha——一个有着严格编辑审查、由半专业分析师组成的投资研究平台上——AI辅助的作者们写出了更深刻、更具洞察力的分析文章。他们的作品预测了未来股价走势,伴随而来的是更低的买卖价差、更聪明的散户交易。AI在帮助他们更好地理解世界。

在WallStreetBets——Reddit上以”YOLO”文化和模因股票闻名的社区里——同样使用AI的人们却在制造另一番景象:情绪化的叙事、极端的价格波动、彩票式的回报分布。AI在这里放大了市场的狂热和非理性。

同一项技术,同一片市场,截然不同的结果。

这不是一个关于AI本身的故事,而是一个关于人如何应用AI的故事。

一、实证的画卷:Hirshleifer等(2026)的核心发现

David Hirshleifer教授与四位合作者的这篇NBER工作论文(2026年2月),对2022年12月至2024年12月期间的两个金融社交媒体平台进行了大规模实证研究,使用GPTZero等工具检测AI生成内容,并系统考察了AI应用与市场结果之间的关系。其核心发现可以用一句话概括:AI是一面放大镜,不是一面镜子——它不创造方向,只放大已有的趋势。

谁在用AI?——不同动机下的选择

在Seeking Alpha上,AI的使用呈现出清晰的”理性增强”(reason enhancement)特征:

- 非英语母语的作者

更多使用AI(高出约2个百分点),因为AI帮助他们跨越语言障碍,更好地组织和表达复杂分析; - 研究导向的作者

——分析师、博士、MBA持有者——更倾向于使用AI,因为AI帮助他们快速学习新领域、整合分散信息; - 而领域专家

——投资组合经理、交易员、财务顾问——反而更少使用AI,因为他们的领域知识已经足够深厚,AI的边际收益有限; -

当作者首次覆盖某家公司时,AI使用率增加约11%;当公共信息稀少时(低分析师覆盖、低新闻曝光),AI使用率也显著上升。

在WallStreetBets上,模式完全不同:

-

AI使用量与信息成本无关。首次覆盖公司并不会导致AI使用增加; -

相反,零售买入激增之后,AI使用量随之飙升(增加70%-100%); -

这不是为了获取信息,而是为了制造叙事。

AI在说什么?——修辞策略的分化

研究团队利用GPT-4.0对每篇文章进行了修辞分析,基于亚里士多德的修辞三分法:

- Logos(理性诉诸)

:基于逻辑和证据的论证 - Ethos(人格诉诸)

:对可信度和权威的诉求 - Pathos(情感诉诸)

:情绪化的语言和叙事框架

在Seeking Alpha上,AI生成的内容与人类内容高度一致:约65-68%是Logos,15-20%是Pathos。AI被用来强化平台已有的分析规范。

在WallStreetBets上,AI生成的内容将更大部分的篇幅分配给Pathos,且整体说服力评分远超人类作者(6.6对5.9)。更有意思的是,即使控制Pathos比例,AI的说服力仍然更高——AI不是简单地增加情绪,而是让同样的修辞变得更加有效。

市场的回应——截然不同的价格后果

这是最震撼的部分。

在Seeking Alpha上:

-

AI文章的看涨情绪正向预测未来一周收益,涨幅约40个基点,且没有逆转; -

AI文章出现的股票,买卖差价(bid-ask spread)收窄约6%; -

AI文章让散户订单流更具信息含量——散户交易对未来收益的预测能力增强; -

AI文章降低了读者之间的分歧。

在WallStreetBets上:

-

AI消息后跟随着更高的异常交易量(增加约42%)和波动性(增加约16%); -

AI消息强烈预测彩票式极端回报事件——发生概率增加约50-62%; -

AI内容不增强订单流的信息含量; -

AI内容加剧了情绪的社群传染。

政策的自然实验:当Seeking Alpha开始禁止AI

2023年10月,Seeking Alpha开始执行”禁止AI”政策。这提供了一个难得的自然实验。

政策执行后,全面AI替代式(Uniform AI)的使用从47%骤降至26%,而选择性使用(Body-Loaded和Edge-Loaded AI)比例上升。更关键的是,政策执行后,继续使用AI的作者产出的内容信息含量更高了——AI文章的看涨情绪与未来收益的一致性显著增强。

这说明,制度的约束可以引导AI向有益的方向发展。不是AI本身变了,而是人用AI的方式变了。

二、为什么同样的人,应用AI会产生不同结果?

论文提供了一个极为有力的分析框架,我们可以从中提炼出几个关键机制:

2.1 制度环境决定激励机制

Seeking Alpha有编辑审查、身份披露、经济补偿机制。作者如果发布质量低下的内容,声誉受损,收益下降。在这种制度下,AI被用来写出更好的分析,因为这是激励所指向的方向。

WallStreetBets没有审查、允许匿名、没有直接金钱报酬。社交资本(Karma点数、社区认可)是主要驱动力。”YOLO”、模因、高风险交易截图是社区货币。在这种制度下,AI被用来制造更具传染性的叙事,因为这也是激励所指向的方向。

制度的差异塑造了AI使用方式的差异。 工具中立,但环境不中立。

2.2 用户认知能力决定信息处理方式

Seeking Alpha用户平均年龄47岁,拥有约52万美元可投资资产,年均交易11.6次。这是相对成熟的投资者群体,更倾向于基于分析的决策。

WallStreetBets有超过1400万订阅者,用户整体更年轻、更不成熟、更容易受到情绪和同伴影响。

同样的AI输出,在成熟用户那里被当信息线索来处理,在受情绪驱动的用户那里被当行动信号来接收。认知能力的差异放大了AI效果的差异。

2.3 使用模式决定产出质量

论文对AI使用模式的分析极具洞察力。在Seeking Alpha上,AI更多被选择性使用——集中在分析段落或框架部分,而人类作者保留了对核心内容的控制。在WallStreetBets上,AI几乎总是被整体替代:整个消息都是AI生成的。

选择性地使用AI是增强,整体替代则是外包思考。两者的差距,决定了内容的深度和可信度。

2.4 动机决定方向

Seeking Alpha作者用AI是为了补足信息缺口——当他们对公司不熟悉时、当信息稀少时。这是一种求知驱动的使用。

WallStreetBets用户用AI是为了放大情绪共振——当零售买入激增时、当需要制造更具说服力的叙事时。这是一种社交驱动的使用。

动机决定了AI是通向真理的桥梁,还是制造幻象的工具。

三、从实证到哲学:AI对人究竟是善还是恶?

这引出了我们这个时代最根本的哲学问题之一。

3.1 “工具中立论”的困境

传统观点认为技术是中立的——刀可以切菜也可以杀人,核能可以发电也可以造弹,AI同样如此。这种”工具中立论”在逻辑上无懈可击,但在实践上回避了问题。

因为技术从来不是在真空中被使用的。技术总是嵌入在特定的制度、文化、激励结构中。而恰恰是这些外部条件,决定了技术效果的善恶。

正如这篇论文所揭示的:在Seeking Alpha的制度环境下,AI是”善”的——它增强了理性、提升了信息效率、改善了市场质量。在WallStreetBets的制度环境下,AI是”恶”的——它放大了非理性、加剧了投机、催生了泡沫。

AI的善恶不在于AI本身,而在于它赖以运行的社会生态系统。

3.2 AI的”道德放大效应”

我提出一个概念:道德放大效应(Moral Amplification Effect)。

传统技术放大的主要是物理力量——蒸汽机放大了人的体力,计算机放大了人的计算力。AI放大的却是人类的认知和情感模式。

如果你倾向于理性分析,AI让你的分析更深刻。如果你倾向于情绪化的赌博,AI让你的赌博更”有理有据”。如果你寻求真理,AI帮你更快找到真理。如果你追求迷因,AI帮你制造更精美的迷因。

AI不像过去的技术那样仅仅是工具,它是一种认知放大器。它把你已有的思维模式、行为倾向、道德判断放大数倍。这意味着:在AI时代,人的品质比以往任何时候都更加重要。

一个正直的人有了AI,可以写出影响千万人的洞见。一个不正直的人有了AI,可以制造影响千万人的谎言。AI放大了你的存在。

3.3 制度设计才是”元答案”

如果AI的效果取决于使用环境,那么问题就变成了:我们能不能设计出更好的环境来引导AI的善用?

Seeking Alpha的”AI禁令”自然实验给出了一个希望:当制度约束改变时,AI的使用方式随之改变。全面替代式使用下降,选择性互补式使用上升,内容的信息含量反而提高了。

这提示我们:与其争论AI本身是善是恶,不如把精力花在设计更好的制度约束上。 这些制度约束可以包括:

- 透明机制

:要求AI生成内容明确标识,让读者知道自己在读什么; - 负责机制

:建立身份披露和责任追溯,降低AI制造虚假信息的收益; - 素养教育

:提升用户的AI素养和信息判断能力,减少被操纵的脆弱性; - 平台设计

:调整算法的激励结构,从追求参与度转向追求信息质量。

3.4 最后的哲学命题:人的位置在哪里?

也许这篇论文最深刻的含义在于:在AI时代,人的因素变得更加关键,而不是更加不重要。

在Seeking Alpha上,最成功的AI使用者是那些本身就有分析能力的人——分析师、博士、MBA。AI不是替代了他们,而是放大了他们。在WallStreetBets上,AI之所以导向负面结果,恰恰是因为使用者的意图本身就不在于追求真理,而在于追求社交认同和情绪宣泄。

因此,关于AI善恶的终极答案可能是这样的:

AI既不善也不恶,但它不可避免地放大了使用者的品性。而使用者的品性,又取决于他们所处的制度环境和文化土壤。

这意味着,我们不应该问”AI会毁灭人类吗”,而应该问**”我们正在构建什么样的制度和文化,来引导AI的放大效应?”**

Seeking Alpha和WallStreetBets的故事告诉我们:同一片AI的天空下,有人用它点亮了智慧的灯塔,有人用它点燃了狂热的火焰。区别不在AI,在人心。而人心,是可以被好的制度和教育塑造的。

结语

Hirshleifer等(2026)的这篇论文之所以重要,不仅因为它的实证发现,更因为它提供了一个看待AI的范式——AI不是命定的,而是被塑造的。它的社会效果取决于我们设计的环境、我们建立的制度、我们培养的素养。

技术乐观主义者说AI会解放人类。技术悲观主义者说AI会奴役人类。而这篇论文告诉我们:AI会放大人类——放大我们的智慧,也放大我们的愚蠢。最终的走向,取决于我们自己。

这既是一个令人警醒的结论,也是一个充满希望的消息。因为,如果AI的善恶取决于我们,那么我们也有能力让它向善。关键在于:我们是否愿意正视这个责任,并为之行动。

本文由DeepSeek-v4-Flash生成。

Hirshleifer, D., Peng, L., Wang, Q., Zhang, W., & Zhang, X. (2026). AI, Opinion Ecosystems, and Finance. NBER Working Paper No. 34807。

夜雨聆风

夜雨聆风