最近,频繁被问到的两个问题:① AI编程时代,还需要传统的软件工程么?② AI编程时代,还需要传统的软件工具链么?

两个话题其实相关,都属于第七个包子的问题,试图跳过信息化、数字化直接上马智能化。没有前两者的积淀,智能化即便不是空中楼阁吧,也只能说是纸上谈兵。

(本文内容较长,建议收藏后慢慢阅读。)

传统软件工具链已成历史?

2025年至2026年,AI编程助手的能力边界急剧扩展。Claude Code可以读取需求文档、写代码、运行测试、提交PR。GitHub Copilot Workspace甚至可以自主完成整个功能开发循环。自然会引发一个问题:既然AI什么都能做,传统软件工具链是否已经成为历史?

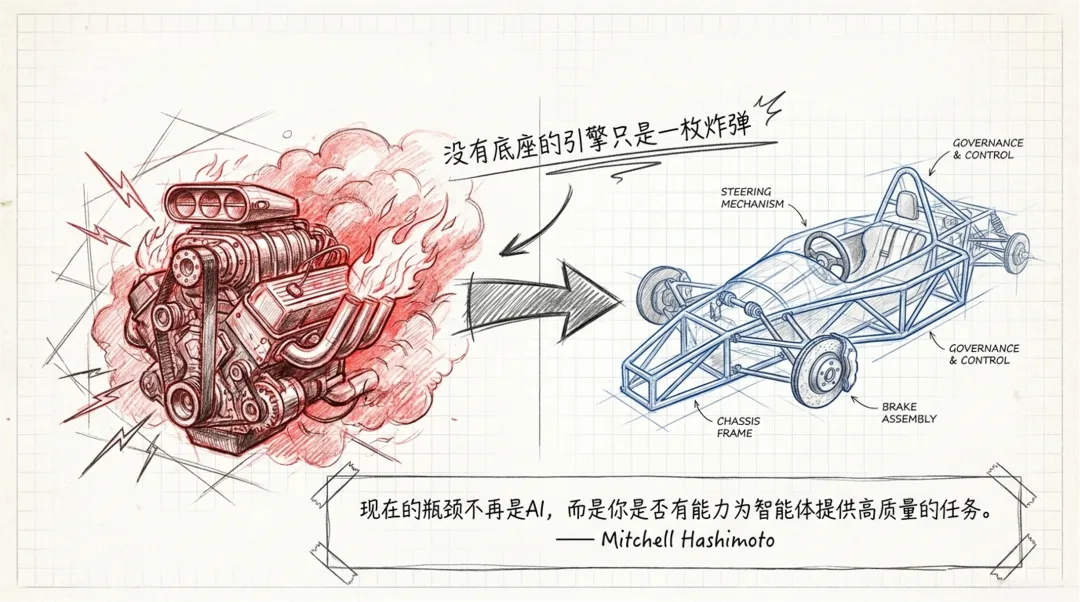

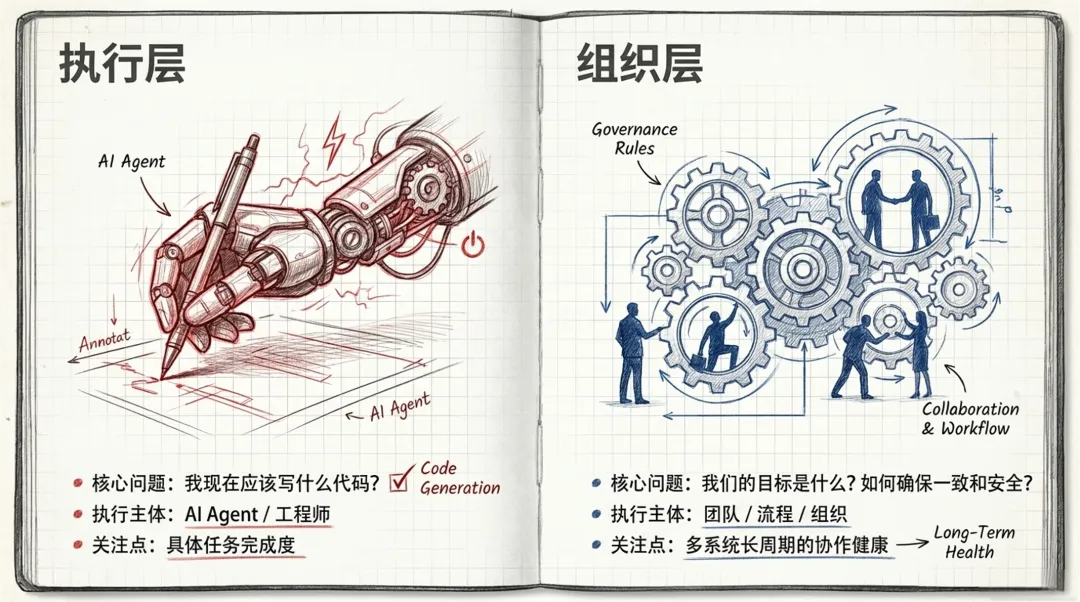

首先,先明确给一个否定的答案。认为AI可以替代传统工具链的判断,源于对「执行」与「组织」两种不同层次能力的混淆。

本文核心观点:Claude Code等AI编程助手是超级智能的编码执行者,而需求管理、设计建模、CI/CD、测试工具等传统工具解决的是组织级的能力框架和流程保障问题——这是两个不同层次的存在,彼此互补而非替代。

「工具放大能力,但不创造意图。」

「AI Agent是超级智能的编码执行者,而那些“传统”工具是组织级的能力框架和流程底座。」

一、澄清核心概念:执行层与组织层的本质区别

1.1 两层能力的区分

-

-

-

核心问题:我们的目标是什么?如何确保一致?如何保证质量?

-

工具:需求管理系统、设计建模工具、CI/CD平台、测试基础设施

软件工程的两层能力模型:┌─────────────────────────────────────────────────────────┐│ 组织层 ││ ││ 需求管理 ←→ 设计建模 ←→ CI/CD ←→ 测试工具 ││ ↑ ││ │ 提供目标、约束、质量标准和协作框架 ││ │ ││ ▼ ││ ┌─────────────────────────────────────────┐ ││ │ 执行层 │ ││ │ │ ││ │ 人类工程师 AI Agent │ ││ │ ↕ ↕ │ ││ │ 写代码 写代码 │ ││ │ 调试 调试 │ ││ │ 重构 重构 │ ││ └─────────────────────────────────────────┘ ││ │└─────────────────────────────────────────────────────────┘

1.2 为什么这个区分至关重要

当Simon Willison说「代理写出的代码超过了人类阅读的代码量」时,他描述的是执行层的变革。

-

-

-

谁来确保代码可以安全地部署到生产环境?—— 发布流程

-

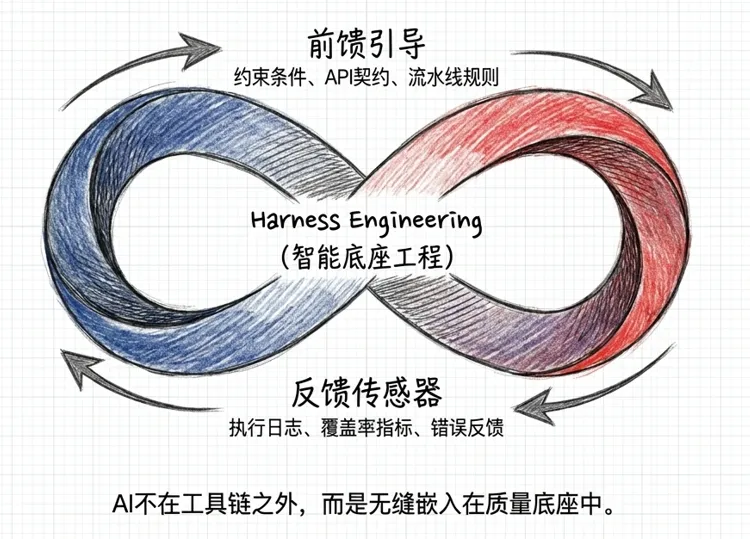

这些问题不会因为AI能写代码而消失。恰恰相反,当执行效率急剧提升时,组织层的协调和保障变得更为关键——否则越高效的执行可能意味着越快速的灾难。正如Mitchell Hashimoto(HashiCorp 联合创始人)说的「现在的瓶颈不再是AI,而是你是否有能力为智能体提供高质量的任务。」

二、需求管理工具的系统记录与共识挑战

关于Jira这类的需求管理工具是否会被类似Claude Code的智能体取代的讨论,核心在于搞混了“意图(Intent)”与“执行(Execution)”的区别。Claude Code 等工具极大地增强了执行速度,但它们无法自主产生商业意图,也无法在多个利益相关者之间调解冲突。需求管理工具不仅没有消失,反而成为了智能体获取“执行上下文”的权威数据源。

2.1 从执行界面到知识权威

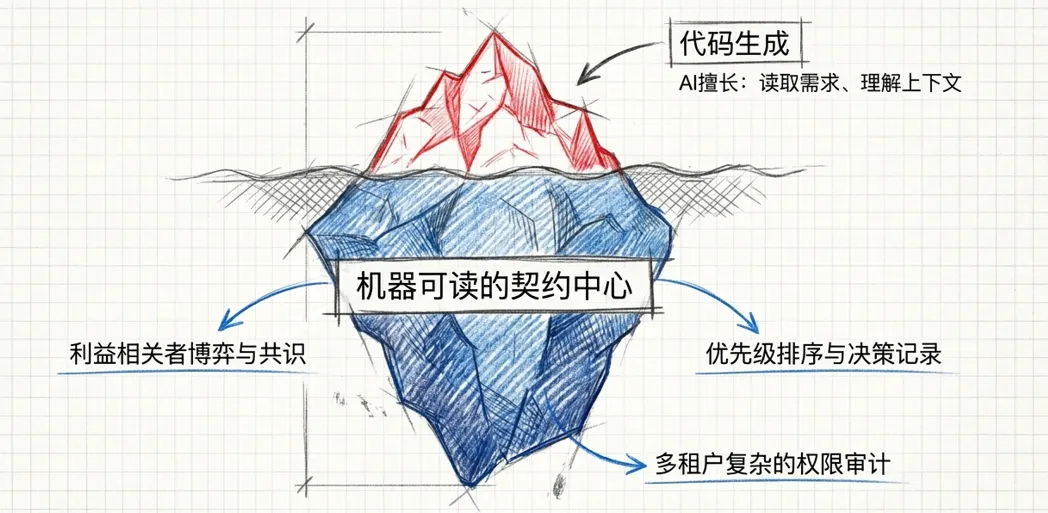

在传统模式下,需求管理工具是人类程序员查看任务的界面;在智能体模式下,需求管理工具演变为一种“机器可读的契约中心”。智能体通过 API 提取需求与任务的上下文,将其转化为代码实现的约束条件。然而,需求管理工具内部的数据往往是零散的,包含大量的非结构化对话和历史快照,这导致智能体在缺乏结构化输入的情况下难以准确预测交付风险。

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

拥有成熟的 auth 模型、治理架构和审计合规能力。

|

|

|

|

|

虽然 AI 可以通过分析 Sprint 模式来预测风险,但这一过程高度依赖于需求管理工具中记录的轨迹数据:计划了什么、实际发生了什么、学到了什么。如果废弃了这些系统,智能体将陷入“上下文贫血”,导致生成的代码虽然语法正确,但在业务逻辑上与企业战略脱节。因此,2026 年的主流实践是维持需求管理工具作为“真相源(Source of Truth)”,并利用AI智能体在其上执行自动化任务,如自动起草进度报告、收集阻碍因素或标注长期未动工的任务。

2.2 需求管理的核心价值

需求管理工具解决的不仅是「记录需求」,而是对业务价值的裁决(否则用Excel不就行了么):

-

产品经理、营销、销售、客户——他们对功能的期望不同

-

-

2.3 AI Agent能做什么、不能做什么

2.4 一个具体场景的说明

AI Agent读取需求 → 生成支付集成代码 → 编写单元测试

1. 这个支付方式是否符合公司支付合规要求? → 需要合规团队判断2. 与现有订单系统的交互如何处理? → 需要架构评审3. 如何分阶段发布,灰度策略是什么? → 需要发布策略决策4. 如何让多个团队(前端、后端、测试、运维)协同? → 需要流程协调5. 如何验证上线后是否真正满足了客户需求? → 需要验收标准定义

关键洞察:AI可以把「怎么做」执行得非常好,但它不知道「做什么」的选择依据是什么,更无法协调多个利益相关者的认知。

三、设计建模工具:AI无法具备的全局视野

3.1 设计系统的治理危机

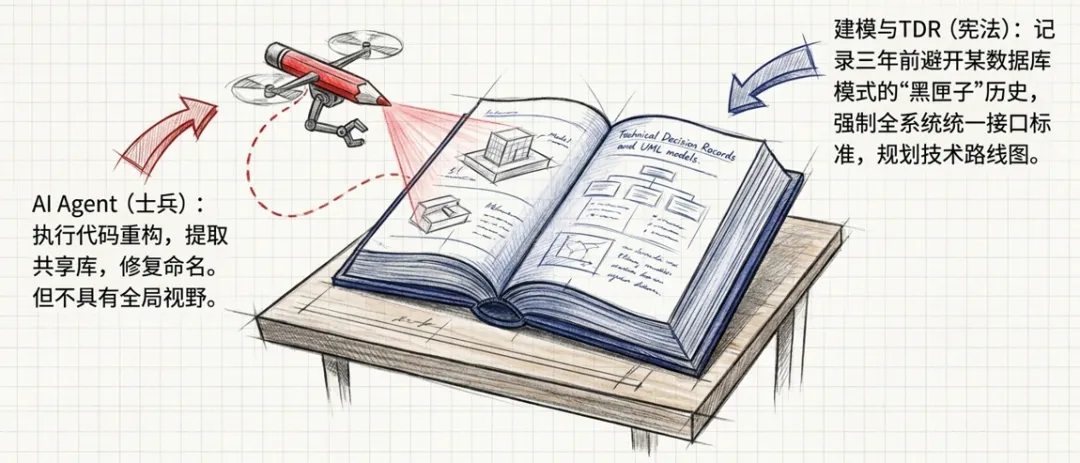

设计建模工具旨在解决复杂系统的结构抽象、跨模块接口定义、技术决策记录(TDR)以及架构一致性保证。Claude Code虽然具备一定的读图和代码生成能力,但其对系统长期演进中的技术债务管理和架构腐化控制缺乏战略眼光。

AI编程助手通常在有限的上下文窗口内工作。这种“局部最优”的特性导致了所谓的“提示词驱动架构(Prompt-driven Architecture)”:系统设计反映的是成千上万个独立提示词的集合,而非统一的工程策略。在这种模式下,AI可能会在同一系统的不同模块中引入不一致的服务模式、错误处理机制或集成契约。研究表明,AI生成的代码在逻辑和正确性问题上的出现频率比人类高出75%,这在很大程度上源于AI缺乏对全局架构约束的理解。

传统架构建模工具(如UML模型)提供了“机器无法通过统计学模拟”的结构化思维。它们迫使架构师显式定义组件边界和依赖关系。尽管目前的视觉语言模型(VLM)在理解软件架构图方面有所进步,但顶级模型(如Gemini 3 Flash)在处理复杂交互流时的准确率仍未突破80%的瓶颈,而小型模型甚至低于20%。这意味着,如果缺乏确定性的设计底座,AI生成的系统将迅速陷入不可维护的“泥潭”中。

AI生成代码的一个悖论是:它使编码速度加快,但也使技术债务的累积速度加剧。88%的开发者报告称,AI对技术债务产生了负面影响,主要体现在生成冗余代码和引入难以察觉的副作用。设计建模工具作为可视化呈现复杂关系的手段,在AI时代反而变得更加重要。它们能够帮助资深工程师识别AI生成的方案是否违背了预设的领域模型或性能约束。

此外,技术决策记录(TDR)作为架构演进的“黑匣子”,是AI无法自动生成的。AI不知道为什么在三年前团队决定避开某种特定的数据库模式。这种基于历史教训的决策必须沉淀在传统的文档和建模工具中,以作为AI生成逻辑的“上位法”。

3.2 设计建模工具的核心价值

3.3 AI Agent能做什么、不能做什么

-

-

-

-

决策推理:为什么当初选择微服务而非单体?这个决策今天还成立吗?

3.4 一个技术债务管理的案例

场景:一个有5年历史的微服务系统,存在大量架构腐化

「把这个类的命名改成符合规范的」「为这个模块添加接口隔离」「将这个重复逻辑提取为共享库」

核心洞察:设计建模工具记录的是系统的「宪法」——架构原则、决策理由、长期目标。AI Agent是执行「宪法」的士兵,但它不知道「宪法」为什么这样写,更无法修改「宪法」。

四、CI/CD 与基础设施:从流水线到智能编排器

4.1 概率产出与确定性基础设施的硬隔离

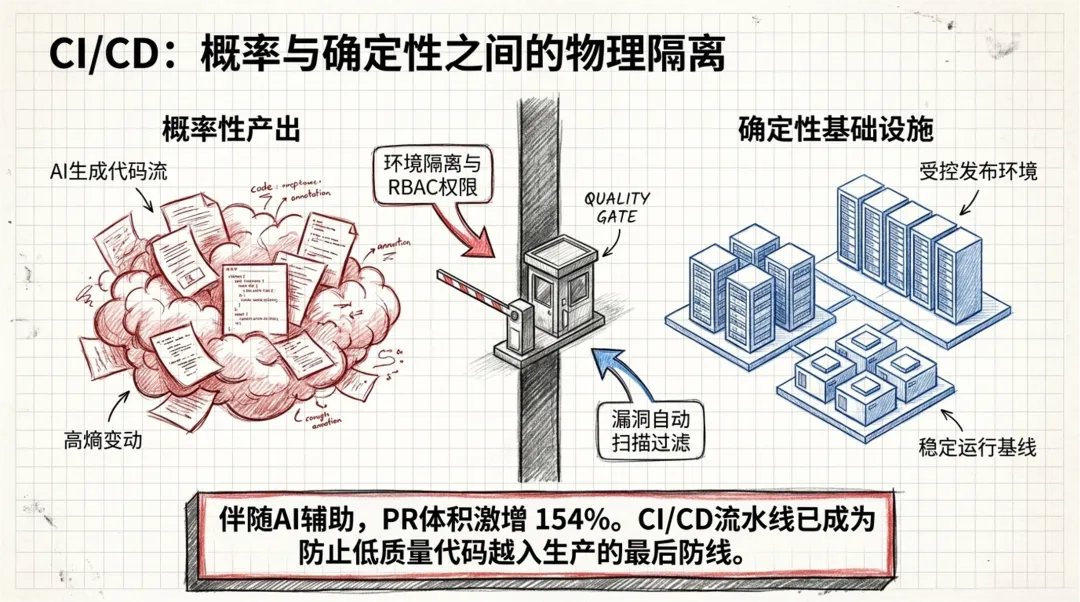

CI/CD工具解决的是自动化构建、测试、部署、环境管理和回滚流程的可靠性。AI智能体可以编写流水线脚本,但它并非流水线运行的物理载体。更重要的是,在非确定性(AI产出)与确定性(生产运行)之间,CI/CD充当了关键的安全隔离带和权限边界。

AI智能体如Claude Code具备极强的操作性,能够触发构建或执行部署任务,但将这种能力无限制地暴露给生产环境将带来致命风险。AI在执行过程中可能出现幻觉,例如误关重要的生产资源或在部署时泄露API密钥。传统CI/CD工具提供了严密的基于角色的访问控制(RBAC)、密钥存储以及物理环境隔离。

这些工具定义的工作流是AI代码进入生产环境的唯一合法路径。即使AI可以生成IaC配置(如Terraform),这些配置文件也必须通过CI/CD流水线的确定性校验和模拟运行(Plan),而非由AI直接在云端生效。流水线作为一种“不可篡改的审计日志”,记录了每一次从代码到制品的转换过程,这对于企业的合规性治理至关重要。

AI生成代码的本质是概率性的,而软件交付的要求是确定性的。CI/CD流水线中的每一个“质量门禁(Quality Gate)”——如静态分析、单元测试覆盖率、漏洞扫描——都是对AI产出的最终裁决。研究显示,AI辅助的PR大小增加了154%,这导致了严重的评审瓶颈。在这种情况下,依赖CI/CD中的自动化静态检查(如SonarQube)来初步过滤低质量或有漏洞的代码,成了维持团队交付效率的先决条件。

4.2 CI/CD平台的核心价值

4.3 AI Agent能做什么、不能做什么

-

运行流水线:它不是执行环境,无法真正运行测试和构建

-

-

-

-

故障恢复:当流水线失败时,不能自动修复基础设施问题

4.4 一个生产环境故障的处理场景

工程师:「Claude,帮我分析一下最近的代码变更」Claude Code:「最近3小时内有5个提交,其中一个修改了支付模块...」

回滚到哪个版本?→ 需要CI/CD系统的制品历史如何验证回滚成功?→ 需要运行测试套件谁有权限执行回滚?→ 需要权限系统回滚通知谁?→ 需要告警系统如何防止问题再次发生?→ 需要变更流程复盘

核心洞察:CI/CD是保障系统可靠性的「基础设施」,就像电力系统——你不能用一个更聪明的灯泡来替代电网。AI Agent可以在灯泡层面发光,但电网提供的才是让灯泡可能发光的基础。

五、质量保证与测试:AI生成测试与专业测试工具的分工

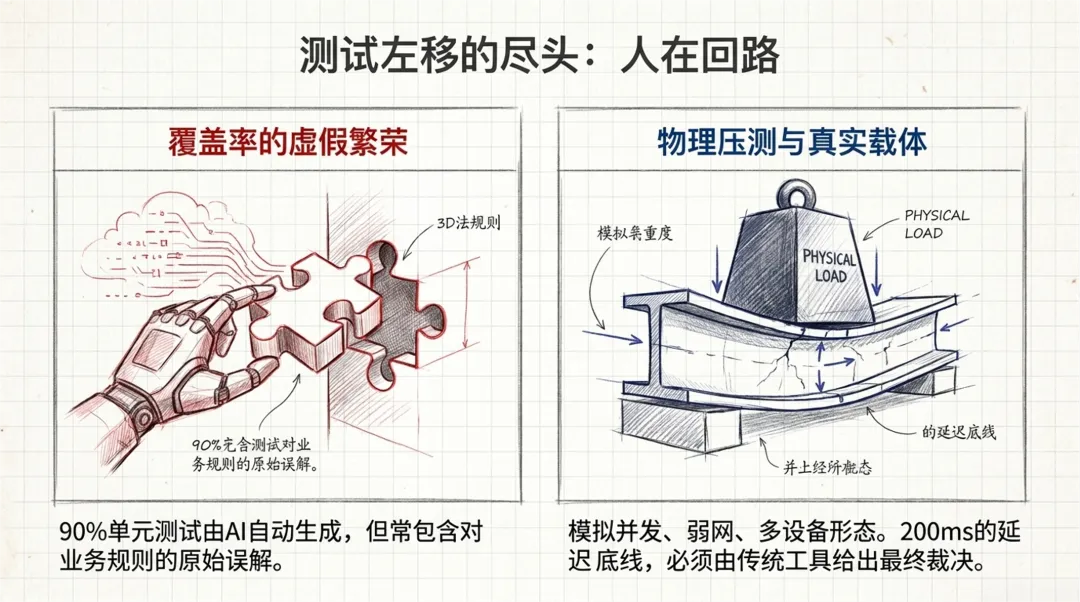

测试工具是受智能体影响最深、变革最剧烈的领域。2026 年,企业普遍实现了“测试左移”的终极形态:AI 智能体在编写代码的同时,已经能够基于对代码仓库的理解生成了单元测试、集成测试甚至模糊测试脚本。

测试工具领域正经历着从“脚本维护”到“意图驱动”的变革。尽管AI能高效生成单元测试,但对于集成测试、端到端(E2E)测试、性能压测及安全扫描,仍需要专门的工具与严密的运行时环境支撑。

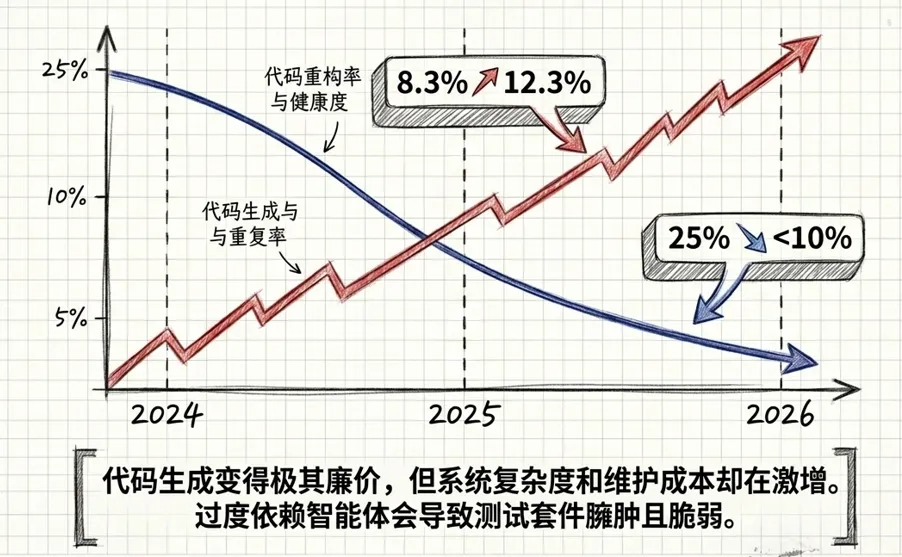

5.1 自动化生成与技术债的博弈

尽管 AI 测试生成的效率极高,但我们在 2026 年观察到了所谓的“交付悖论”:代码生成变得廉价,但软件系统的复杂度和维护成本却在激增。GitClear 的分析显示,2024 年至 2026 年间,代码重复率从8.3%上升至12.3%,而代码重构的比例却从 25%下降到了不足10%。这表明,过度依赖智能体生成测试会导致测试套件变得臃肿、脆弱,且难以捕捉深层业务逻辑的细微偏离。

AI助手编写单元测试的速度令人瞩目,但其质量往往存在“自证清白”的倾向。AI往往基于其生成的函数逻辑来编写测试,如果原始逻辑本身包含对业务规则的误解,那么生成的测试也会相应地包含这种误解,从而失去发现问题的能力。此外,AI对于复杂并发、分布式事务以及边缘情况的捕捉能力较弱,因为这些场景在训练数据中相对稀缺。

传统测试工具链(如Selenium, Appium, JMeter)提供了真实的运行载体,能够模拟多用户并发、弱网环境及不同设备形态下的系统行为。对于高性能系统,AI生成的查询或代码必须经过专门的压力测试工具验证。性能需求(如API响应在200ms以内)是具体且可衡量的NFR,AI只能尝试优化,而传统工具则负责给出最终的通过或失败结论。

测试的充分性与质量保证策略需要人工设计。测试领域正向“人在回路(Human-in-the-Loop)”治理模式转型。在这种模式下,AI处理高容量、低复杂度的重复性任务,而人类测试专家则专注于风险驱动的策略设计、探索性测试以及伦理合规性审查 。

在金融服务等高风险行业,智能体被用于将数十万行 COBOL 遗留代码迁移至 Java。在此过程中,虽然 AI 实现了80%的自动化率,但最终的正确性验证仍依赖于成熟的回归测试工具和人类的“最后签字权(Sign-off)”。这种协作模式确认了:测试工具并未消失,而是从“脚本执行器”演变为“智能体行为的验证者”。

5.2 测试工具体系的完整图景

测试不是一个单一活动,而是一个涉及多个层次、多种工具的体系:

测试金字塔:┌───────────┐│ E2E │ ← Selenium/Playwright/Cypress│ 测试 │├───────────┤│ 集成测试 │ ← TestContainers/Docker├───────────┤│ 单元测试 │ ← Jest/Pytest/Go test└───────────┘另外还有:- 性能测试:JMeter- 安全扫描:SonarQube/Snyk- 变异测试:Infection Medics/Pitest- 覆盖率分析:Istanbul/Coverage.py

5.3 AI Agent在测试中的角色

|

|

|

| 集成测试 |

|

| E2E测试 |

|

| 性能测试 |

|

| 安全扫描 |

|

| 变异测试 |

|

| 覆盖率分析 |

需要专业覆盖率工具的 instrumentation

|

5.4 一个API服务的完整测试场景

场景:一个RESTful API服务,需要验证其正确性

def test_create_order_success():response = client.post("/orders", json={"product_id": 123, "quantity": 1})assert response.status_code == 201assert response.json()["id"] is not None

1. 集成测试:真实数据库 + 真实网络→ 需要 Docker Compose + TestContainers→ AI Agent无法「想象」出PostgreSQL2. E2E测试:完整的用户下单流程→ 需要 Playwright/Cypress 浏览器自动化→ 需要启动整个应用栈3. 性能测试:1000并发请求的响应时间→ 需要 k6/Gatling 负载生成器→ 需要监控和基准对比4. 安全扫描:SQL注入、XSS、CSRF→ 需要专业安全扫描工具→ 需要漏洞特征库更新5. 混沌测试:部分服务宕机时的系统行为→ 需要 Chaos Monkey→ 需要故障注入框架

关键洞察:测试的本质是「验证系统在各种条件下都可靠」。AI Agent可以生成「理想条件下看起来对」的测试代码,但测试需要运行在真实环境、覆盖边界条件、处理异常情况——这些都需要专业的测试基础设施。

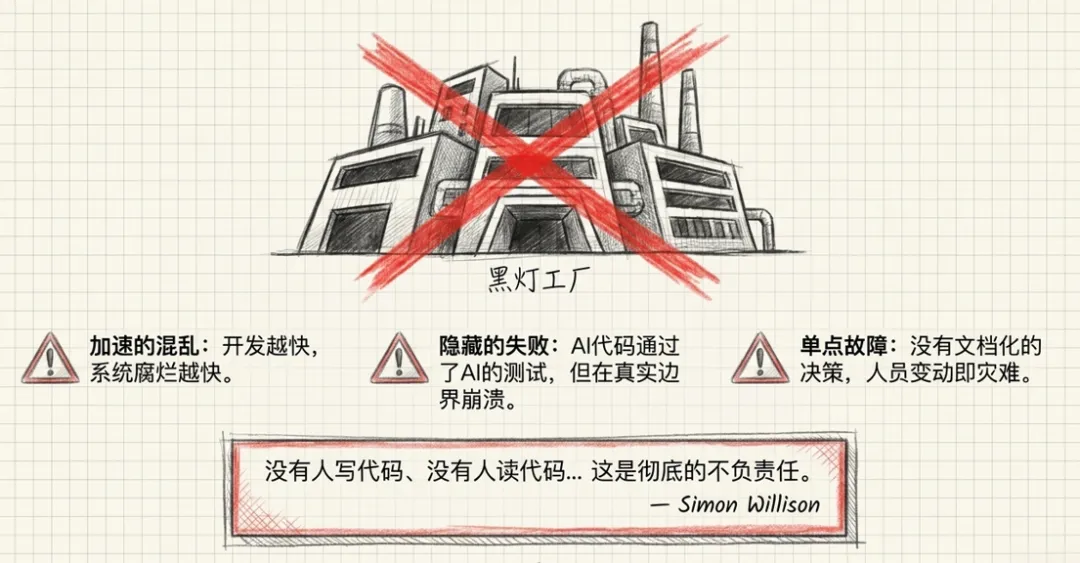

六、工具和工程能力缺失的风险

罗马不是一天建成的,正如数字化无法逾越信息化,智能体工程也无法直接跳过筑基信息化与数字化的软件工具链。优秀的Harness Engineering并非始于AI,而是始于优秀的软件工程实践。

6.1 当执行效率与组织协调失衡时

当AI大幅提升执行效率,但组织层工具缺失时,会发生什么?

6.2 一个真实的反模式案例

2026年初,部分公司宣布「没人写代码、没人读代码」的黑灯工厂模式。这种模式的前提是:

|

|

|

|

|

AI只能处理明确描述的需求,隐含需求和利益冲突需要人类判断

|

|

|

|

|

|

|

Simon Willison的评价:「这是彻底的不负责任」——除非有真正有效的Harness和质量保障机制。

七、新的协作模式:工具层与AI层的融合

7.1 正确的协作模型

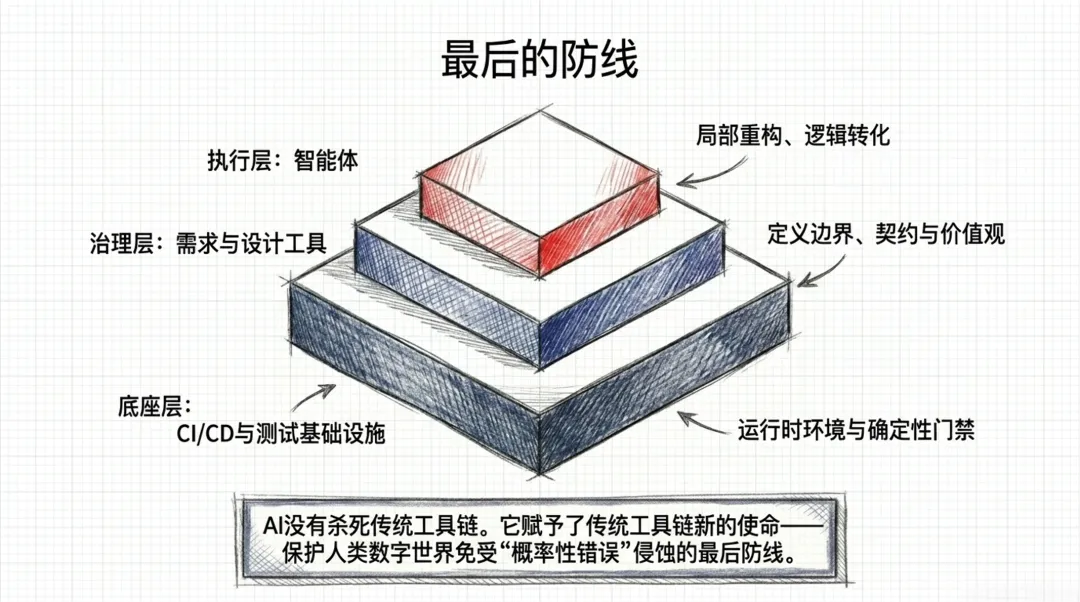

AI编程助手与传统软件开发工具链之间并非竞争性的替代关系,而是深度的互补协作关系。AI Agent作为“超级智能的编码执行者”,释放了人类在琐碎逻辑、语法转换和重复样板代码上的劳动力;而需求管理、设计建模、CI/CD及测试工具则作为“组织级的能力框架和流程底座”,提供了人类文明在软件工程领域沉淀下来的确定性、纪律性和安全性保障。

┌─────────────────────────────────────────────────────────┐│ 组织层工具(不可替代) ││ ││ 需求管理 ←→ 设计建模 ←→ CI/CD ←→ 测试基础设施 ││ ↑ ││ │ 提供目标、约束、质量标准、协作框架 │└─────────────────────────────────────────────────────────┘↕ 有序交互┌─────────────────────────────────────────────────────────┐│ AI执行层(能力放大器) ││ ││ Claude Code / Codex / Cursor ││ ↑ ││ │ 读取组织层输出,执行具体任务 ││ ↓ ││ 生成代码 → 进入CI/CD → 测试验证 → 人工抽检 → 部署 ││ │└─────────────────────────────────────────────────────────┘

7.2 具体协作场景

1. 需求管理→ 用户故事:作为用户,我希望能用微信支付付款→ 验收标准:支付成功率 > 99.9%,响应时间 < 3秒→ 优先级:P1→ 涉及模块:支付服务、订单服务、通知服务2. 设计建模→ 更新架构图:新增支付适配器模块→ 定义接口契约:PaymentGateway interface→ 记录TDR:为什么选择微信而非支付宝(商户费率更低)3. CI/CD→ 配置流水线:支付模块独立部署→ 设置质量门禁:单元测试覆盖率 > 80%,安全扫描通过→ 配置灰度策略:10%流量先跑,监控无异常后全量4. 测试基础设施→ 准备测试账号和沙箱环境→ 配置支付场景的集成测试→ 设置性能和负载测试阈值

→ 读取用户故事和验收标准→ 生成支付适配器模块代码→ 编写单元测试(符合覆盖率要求)→ 生成集成测试代码框架→ 帮助调试和修复测试失败

关键点:AI在「执行需求」阶段发挥作用,但「需求是什么」「如何验证」「何时部署」由组织层决定。

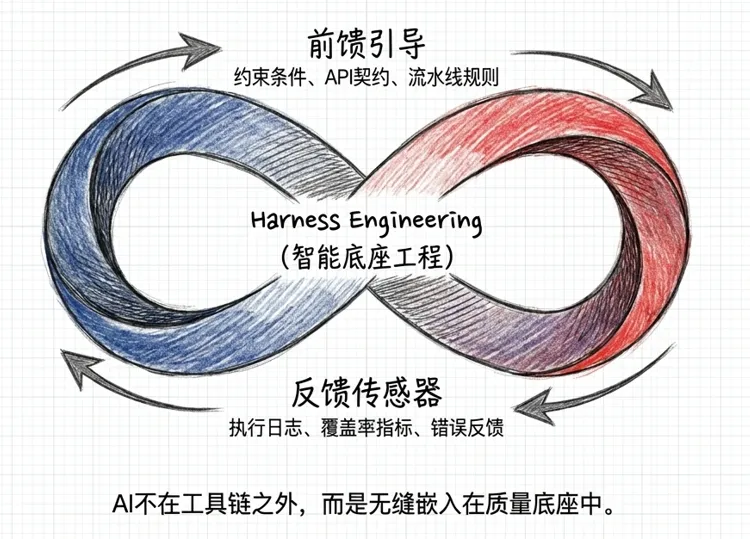

7.3 Harness Engineering:新协作模式的工程基础

Harness Engineering框架,恰好是连接AI执行层和组织层的工程基础:

Feedforward Guides(组织层→AI层):

AGENTS.md需求理解- 每次实现前,先读Jira上的用户故事- 确认理解了验收标准再开始编码架构约束- 遵循架构图中的模块边界- 不允许跨模块循环依赖质量要求- 单元测试覆盖率 > 80%- 所有PR必须通过安全扫描

Feedback Sensors(AI层→组织层):

CI/CD流水线反馈- lint: 必须通过- test: 覆盖率报告自动生成- security: SonarQube扫描结果- arch-check: ArchUnit边界检查

组织层定义目标 → AI层执行 → 传感器反馈 → 人工抽检 → 组织层改进流程

八、结论:工具层与AI层的正确关系

8.1 核心论点回顾

第一:软件工程存在「执行层」与「组织层」两个本质不同的层次。

第二:AI编程助手(Claude Code等)本质上是执行层的革命性提升,而非组织层的替代。

第三:需求管理、设计建模、CI/CD、测试工具解决的是组织层的协调、质量、保障问题——这些问题不会因AI能写代码而消失。

第四:AI执行层与组织层工具链的正确关系是分层协作、闭环反馈,而非彼此替代。

8.2 对从业者的建议

-

-

-

学会在组织层工具中定义清晰的目标和约束,让AI更有效地执行

-

-

恰恰相反,当执行加速时,组织层的协调和治理变得更加重要

-

投资Harness Engineering,让AI执行与组织目标对齐

-

-

投资「AI友好的」接口:更好的结构化输出、更清晰的语义

-

8.3 开放问题

-

工具整合:如何让需求管理、设计建模、CI/CD工具更自然地与AI Agent集成?

-

反馈闭环:如何建立组织层工具与AI执行层之间的自动反馈机制?

-

治理边界:哪些组织层决策可以部分自动化,哪些必须保留人工判断?

-

技能演进:当AI承担更多执行工作时,组织层能力(需求分析、架构设计、项目管理)是否需要重新定位?

AI没有杀死传统工具链,反而通过提高系统的复杂度和变动速度,赋予了传统工具链新的使命——它们成了保护人类数字世界免受“概率性错误”侵蚀的最后防线。在AI驱动的软件工程新时代,那些能够将AI的“效率增量”无缝嵌入到传统工具链“质量底座”中的企业,将获得持久的竞争优势。

感谢阅读!我是冬哥,专注于探索AI软件研发的新范式。

如果本文对你有所启发或帮助,不妨 推荐、分享,并关注我 ❤️。你的每一次互动,都是我持续分享优质内容的强大动力。

夜雨聆风

夜雨聆风