本地部署 OpenClaw 大模型:零 Token 快速上手(DeepSeek 专属版)

OpenClaw 是一款开源 AI 智能体框架,主打隐私私有化部署,全程无需 API 密钥 / Token,就能让大模型在本地 “安家”。

之前用千问的小伙伴已经快速跑通流程,这次咱们换热门的 DeepSeek 来接入,手把手带你从环境准备到服务验证,全程零 Token、零复杂配置,微信公众号读者零基础也能跟着做!

一、核心准备:硬件与依赖先搞定

部署前的基础准备是关键,硬件够、依赖装对,后续全程一路绿灯~

1. 硬件最低要求(通用不挑机)

内存:≥2GB(推荐 8GB 以上,跑 DeepSeek 7B 模型更丝滑)

磁盘:预留 ≥20GB 空间(7B 量化模型约 4.7GB)

处理器:Intel i5/Ryzen 5 及以上,无 GPU 也能跑(CPU 运行速度稍慢,不影响体验) 系统:Windows 11、macOS、Linux 全兼容(Windows 建议用管理员 CMD 终端,避免权限坑)

2. 核心依赖安装(Node.js + Ollama)

OpenClaw 基于 Node.js 运行,本地模型靠 Ollama 管理,两步搞定安装:

(1)安装 Node.js 22+

https://nodejs.cn/en/download/prebuilt-binaries

# Linux/macOS 命令curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash -sudo apt install -y nodejs# Windows:直接从 nodejs.org 下载 22+ 版本,一路点“下一步”安装

✅ 验证:终端输入 node -v,显示 v22.x.x 就说明装成功了

(2)安装 Ollama(本地模型管家)

下载安装:从 Ollama 官网 下对应系统版本,Windows 安装后自动注册服务,Linux/macOS 执行命令 # Linux/macOS 一键安装curl -fsSL https://ollama.com/install.sh | sh✅ 验证:终端输入 ollama --version,显示版本号即安装完成

二、核心步骤:DeepSeek 接入 + OpenClaw 部署(零 Token)

这部分是重点!咱们先拉取定制化的 DeepSeek 模型,再配置 OpenClaw 接入,全程不碰任何 Token~

1. 安装 OpenClaw 主程序

先配国内镜像加速,再全局安装,速度更快不踩坑:

# 配置 npm 国内镜像(加速安装,国内用户必做)npm config set registry https://registry.npmmirror.com# 全局安装 OpenClaw 最新版npm install -g openclaw@latest✅ 双重验证: 1. 输入 openclaw --version,显示 v2026.3.x 及以上版本

2. 输入 openclaw doctor,无报错提示,环境就完全没问题

2. 拉取并定制 DeepSeek 模型(关键!)

OpenClaw 要求模型上下文窗口 ≥16000 tokens,咱们给 DeepSeek 手动配置 32768 tokens,满足长文本需求。以 DeepSeek 7B 量化版 为例(4GB+ 显存就能跑):

# 1. 拉取 DeepSeek 基础模型ollama pull deepseek:7b# 2. 创建 Modelfile 配置上下文(32768 tokens,超长上下文)# Windows(CMD 终端,替换 <你的用户名>)cd C:\Users\<你的用户名>@"FROM deepseek:7bPARAMETER num_ctx 32768"@ | Out-File -Encoding ascii Modelfile# Linux/macOScd ~echo "FROM deepseek:7bPARAMETER num_ctx 32768" > Modelfile# 3. 生成定制模型(命名好记,后续直接用)ollama create deepseek:7b-32k -f Modelfile

💡 显存备选方案(按自己电脑配置选):

8GB 显存:deepseek:7b(原生版,效果更好) 4GB 显存:deepseek:7b-instruct-q4_0(量化版,轻量化不卡顿) 2GB 显存:deepseek:3b(轻量版,低配电脑也能跑)

3. OpenClaw 初始化配置(零 Token 核心步骤)

执行配置向导,全程选本地、填对地址,完全不用输入任何 Token / 密钥!

# 启动配置向导openclaw onboard

一步步跟着选(新手直接抄):

提示 “是否确认安全风险”:输入 Yes 回车

选择配置模式:新手直接选 QuickStart(快速配置,不用动脑)

选择模型提供商:输入 Ollama(核心!本地模型都走这个通道)

填写 API 地址:输入 http://127.0.0.1:11434/v1(Ollama 本地固定地址,必须带 /v1!)

填写模型名称:输入咱们定制的 deepseek:7b-32k(和上一步模型名完全对应)

后续所有提示直接回车默认,配置就完成啦!

4. 启动 OpenClaw 服务,开启本地 AI 对话

执行启动命令,坐等服务加载,然后就能用 Web 控制台玩起来~

# 启动服务openclaw gateway start# 后续想停止服务用这个命令# openclaw gateway stop

🎉 访问入口:打开浏览器,输入 http://127.0.0.1:18789,直接进入 Web 控制台(无需 Token 登录,首次登录自动创建管理员账号,超方便)

三、快速验证:DeepSeek 本地部署成功了吗?

两步测试,马上确认效果,新手也能快速判断~

1. 基础功能测试(必做)

进入 Web 控制台的「对话」页面

输入测试指令:帮我写一段 Python 代码,打印“Hello OpenClaw + DeepSeek 本地部署成功”

若 10-30 秒内返回代码,说明 DeepSeek 本地调用完全通畅!

2. 上下文能力验证(进阶)

输入指令:我刚才让你写的代码功能是什么?

如果模型能精准回复 “打印指定欢迎语”,说明咱们配置的 32k 上下文生效啦,长对话也不会丢内容!

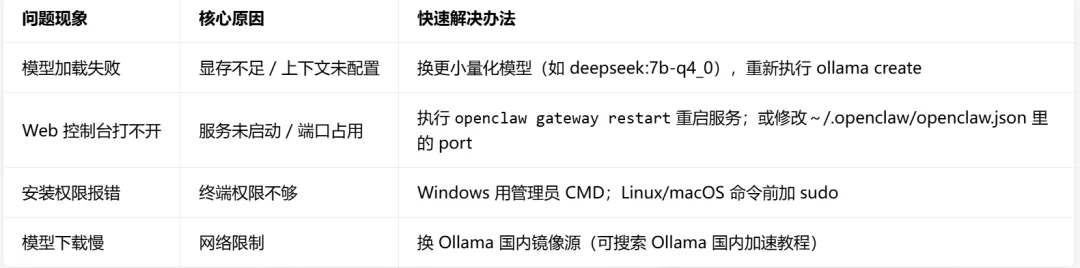

四、避坑指南:新手常见问题快速解决

部署时遇到小问题不用慌,对照这几条马上搞定~

五、扩展玩法:让本地 AI 更强大(可选)

部署完成后,还能给 OpenClaw 加技能,让它更懂你的需求~

1. 安装实用技能(零 Token)

自动安装:

在控制台输入指令,比如「帮我安装联网搜索技能」,AI 自动配置

手动安装:从 ClawHub 官网 下载 Skill 压缩包,解压到:

Windows:C:\Users\<你的用户名>\.openclaw\skills\

Linux/macOS:~/.openclaw/skills/

重启服务即可生效

2. 换其他本地模型(通用流程)

想换别的模型?直接走 3 步流程:

ollama pull 模型名 拉取模型

配置上下文生成定制模型

重新执行 openclaw onboard,改模型名即可

六、总结:本地部署核心要点

用 Node.js + Ollama 对接 DeepSeek,全程零 Token、零 API 密钥,核心流程就 4 步:

装 Node.js + Ollama 基础依赖

拉取并定制 DeepSeek 32k 上下文模型

配置 OpenClaw 本地 Ollama 提供商

启动服务,用 Web 控制台验证

这样部署的本地 AI,隐私完全可控,不用怕数据泄露,日常对话、代码生成、文案创作都能搞定~ 赶紧跟着步骤试试,拥有自己的本地 DeepSeek 智能体吧!

💡 提示:部署过程中如果遇到具体报错,可截图终端信息,我帮你快速定位问题~

本地部署电脑配置是关键,安装前现将电脑组个备份,推荐腾讯openclaw一键云部署方便简单

夜雨聆风

夜雨聆风