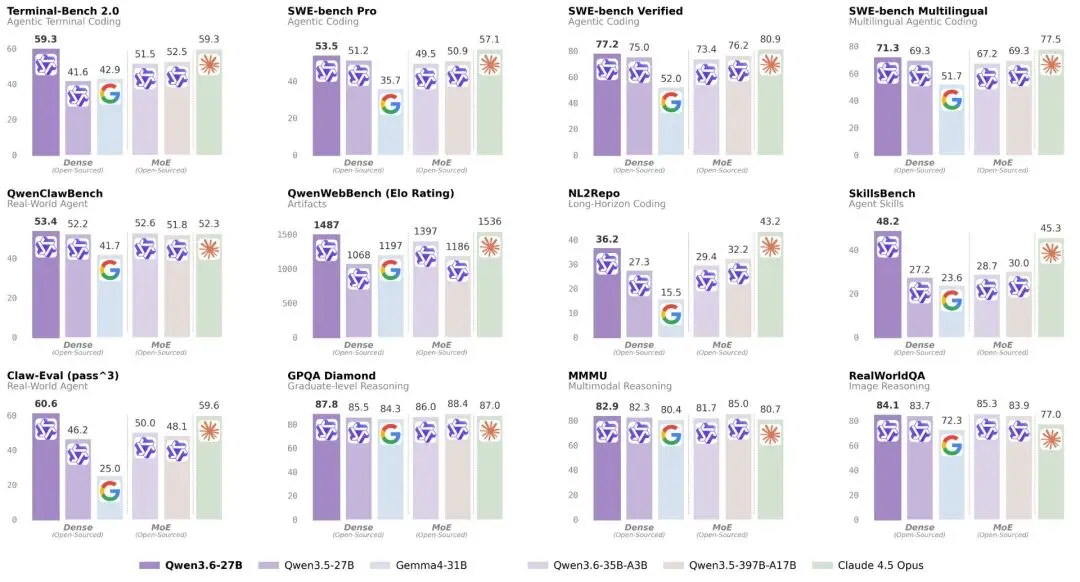

2026年4月22日,阿里云通义千问团队正式开源了Qwen3.6系列最受社区期待的型号——Qwen3.6-27B。这款270亿参数的稠密多模态模型一发布便引爆AI圈:它在所有核心编程智能体评测中全面超越了前代旗舰Qwen3.5-397B-A17B(总参数3970亿的MoE模型,参数量是其15倍),将旗舰级编程能力下放到了消费级硬件可运行的规模,堪称今年以来开源社区最具实用性的模型之一。

一

本地部署

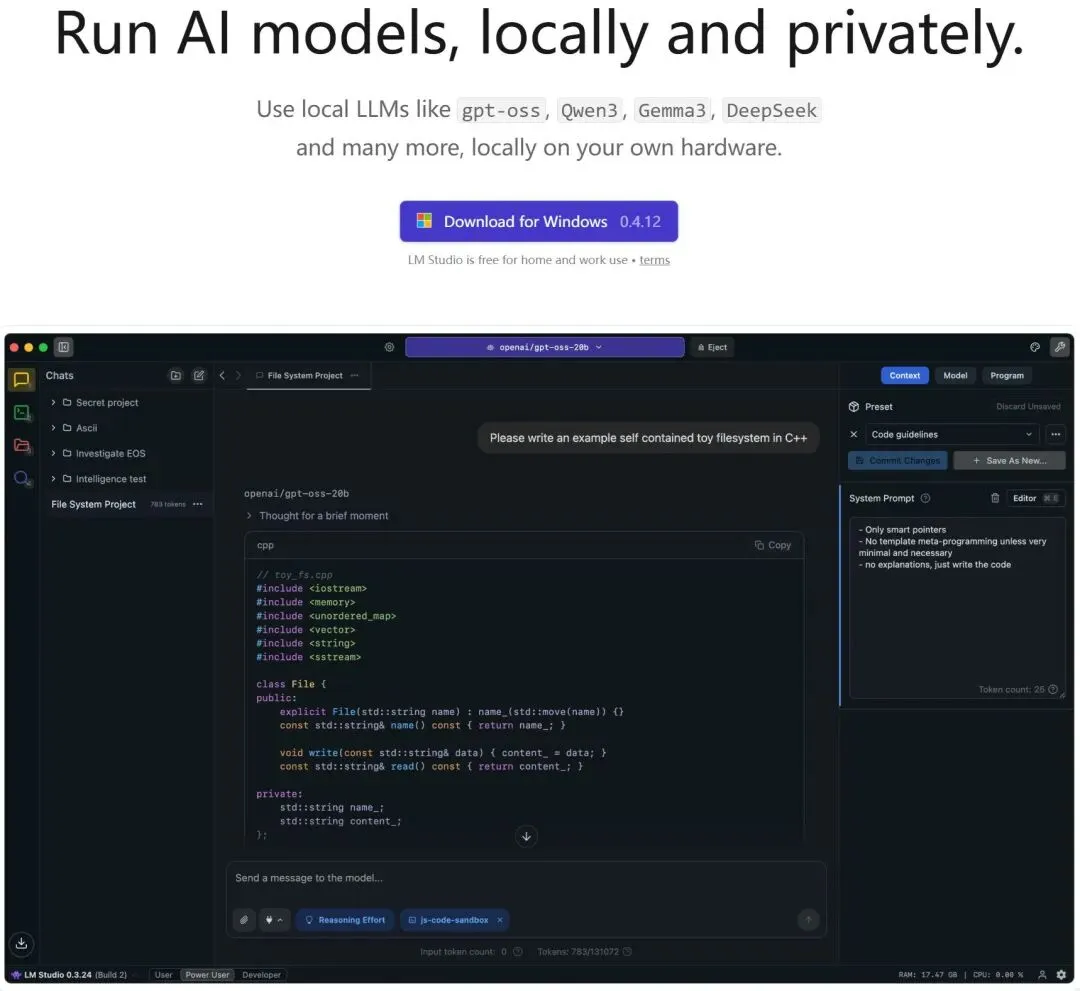

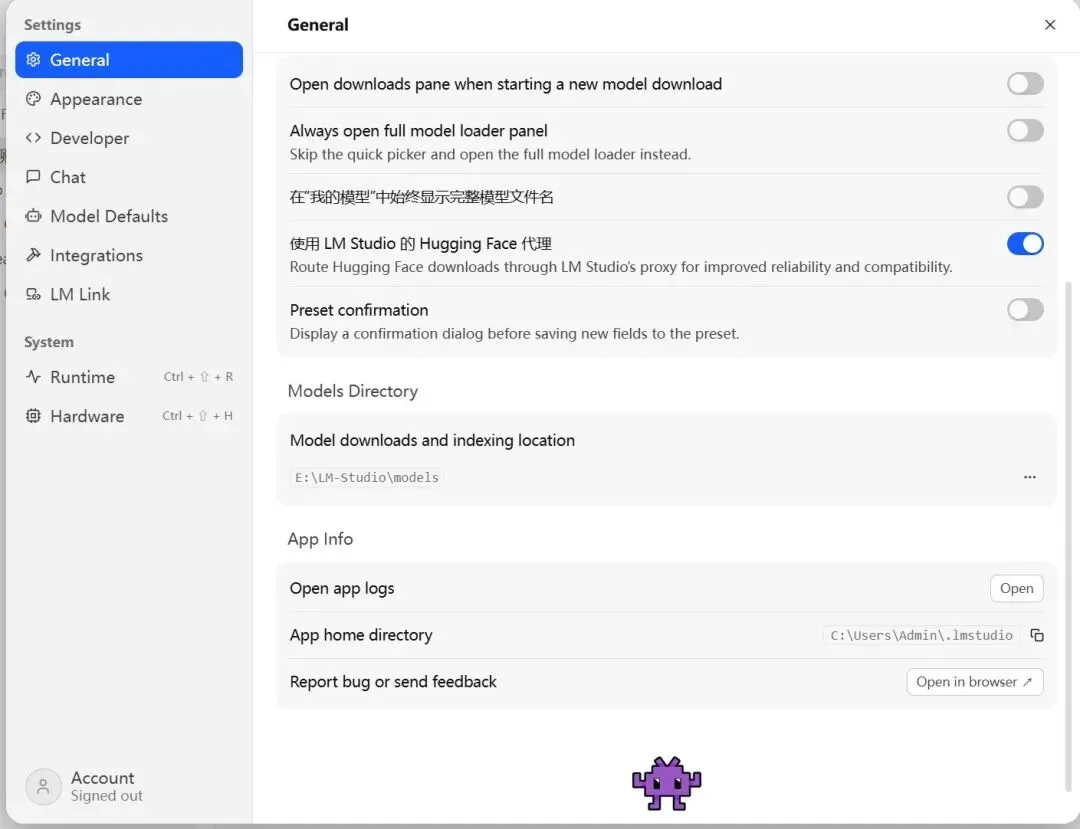

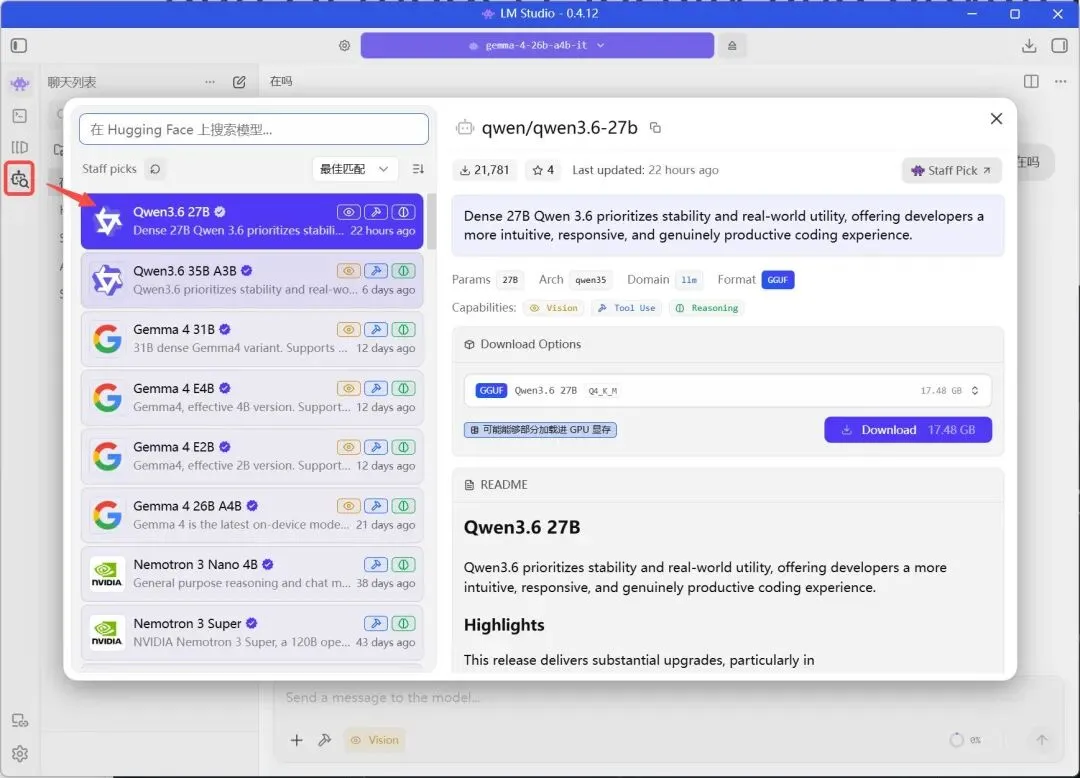

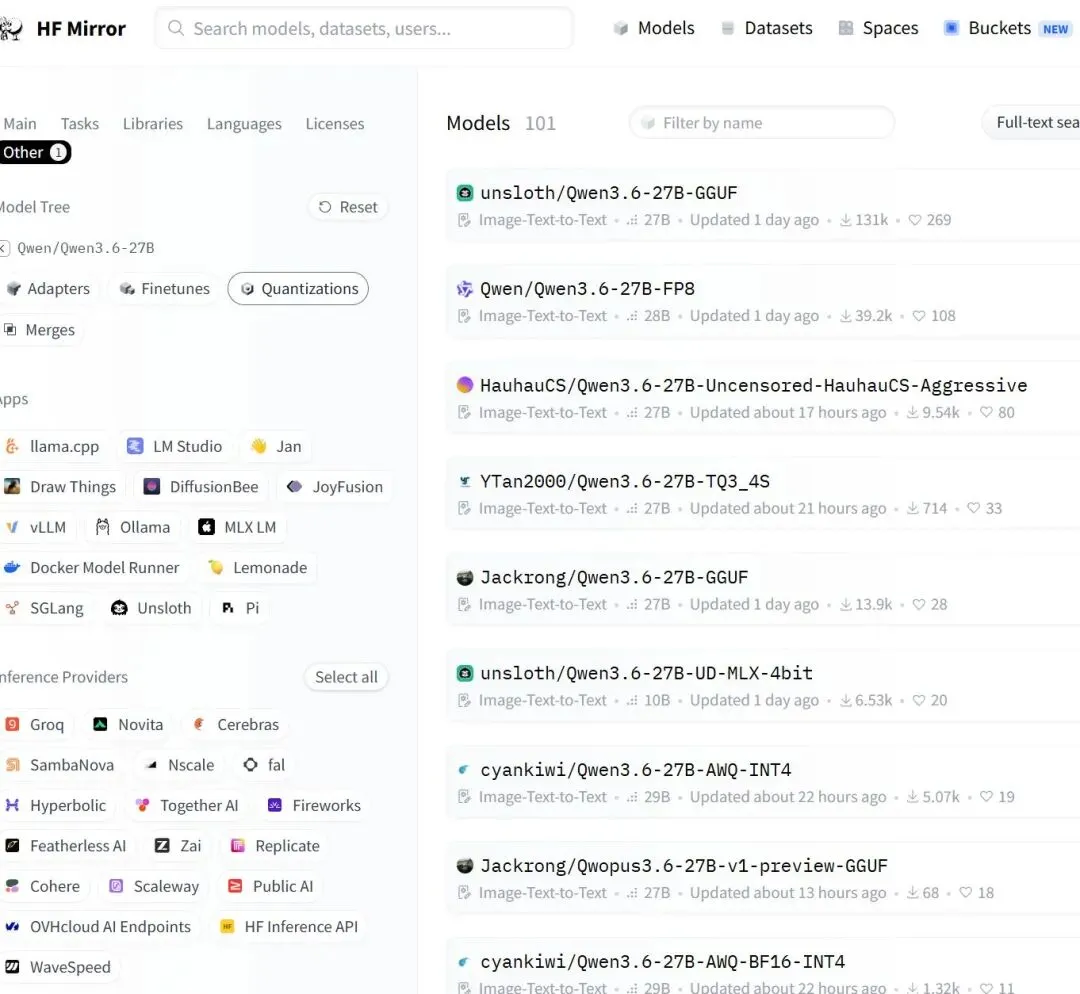

本地部署可以采用ollama,LMstudio,lama.cpp以及VLLM,部署的难度依次由易到难,但可调的参数也由少到多。简单体验下用ollama就够了,企业部署的话VLLM比较合适。在我电脑上三者都有部署,今天我演示LM studio的简易体验流程。在部署之前先说下我的电脑主要配置显卡:GTX5080,内存88G,CPU:ultra7-265kF主要是显存和内存,我这个显存16G,也见过一些人12G也在跑,内存最好64G以上。安装很简单,直接到https://lmstudio.ai 下载windows安装包,按提示安装即可。

接入Hermes agent

大模型可以在本地用,也可以接入openclaw小龙虾或最近大火的Hermes agent,因为windows无法直接安装Hermes,是通过WSL2安装在隔离的Ubantu系统内,所以在连接LM studio的时候需要进行如下设置并在网络中提供API服务。

适用场景:中小团队和个人开发者的福音

Qwen3.6-27B的定位非常清晰,它几乎是为开发者量身打造的模型:

- 个人/小团队本地编程助手: 量化后可在普通工作站甚至高性能笔记本上运行,不需要云API成本,数据完全本地可控。

- 代码智能体部署: 作为OpenClaw、Hermes Agent等智能体框架的本地大脑,可实现自动化代码生成、测试、部署全流程。

- 企业内部知识库+开发辅助: 结合RAG可搭建兼具代码能力和业务知识的内部助手,大幅提升开发效率。

- 多模态开发场景: 可直接处理设计稿生成前端代码、根据报错截图定位问题等创新应用。 总的来说,Qwen3.6-27B是今年以来开源社区最具实用性的模型之一,它第一次把旗舰级的代码智能体能力下放到了普通开发者可负担的硬件规模上,必将引发新一轮的AI开发应用创新。如果你是开发者,尤其是做智能体、编程工具相关的方向,这个模型绝对值得第一时间尝试。简单的任务使用本地的模型跑,复杂的任务结合Claude跑,还是可以省下不少Token,毕竟能省点是点。

夜雨聆风

夜雨聆风