51万行源码泄露后,我用Claude写代码开始“脱敏”了

你的商业代码,可能正在AI面前裸奔

从开发者视角看AI编程工具的安全边界

上周,AI圈被一记重锤砸醒:Anthropic的Claude Code,因一个npm打包失误,51万行核心源码被泄露在公网。40多个工具模块、未发布功能,一览无余。

这不止是巨头的尴尬。它把一个问题炸到了所有开发者面前:

我们每天喂给Claude、ChatGPT的代码,安全吗?会被记住、泄露,甚至成为训练别人的素材吗?

作为一名用Claude写了3个月代码的嵌入式工程师,这次事件后,我彻底审计了我的AI工作流。今天,我想和你聊聊在AI时代,如何守住代码安全的底线。

从51万行泄露,看我们身边的“黑天鹅”

这次泄露,暴露了AI工具安全链条的脆弱。

-

泄露了什么? 不只是51万行代码,更是完整的调试信息(.map文件),相当于把一座建筑的施工图纸公之于众。

-

原因多低级? 一个忘记排除配置文件的打包失误。顶级AI公司尚犯此错,我们凭何相信“绝对安全”?

-

与你何干? 这次事件是一个危险信号:如果平台自身都难保,你上传的数据(你的代码)在它的服务器里流转,又有多大概率绝对安全?

为什么是Claude?—— 能力与风险的孪生子

Claude在复杂逻辑和安全性上表现惊艳,这正是我们依赖它的原因。

我3个月的真实体验

我用Claude写嵌入式代码,发现:

1. 代码更像人写的

ChatGPT写的代码能跑,但有”AI味”,不够优雅。Claude写的代码会考虑边界情况,注释清晰,更像是经验丰富的程序员写的。

2. 上下文理解更强

Claude能读懂整个项目结构,写出的代码是”融合的”,不是孤立的片段。这一点在大型项目中太重要了。

3. 更懂安全——这是重点!

同样一个”用户登录”需求,我让两个AI分别写:

ChatGPT写的:

deflogin(username, password):# 直接字符串拼接,SQL注入风险! user = db.query(f"SELECT * FROM users WHERE username='{username}'")return user.password == passwordClaude写的:

deflogin(username, password):# 参数化查询,防止SQL注入 user = db.query("SELECT * FROM users WHERE username = %s", (username,))ifnot user:returnFalse# 密码哈希验证return verify_hash(password, user.password_hash)看到差距了吗?

Claude会主动考虑安全问题,主动加注释说明为什么这样写。这一点在2026年的环境下太重要了。

但问题来了……Claude编程能力这么强,大家都用它写代码,代码会不会被”记住”?

你的代码会被AI”记住”吗?

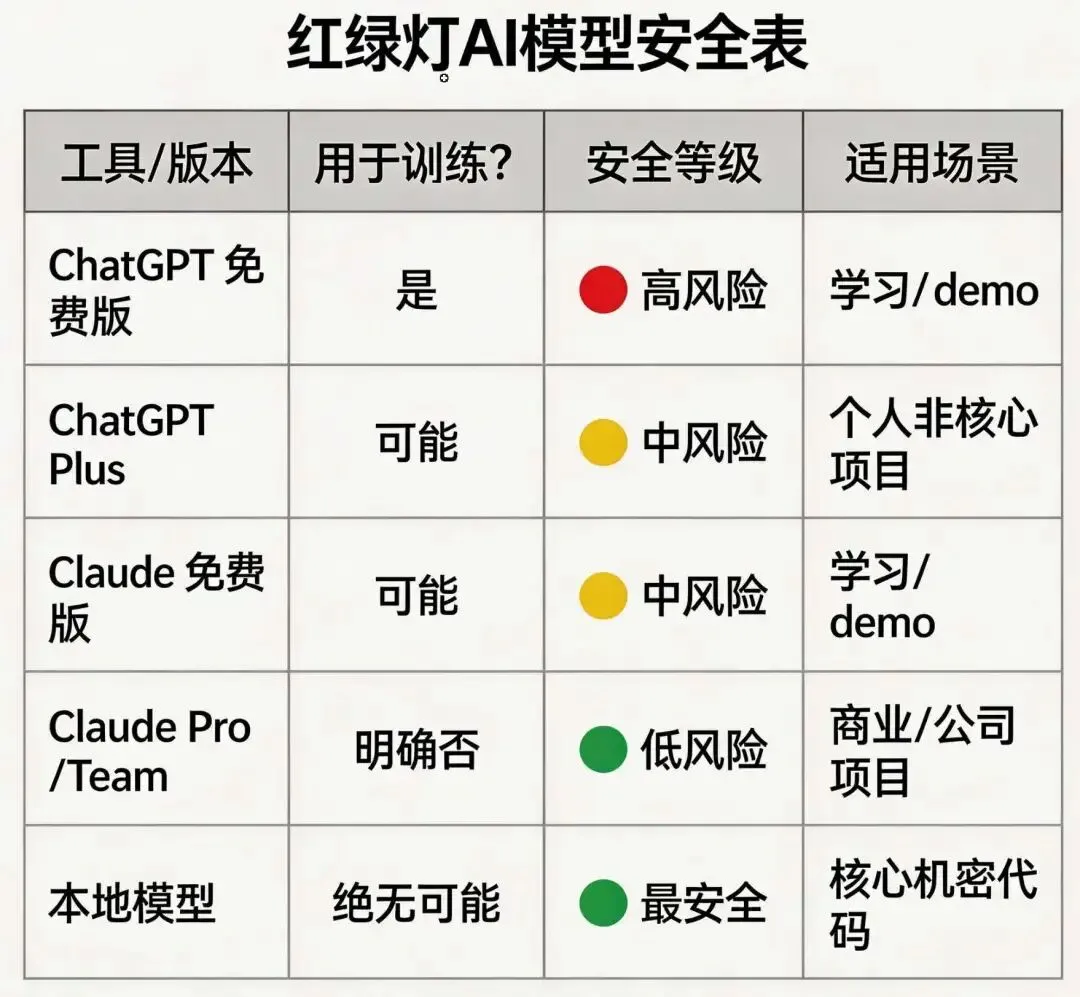

答案是:取决于你用哪个版本,以及怎么用。

我仔细研读了主流AI工具的服务条款,结论如下:

核心结论:

处理任何商业、敏感代码,请务必使用承诺“不用于训练”的企业版或专业版(如Claude Pro)。每月20美元,是保护知识产权的最低成本。

比”被记住”更可怕的5个隐形漏洞

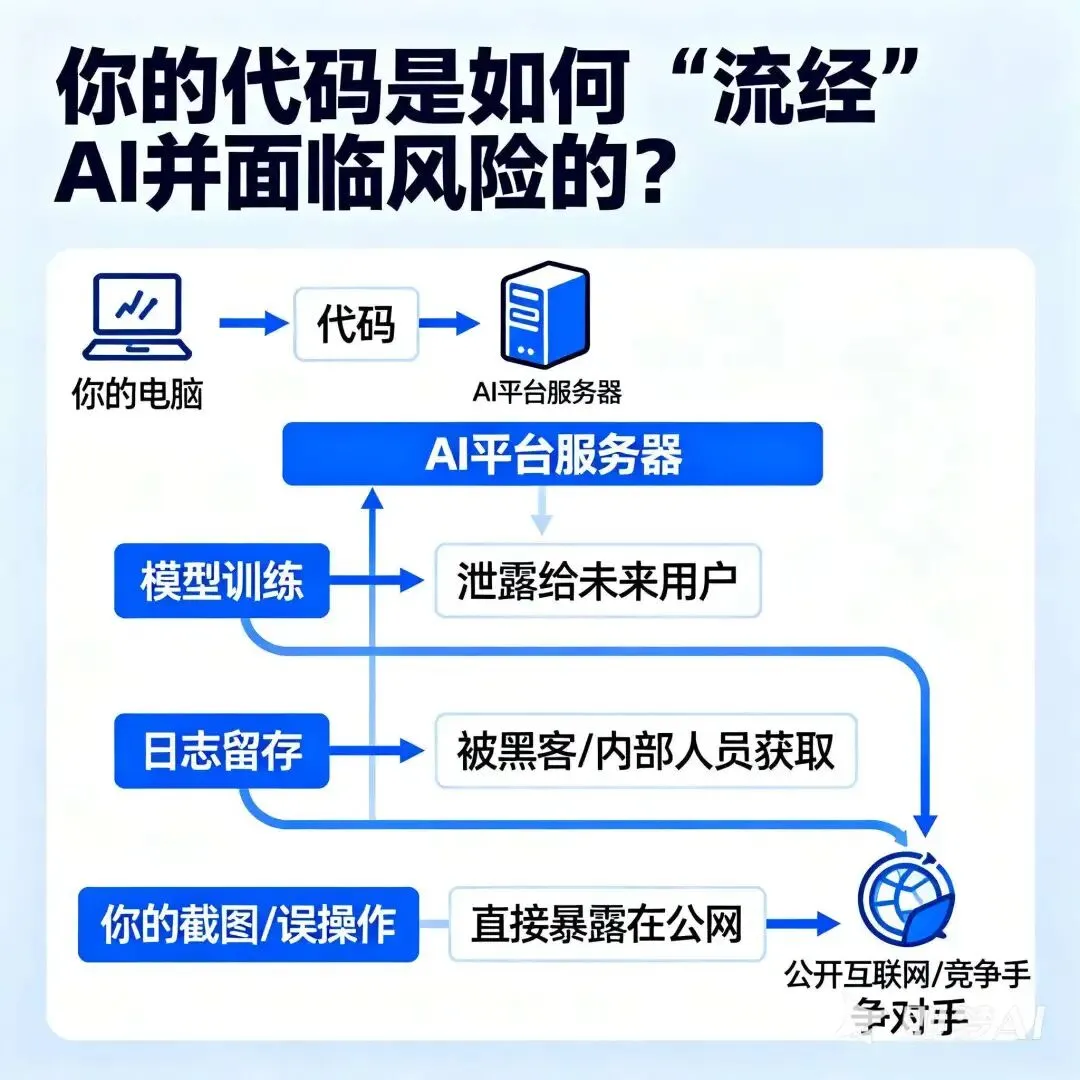

即使AI承诺不训练,风险也远未结束。这五大漏洞,每一个都可能让你“社死”。

1.【社死式泄露】截图分享

在社区炫耀“看,AI帮我解决了这个难题!”,结果截图中包含了内部API地址、密钥、业务逻辑。这是最高发、最直接的泄露。

2.【平台裸奔】日志与数据留存

你与AI的对话,会作为日志留在服务器。一旦平台被黑、内部违规、或配合法律调查,你的代码将暴露。

3.【AI钓鱼】提示词反向工程

攻击者通过精心设计提示词(如“写一个类似XX公司风控系统的代码”),可能诱导AI“回忆”并输出从你那里学到的模式。

4.【内部鬼】员工恶意使用

离职员工用公司代码训练私人模型;或竞对员工将你的核心逻辑喂给AI进行分析模仿。防不胜防。

5.【慢性死亡】去独特化

当所有开发者都用AI写相似代码,你的技术优势将迅速被抹平。算法从“独门秘籍”变成“公开的秘密”。

实战指南:2026年开发者AI安全自查清单

说了这么多风险,不是让你不用AI,而是教你安全地用AI。

1. 选择合适的工具版本

第一原则:商业代码用不会训练的版本

根据你的情况选择:

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

| 个人副业 | Claude Pro | $20/月 | 承诺不训练 |

| 公司代码 | Claude Team | $25/人/月 | 团队管理 |

| 核心机密 | 本地模型 | 免费 | 绝对安全 |

我的选择:

-

学习/测试:Claude免费版 -

个人项目:Claude Pro($20/月,值得) -

公司项目:推动老板买Claude Team -

核心算法:本地Ollama+CodeLlama

2. 脱敏再喂给AI(重要!)

错误示范:

"帮我优化这个支付逻辑:[paste包含公司名的真实代码]# CompanyX Payment Gateway v2.3# Author: zhangsan@companyx.comdef process_payment(user_id, amount): api_key = "sk_live_51M..." # Stripe密钥 ...正确做法:

"帮我优化一个通用支付逻辑:[paste重命名、去敏感信息的代码]def process_payment(user_id, amount): # TODO: 替换为真实API密钥 api_key = "YOUR_API_KEY_HERE" ...脱敏清单:

-

✅ 变量名重命名(user → customer) -

✅ 删除公司信息(注释、函数名) -

✅ 删除硬编码密钥(API Key、密码) -

✅ 删除IP地址和域名 -

✅ 抽象业务逻辑(保留算法,隐藏业务)

3. 使用本地模型(最安全)

如果你真的担心,或者处理核心机密:

推荐方案:

-

工具:Ollama -

模型:CodeLlama 34b / DeepSeek-Coder -

成本:免费(需要好的显卡)

我的建议: 普通项目用Claude,核心机密用本地模型。

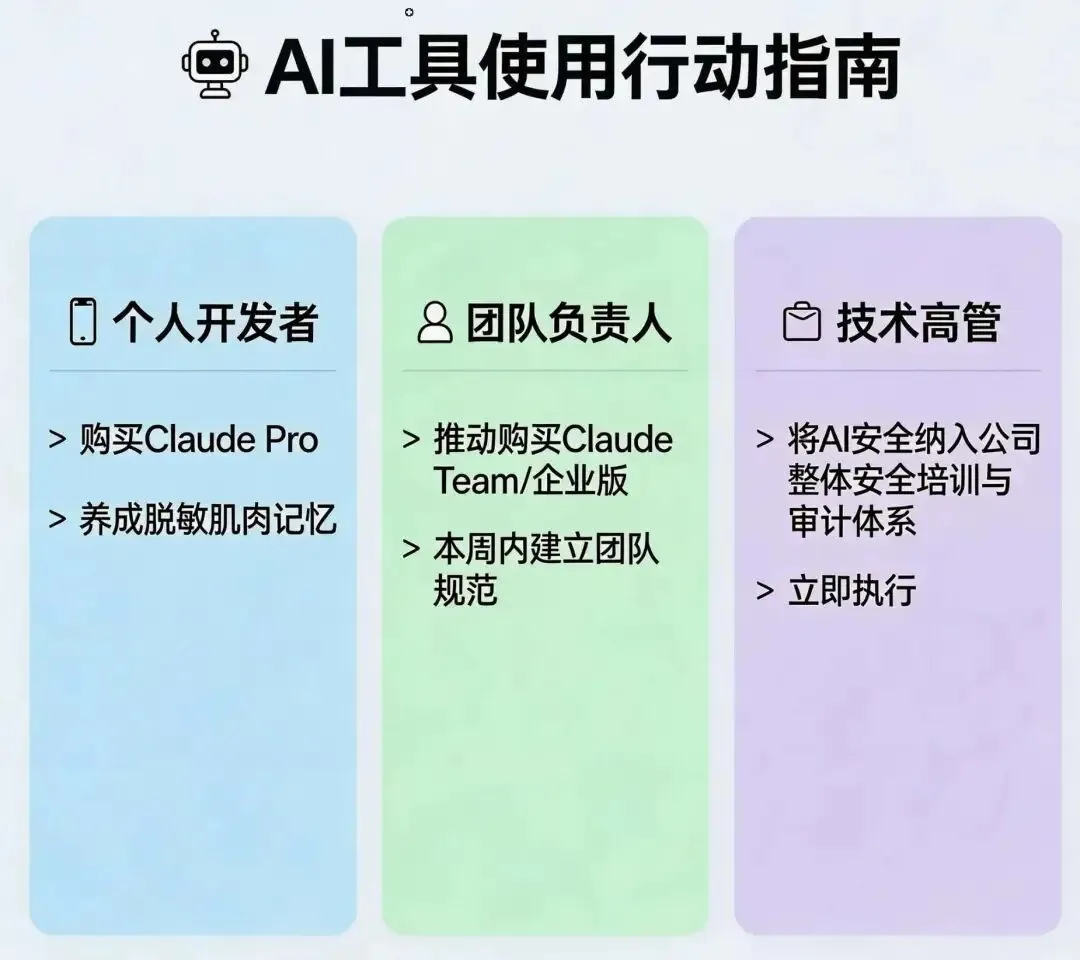

4. 建立团队规范(公司必做)

如果你是技术Leader,必须建立这些规范:

AI工具使用规范

-

✅ 明确允许使用的AI工具(统一管理) -

✅ 明确哪些代码可以用AI -

✅ 禁止外部AI处理敏感数据 -

✅ AI生成的代码必须Code Review

提示词管理规范

-

✅ 敏感项目必须脱敏 -

✅ 禁止截图外发 -

✅ 记录AI使用日志

审计流程

-

✅ 定期检查AI对话记录 -

✅ 监控异常数据流出 -

✅ 员工离职时审计AI使用

这跟防火墙、VPN一样重要。

给所有技术决策者的终极建议

如果你团队的代码有价值,那么AI安全就是2026年企业安全的必选项,而不是可选项。

AI不会取代程序员,但不懂AI安全的程序员和团队,一定会被时代淘汰。这不是危言耸听,这是正在发生的现实。

写在最后Claude Code事件不是让我们因噎废食,放弃AI这个强大的杠杆。相反,它是一记警钟,让我们必须学会安全地与之共舞。

如果这篇文章对你有帮助,点赞、在看、转发,让更多需要它的开发者看到。

夜雨聆风

夜雨聆风