AI诈骗,正在围猎每一个人

向阳而生

追光

心有暖阳,日常不慌

先讲一个真实的事。

某科技公司的财务总监老张,收到老板的微信语音:“我在谈一个紧急项目,你马上往这个账户转200万,合同回头补。”

声音是老板的,连说话带点沙哑的尾音都一样。老张没多想,准备转账。就在操作前最后一刻,他鬼使神差拨通了老板的电话。

老板说:“我什么时候让你转账了?”

老张后背一阵发凉。后来才知道,那条语音是AI合成的——骗子不知道从哪儿搞到了老板几秒钟的语音素材,克隆出了足以乱真的声音。

这不是段子。这是2025年发生在广东的一起真实案件,类似的案子在全国已经数不胜数。

很多人以为AI诈骗就是“冒充孙子骗老人”。错了。它正在围猎每一个人——你、你爸妈、你老板、你孩子,谁都有可能中招。

—01—

先看几组数据,看完别眨眼。

公安部披露,2025年上半年全国电信网络诈骗涉案金额超百亿元。其中,利用AI换脸、拟声技术实施的诈骗案件,一季度环比激增45%。

更让人心惊的是受害人群的变化。

过去,被骗的大多是老年人。现在呢?某反诈中心的数据显示,AI诈骗的受害者中,18-40岁的年轻人占了近六成。

你没看错。年轻人比老年人更容易上当。

为什么?因为年轻人更依赖网络社交,更习惯语音、视频沟通,也更相信“眼见为实”。而AI最擅长的,就是制造“真实的假象”。

—02—

AI诈骗到底有多可怕?我跟你讲三个案例,分别对应三类人。

**第一类:职场人。**

上面那个财务总监老张,不是个例。2025年,香港一家跨国公司被AI换脸技术骗走了2亿港币。骗子伪造了总部CFO的面容和声音,在视频会议里下达转账指令,参会的财务人员全程没看出破绽。

你以为你够谨慎?当你在视频里亲眼看到“老板”的脸、亲耳听到“老板”的声音,你还会怀疑吗?

**第二类:年轻人。**

杭州的小王,在社交软件上认识了一个“美女”。对方主动视频聊天,画面里确实是个漂亮姑娘。聊了几天,对方发来一段不雅视频——是小王的脸,被AI换脸合成到了色情片里。

对方威胁:不给钱,就把视频发给你所有亲友。

小王报了警。警察告诉他,那个“美女”从头到尾都是AI生成的,声音、长相全是假的。

**第三类:老人。**

湖北黄石,70多岁的丁婆婆接到“孙子”电话,带着哭腔说把人打伤了,要4万块私了。声音一模一样,连叫“奶奶”的语气都分毫不差。丁婆婆取了钱,被上门取钱的骗子拿走。

直到晚上真孙子回家,她才明白被骗了。

这三个案例说明一件事:AI诈骗不挑年龄,不挑职业,它只挑人性的弱点——怕、爱、贪。

—03—

为什么AI诈骗这么难防?

两个原因。

**第一,技术门槛太低了。**

克隆一个人的声音需要什么?几秒钟的语音素材。你发在家族群里的一条语音、发在朋友圈的一个视频,甚至接了一个骚扰电话说了一句“喂”,都可能被骗子录下来。

网上有教程,几十块钱、几分钟,就能训练出一个声音模型。

换脸更简单。一张照片就够了。你社交媒体上的自拍、全家福,都是骗子的素材库。

**第二,骗子会“定制剧本”。**

以前的诈骗是广撒网,“你猜我是谁”。现在的AI诈骗,是为你量身定做的。

骗子先通过非法渠道摸清你的底:你是谁、做什么工作、家里有几口人、老板是谁、孩子在哪上学。然后根据这些信息,编一个让你不得不信的剧本。

你是个财务,就冒充你老板。你是个宝妈,就冒充你孩子的老师。你是个独居老人,就冒充你在外地的孙子。

不是你不小心,是骗子太“懂”你了。

—04—

那怎么办?

别急,我不是要给你上一堂反诈课。我只说三条最实用的,你记住就行。

**第一条:凡是涉及钱,挂断、回拨。**

不管对方是谁,不管多紧急,不管声音多像——挂掉电话,用你存的那个号码回拨过去。真有事,不差这一分钟。

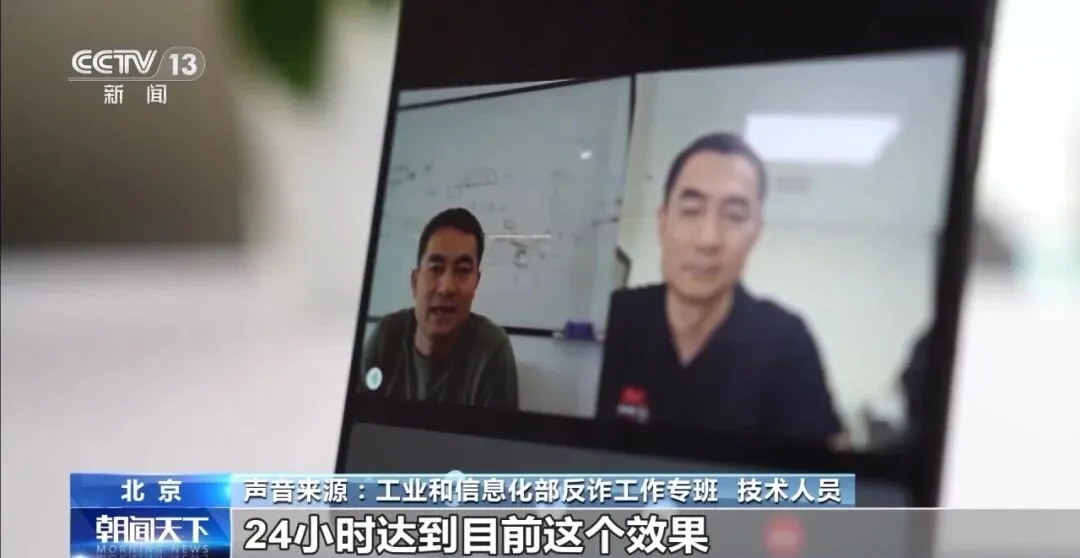

**第二条:视频通话也不可信。**

让对方向左转头、眨眨眼、用手指在脸前晃一下。目前的技术,这些动作AI还做不自然。如果对方找借口不做,大概率有问题。

**第三条:管好自己的“声音”和“脸”。**

不随便在社交平台发高清正脸照、不发清晰的语音消息。关掉那些“允许陌生人下载视频”的权限。你少发一条语音,骗子就少一份素材。

—05—

写到这里,想起一个反诈民警说过的话:

“以前我们告诉老人,别信陌生电话。现在我们要告诉所有人,别信你看到的、听到的。”

技术跑得太快了,法律和防范意识都追不上。

但有一件事永远不会变:骗子可以克隆你的声音,但克隆不了你的警惕。

你多留一个心眼,骗子就多一分失败的可能。

转发这篇文章给你关心的人吧。不是吓他们,是提醒他们。

毕竟,在这个AI什么都能造假的年代,信任,成了最奢侈的东西。

END

夜雨聆风

夜雨聆风