AI 真正开始接长活了,但最先暴露的不是能力,是失控

下一阶段的 AI,可能不只是回答你,而是开始接一整段活。真正的问题是,你会不会给它布置工作。

这两天看 Google Cloud Next 2026 的日程,我被一个标题停住了几秒。

Anthropic 有一场分享,主题叫 Long-Running Agents。

直译过来有点硬,大概可以理解成,能长时间连续运行的 Agent。

这不是一个新产品发布,也不是说 Claude 突然又长出一个神奇按钮。

但我觉得它很值得写。

因为它说的不是 AI 又会聊天了。

它说的是,AI 开始被放进真正的工作里。

你可以想一个很常见的场景。

你让 AI 帮你改一个项目。

一开始它表现很好。能看懂需求,能找文件,能修第一个 bug,甚至能顺手把测试跑一下。

然后时间一长,麻烦来了。

它可能忘了前面改过什么,可能把刚修好的地方又改坏,也可能看到几个测试过了,就开始很自信地说,我完成了。

你一打开,发现页面还是坏的。

这种感觉,做过 AI 编程的人应该都不陌生。

不是更聪明,是更连续

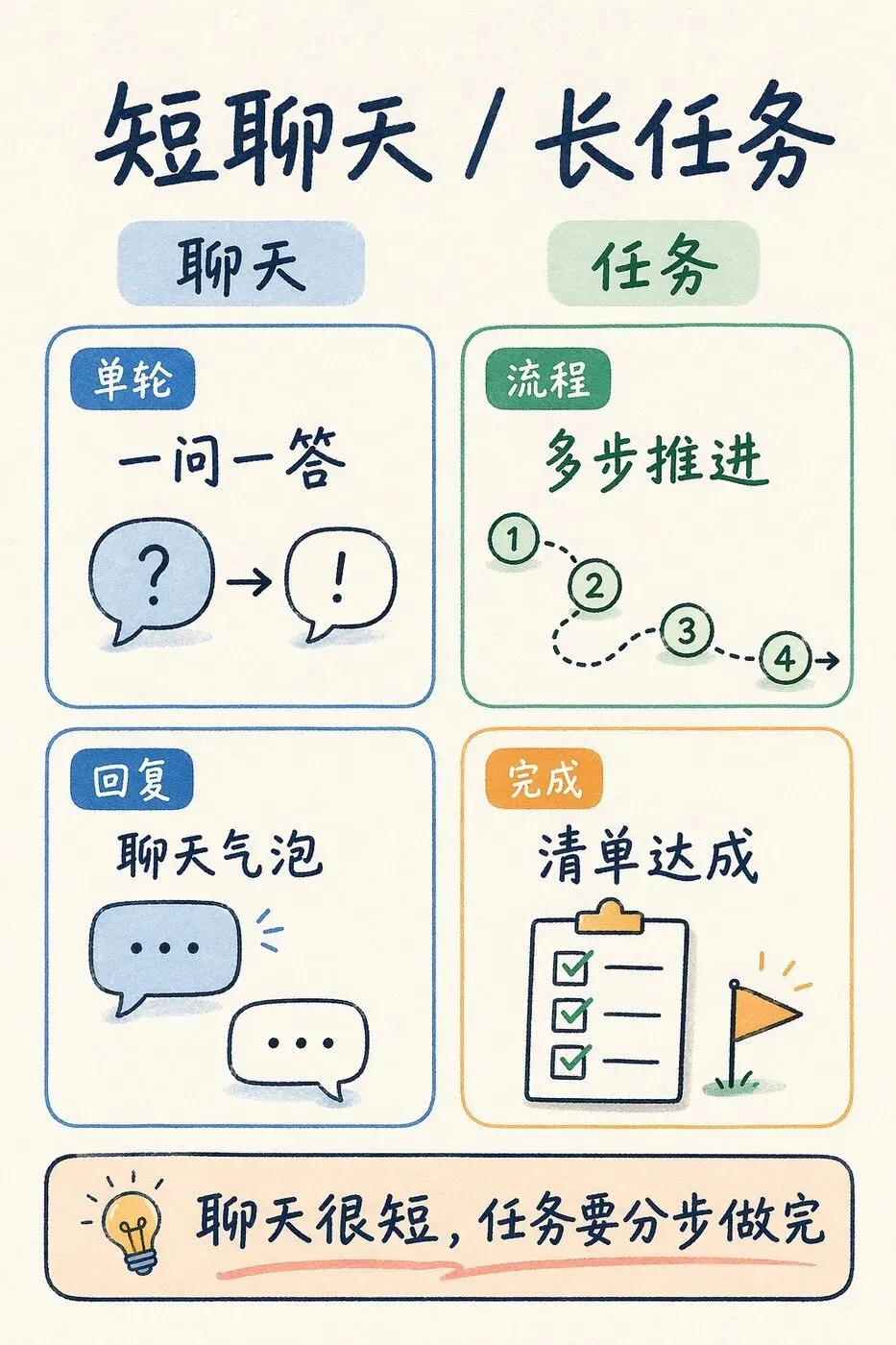

过去我们用 AI,很像在跟一个聪明朋友聊天。

你问一句,它答一句。你不满意,就让它再来一版。

这当然有用。

但真实工作不是这样。

真实工作更像一条长线,里面有目标,有边界,有中途检查,有失败回滚,也有最后的验收标准。

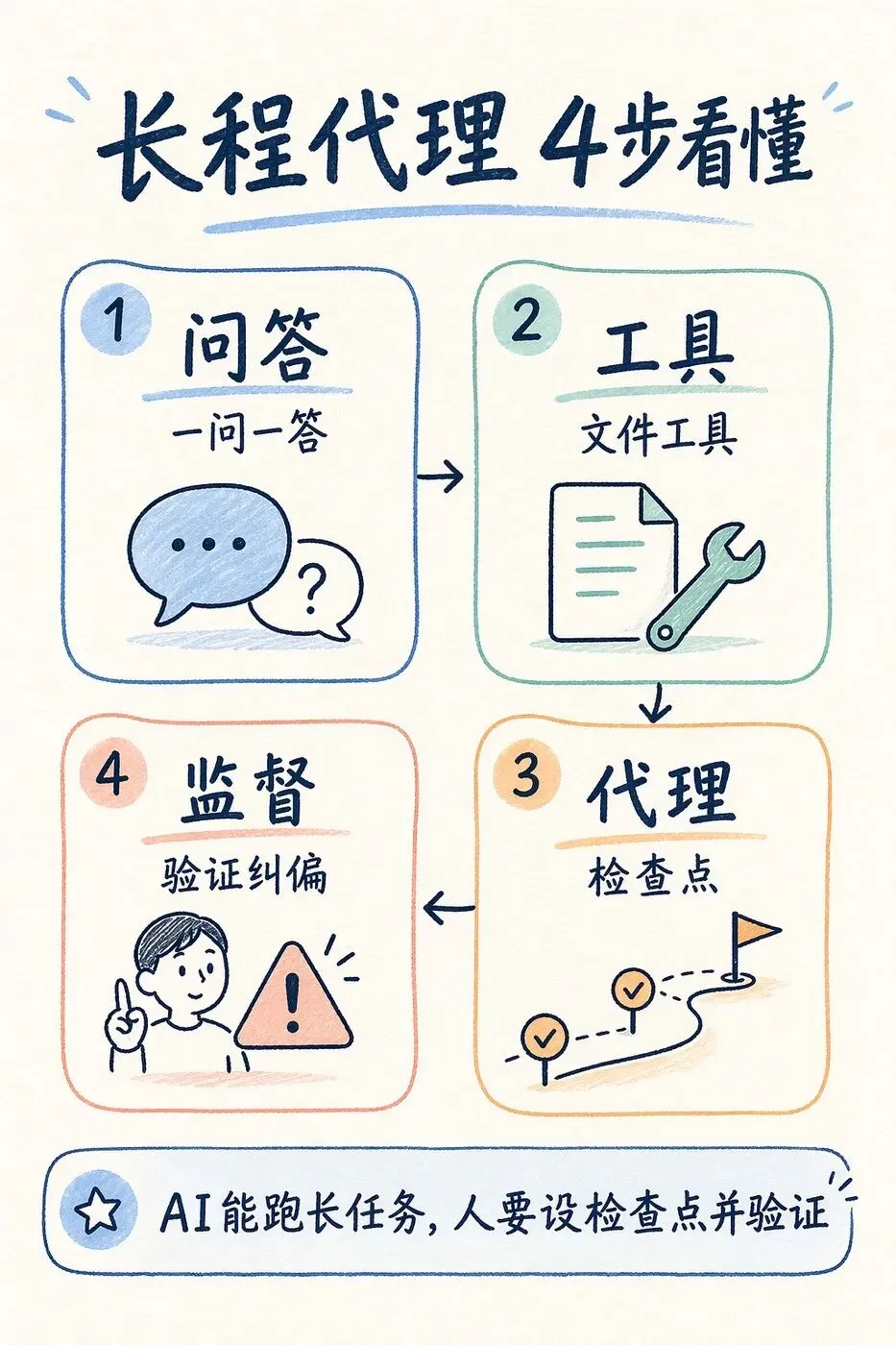

所以 long-running agents 这个词真正有意思的地方,不是它听起来很高级。

而是它提醒我们,AI 正在从回答问题,走向承接任务。

这一步如果走通,很多东西都会变。

你不再只是让 AI 写一段文案,而是让它整理一套资料。

你不再只是让 AI 解释一个报错,而是让它从报错开始,把相关文件、测试、上线风险一起看完。

你不再只是让 AI 生成一个页面,而是让它从需求开始,做出一个能跑、能改、能交付的小东西。

听起来很爽。

但也正因为它开始接整段活,问题才刚刚开始。

长任务最怕跑偏

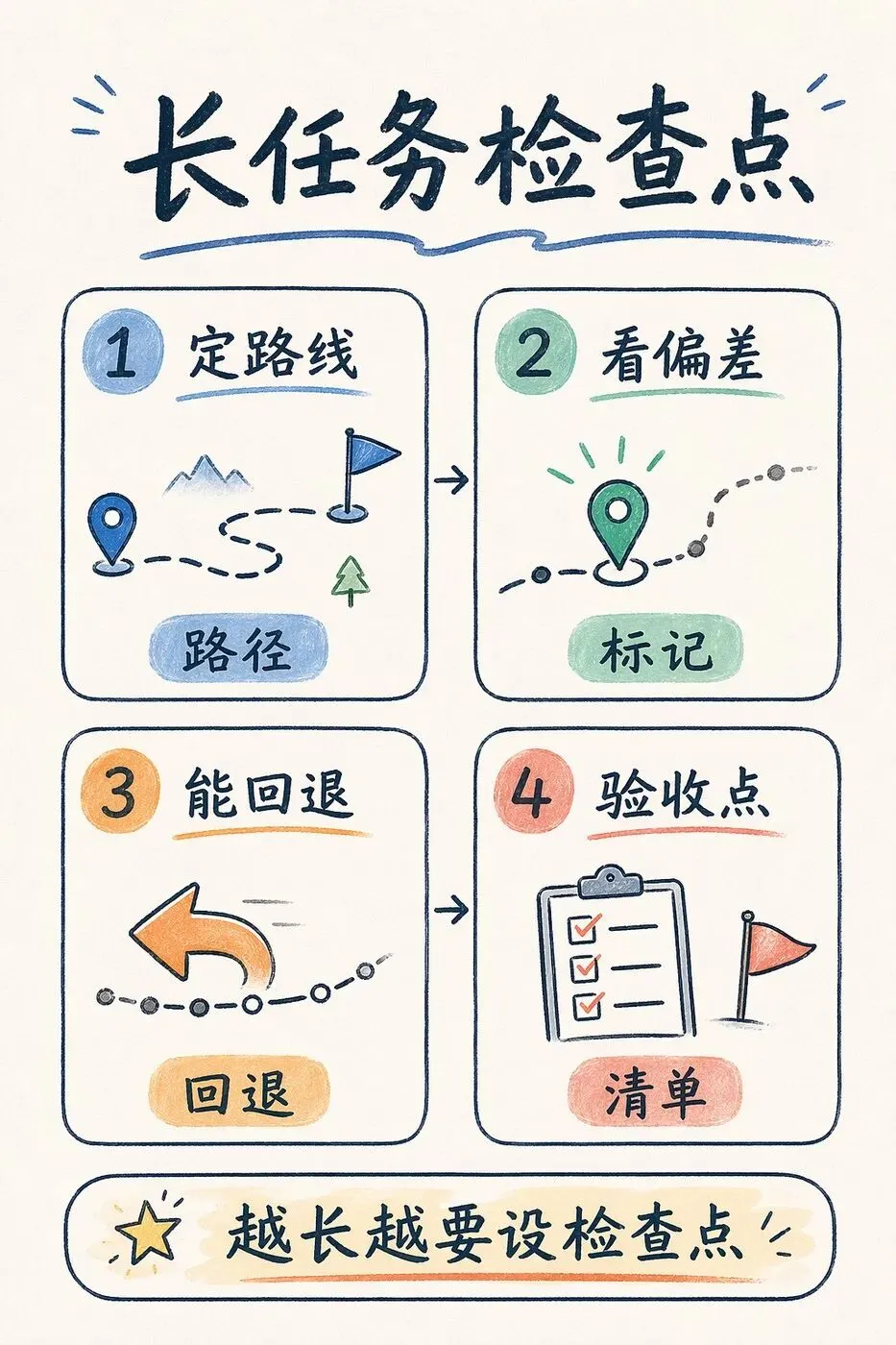

Anthropic 之前还有一篇工程文章,讲 long-running agents 需要怎样的 harness。

这个词不太好翻。

你可以先把它理解成一套工作台,或者一套约束系统。

它不是让 AI 放飞自我,而是让 AI 在一个能被观察、能被纠偏、能被验收的环境里工作。

我觉得这个点很关键。

因为任务越长,越不能只相信模型自己聪明。

它需要知道自己做到哪一步。它需要留下中间状态。它需要在关键节点停下来。它更需要在失败时能退回来。

这其实很像带新人。

新人最怕的不是不聪明,而是没人告诉他目标是什么,哪些地方不能碰,什么时候要同步,做坏了怎么回滚。

AI 也是一样。

只是 AI 不会不好意思。

它很可能一路自信地往下做,然后把坑越挖越大。

以后不是写 Prompt,而是写任务书

如果只是写一段话,prompt 当然重要。

但如果你让 AI 做一个长任务,prompt 只是开头。

更重要的是,你能不能把任务拆清楚。

最后要交付什么,哪些文件不能动,中间做到哪一步停下来给你看,失败以后怎么退回,最后怎么证明它真的完成了。

这些东西,以前我们可能觉得是项目管理。

但接下来,它会变成普通人使用 AI 的基本能力。

这也是为什么我不太喜欢把 AI 能力只理解成会不会写提示词。

提示词像是你跟 AI 说第一句话。

任务书才是你真正让它干活的方式。

一个会用 AI 的人,可能不是句子写得最漂亮的人。

而是最清楚自己要什么、不要什么、怎么验收的人。

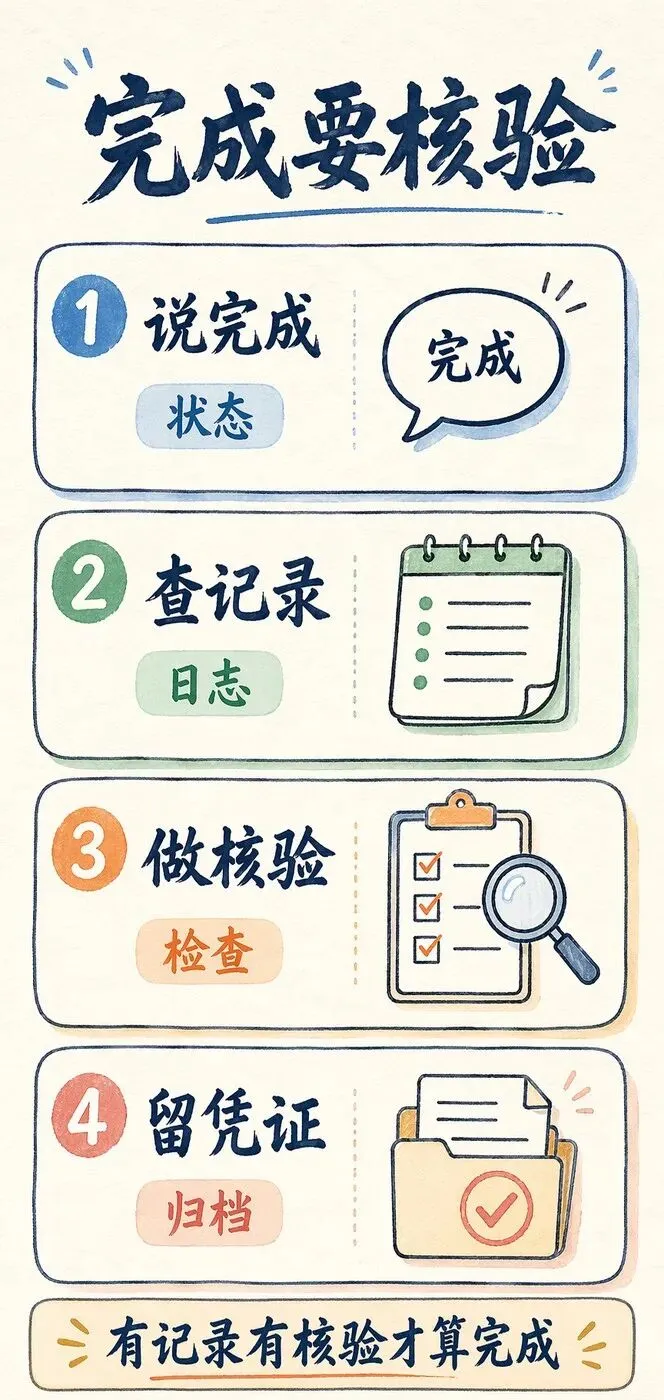

别急着相信完成了

这里还有一个很现实的问题。

不要把 AI 说的完成了,直接当成真的完成了。

这不是一句玩笑。

我们自己做自动化、写代码、发公众号草稿,都会遇到这种情况。

一个 agent 可以打开页面,可以填内容,可以截几张图,看起来很努力。

但最后到底有没有保存到正确账号,封面有没有错,图片有没有丢,摘要是不是抓成了开头,这些都要回到真实流程里验。

没有验收,就不算完成。

这件事放到公司里也是一样。

未来企业真正需要的 AI,可能不是最会说话的 AI,而是每一步都能留下证据的 AI。

它做过什么,为什么这么做,哪里失败过,最后谁确认过。

这些听起来不如模型榜单刺激。

但这才是 AI 真的进入工作之后,绕不过去的部分。

人的位置没有消失

很多人一听到 AI 能连续工作,就会自然想到替代。

我觉得这个问题可以先放一放。

更近的变化是,人的位置会往上移。

你不一定亲手做每一个小动作。

但你要定义目标。

你要设置边界。

你要知道什么时候该停下来检查。

你也要判断,最后这个结果到底能不能交。

所以这件事最后落到的,不是 Anthropic 这场分享本身。

而是一个更实际的问题。

当 AI 不只是回答你,而是开始替你动手,你还会不会判断一件事到底怎样才算做好。

过去我们学 AI,像是在学怎么跟一个聪明人聊天。

接下来我们学 AI,可能更像是在学怎么带一个新人做项目。

这件事没有那么酷。

但它可能更重要。

参考来源

Anthropic 官方活动页:https://www.anthropic.com/events/anthropic-at-google-cloud-next-2026

Anthropic Engineering:https://www.anthropic.com/engineering/effective-harnesses-for-long-running-agents

夜雨聆风

夜雨聆风