AI Agent与上下文工程(四): Agentic Context Engineering

大多数人都是高估自己一天可以做的事情,但是低估了自己一年可以做的事情

AI Agent与上下文工程(四): Agentic Context Engineering

作者:xyiz

原文:https://zhuanlan.zhihu.com/p/2029282815401891569

Agentic Context Engineering的核心理念是:从人工干预的、静态的 Prompt 编写,走向具备自我进化、自我纠错能力的 Agentic 上下文管理。

在Agentic Context Engineering的观点中,Agent 的上下文不再是一个需要人类从外部精心打理的“静态容器”,而是一个能够由 Agent 自身在执行任务中不断反思、总结、提炼并主动更新的“生命体”。本文将列举当前学术界与工业界在 Agentic Context Engineering 领域的一些最新进展。

让上下文压缩更加 agentic

摘要压缩的陷阱:Context Collapse

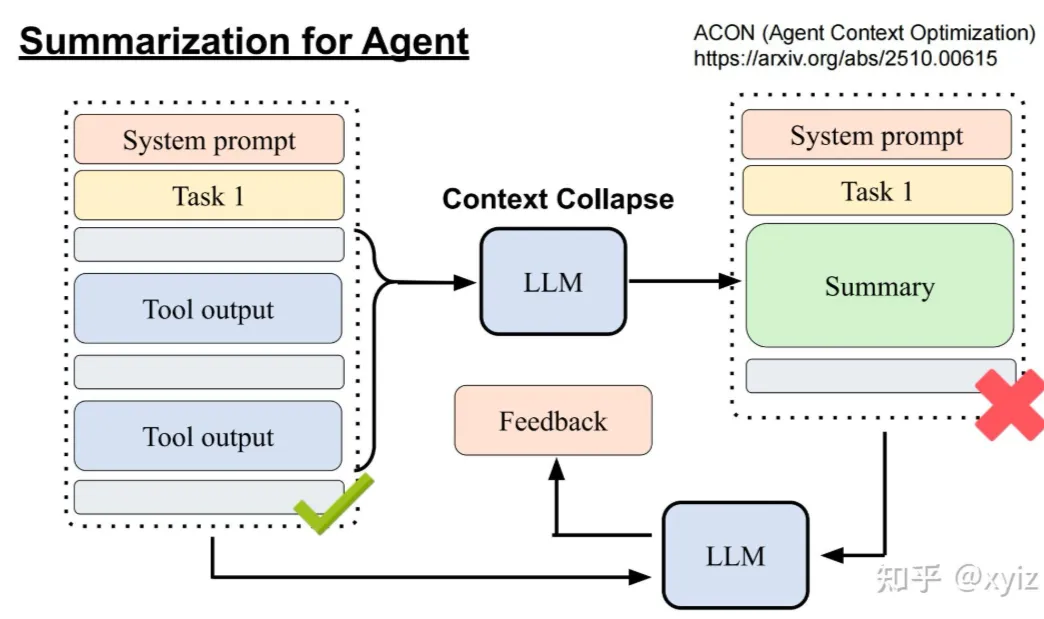

在上一篇文章AI Agent与上下文工程(三): 上下文压缩方法中,我们提到过利用大语言模型(LLM)自身的理解能力,将过去冗长的历史记录“总结”成精简的摘要。然而,基于LLM的摘要式压缩并不是万能的。在实际的Agent任务中,简单的总结往往会导致致命的信息丢失。很多研究中指出,如果在Agent运行中仅仅使用普通的 Prompt 让 LLM 去做总结,反而会导致 “上下文坍塌(Context Collapse)”,也就是在不断的迭代重写中,之前的某些长尾领域知识会被灾难性遗忘,Agent 的任务成功率会显著下降。

因为在真实且复杂的 API 交互或代码执行中,有些信息是绝对不能被总结掉的。例如:

-

凭证变量(Credential variables) -

Token 状态(Token state) -

身份验证要求(Authentication requirements)

一旦LLM在写摘要时“自作聪明”地把这些长得像乱码的 Token 或繁琐的系统规则给省略了,Agent 在下一步调用 API 时就会直接报错。

ACON: OPTIMIZING CONTEXT COMPRESSION FOR LONG-HORIZON LLM AGENTS

ACON: OPTIMIZING CONTEXT COMPRESSION FOR LONG-HORIZON LLM AGENTS

原文:https://arxiv.org/abs/2510.00615

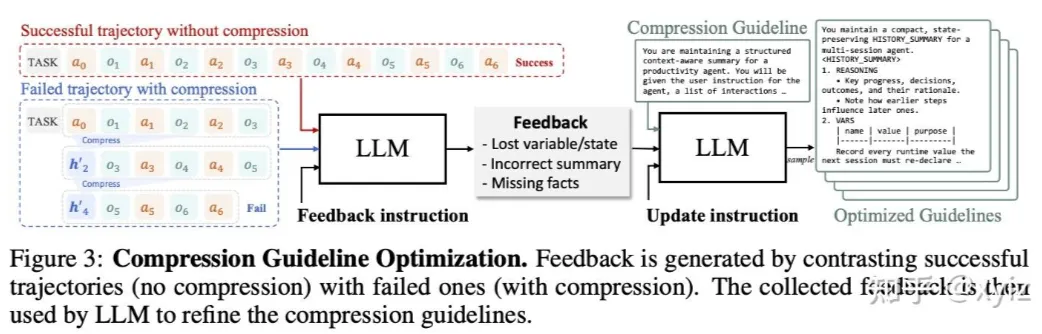

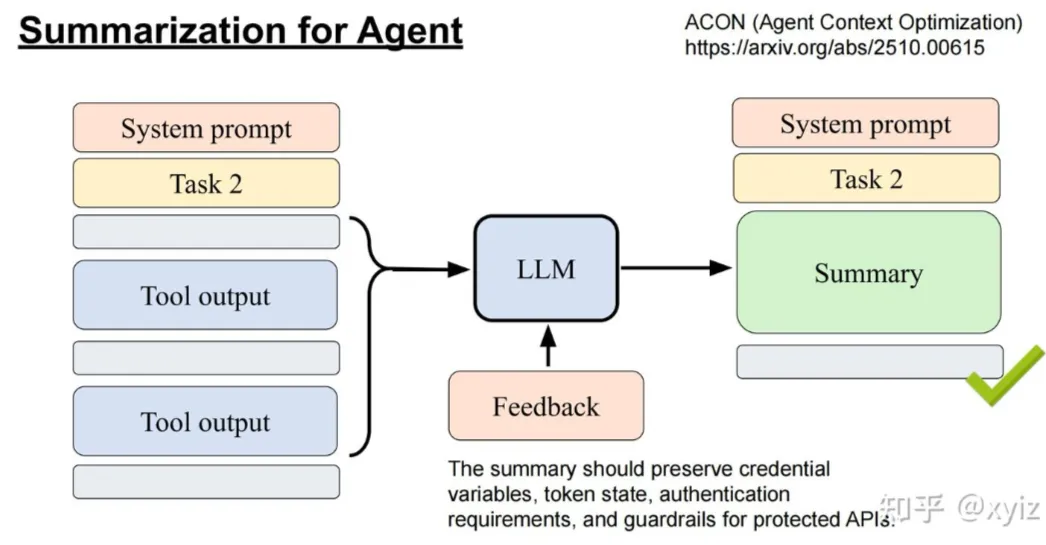

ACON: OPTIMIZING CONTEXT COMPRESSION FOR LONG-HORIZON LLM AGENTS这篇论文中提出的ACON框架,其思路是,不能仅凭LLM单方面去做总结,而是要引入环境反馈(Feedback)。当压缩后的上下文导致任务失败时,系统会将失败的反馈传回,指导LLM学习“哪些关键信息(如凭证、状态)必须在摘要中被保留”:

ACON框架分为如下几步:

-

收集对比轨迹(Contrastive Trajectories):系统首先让Agent在“完整上下文”下运行一次(通常能成功),再在“朴素压缩上下文”下运行一次(导致任务失败)。 -

失败原因分析(Failure Analysis):引入一个强大的评判LLM(如 GPT-4)去对比这两条轨迹,分析“为什么完整上下文成功了,而压缩后却失败了?”。LLM 会敏锐地发现那些被粗暴摘要掉、但对任务至关重要的信息(例如:“在第三步压缩时,丢失了用于身份验证的 Session Token”)。 -

更新压缩指南(Guideline Optimization):基于上述失败分析,LLM 会在自然语言空间中更新并优化“压缩指南(Compression Guidelines)”。比如在指南中动态增加一条硬性规则:“在总结交互历史时,切勿省略带有凭据属性的字符串或系统环境状态,必须原样保留”。

上述过程也可以简化为如下两张流程图。第1、2步:

第3步:

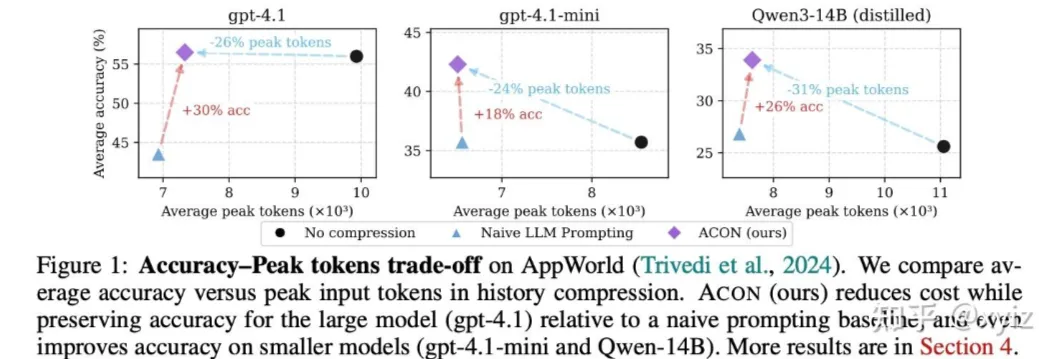

通过这种“试错-反馈-更新规则”的机制,基于 LLM 的摘要压缩就从“盲目的文本缩写”进化成了“任务导向的关键状态提取”,从而在缩减 26%-54% Token 消耗的同时,还能维持甚至提升 Agent 的任务成功率:

让 System Prompt / 全局指令更加 agentic

在传统的 Agent 开发中,System Prompt 是静态的“人设和操作手册”。一旦遇到 Agent 犯错,开发者就需要手动去修改 Prompt。那么,Agent 能否自己修改和进化自己的 System Prompt 呢?

Agentic Context Engineering: Evolving Contexts for Self-Improving Language Models

Agentic Context Engineering: Evolving Contexts for Self-Improving Language Models (arXiv:2510.04618)

原文:https://arxiv.org/abs/2510.04618

斯坦福大学等机构在 2025 年 10 月提出的这篇经典论文指出,如果直接让 LLM 去重写自己的 System Prompt,往往会陷入两个致命陷阱:

-

简洁性偏差(Brevity bias)(模型倾向于把 Prompt 越写越短,丢失关键细节) -

上下文坍塌(Context collapse)(在不断的迭代重写中,之前的某些长尾领域知识会被灾难性遗忘)。

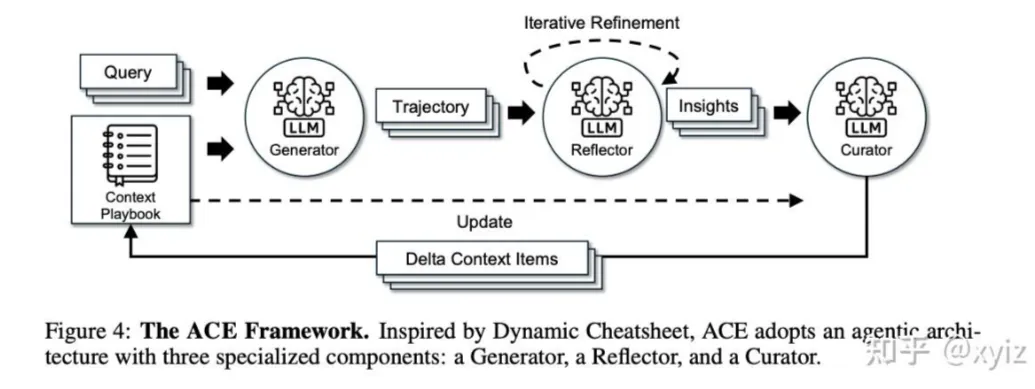

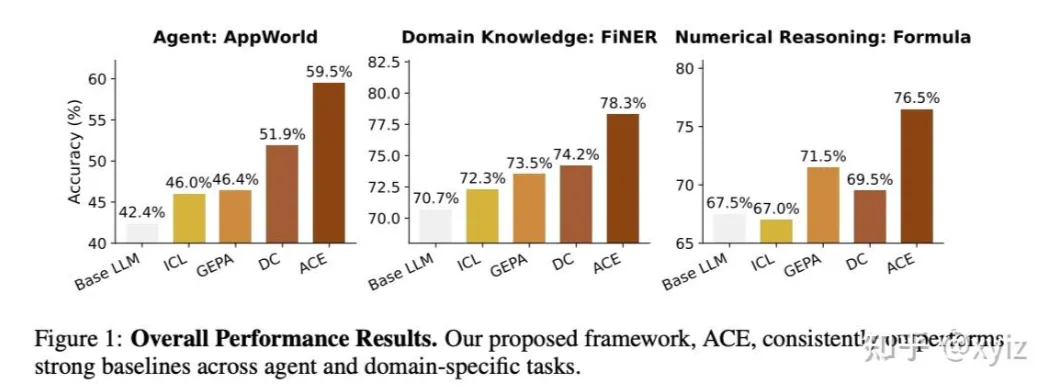

为了解决这一问题,该研究提出了 ACE(Agentic Context Engineering)框架。ACE 将上下文从单一的 Prompt 转化为一种动态的、结构化的 “Playbook”。它采用了一个模块化的流水线:首先由“Generator”在任务执行后产出新策略,接着由“Reflector”利用自然语言执行反馈(无需人类标注)进行评估,最后由“Curator”以增量的方式安全地将新策略合并到 Playbook 中,从而避免了信息的坍塌。

在没有监督微调(SFT)和梯度更新的情况下,ACE 在各类 Agent 基准测试中平均提升了 10.6% 的性能。

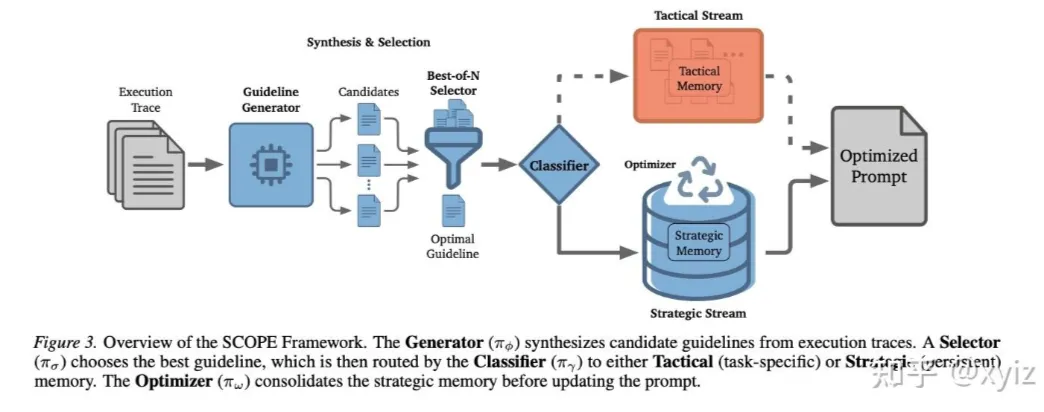

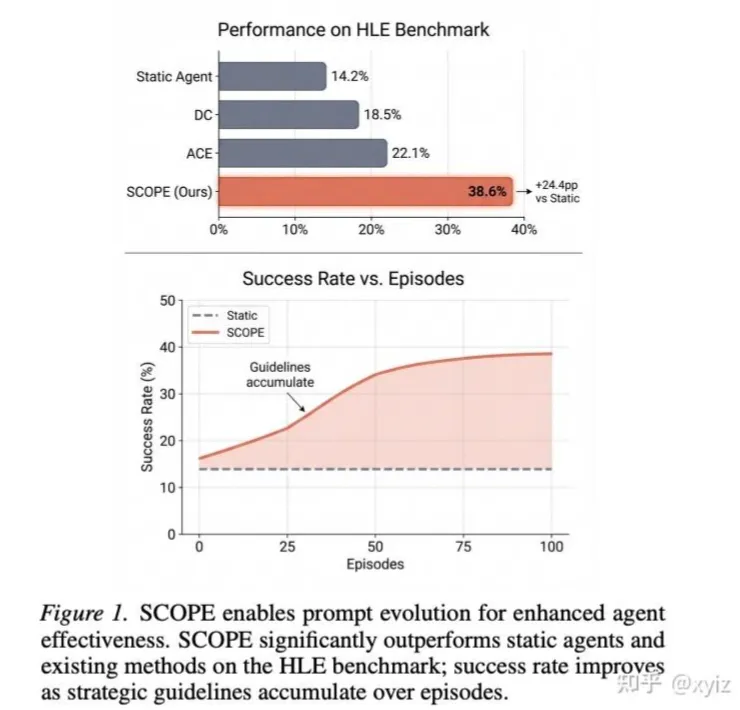

SCOPE: Prompt Evolution for Enhancing Agent Effectiveness

SCOPE: Prompt Evolution for Enhancing Agent Effectiveness (arXiv:2512.15374)

原文:https://arxiv.org/abs/2512.15374

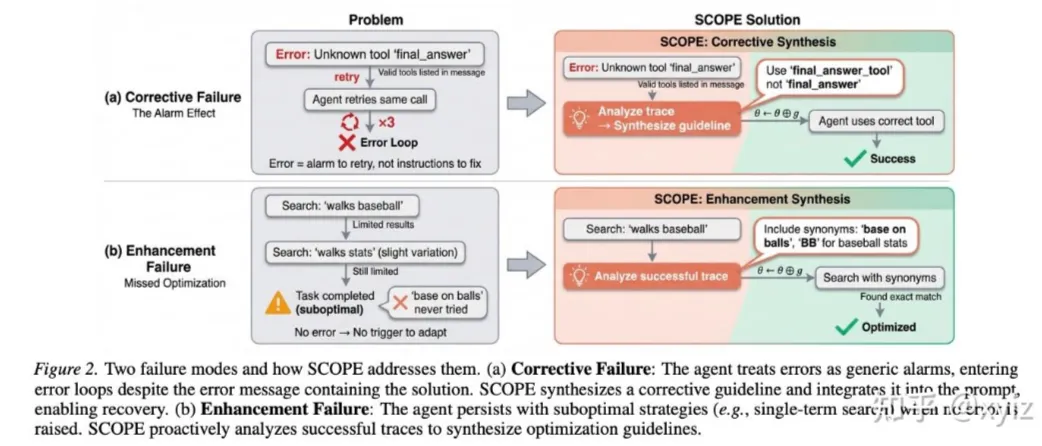

在复杂且动态的真实环境中,Agent 常常会陷入两种失败模式

-

纠正性失败(Corrective Failures):在遇到工具报错或环境障碍时,无法跳出死循环,无法解决眼前的即时错误。 -

增强性失败(Enhancement Failures):表现为次优的行为模式,如检索偏差、效率低下或上下文污染等。

为了解决这一问题,SCOPE 将上下文管理定义为一个在线优化问题,通过从智能体的“执行轨迹”中汲取经验并自动进化其提示词。

SCOPE 框架的完整工作流程,主要包含三个核心阶段:

-

合成与选择(Synthesis & Selection):系统首先以智能体过去的“执行轨迹(Execution Trace)”作为输入,通过“指导生成器(Generator, )”自动生成多条候选的指导原则。随后,“Best-of-N 选择器(Selector, )”从中进行优中选优,筛选出一条“最佳指导原则(Optimal Guideline)”。 -

双流路由分类(Routing):最佳原则接着会进入“分类器(Classifier, )”进行分流。如果是针对当前特定任务的短期经验,将被划入虚线所示的“战术流”,存入战术记忆(Tactical Memory);如果是具备持久性、通用价值的经验,则进入实线所示的“战略流”,存入战略记忆(Strategic Memory)。 -

优化与输出(Optimization & Output):为了防止长期规则堆积冗余,“优化器(Optimizer, )”会对战略记忆库进行动态的梳理与整合。最终,特定的战术记忆与提纯后的战略记忆强强联合,共同生成“优化后的提示词(Optimized Prompt)”,实现智能体的闭环进化。

实验表明,通过这种自动化的 Prompt 进化,SCOPE 在极具挑战性的 HLE 和 GAIA 基准测试中,无需任何人类干预,就将任务成功率分别从 14.23% 飙升至 38.64%,以及 32.73% 飙升至 56.97%。

让记忆与经验更加 agentic

这类改进的核心思路是:与其每次都把所有的历史记录塞满 Context,不如让 Agent 自主将经验提炼为浓缩的“记忆库”。

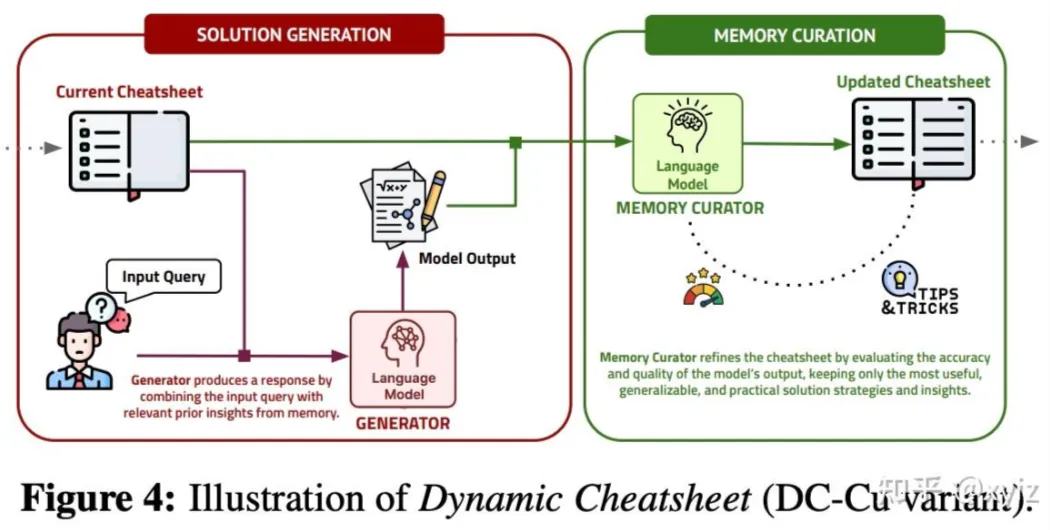

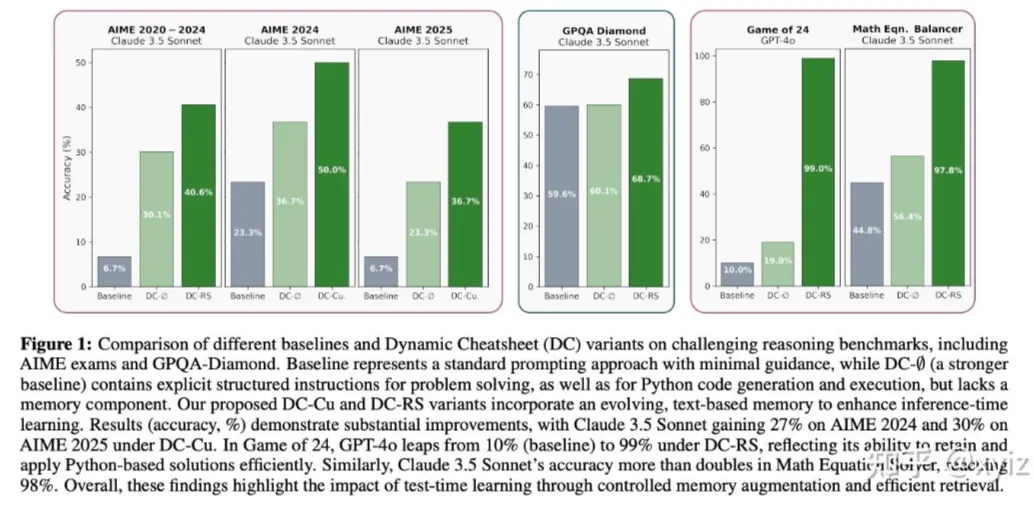

Dynamic Cheatsheet: Test-Time Learning with Adaptive Memory

Dynamic Cheatsheet: Test-Time Learning with Adaptive Memory (arXiv:2504.07952)

原文:https://arxiv.org/abs/2504.07952

这篇论文提出了一种极其轻量级的框架——Dynamic Cheatsheet(DC)。它赋予了黑盒大模型在推理时不断进化的外挂记忆。DC 不记录冗长的原始对话,而是设立了一个后台“Curator”模块,在 Agent 完成一轮推理后,主动评估其方案的正确性与泛化性,提炼出极其简练的“启发式规则、代码片段或解题思路”,并将其记录在 Cheatsheet 上。Agent 在后续任务中可以随时复用这些策略。

这种测试时学习极大地提升了模型的性能。在接入 DC 后,Claude 3.5 Sonnet 在 AIME 数学竞赛上的准确率直接翻倍(从 23% 提升至 50%);而 GPT-4o 在“24点游戏”上的成功率更是从 10% 飙升至近乎完美的 99%。

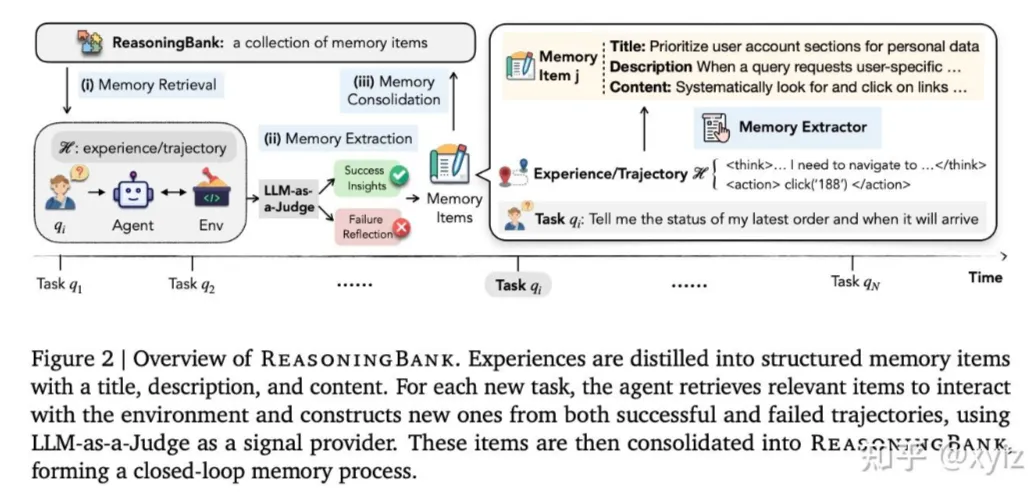

ReasoningBank: Scaling Agent Self-Evolving with Reasoning Memory

ReasoningBank: Scaling Agent Self-Evolving with Reasoning Memory (arXiv:2509.25140)

原文:https://arxiv.org/abs/2509.25140

在记录经验时,Agent 往往存在“幸存者偏差”,即只把成功走通的路径记录下来。然而,在真实的试错过程中,失败的教训往往比成功的经验更具指导价值。此外,被动地等待任务来积累经验效率太低。

Google Research 提出的 ReasoningBank 不仅从成功的经验中提取规律,更强制从 自我评判的失败经验 中提炼泛化性推理策略:

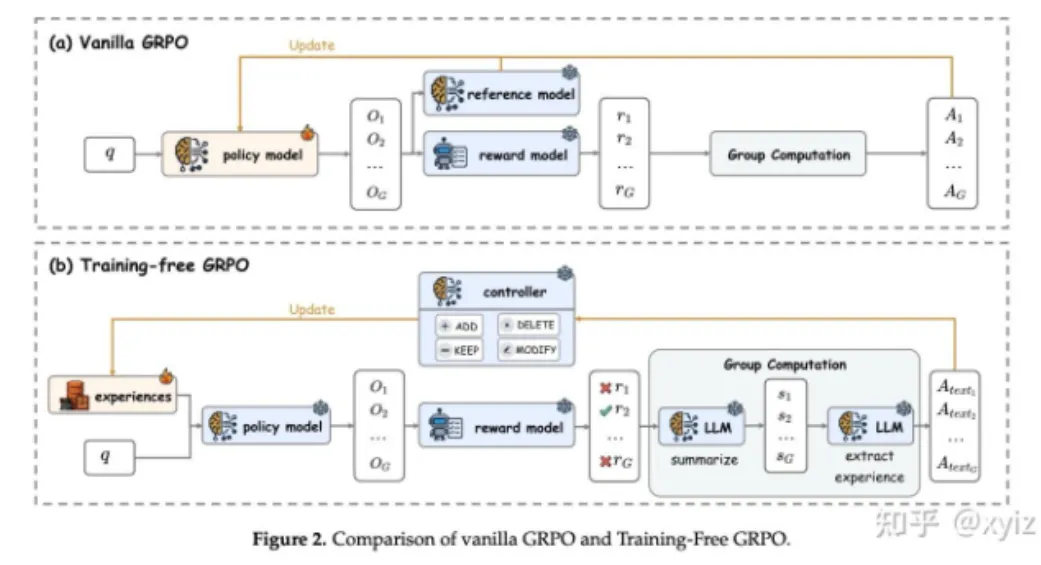

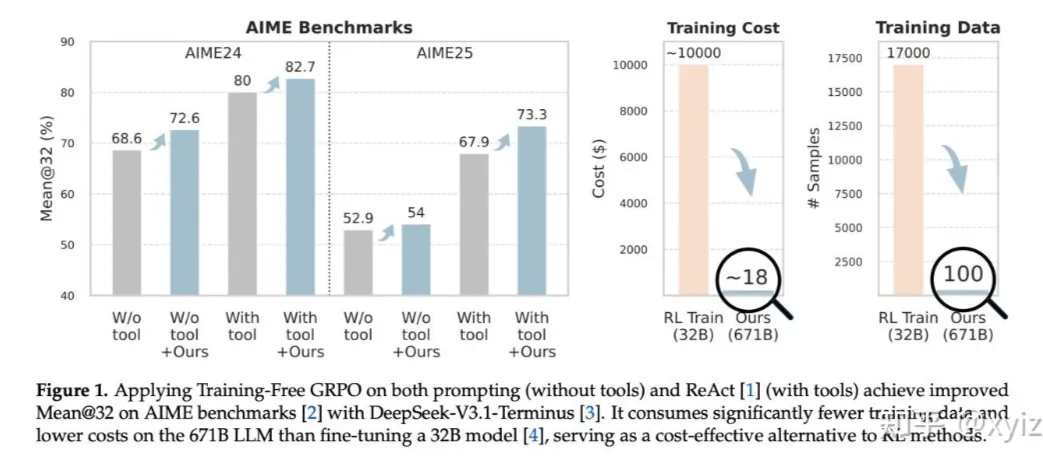

Training-Free Group Relative Policy Optimization

Training-Free Group Relative Policy Optimization (arXiv:2510.08191)

原文:https://arxiv.org/abs/2510.08191

2025 年初,以 DeepSeek-R1 为代表的模型证明了通过强化学习(特别是 GRPO 算法)可以让模型产生强大的思考能力。但对于 Agent 应用而言,标准 GRPO 需要进行昂贵的梯度反向传播和参数更新,成本极高,且在垂直领域中容易面临数据匮乏和灾难性遗忘(过拟合)的问题。

这篇研究提出了一种 Training-Free GRPO。它将策略优化从“Parameter space”彻底转移到了“Context space”。它的运行逻辑完全模拟 GRPO:对同一个 Query 生成一组Rollouts,但它不计算数学上的 Advantage 去更新权重,而是让 LLM 充当裁判,对这组尝试的“胜者和败者”进行对比内省,提取出自然语言形态的 “Semantic Group Advantage” 。这些语义经验作为 Token Prior 注入到后续上下文,完成免训练的强化学习闭环。

使用这种纯上下文驱动的 RL 方法,只需百余条训练样本驱动冻结的旗舰模型(如 DeepSeek-V3),就能匹敌甚至超越全参数微调的 32B 大模型。更夸张的是,它的“学习成本”从微调的 800 美元直接降维打击至仅需 8 美元的推理 API 费用。

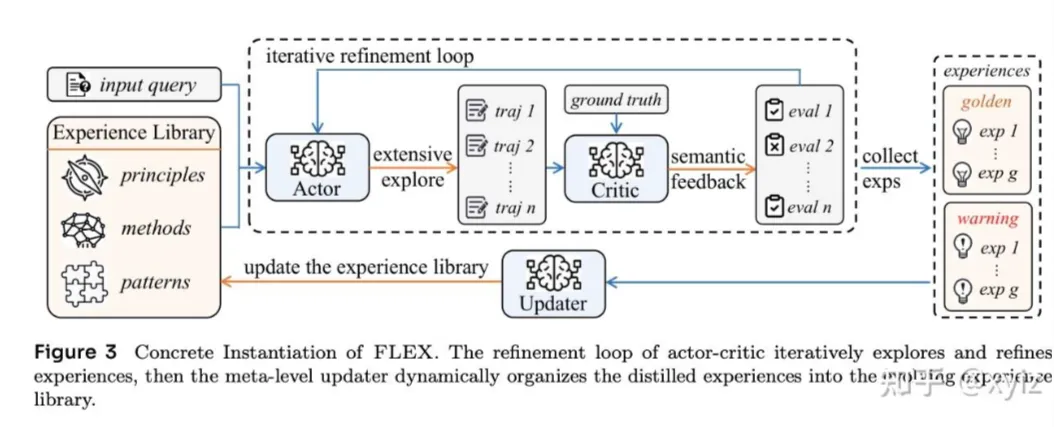

FLEX: Continuous Agent Evolution via Forward Learning from Experience

FLEX: Continuous Agent Evolution via Forward Learning from Experience (arXiv:2511.06449)

原文:https://arxiv.org/abs/2511.06449

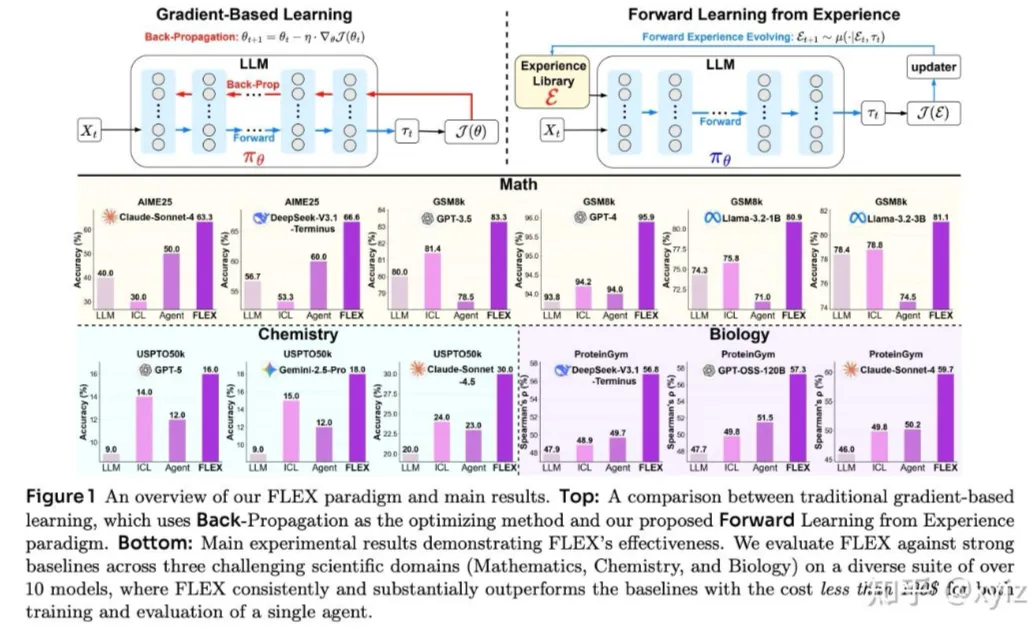

清华大学等团队提出的 FLEX(Forward Learning with EXperience)提出了一个与“反向传播”截然不同的概念:前向学习(Forward Learning)。它构建了一个Actor和Updater交织的循环机制,Agent 在与环境的互动中不断收集、蒸馏经验,存入结构化的经验库。

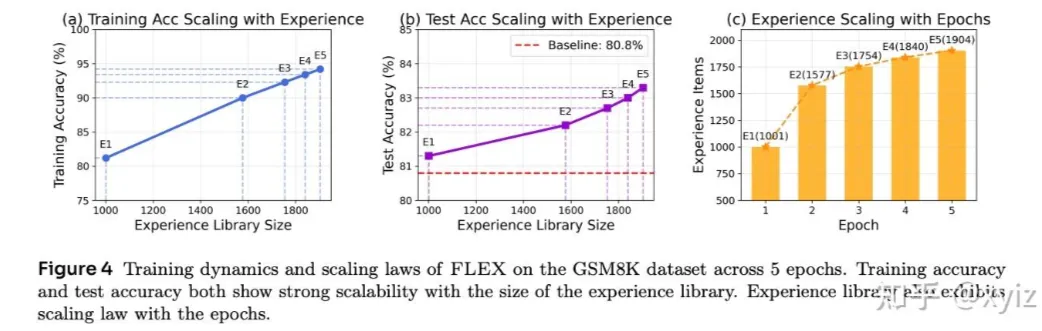

该研究另一个发现是:提出了经验增长的 Scaling Law,证明了 Agent 的能力会随着经验库容量的扩大而呈现数学上可预测的线性/对数增长。

FLEX 在数学(AIME)、化学合成(USPTO50k)和生物预测等多个科学领域实现了提升。例如在 Claude-Sonnet 上,仅仅学习了 49 个交互案例,其 AIME 准确率就从 40% 拉升至 63.3%:

总结

如果说早期基于 RAG 与 Prompt Engineering 的上下文管理是为 Agent 打造了一把锋利的“外挂瑞士军刀”,那么 Agentic Context Engineering 则是赋予了 Agent 能够自己 “打磨刀刃、编写秘籍、繁衍经验” 的灵魂。

从 ACE 和 SCOPE 的提示词自我演进,到 ReasoningBank 和 FLEX 的经验记忆沉淀,甚至 Training-Free GRPO 在无梯度下的策略跃迁,以及 ACON 带来的自主上下文瘦身,解释了上下文工程的未来方向:大语言模型不仅是推理的引擎,更是自我优化的主体。

夜雨聆风

夜雨聆风